直逼DeepSeek-R1-32B,碾压李飞飞s1!UC伯克利等开源全新SOTA推理模型

时间:25-04-22

新智元报道

免费影视、动漫、音乐、游戏、小说资源长期稳定更新! 👉 点此立即查看 👈

编辑:编辑部 HNYZ

【新智元导读】近日,斯坦福、UC伯克利等多机构联手发布了开源推理新SOTA——OpenThinker-32B,性能直逼DeepSeek-R1-32B。其成功秘诀在于数据规模化、严格验证和模型扩展。32B推理模型,仅用1/8数据,与同尺寸DeepSeek-R1打成平手!

就在刚刚,来自斯坦福、UC伯克利、华盛顿大学等机构联手发布了一款SOTA级推理模型——OpenThinker-32B,并同时开源了高达114k的训练数据。

项目主页:https://www.open-thoughts.ai/blog/scale

Hugging Face:https://huggingface.co/open-thoughts/OpenThinker-32B

数据集:https://huggingface.co/datasets/open-thoughts/OpenThoughts-114k

团队发现:采用经DeepSeek-R1验证标注(基于R1蒸馏)的大规模优质数据集,便可训练出SOTA的推理模型。

具体方法,就是通过数据规模化、推理过程验证以及模型规模扩展。

由此得到的OpenThinker-32B,在数学、代码和科学等多个基准测试中,OpenThinker-32B性能直接碾压了李飞飞团队s1和s1.1模型,直逼R1-Distill-32B。

值得一提的是,相比于使用了800k数据(包含600k个推理样本)的R1-Distill,OpenThinker-32B仅用了114k数据,就能拿下几乎同等的优异成绩。

结果均通过开源评估框架Evalchemy计算得出

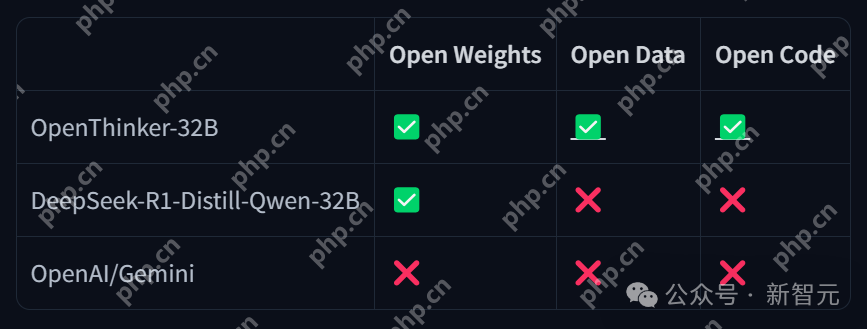

除此之外,OpenThinker-32还把模型权重、数据集、数据生成代码、训练代码上,全部都给公开了!

数据策展

研究人员使用了与之前训练OpenThinker-7B模型相同的OpenThoughts-114k数据集来训练OpenThinker-32B。

他们利用DeepSeek-R1模型,收集了精心挑选的17.3万个问题的推理过程和解答尝试。然后将这些原始数据作为OpenThoughts-Unverfied-173k数据集公开发布。

整个流程的最后一步是,如果推理过程未能通过验证,就过滤掉相应的数据样本。

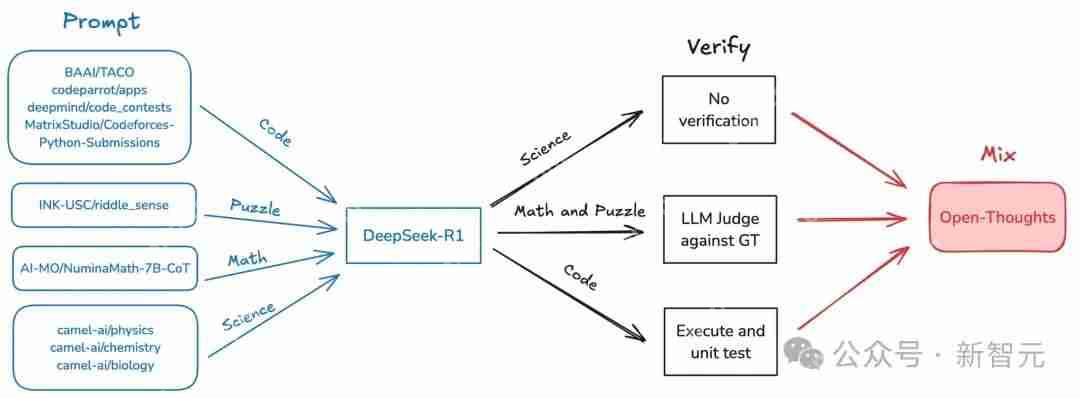

下图可视化地展示了整个过程。

研究团队首先输入源数据或问题提示,这些内容可以来自不同的领域和平台,如BAAI/TACO、DeepMind、Python提交等,涉及代码、谜题、科学和数学等多个方面。

接着这些多元的输入会进入核心的处理模块——DeepSeek-R1,在这里对数据进行分析与处理。这些问题会被分成三个方面,分别是:科学类问题、数学与谜题和代码。

有些结果不需要验证,可能是简单的分析或直接输出。对于一些需要深入验证的内容,利用大语言模型(LLM)采用与GT(Ground Truth)对比的方式进行评判。如果是代码,执行代码并进行单元测试,确保代码的正确性和有效性。

最后能将不同方向的结果结合起来,生成开放的思考和更为综合的解决方案。

研究团队更新了最终的OpenThoughts-114k数据集,加入了一个名为「metadata」的配置,其中包含了一些用于数据集构建的额外列:

problemground_truth_solutiontest_cases (code only)starter_code (code only)DeepSeek_reasoningDeepSeek_solutiondomainsource这些额外的元数据将使得这个数据集更容易用于新的场景,例如数据过滤、领域切换、验证检查以及更改推理过程的模板。

这些额外的元数据将得使该数据集使用起来更加容易,仅需一行代码就能完成例如过滤、更换领域、检查验证和更改推理跟踪模板等。

代码语言:javascript代码运行次数:0运行复制load_dataset("open-thoughts/OpenThoughts-114k", "metadata", split="train")这就是直逼DeepSeek-R1-32B,碾压李飞飞s1!UC伯克利等开源全新SOTA推理模型的全部内容了,希望以上内容对小伙伴们有所帮助,更多详情可以关注我们的菜鸟游戏和软件相关专区,更多攻略和教程等你发现!

专题合集

精彩合集,奇葩无下限相关文章

大家还在看

-

- 《神火大陆》希尔神域第11层奇遇任务1攻略

-

26-04-01

-

- 金铲铲之战S17拉亚斯特技能费用介绍

-

26-04-01

-

- 金铲铲之战阿狸的光坏神器效果一览

-

26-04-01

-

- 《蓝色星原:旅谣》芃芃介绍

-

26-04-01

-

- 《无径之林》建筑雕像解锁条件介绍

-

26-04-01