Ollama本地模型接入OpenClaw教程

时间:26-04-01

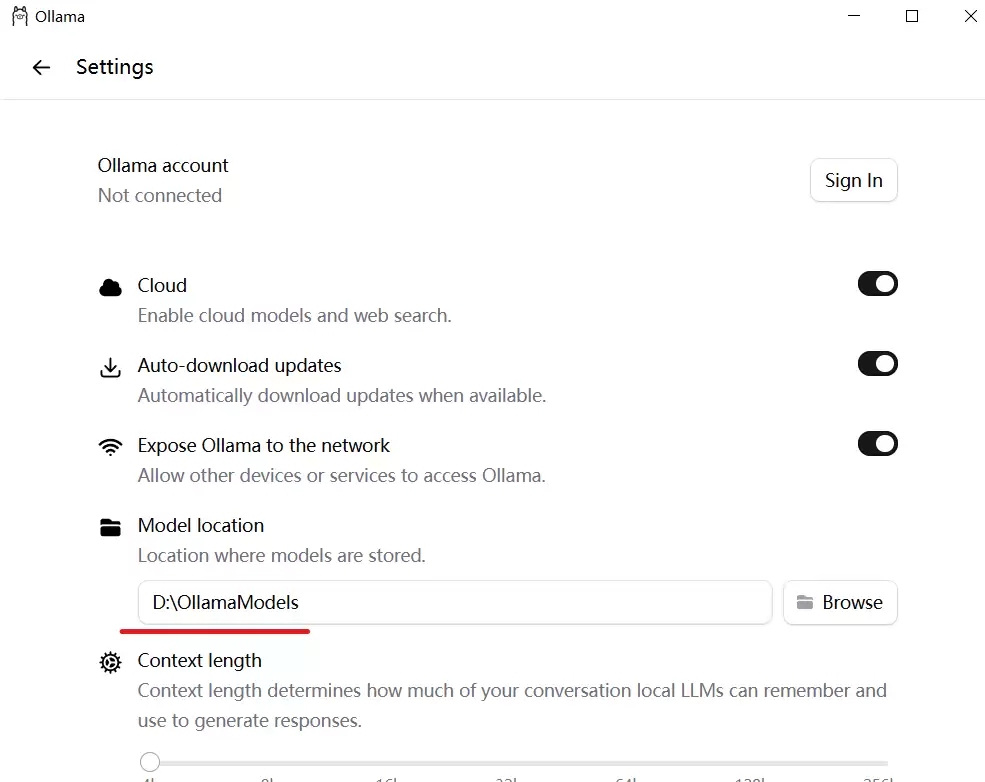

访问Ollama官网获取安装程序,完成部署后启动应用。系统默认将模型文件存储在C盘。鉴于大语言模型通常占用数十GB空间,建议你主动修改存储位置以释放系统盘压力。

免费影视、动漫、音乐、游戏、小说资源长期稳定更新! 👉 点此立即查看 👈

进入Ollama界面,在左侧导航栏选择“Settings”。配置面板中的“Model location”项即用于更改模型仓库路径。关键提示:务必选择NVMe或SATA固态硬盘分区作为存储位置,传统机械硬盘的IO性能会严重拖慢模型加载与推理速度。

一、选择模型

1.查看可自动识别模型

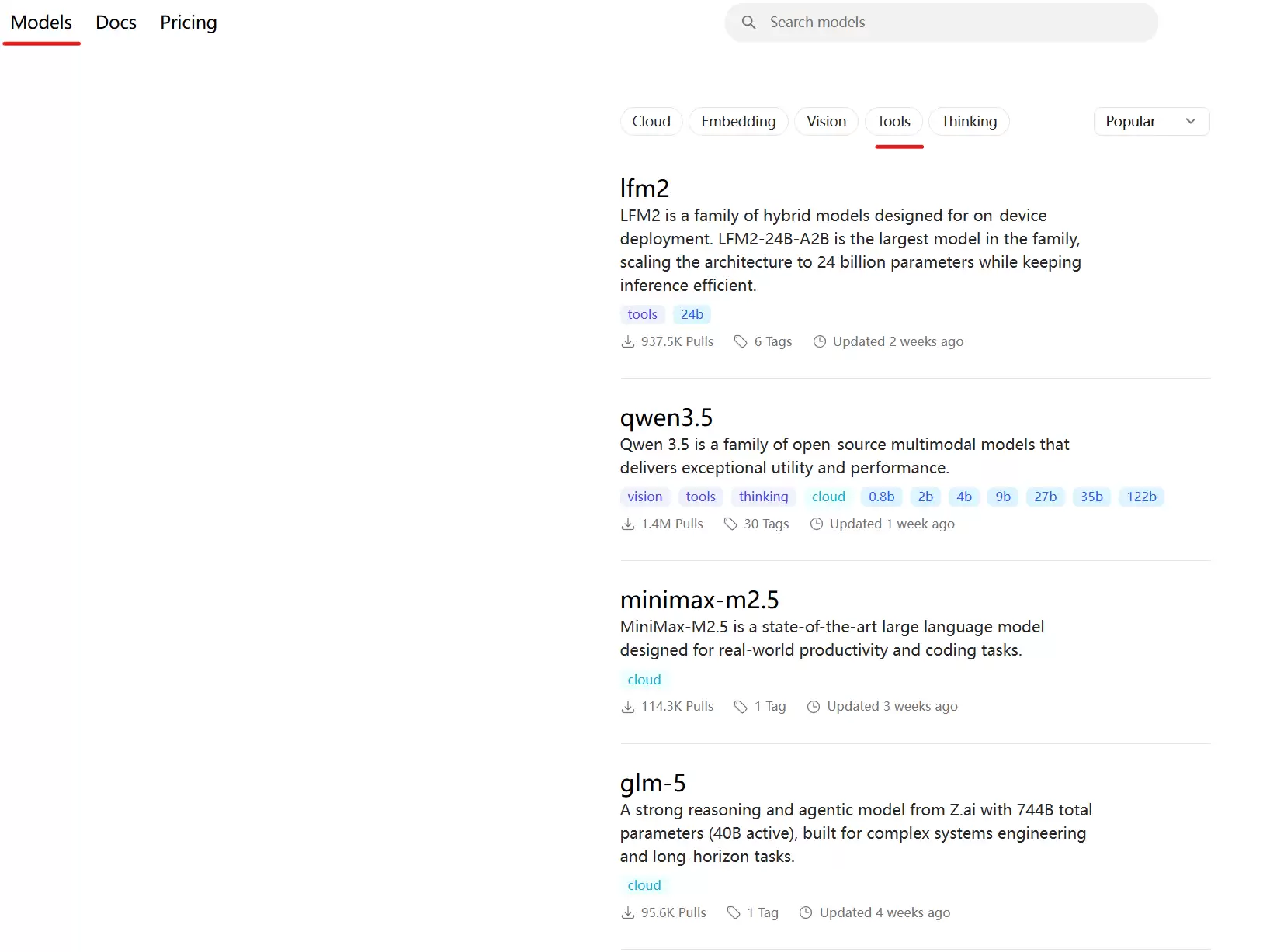

Ollama官方模型库收录了所有可用模型。但OpenClaw仅能自动探测那些明确声明支持tools(函数调用)能力的模型,因此需要定向筛选。在模型库页面,点击顶部“Models”分类,随后激活右侧的“Tools”筛选标签。当前列表中的模型均已通过工具调用兼容性验证,可直接选用并部署。

2.下载模型

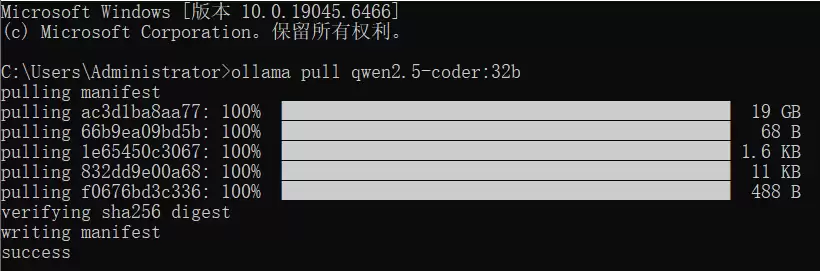

确定模型后,通过Win+R快捷键启动运行对话框,输入“CMD”进入命令行终端。使用标准拉取指令获取模型文件:

# ollama pull + 要拉取的模型名称

ollama pull qwen2.5-coder:32b执行命令后,终端将实时显示下载进度与分层拉取日志,模型会自动缓存至你预设的存储目录。

二、环境变量

1.配置环境变量

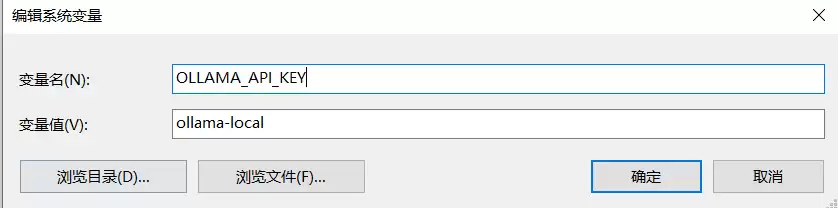

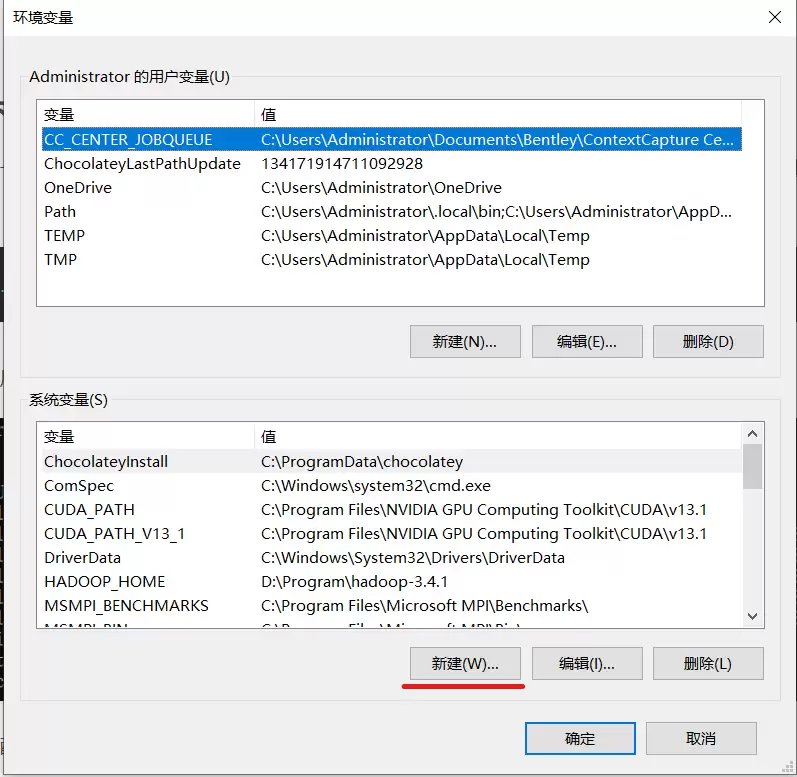

(1)通过图形化界面设置

在Windows搜索栏输入“编辑系统环境变量”并打开配置窗口。点击“环境变量”进入编辑界面。

在“系统变量”区域点击“新建”,分别填入以下键值对并确认保存:

# 变量名

OLLAMA_API_KEY

# 变量值

ollama-local(2)通过PowerShell设置

偏好命令行的用户可直接在PowerShell中执行以下指令完成持久化配置:

# 1. 永久设置用户环境变量

[Environment]::SetEnvironmentVariable("OLLAMA_API_KEY", "ollama-local", "User")

# 2. 让当前终端立即生效(不用重启)

$env:OLLAMA_API_KEY = "ollama-local"

# 3. 再次确认

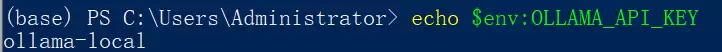

echo $env:OLLAMA_API_KEY2.验证环境变量是否配置成功

执行验证前,请确认Ollama后台服务进程处于活动状态。

(1)在PowerShell中检查环境变量是否生效

启动PowerShell终端,运行查询命令:

echo $env:OLLAMA_API_KEY配置成功后终端将准确回显“ollama-local”。若无输出,则表明变量未成功注入系统会话,需重新检查配置步骤。

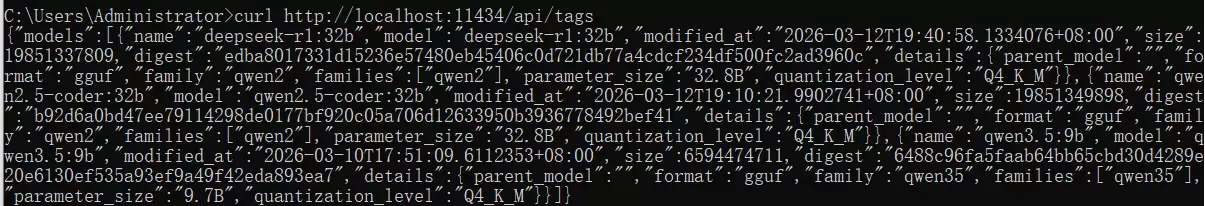

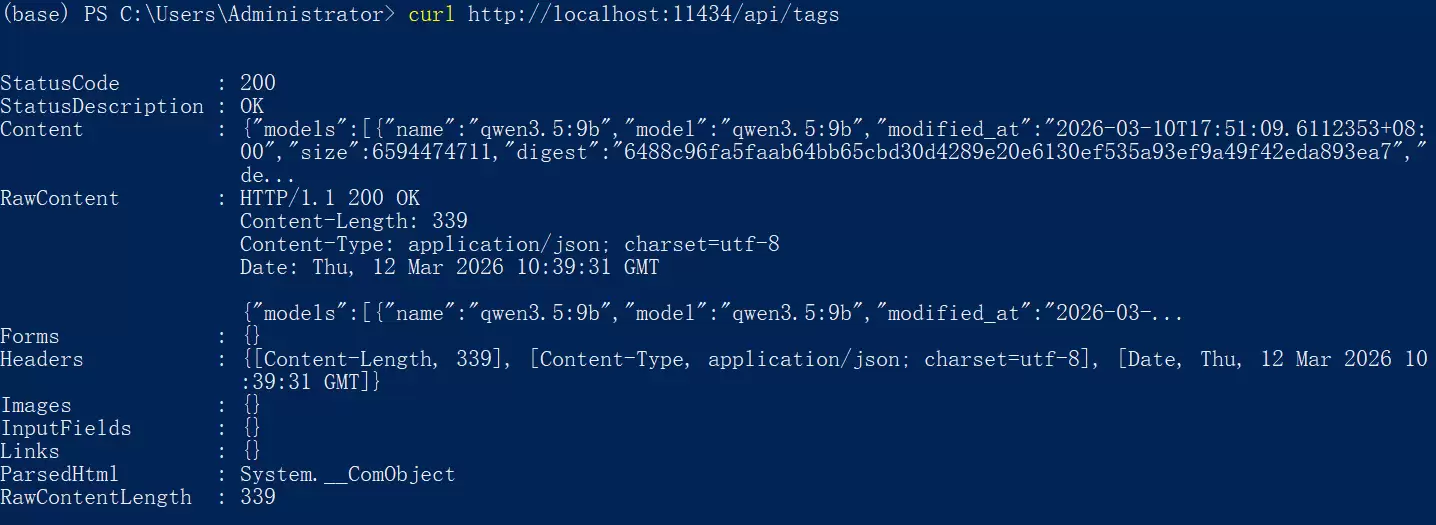

(2)测试 Ollama API 是否能被 OpenClaw 访问

在PowerShell或CMD中执行API连通性测试:

curl http://localhost:11434/api/tags该指令用于验证OpenClaw能否通过RESTful API与本地Ollama实例通信。正常响应将返回包含已加载模型清单的JSON数据包。

若请求超时或返回连接错误,通常意味着Ollama服务未在11434端口监听,需检查服务状态与端口占用情况。

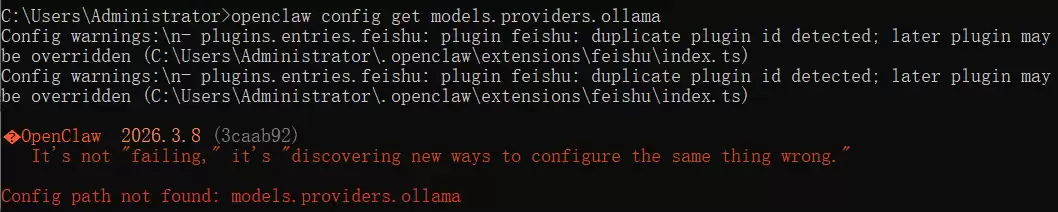

(3)验证 3:OpenClaw 的 Ollama 配置是否屏蔽了自动发现

最后检测OpenClaw内部配置状态:

openclaw config get models.providers.ollama正确配置下应仅返回apiKey: "你设置的值"。若出现包含baseUrl、models等完整配置树,则表明自动发现机制已被手动配置覆盖而失效。

这说明环境变量未能被OpenClaw正确读取。按顺序执行以下修复命令重建配置链路:

# 第一步:设置Ollama的apiKey(任意非空值即可,比如"local-ollama")

openclaw config set models.providers.ollama.apiKey "local-ollama"

# 第二步:手动指定Ollama的本地地址(确保和Ollama服务端口一致)

openclaw config set models.providers.ollama.baseUrl "http://localhost:11434"

# 第三步:验证配置是否生效(此时应该能返回配置,而不是"path not found")

openclaw config get models.providers.ollama配置同步完成后,再次执行查询指令:

openclaw config get models.providers.ollama此时应返回完整且生效的Ollama连接配置,表明修复成功。

这就是Ollama本地模型接入OpenClaw教程的全部内容了,希望以上内容对小伙伴们有所帮助,更多详情可以关注我们的菜鸟游戏和软件相关专区,更多攻略和教程等你发现!

专题合集

精彩合集,奇葩无下限相关文章

大家还在看

-

- 洛克王国嘟嘟恶魔配队攻略:平民/高配阵容推荐

-

26-04-01

-

- 《毒液突击队》武器专家成就解锁指南

-

26-04-01

-

- 洛克王国双风墙毒队玩法指南:阵容搭配与操作详解

-

26-04-01

-

- 洛克王国世界共有哪些种类?全类别解析与图鉴

-

26-04-01

-

- 冬季星空格外清晰的成因:关键因素详解

-

26-04-01