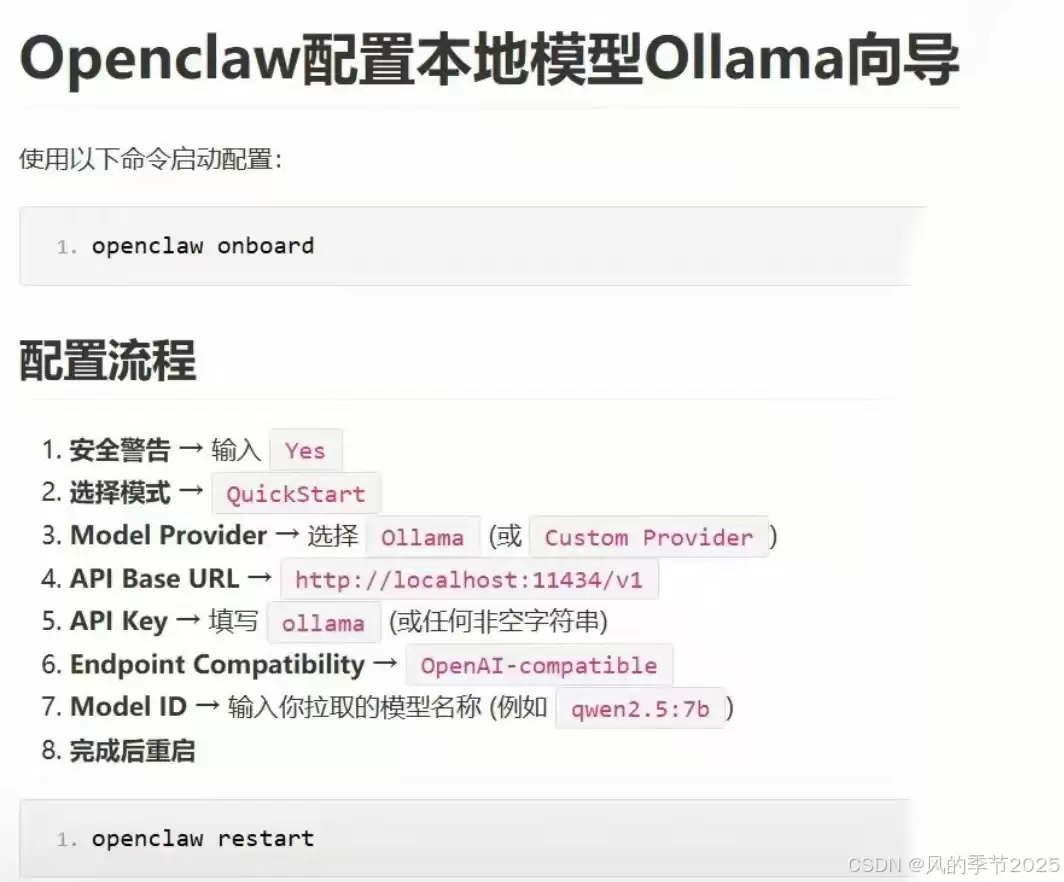

Openclaw标准安装 配置本地模型Ollama

时间:26-04-01

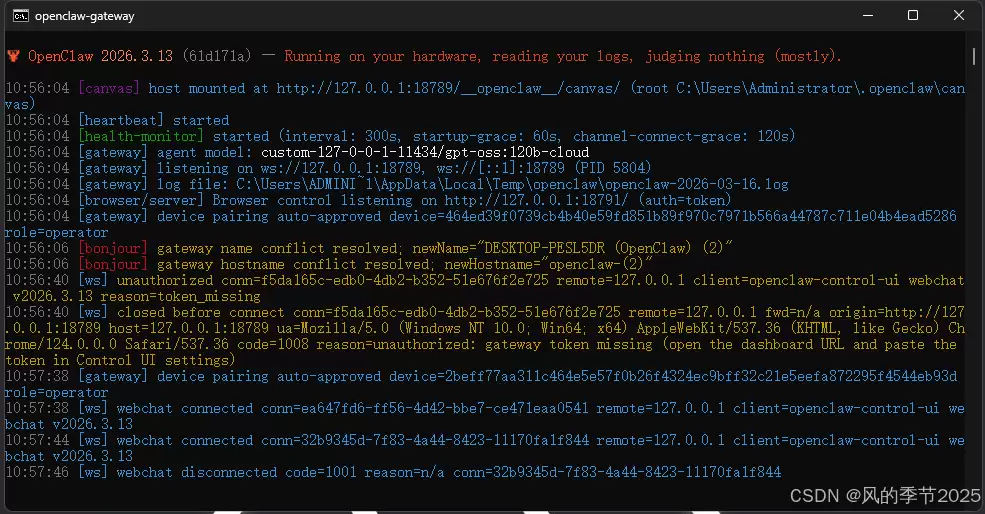

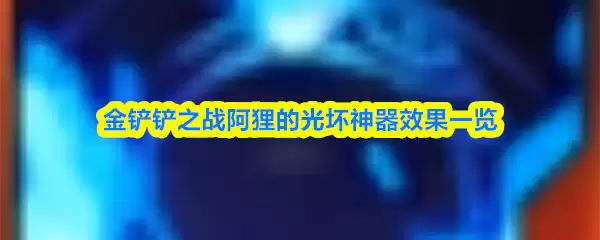

OpenClaw本地模型配置:Ollama集成简明教程

通过OpenClaw与本地Ollama模型集成,您可以在安全、私有的环境中部署AI助手。本指南将引导您完成配置的核心步骤。

免费影视、动漫、音乐、游戏、小说资源长期稳定更新! 👉 点此立即查看 👈

初始化配置

在终端执行以下命令,启动配置向导:

openclaw onboard

分步配置参数解析

跟随命令行提示,准确输入以下关键参数。每一步都直接影响Ollama的API连接成功率。

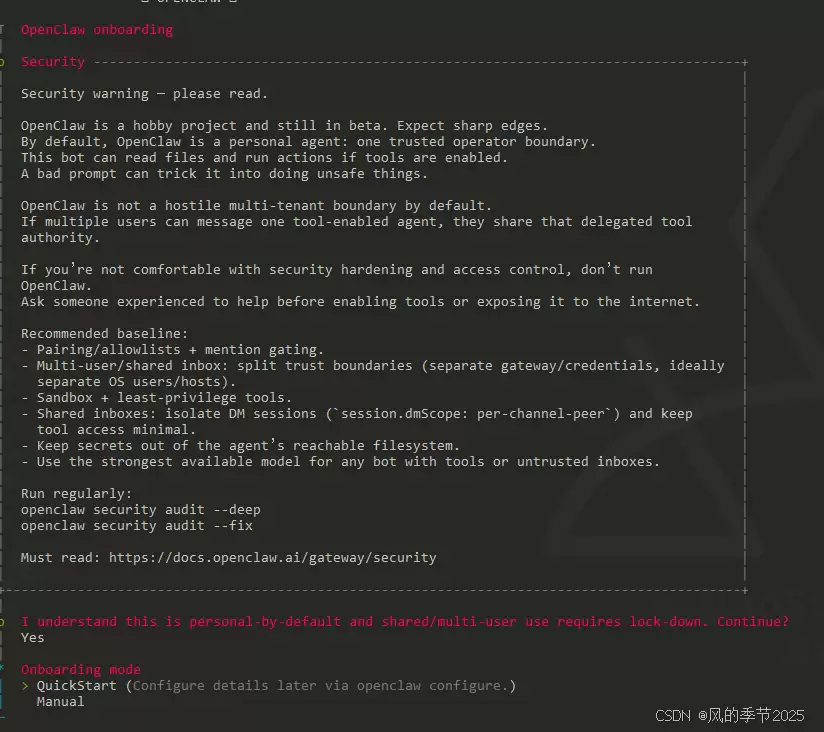

1. 系统安全提示确认:输入 "Yes" 授权继续配置

2. 部署模式选择:为快速验证,选择 "QuickStart" 方案

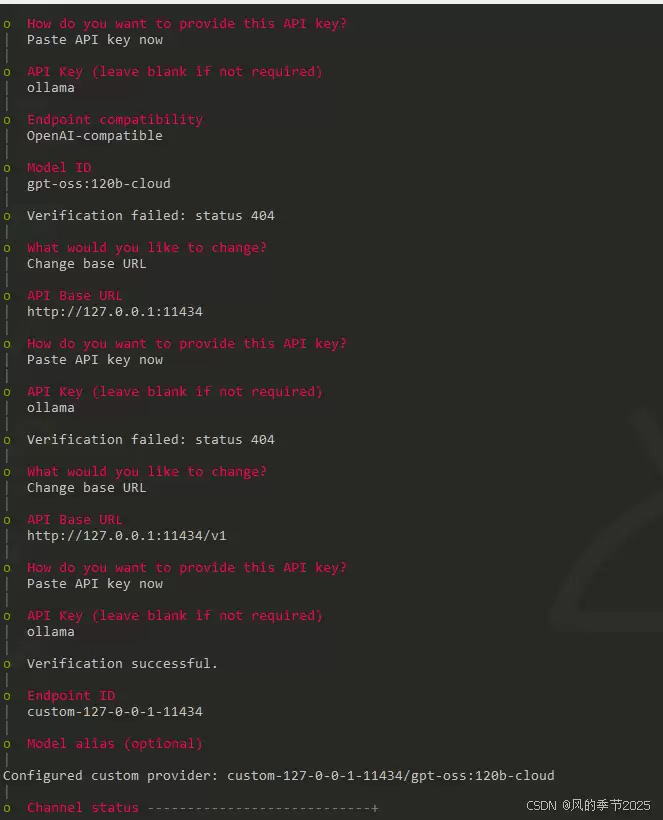

3. 模型供应商设置:指定为 "Ollama"(高级用户可选“Custom Provider”进行自定义)

4. API基础地址配置:填入本地端点 http://localhost:11434/v1

5. API密钥验证:输入 "ollama" 作为密钥(或任一非空字符串)

6. 接口兼容性选择:设定为 "OpenAI-compatible" 以匹配标准协议

7. 模型标识符指定:输入您已通过Ollama拉取的模型名称,例如“qwen2.5:7b”

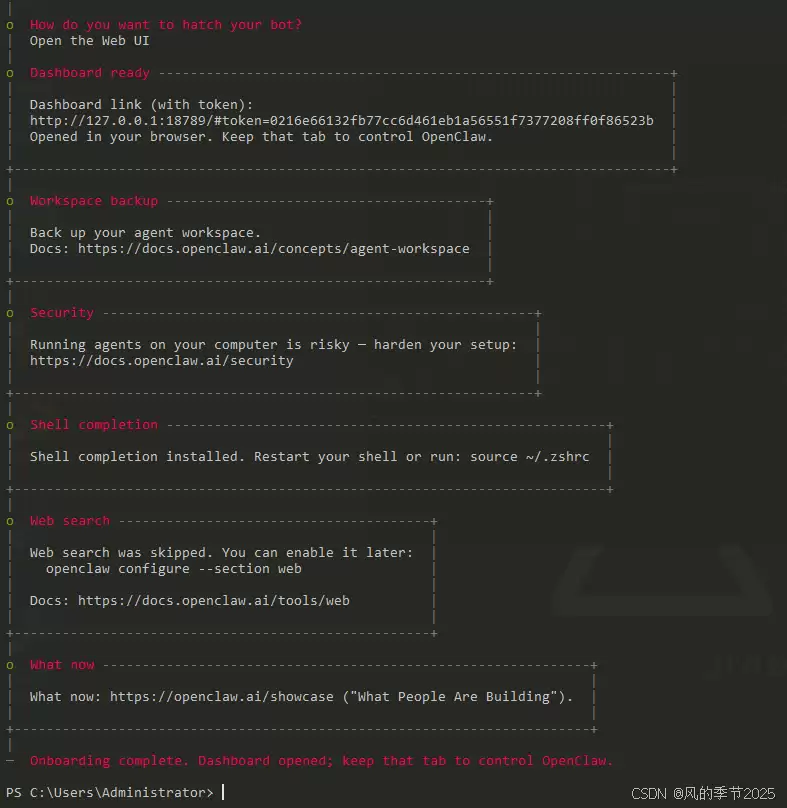

使配置生效

全部参数设置完毕后,必须重启OpenClaw服务,以加载新的Ollama连接器。

openclaw restart

这就是Openclaw标准安装 配置本地模型Ollama的全部内容了,希望以上内容对小伙伴们有所帮助,更多详情可以关注我们的菜鸟游戏和软件相关专区,更多攻略和教程等你发现!

专题合集

精彩合集,奇葩无下限相关文章

大家还在看

-

- 《神火大陆》希尔神域第11层奇遇任务1攻略

-

26-04-01

-

- 金铲铲之战S17拉亚斯特技能费用介绍

-

26-04-01

-

- 金铲铲之战阿狸的光坏神器效果一览

-

26-04-01

-

- 《蓝色星原:旅谣》芃芃介绍

-

26-04-01

-

- 《无径之林》建筑雕像解锁条件介绍

-

26-04-01