openclaw 配置ollama急救

时间:26-04-01

从技术入门阶段的一个典型痛点切入:当你依照教程配置新工具却卡在某一步,反复尝试后依旧报错,这种体验确实会打击热情。这并非个例,而是技术学习路径中的常见节点。我们来系统性地拆解你遇到的这个具体问题。

免费影视、动漫、音乐、游戏、小说资源长期稳定更新! 👉 点此立即查看 👈

核心故障:OpenClaw Onboard 无法完成 Ollama 模型配置

首先,我们锁定问题的边界。你已成功在本地部署了Ollama和OpenClaw,并且拉取了如Llama 3.1、Qwen等主流模型文件。这证明基础软件安装与环境搭建是成功的。

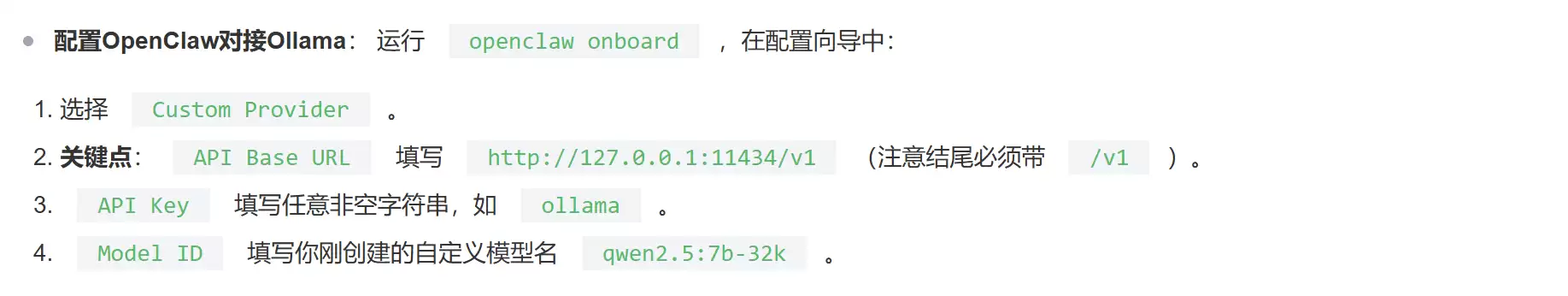

随后,你按照官方文档流程,进入模型配置环节:

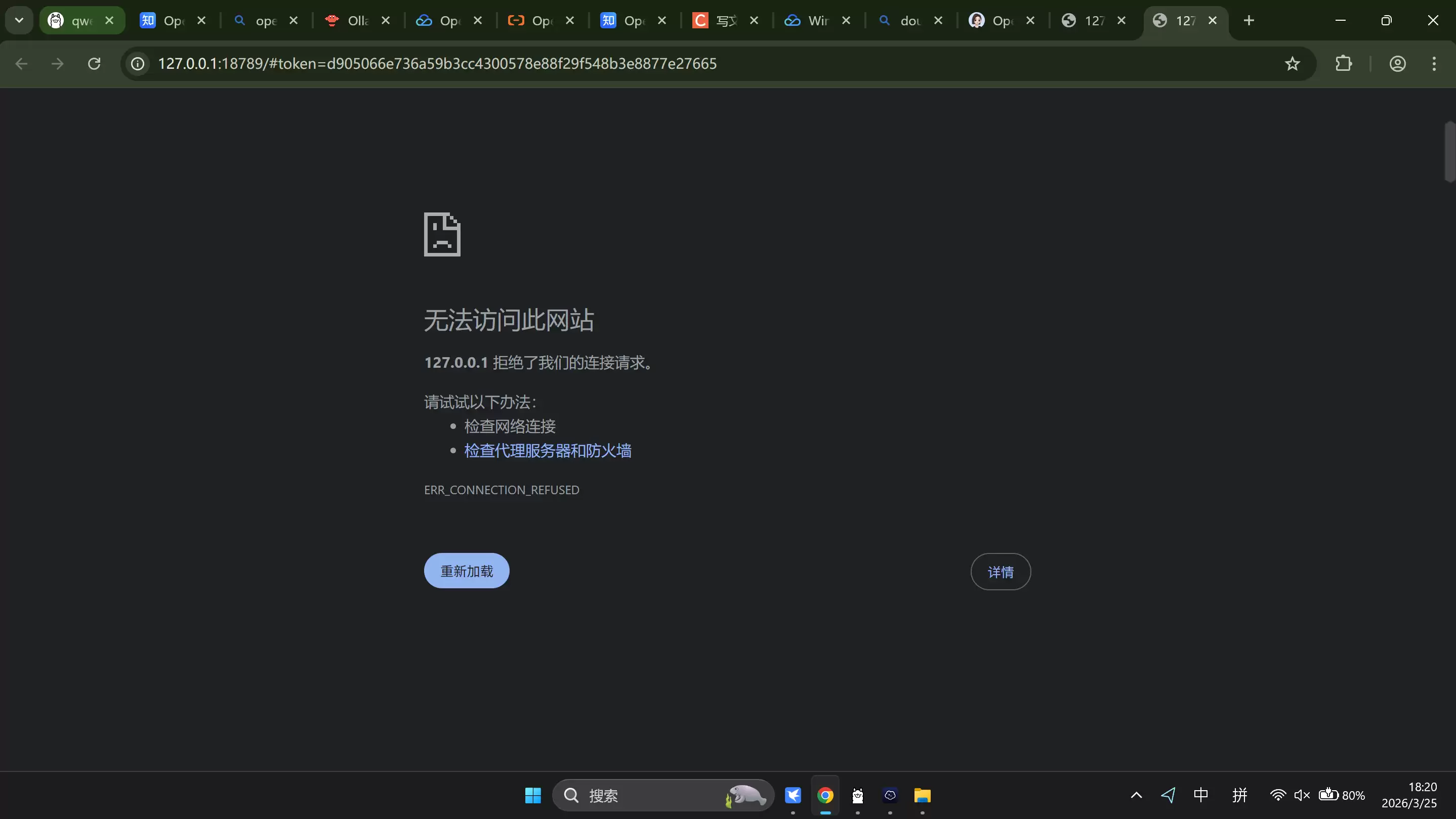

但在关键的配置页面,系统返回了连接失败的结果:

页面提示明确指向了与Ollama服务的网络连通性问题。

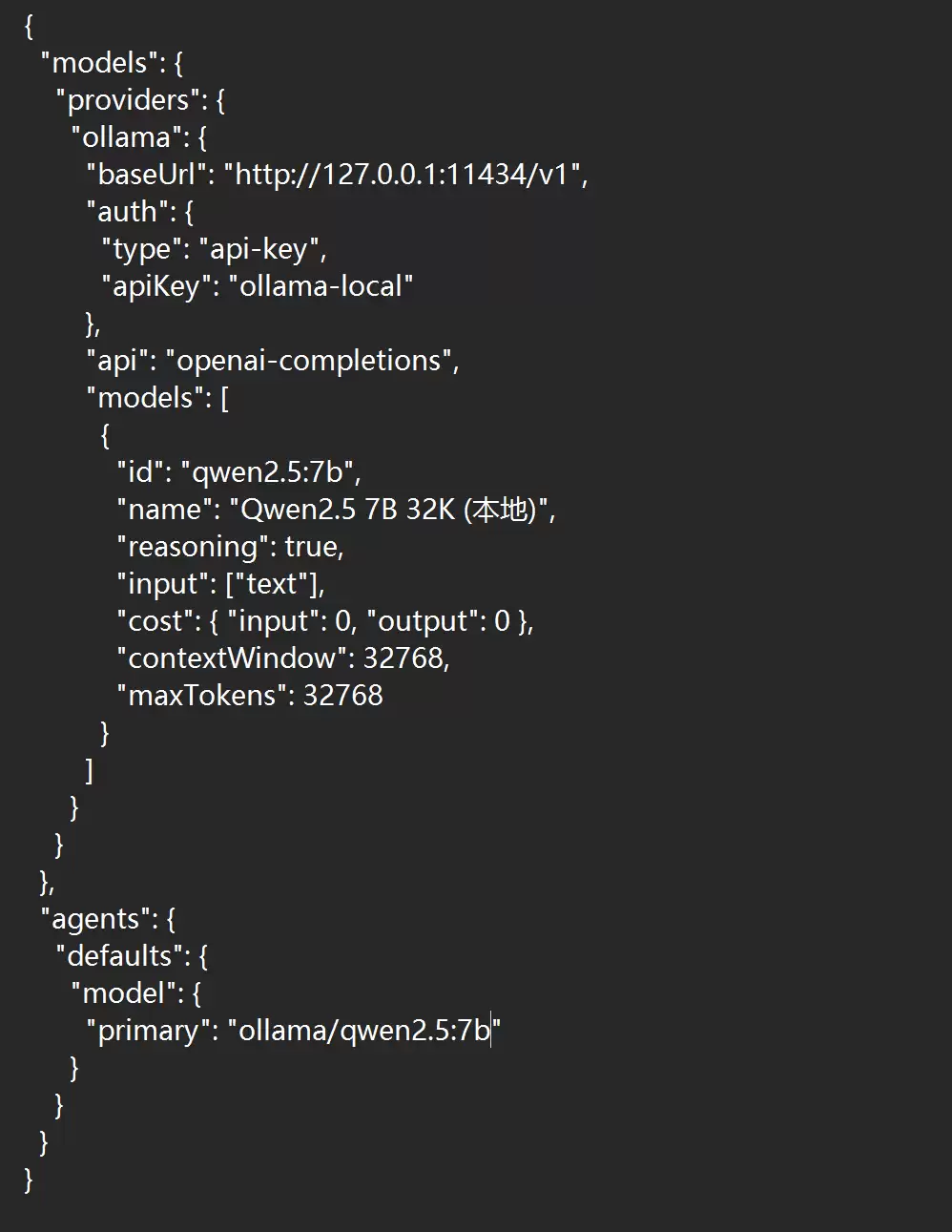

你采取的初步排查措施是合理的——直接修改openclaw.json配置文件,手动指定Ollama的API端点地址:

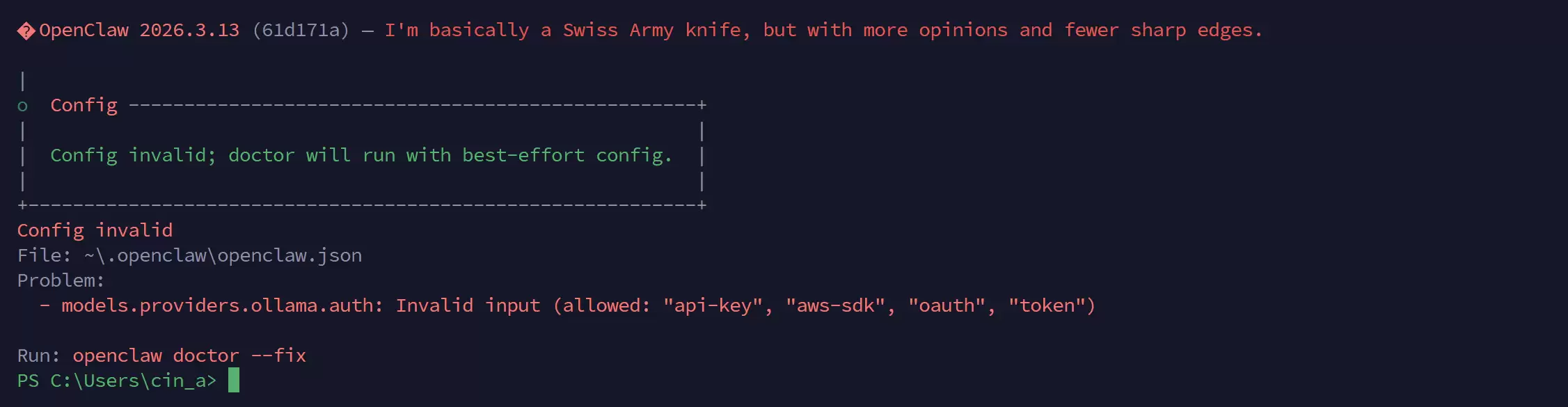

修改后,通过openclaw tui命令进行测试,终端返回了更具诊断价值的错误日志:

日志明确指出,尝试访问http://localhost:11434时遭遇“Connection refused”。这个状态码意味着客户端能解析目标地址,但目标端口上没有活跃的服务在监听请求。

至此,故障根因已足够清晰。问题不在配置文件的语法或OpenClaw本身,而在于服务端状态。解决路径非常直接:首要任务是验证Ollama后台服务是否已正确启动并监听在预期的11434端口上。我们将通过几个简单的终端命令来确认这一点。

这就是openclaw 配置ollama急救的全部内容了,希望以上内容对小伙伴们有所帮助,更多详情可以关注我们的菜鸟游戏和软件相关专区,更多攻略和教程等你发现!

专题合集

精彩合集,奇葩无下限相关文章

大家还在看

-

- 奇异人生重聚一次两次成交成就怎么解锁-一次两次成交成就解锁指南

-

26-04-01

-

- 金铲铲之战S17努努技能费用介绍

-

26-04-01

-

- 永恒老乔玩法全解析:水上世界核心英雄攻略

-

26-04-01

-

- 《黑子的篮球》街头对决平民球员大揭秘

-

26-04-01

-

- 洛克王国世界成长赠礼获取攻略

-

26-04-01