OpenClaw 之父谈 AI 温差:美国员工会因“养龙虾”被裁,中国员工不用反而会被开除

时间:26-04-01

OpenClaw创始人解读AI应用鸿沟:一场横跨太平洋的产业实践分野

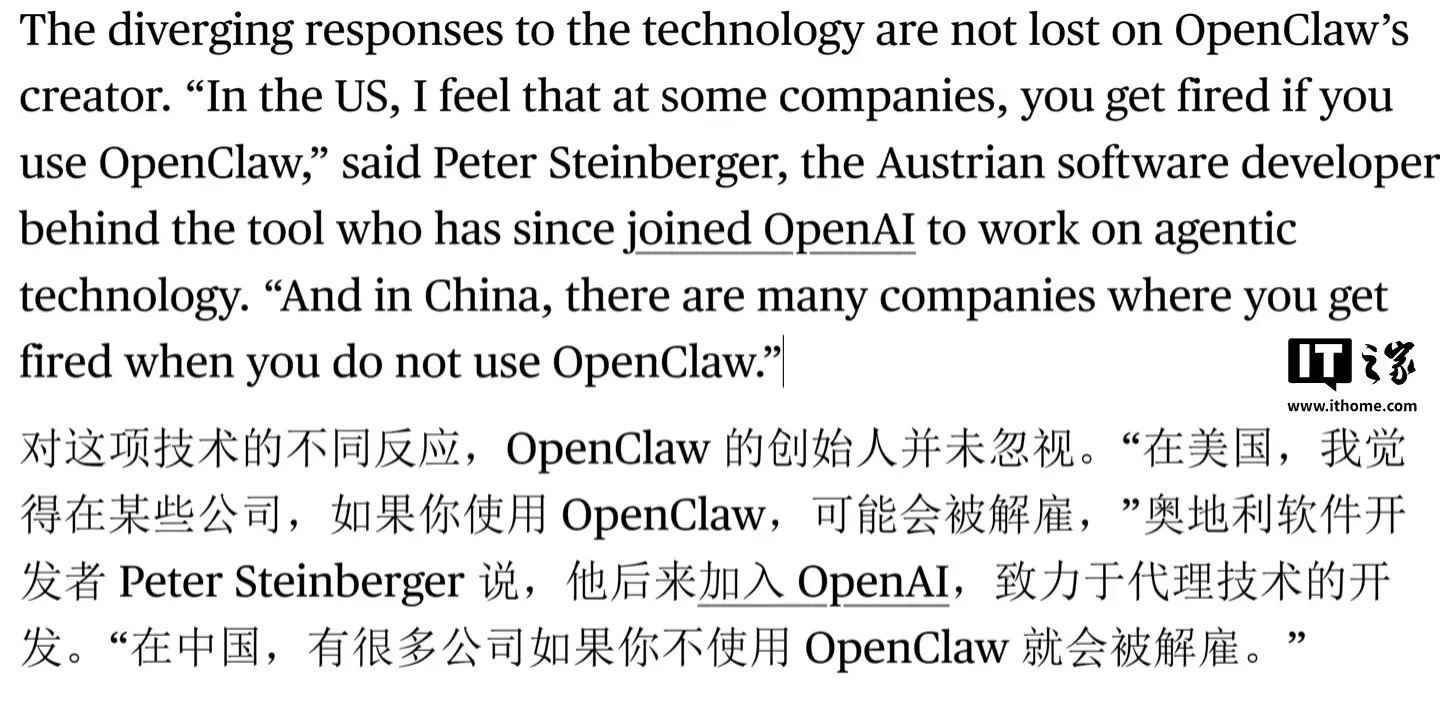

AI工具在全球市场的采纳曲线,呈现出一种耐人寻味的断裂。近日彭博社的一篇专访,将这种因地域文化与管理哲学而产生的“应用温差”,置于聚光灯下。

免费影视、动漫、音乐、游戏、小说资源长期稳定更新! 👉 点此立即查看 👈

专访核心人物是OpenClaw创始人彼得·斯坦伯格。他揭示了一个关键洞察:中国企业对AI工具展现出极强的运营驱动性,甚至将其纳入工作流强制要求;而美国企业则普遍笼罩在合规与数据安全的谨慎氛围中,部分公司已明确限制员工使用。

实践场与观察室的分野

斯坦伯格指出,中美在AI落地阶段已形成实质性鸿沟。中国市场呈现出一种高强度的压力测试环境——从教育、职场到生活场景,海量用户正在高频交互中锤炼AI产品的鲁棒性与场景适应性。尤其在企业端,将AI工具使用纳入绩效考核,使其成为一个天然的、高吞吐量的系统验证场。

相比之下,美国企业虽在技术研发上领先,却在部署环节更为审慎。尽管开发者社区对OpenClaw类工具热情高涨,但企业级决策者更优先考虑模型幻觉、数据泄露与合规风险。部分科技巨头已率先在内部网络设置访问壁垒,形成了一种“战略性隔离”。

“使用禁令”与“不使用惩罚”背后的管理逻辑

如何概括这种两极分化的职场现状?斯坦伯格的比喻一针见血:“在部分美国公司,使用OpenClaw可能成为被解雇的理由;而在许多中国公司,不使用它反而会让你面临职业风险。”

这句略显极端的对比,精准映射出两种截然不同的风险决策模型:一方致力于风险规避与控制,另一方则追求机会捕获与效率红利。

经验迁移的可能性与挑战

斯坦伯格在采访中建议,美国业界或可借鉴中国在技术快速规模化中的应用数据与迭代经验。他的核心论点是:唯有通过大规模的真实人机协同,才能系统性探测AI智能体的能力边界、失效模式与潜在漏洞,从而构建更可靠的安全护栏。远距离的理论推演,无法替代实战中获得的认知。

目前,已加入OpenAI并执掌Codex团队的斯坦伯格透露,其团队面临的核心挑战在于重新定义产品边界。随着AI智能体自主性与泛化能力的跃升,所谓“专用工具”与“通用助手”的品类划分正迅速失效。

未来的工作范式或将围绕两个核心智能体展开:个人智能体与工作智能体。在确保数据主权与隐私保护的前提下,实现跨平台、跨任务的自主调度与协同。届时,当前关于“是否该用AI”的争议,或许会如同当年质疑搜索引擎价值一样显得过时。但在那个未来到来之前,这场横跨太平洋的规模化对比实验,每一步进展都极具行业参考价值。

这就是OpenClaw 之父谈 AI 温差:美国员工会因“养龙虾”被裁,中国员工不用反而会被开除的全部内容了,希望以上内容对小伙伴们有所帮助,更多详情可以关注我们的菜鸟游戏和软件相关专区,更多攻略和教程等你发现!

专题合集

精彩合集,奇葩无下限相关文章

大家还在看

-

- 《神火大陆》希尔神域第11层奇遇任务1攻略

-

26-04-01

-

- 金铲铲之战S17拉亚斯特技能费用介绍

-

26-04-01

-

- 金铲铲之战阿狸的光坏神器效果一览

-

26-04-01

-

- 《蓝色星原:旅谣》芃芃介绍

-

26-04-01

-

- 《无径之林》建筑雕像解锁条件介绍

-

26-04-01