摩尔线程 MTT S5000 适配 FlagOS 训练全要素软件栈,实现 Qwen3-0.6B 端到端无中断训练

时间:26-04-01

3月27日关键进展:完整AI训练栈验证,国产GPU实现端到端贯通

北京智源人工智能研究院今日公布了一项标志性验证成果。该研究首次在统一的FlagOS技术栈上,成功完成了从底层硬件到上层模型的端到端全要素跑通,覆盖六款异构AI芯片、三大主流模型架构,并成功验证了同构与异构千卡集群的协同训练能力。

免费影视、动漫、音乐、游戏、小说资源长期稳定更新! 👉 点此立即查看 👈

作为核心硬件合作伙伴,摩尔线程提供了其旗舰级的MTT S5000 AI训推一体GPU智算卡。本次验证的关键在于,该卡完成了对FlagOS训练所需完整软件栈的全面适配与集成。

这套软件栈构成了大模型训练的核心技术链,包括负责资源调度的FlagScale框架、基于Megatron-LM的分布式训练架构,以及Transformer Engine、Triton算子库和FlagCX通信库等核心组件。这意味着从集群调度、模型并行到算子加速与跨节点通信的完整技术路径已实现贯通。

验证结果的数据表现具有明确的说服力。基于MTT S5000,团队完成了Qwen3-0.6B语言模型长达1T Tokens的数据规模训练,整个过程持续6天以上,累计执行超过14000个训练步,系统全程保持稳定,未发生中断。

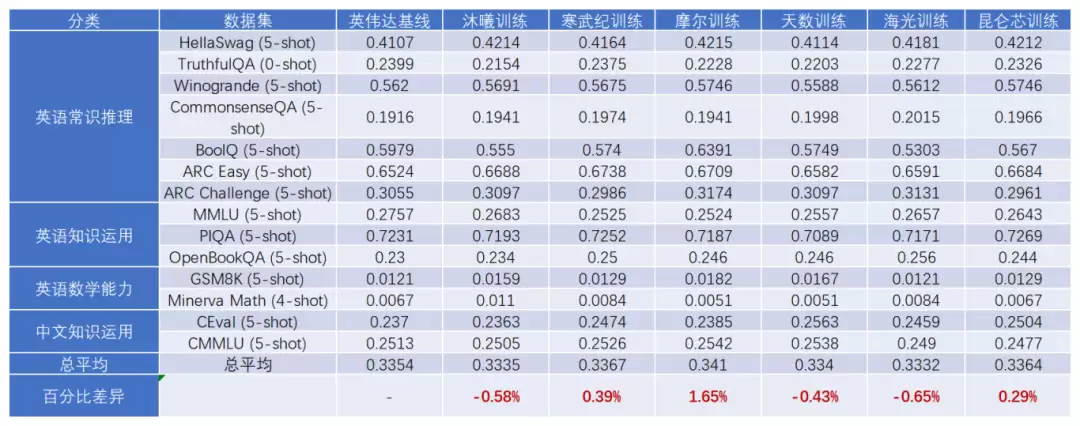

训练产出的模型,其损失曲线与行业基准高度一致,平均相对误差低于0.82%。在后续的标准下游任务评估中,模型性能甚至超过基准指标1.65个百分点。这一系列数据证实,基于MTT S5000构建的算力解决方案,能够支撑大模型从训练到产出全流程的稳定与高效。

这就是摩尔线程 MTT S5000 适配 FlagOS 训练全要素软件栈,实现 Qwen3-0.6B 端到端无中断训练的全部内容了,希望以上内容对小伙伴们有所帮助,更多详情可以关注我们的菜鸟游戏和软件相关专区,更多攻略和教程等你发现!

专题合集

精彩合集,奇葩无下限相关文章

- 如何关闭高德地图导航语音-高德地图导航语音关闭方法

- 如何查询我的常德无犯罪记录证明-我的常德无犯罪记录证明查询方法

- 咔皮记账怎么同步多设备-咔皮记账如何在多设备间同步

- 知犀思维导图app如何更改颜色-知犀思维导图app怎样变换颜色

- 贾跃亭宣布法拉第未来月底将超额完成机器人首月 20 台交付目标

- 消息称魅族 AR 眼镜品牌 StarV 的 AR 系统团队整体入职雷鸟创新

- realme 全面接入 OPPO 售后服务网络:即日开启过渡整合,4 月起统一提供支持

- openClaw常用操作命令

- openclaw[龙虾]禁用版本升级提示

- 古尔曼:苹果 CEO 候选人 John Ternus 广受高层欢迎,曾扭转产品质量下滑局面

大家还在看

-

- 《神火大陆》希尔神域第11层奇遇任务1攻略

-

26-04-01

-

- 金铲铲之战S17拉亚斯特技能费用介绍

-

26-04-01

-

- 金铲铲之战阿狸的光坏神器效果一览

-

26-04-01

-

- 《蓝色星原:旅谣》芃芃介绍

-

26-04-01

-

- 《无径之林》建筑雕像解锁条件介绍

-

26-04-01