2026 年 4 月降 AI 率效果实测!10 款主降 AI 软件,比话最终把 AI 率从 84% 降到 1.4%!

时间:26-04-07

2026 毕业季论文 AI 率检测深度指南:现行标准、核心挑战与高效对策

2026届毕业生即将迎来论文审核季。目前,国内高校对毕业论文的AI生成内容(AIGC)检测标准已趋严格。一项针对80所院校的内部调研显示,多数学校将AI率的警戒线设定在20%-30%;部分985/211院校的硕士、博士论文要求更为苛刻,直接降至15%。未能通过AIGC检测的直接后果往往是延期答辩,这无疑是每位毕业生必须严肃应对的学术关卡。

免费影视、动漫、音乐、游戏、小说资源长期稳定更新! 👉 点此立即查看 👈

当前真正的困境在于,主流AIGC检测系统本身像一个“算法黑箱”。一个高频出现的状况是:完全由作者独立构思、撰写的段落,也可能被系统误判为AI生成。令事态更复杂的是,随着检测算法的持续迭代,许多同学发现,去年年底检测AI率尚在安全范围(如18%)的论文,今年未作任何修改再次检测,结果可能陡增至30%以上。文本纹丝未动,变化的只是后台的识别模型。

面对算法的不确定性,传统的“同义词替换”、“语序调整”等手动改写方法,其降AI效果已大打折扣。因此,毕业生们转而寻求专业降AI工具的帮助。随之而来的问题是:市面声称具备此功能的工具不下数十种,究竟哪一款能稳定应对知网的检测?付费后若效果不达标怎么办?商家的宣传数据,其可信度又该如何验证?

针对这些普遍疑虑,我们历时两周,对市面主流的10款降AI工具进行了集中横向评测,测试环境严格对标知网AIGC检测系统。

核心结论先行:在针对知网的专项测试中,“比话”表现最为稳定,成功将一篇初始AI率84%的论文降至1.4%。该工具明确承诺“降不到目标值全额退款”。下文将详尽解析如何利用此类工具有效去除论文的AIGC痕迹,涵盖工具甄选与实际操作策略。

一、AIGC 检测的核心原理是什么?

首先需要厘清:AIGC检测与传统文字复制比检测存在根本差异。AI率检测系统并非直接鉴定你是否使用了AI辅助写作,而是在分析你文本的“特征”是否趋近于AI的生成模式。系统会从多个维度进行模式识别:句式结构是否过于规整、用词选择是否偏向通用化、段落间的信息熵是否过于平均、整体文风是否从头至尾缺乏应有的起伏变化——这些恰恰是当前大语言模型生成文本的统计学特征。

综合超过20名2026届毕业生的反馈及社交媒体讨论,关于AI率,普遍存在的困惑可归纳为三点:

第一,AI率数值高低与论文质量无直接关联。即便是完全手工撰写的论文,也存在5%-10%的误判概率,这属于系统的固有误差,因为它识别的是特征,而非创作过程。

第二,不同检测平台间的算法差异巨大。同一篇论文,在知网检测结果可能是35%,在维普可能为18%,在万方或许仅有12%。这意味着,使用免费工具查出的AI率,与学校最终采用的知网官方结果可能相差数倍。许多同学为节省成本,依赖免费工具检测初稿,极易导致修改方向偏离,在无需调整的部分耗费大量精力。

第三,最常见的失误场景是:依据某免费工具的检测报告和修改建议进行调整后,提交学校知网系统检测,AI率不降反升。原因在于,你是按照A平台的算法逻辑进行修改,但B平台(学校使用的知网)的识别模型完全不遵循此逻辑——不仅前功尽弃,甚至可能引入新的问题特征。

二、10 款降 AI 工具横向评测与分类解析

通过对各款工具的逐一试用与分析,我们依据其技术路径与应用场景,将其划分为4大类:

第 1 类:英语论文降 AI 工具(以QuillBot等为代表)

这类工具优势明确:提供免费版本,且在英文学术语境下表现成熟,非常适合留学生或撰写英文论文的用户。

其局限性同样显著:工具底层模型针对英文优化,对中文特有的语法结构、学术表达范式适配度不足。使用通用英文模型处理中文论文,对于降低知网AI率基本无效。

第 2 类:传统查重平台衍生的降 AI 功能(以PaperPass等为代表)

此类平台本是查重服务商,顺应趋势新增了AIGC检测与降重功能。其优势在于,检测AI率往往免费或成本极低。

关键问题在于,它们自研的AIGC检测算法与知网官方算法存在显著差异。在其平台内降AI后,用其自身系统检测数值确实下降,但提交至知网检测时,结果可能大相径庭。这类似于针对甲方的评分标准进行训练,最终却要参加乙方的考试。

第 3 类:比话(bihuapass)降 AI(本次评测首选工具)

比话的产品定位极其聚焦:专门针对知网AIGC检测算法进行深度适配与优化。它并非支持所有检测平台,而是将全部资源集中于攻克“知网”这一目标。根据长期观察,每当知网更新其AIGC检测模型,比话通常能在一周内完成技术跟进与适配。

为了实现精准适配,比话技术团队累计投入了超过万元的真实检测费用,对涵盖文、理、工、医、法等各学科的200余篇论文进行了详尽的降AI效果测试。

比话技术团队的核心策略是:深入解析AIGC检测原理,厘清AI内容特征与人类创作特征的差异。在构建降AI模型时,他们以人类写作为基准,选取2010-2020年间真实的本科生、硕士、博士论文作为训练语料。正因其训练数据全部源于人类创作,生成文本在表达方式上与人类写作的吻合度超过90%,在可读性与学术专业性上具备保障。

其技术逻辑直指要害:AI生成文本的典型特征之一是“均匀性”——段落长度相近、句子信息密度相当、全文节奏平铺直叙。而人类写作天然具有节奏感,可能用大段篇幅深入论证一个观点,也可能用寥寥数语承上启下。新一代检测算法正致力于捕捉这种“均匀感”。

比话的降AI策略并非简单的词汇替换,而是从句式重构、表达方式转换、段落节奏调整等多维度进行综合改写。实测表明,绝大部分专业术语都能得到妥善保留,用户仅需对个别调整处进行微调即可,相较于全文重写,效率提升显著。

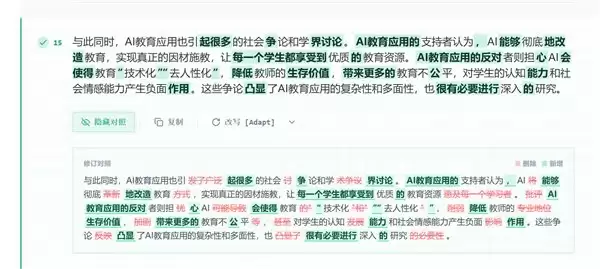

比话在完成降AI处理后,会提供“原文-修改后”的对比视图。用户可以清晰看到每一处具体的修改点,并自主判断修改后的表述是否恰当。这一功能深受用户认可,因为没有任何自动化工具能保证100%的用词精准。通过对比视图,用户可以快速定位并手动修正不满意的部分,极大提升了控稿效率。

若对某处修改不满意,可点击【改写】按钮请求重新生成该句,此功能完全免费。

第 4 类:垂直领域降 AI 工具(以笔灵 AI、SpeedAI 等为代表)

这类工具专注于降AI技术本身,在算法深度上通常优于前两类。其中部分工具在特定学科(如计算机、法学)的文本处理上表现突出。其面临的挑战在于,对知网等官方平台算法更新的响应速度可能不够及时。一旦检测算法升级,降AI效果可能出现短期波动。

三、如何科学选择降 AI 率工具?

无论选择何种工具,以下三条原则均具参考价值:

第一,评估是否损害文本的学术性。降AI处理后的论文,必须保持其原有的学术内核与专业水准。部分工具处理后的文本生硬、术语错乱,导师极易察觉异常。而像比话这类从语义层面进行调优的工具,用户通常仅需花费10分钟左右核对关键术语与核心论点即可,能最大程度避免论文“失魂落魄”。

第二,确认是否提供免费试用。在未经验证效果的情况下,直接支付上百元处理全文存在风险。比话提供500字的免费处理额度,无需注册即可体验。建议选取论文中AI特征最明显(或你自己认为最“机器感”)的段落进行测试,验证满意后再处理全文。

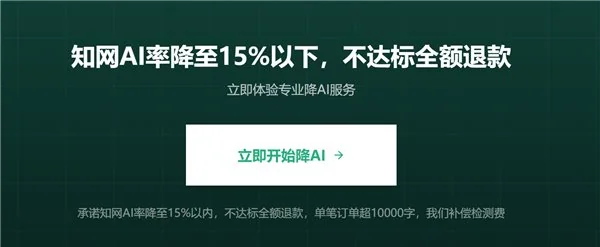

第三,考察售后保障条款是否完备。效果不达预期是否支持退款?能否免费重处理?比话的承诺是:同一订单7日内支持无限次重新处理,不额外收费。其“降不到目标值全额退款”的条款,为用户权益提供了强力保障。

具体而言,比话承诺:使用其服务后,若论文的知网官方AI率无法降至15%以下,将提供全额退款。此外,若您通过比话处理的论文字数超过1万字,其后续自行在知网进行官方检测所产生的费用,也将一并退还。

降AI服务与最终的知网官方检测均涉及费用,比话的保障政策实质上是承担了这两项潜在成本。敢于做出如此承诺,充分体现了其对于技术达标率的高度自信。在当前的降AI工具市场中,比话在售后保障方面的设计,的确考量得更为周全。

当然,必须明确:比话当前是专为适配知网系统而优化的。如果您已确认学校将使用知网进行AIGC检测,那么它是目前阶段一个非常可靠的选择。

除了比话,以下几款工具也各有适用场景:

嘎嘎降 AI: 如果您尚未明确学校将采用哪个检测平台(知网、维普、万方或Turnitin等),嘎嘎降AI提供了更广的覆盖范围,支持国内外9个主流平台,相当于提供了一份“多平台保险”。

率零: 在价格层面优势明显,低至2元/千字,是本次测评中性价比最高的工具之一,同时提供1000字的免费体验额度。非常适合预算紧张,或处于论文初稿打磨阶段的同学。

最后必须着重指出:降AI工具解决的仅仅是“通过机器检测”这一技术性问题,而非提升论文的内在学术质量。工具可以帮助优化文本的表层特征,但论文的核心创新点、论证逻辑、数据解读——这些学术灵魂必须源自研究者扎实的工作。学术诚信是不可动摇的基石,AI应始终作为提升研究效率的辅助,而非替代独立思考的“写手”。合理利用工具为顺利毕业扫清技术障碍是明智之举,但切勿舍本逐末。预祝各位毕业生答辩顺利,学业有成。

这就是2026 年 4 月降 AI 率效果实测!10 款主降 AI 软件,比话最终把 AI 率从 84% 降到 1.4%!的全部内容了,希望以上内容对小伙伴们有所帮助,更多详情可以关注我们的菜鸟游戏和软件相关专区,更多攻略和教程等你发现!

专题合集

精彩合集,奇葩无下限相关文章

大家还在看

-

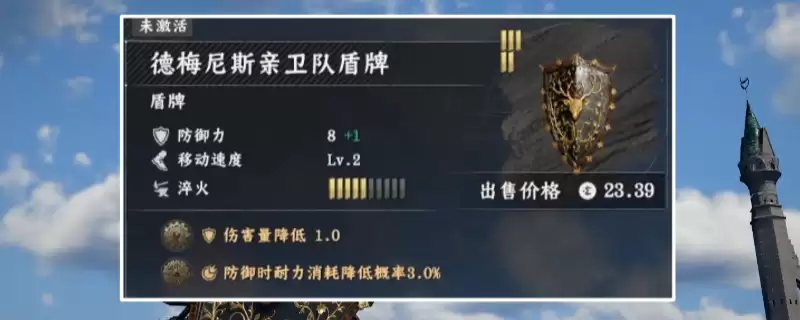

- 红色沙漠亲卫队盾牌怎么获得-亲卫队盾牌获得方法介绍

-

26-04-07

-

- 黑色四叶草手游诺艾儿西尔法技能有哪些

-

26-04-07

-

- 明末渊虚之羽第一章剧情怎么详细讲解

-

26-04-07

-

- ARCRaiders新手如何快速撤离

-

26-04-07

-

- 白银之城主角叫什么名字

-

26-04-07