OpenClaw部署配置windows

时间:26-04-07

在Windows系统上快速部署OpenClaw:一份详尽的配置指南

想要在本地环境体验强大的AI编码助手OpenClaw吗?对于Windows用户而言,整个部署过程其实可以非常顺畅。下面这份手把手的指南,将带你从零开始,完成从环境准备到模型配置的全过程。放心,我们会避开那些常见的“坑”,让你高效地跑起来。

免费影视、动漫、音乐、游戏、小说资源长期稳定更新! 👉 点此立即查看 👈

第一步:安装Node.js

这是整个生态的基石。前往Node.js官网的下载页面(https://nodejs.org/en/download),选择适用于Windows的安装包。下载完成后,运行安装程序并遵循提示完成安装。安装完成后,建议在终端中输入 node -v 和 npm -v 来验证安装是否成功。

第二步:安装Git

虽然OpenClaw的核心安装不强制要求Git,但作为开发者,拥有Git工具链对于后续可能涉及的版本管理和依赖处理都大有裨益。请确保你的系统已经安装了Git。

第三步:安装与配置OpenClaw

关键步骤来了。请务必以管理员身份打开Windows PowerShell。这是为了确保后续的全局安装和系统级操作拥有足够的权限。在打开的PowerShell窗口中,执行以下命令:

npm install -g openclaw@latest这条命令会从npm仓库拉取最新版本的OpenClaw并进行全局安装。耐心等待安装完成即可。

第四步:初始化配置OpenClaw

安装完成后,我们需要进行初始化配置。继续在管理员PowerShell中运行:

openclaw onboard这个命令会启动一个交互式的配置向导。

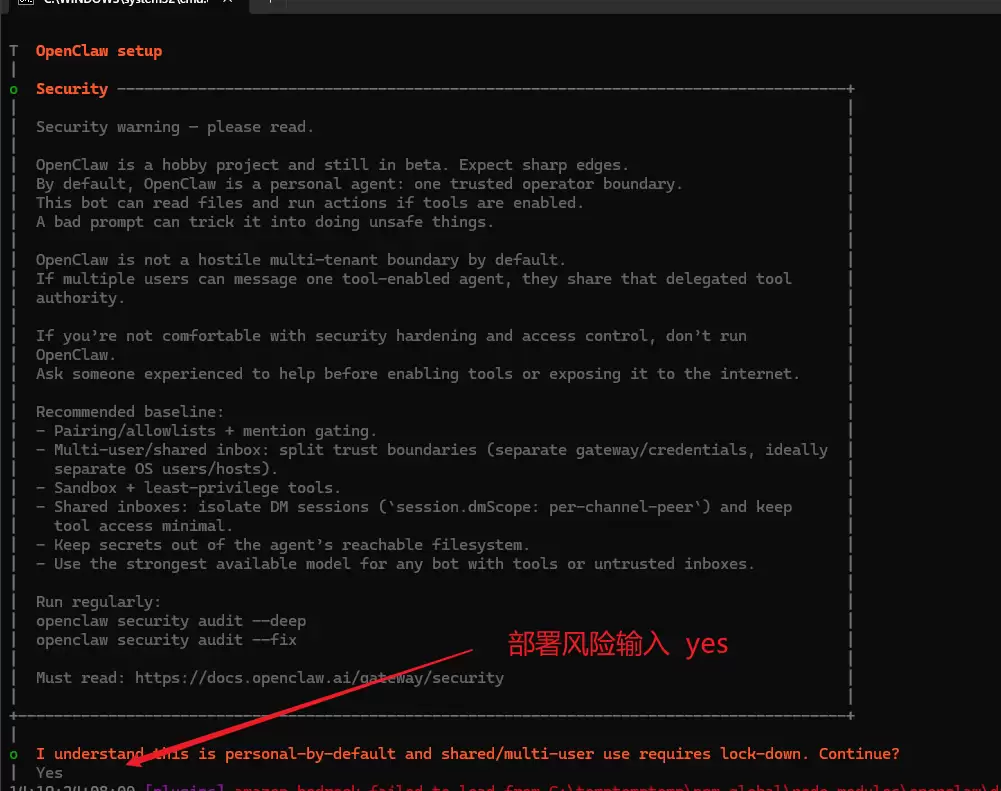

4-1:部署风险提示

系统首先会给出一个部署风险提示。这里直接选择 YES 并回车确认即可。

4-2:配置模式

接下来选择配置模式。为了快速上手,我们选择 QuickStart 模式,然后回车。

4-3:选择模型供应商

向导会列出可选的模型供应商,例如“火山引擎”。使用方向键选择你准备使用的供应商(本例中选择“火山引擎”),然后回车确认。

4-4:后续配置

对于后续关于对话工具(对话工具 (skip for now))和技能(Skills (no))的配置选项,如果你是初次体验,可以暂时选择跳过或选择“否”,以简化初始配置。

第五步:启动网关与控制台访问

完成初始化配置后,有一个至关重要的步骤:必须启动OpenClaw网关服务,否则网页控制台将无法连接。请打开一个新的PowerShell窗口(无需管理员权限),输入以下命令:

5-1:在主机上启动网关

openclaw gateway run执行后,该窗口会持续运行并显示网关日志,请保持此窗口开启。

5-2:获取带令牌的仪表盘URL

此时,再打开一个新的PowerShell终端,运行:

openclaw dashboard运行此命令后,它通常会直接在你的默认浏览器中打开一个带有认证令牌的OpenClaw仪表盘(控制台)页面。如果没有自动打开,命令行也会输出一个URL链接,手动复制到浏览器打开即可。

第六步:在用户目录下配置模型信息

为了让OpenClaw使用我们指定的AI模型,需要编辑其配置文件。该文件通常位于用户目录下(例如 C:\Users\[你的用户名]\.openclaw\),名为 openclaw.json。

你需要用文本编辑器打开此文件,并根据你的本地或远程模型服务信息进行配置。以下是一个配置示例,其中包含了模型端点、API密钥(示例中已用‘111’、‘11’替代)和工作空间路径等关键信息:

{

"agents": {

"defaults": {

"model": {

"primary": "qwen35122b/qwen3.5:122b "

},

"models": {

"ollama/qwen3-coder:30b": {}

},

"workspace": "C:\\Users\\dell\\.openclaw\\workspace"

}

},

"gateway": {

"mode": "local",

"auth": {

"mode": "token",

"token": "ddda7c106535bd009537b753b2507e9b2375b75619035846"

},

"port": 18789,

"bind": "loopback",

"tailscale": {

"mode": "off",

"resetOnExit": false

},

"controlUi": {

"allowInsecureAuth": true

},

"nodes": {

"denyCommands": ["camera.snap", "camera.clip", "screen.record", "contacts.add", "calendar.add", "reminders.add", "sms.send", "sms.search"]

}

},

"session": {

"dmScope": "per-channel-peer"

},

"tools": {

"profile": "coding"

},

"models": {

"mode": "merge",

"providers": {

"gpt-oss120b": {

"api": "openai-completions",

"apiKey": "111",

"baseUrl": "http://192.168.11.24:11434/v1",

"models": [{

"id": "gpt-oss:120b",

"input": ["text"],

"name": "gpt-oss:120b"

}]

},

"qwen35122b": {

"api": "openai-completions",

"apiKey": "11",

"baseUrl": "http://192.168.11.240:11434/v1",

"models": [{

"id": "qwen3.5:122b",

"input": ["text"],

"name": "qwen3.5:122b"

}]

}

}

},

"auth": {

"profiles": {

"ollama:default": {

"provider": "ollama",

"mode": "api_key"

}

}

},

"hooks": {

"internal": {

"enabled": true,

"entries": {

"session-memory": {

"enabled": true

}

}

}

},

"wizard": {

"lastRunAt": "2026-04-02T06:21:53.021Z",

"lastRunVersion": "2026.4.1",

"lastRunCommand": "onboard",

"lastRunMode": "local"

},

"meta": {

"lastTouchedVersion": "2026.4.1",

"lastTouchedAt": "2026-04-02T06:21:53.033Z"

}

}请注意:你需要将示例中的 apiKey、baseUrl、workspace 路径以及模型ID等信息,替换为你自己的实际配置。

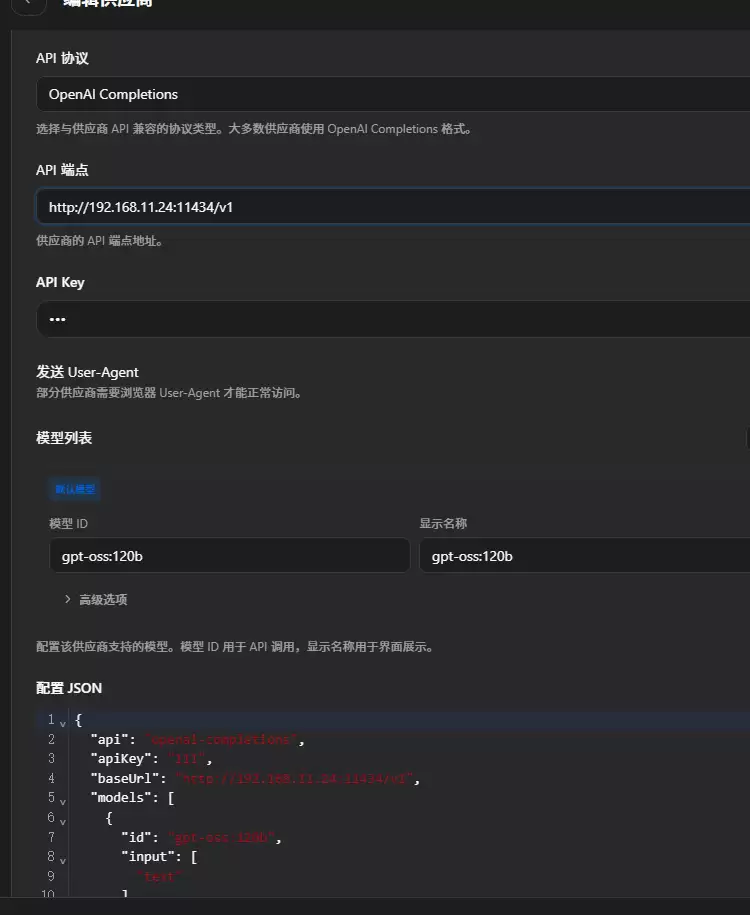

6-1:使用cc-switch配置模型

除了手动编辑JSON文件,OpenClaw通常也提供了更友好的图形化方式来切换和配置模型。你可以在启动的Web控制台中找到相关界面进行操作,如下图所示:

至此,所有核心配置步骤已完成。现在,你可以回到浏览器中打开的OpenClaw控制台,开始体验AI辅助编程的乐趣了。如果在配置过程中遇到问题,首要检查网关服务是否正常运行,其次是核对配置文件中的模型端点地址和密钥是否正确无误。

这就是OpenClaw部署配置windows的全部内容了,希望以上内容对小伙伴们有所帮助,更多详情可以关注我们的菜鸟游戏和软件相关专区,更多攻略和教程等你发现!

专题合集

精彩合集,奇葩无下限相关文章

大家还在看

-

- 洛克王国世界多多是什么-洛克王国世界多多介绍

-

26-04-07

-

- 洛克王国如何获取世界魔法石-洛克王国世界魔法石获取途径

-

26-04-07

-

- 王者荣耀世界怎么潜水-王者荣耀世界潜水玩法全解析

-

26-04-07

-

- 洛克王国世界飞刀小木怎么捕捉-洛克王国世界飞刀小木捕捉方法

-

26-04-07

-

- 洛克王国世界暖火雪境宝箱怎么探索-洛克王国世界暖火雪境宝箱探索方法

-

26-04-07