日本团队训练大鼠神经元,可实时执行 AI 计算任务

时间:26-04-07

日本科学家训练大鼠神经元,成功实现自主AI计算

最近,科技媒体Tom‘s Hardware报道了一项引人注目的研究。来自日本东北大学与未来大学的团队,成功训练了大鼠的皮层神经元,让这些活体细胞在一种名为“闭环储备池计算”的实时机器学习框架下,自主生成了复杂的时序信号。这听起来是不是有点科幻?但它的确正在发生。

免费影视、动漫、音乐、游戏、小说资源长期稳定更新! 👉 点此立即查看 👈

活体神经元与机器的融合

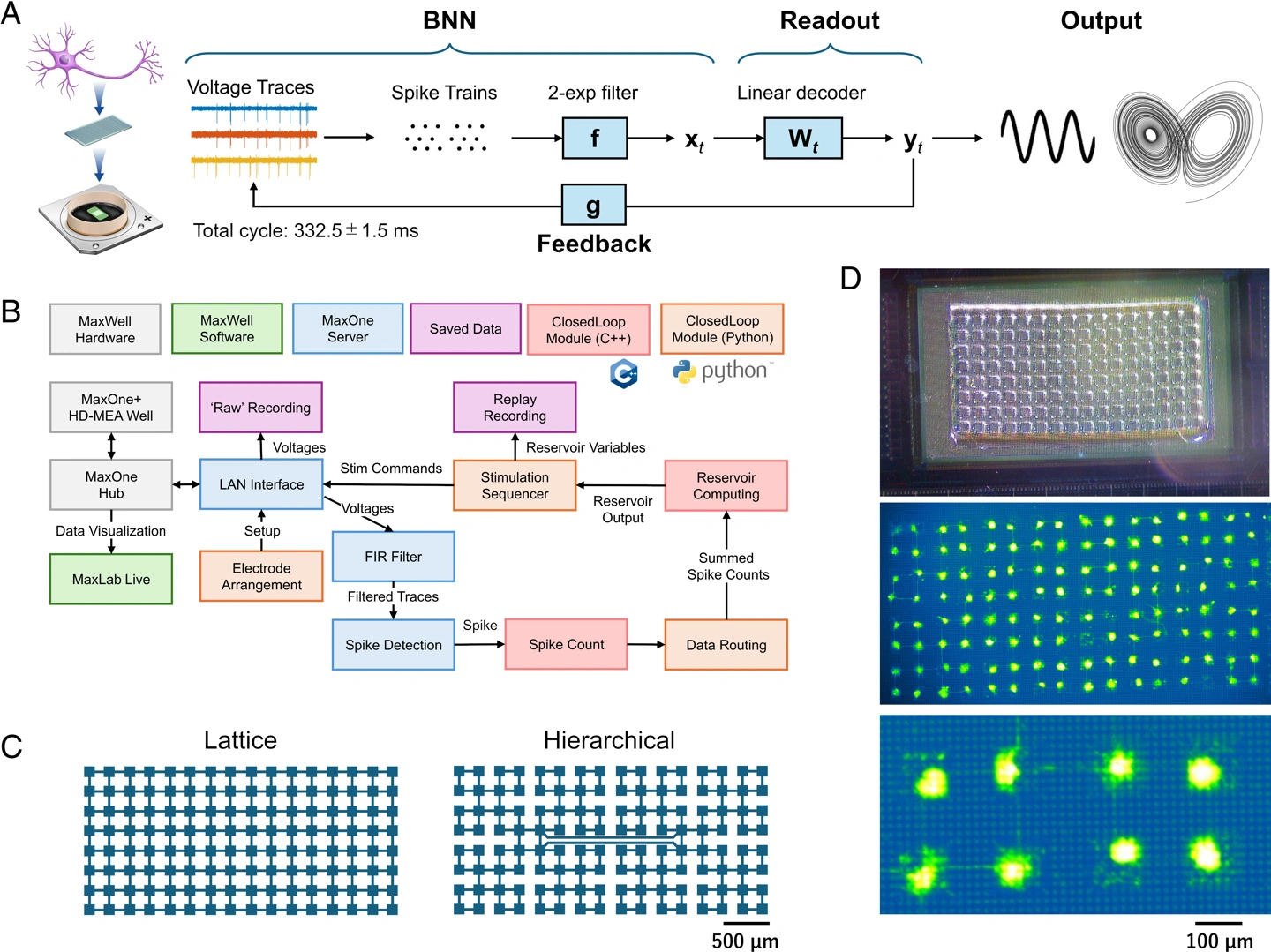

这项技术的核心,在于将活体神经元与高密度微电极阵列、微流控设备精巧地集成在一起。由此构建的系统,其神奇之处在于,它无需依赖外部持续输入指令,就能自主学习和生成周期性乃至混沌的波形,独立执行AI计算任务。这为“生物计算”打开了一扇全新的大门。

约束,是为了更好的“思考”

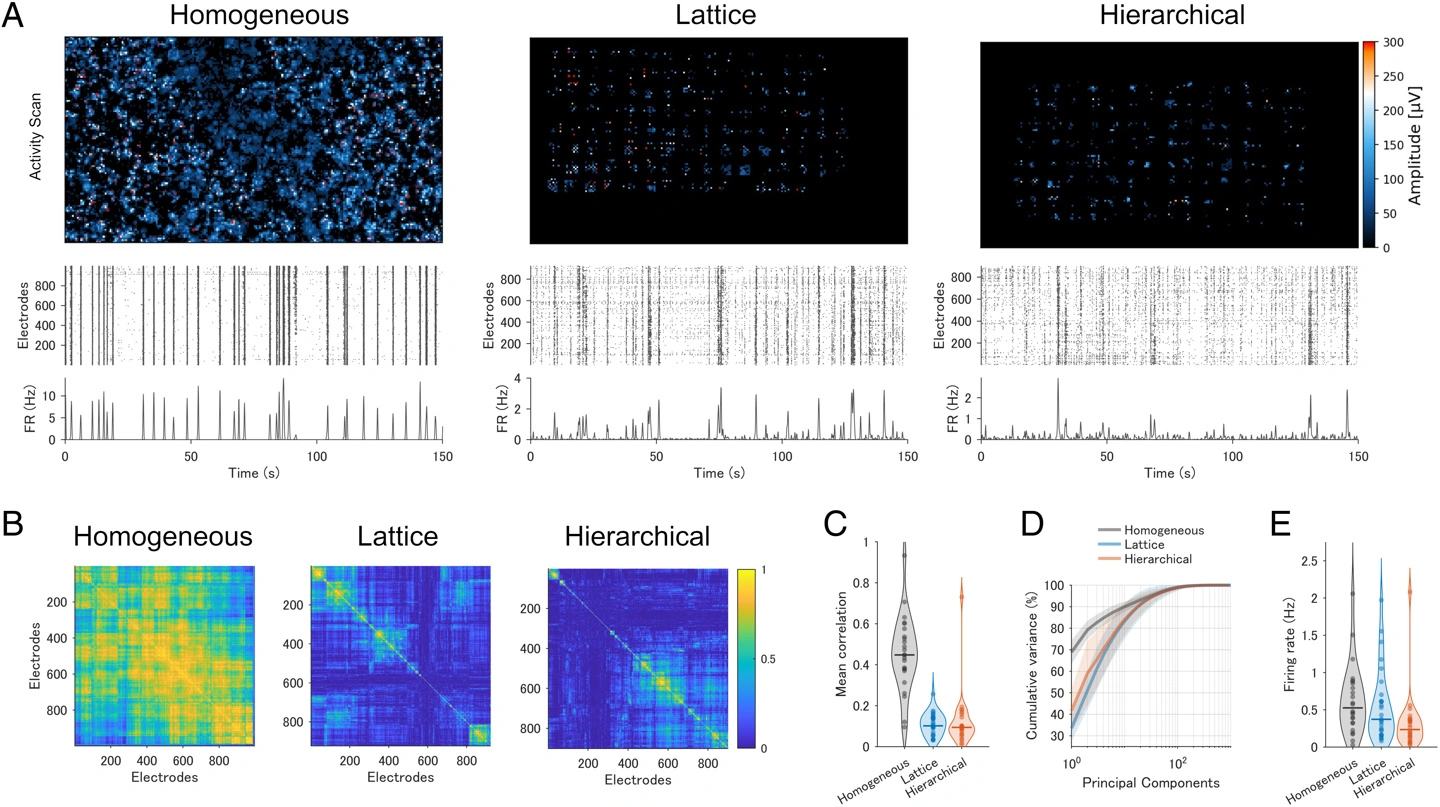

那么,如何让一群神经元“听话”地完成计算呢?关键在于对它们连接方式的物理约束。研究团队发现,如果放任培养的神经元自由生长,它们会形成一个高度同步化的网络——就像所有人都在齐声呐喊,反而无法处理复杂信息,学习目标信号也就无从谈起。

为此,他们利用PDMS(聚二甲基硅氧烷)微流控薄膜,将神经元胞体精准地限制在128个微型微孔中,再通过设计好的微通道进行连接。他们尝试构建了两种网络结构:格型和分层型。这种设计绝非限制自由,恰恰相反,它极大地提升了网络动力学的维度。效果立竿见影,神经元之间的两两相关性从0.45大幅降至0.12,这意味着网络具备了更丰富、更独立的动态响应能力。

卓越的表现与未来的瓶颈

测试结果令人振奋。其中,格型网络在所有目标波形生成任务中都表现优异。这个由活体神经元构成的系统,能够稳定生成周期为4秒、10秒和30秒的正弦波、三角波和方波。更令人惊叹的是,它甚至能逼近三维混沌轨迹中的经典模型——洛伦兹吸引子。在学习阶段,其预测信号与目标信号的相关性超过了0.8,展现出强大的学习能力。

正如东北大学的山本英明教授所言,这项研究证明,活体神经元网络不仅仅是一个生物学系统,它完全可以作为一种新型的计算资源来开发和利用。

当然,这项前沿技术目前仍面临性能瓶颈。一个明显的挑战是,当训练停止、系统进入完全自主运行模式时,输出误差会逐渐增加。此外,反馈环路中约330毫秒的延迟,也限制了系统追踪快速变化波形(例如语音信号)的能力。这些都是通往实用化道路上必须翻越的山峰。

结语:通往脑机接口的新路径

面对这些挑战,研究团队的目光已经投向未来。他们计划通过开发专用硬件来降低系统延迟,并进一步扩展该技术在脑机接口和神经假体设备中的应用潜力。这条路虽然漫长,但每一步都扎实而充满想象力。

附上参考地址:Online supervised learning of temporal patterns in biological neural networks under feedback control

这就是日本团队训练大鼠神经元,可实时执行 AI 计算任务的全部内容了,希望以上内容对小伙伴们有所帮助,更多详情可以关注我们的菜鸟游戏和软件相关专区,更多攻略和教程等你发现!

专题合集

精彩合集,奇葩无下限相关文章

大家还在看

-

- 心之钥结局怎么解锁

-

26-04-09

-

- 中医正骨疗法包括什么

-

26-04-09

-

- 噬血代码2思念交汇之地成就奖杯如何做

-

26-04-09

-

- 灵兽大冒险蛮岳通关方法

-

26-04-09

-

- 盛世龙城新手如何玩

-

26-04-09