高德首款机器狗亮相亦庄机器人马拉松 ABot-Claw重新定义具身机器人的世界记忆

时间:26-04-19

高德途途亮相:全球首款开放环境全自主具身机器人完成马拉松导盲挑战

在2026年北京亦庄机器人半程马拉松的赛道上,阿里巴巴旗下高德完成了一次里程碑式的技术验证。其全球首款开放环境全自主具身机器人——“高德途途”,在真实、动态的马拉松环境中,成功协助视障跑者完成了全程导航、复杂避障与人群穿行等高难度任务。

免费影视、动漫、音乐、游戏、小说资源长期稳定更新! 👉 点此立即查看 👈

途途在导盲场景下的稳健表现,根植于其背后的核心技术体系:高德全新发布的ABot全栈具身技术体系。该体系基于海量真实场景与千万级多模态Clip数据,将高德沉淀多年的空间智能资产,高效转化为驱动机器人进化的核心训练数据。这标志着首个面向AGI(通用人工智能)目标构建的全栈具身技术体系已进入实际应用阶段。

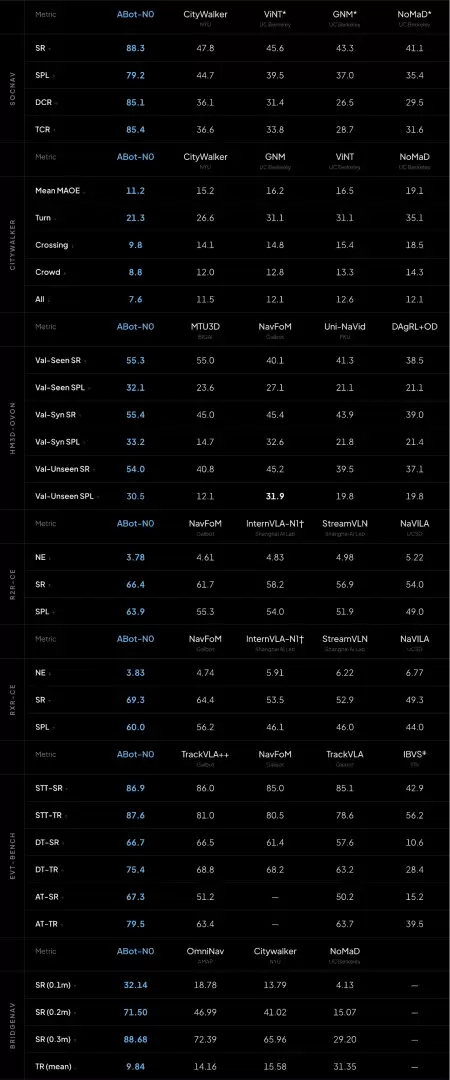

区别于行业内常见的碎片化技术拼凑路径,ABot体系在架构层面实现了根本性突破。它以AGI为核心目标,首次将数据引擎、基座模型与执行中枢深度耦合为一个统一系统。其系统性优势已获验证:高德ABot系列模型已在全球15项权威基准测试中取得SOTA(领先水平)成绩。

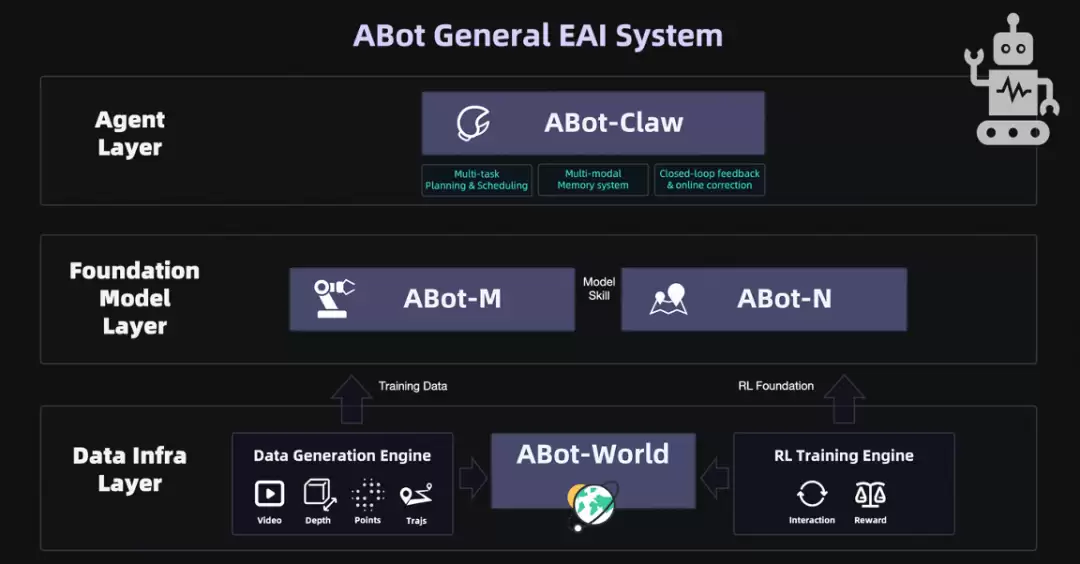

ABot体系:三层飞轮式设计,构建持续进化的具身智能闭环

ABot体系的核心设计哲学是“闭环飞轮”。其数据、模型、应用三层深度咬合,形成“数据驱动模型、模型服务应用、应用反哺数据”的自我进化循环。这套机制精准应对了行业普遍面临的数据稀缺、仿真鸿沟与技能泛化三大瓶颈,构建了一个能够持续迭代的完整技术闭环。

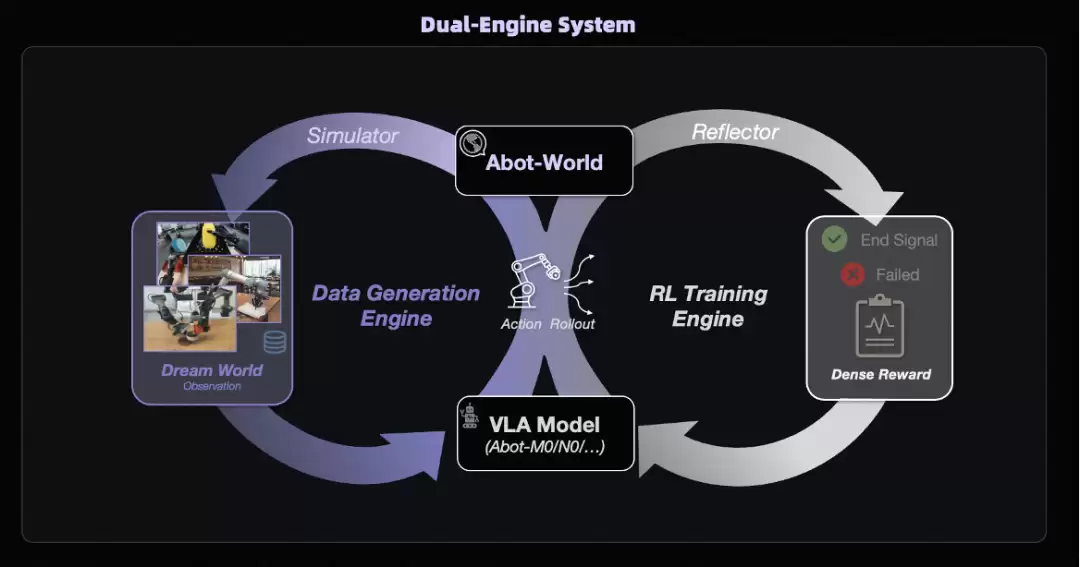

数据是决定具身智能泛化能力上限的关键。传统真机采集方式成本高昂,难以规模化。ABot-World作为数据层核心解决方案,通过批量合成视频、深度、点云、轨迹四类关键训练数据,并配合强化学习引擎在虚拟环境中进行训练。这套高保真仿真方案,有效弥合了“仿真到现实”的鸿沟,将数据成本降低了数个数量级。

模型层聚焦解决具身操作的通用性与导航的长程性两大难题。ABot-M专精于精细操作(“手”),ABot-N则负责长程导航(“腿”)。两者通过创新的“模型技能”机制进行组合调用,协同完成复杂任务。

应用层的核心是具身版“调度中枢”——ABot-Claw。它将异构机器人统一于共享的认知框架下,打造出具备智能调度、持久记忆与分层控制能力的“执行大脑”,有效解决了长程任务闭环难、知识无法跨机器人共享等行业痛点。

ABot体系的设计逻辑,沿袭了高德已被验证的“空间智能飞轮”模式:依托近10亿月活场景产生的海量时空数据与实时反馈,算法在闭环中持续迭代,推动模型对物理世界的认知不断加深。这一体系化优势不依赖于单点技术突破,而是依靠整个飞轮在真实场景中的持续运转来构建技术护城河。

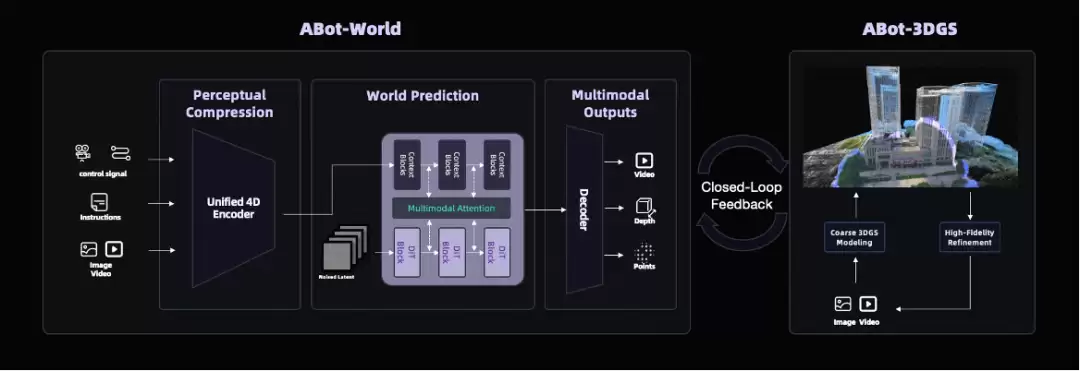

ABot-World:在物理合规性、动作可控性、零样本泛化三大维度均达SOTA

当主流世界模型仍受困于“视觉幻觉”与动力学脱节时,ABot-World取得了关键突破。它成为全球首个将物理定律深度嵌入生成全流程的可微分、可进化动力学引擎。作为ABot体系的底层仿真基座,其性能直接决定了上层模型对物理世界的一致性理解和泛化能力上限。

在架构上,ABot-World专为具身智能设计了14B参数的DiT架构。它以机器人的观测与动作为输入,直接在潜空间生成符合时空动力学规律的未来状态序列。基于千万级真实数据与多层级采样治理,它成功突破了单一任务模型的泛化制约。

在场景构建上,其3DGS冷启动空间基座能处理手机拍摄、航测图等稀疏输入,通过自动化流程将低质量视频转化为高质量3D场景,大幅降低了高质量数据获取的门槛。

训练方面,模型首创了Diffusion-DPO物理偏好对齐框架。该框架由视觉语言模型生成物理规则清单并进行独立判别,构建优劣样本对,驱动模型主动抑制违反物理规律的行为。同时,拉格朗日动力学与3DGS重建技术的融合,使得系统生成的每一帧画面都包含了质量、摩擦、接触力等丰富物理属性的可微分“快照”。

此外,ABot-World构建了“训练+数据”双引擎并行的架构,实现了模型的自进化。依托高德自有地图与脱敏数据,结合3DGS技术,系统已累计生产了上万级3D真实场景、百万级推理数据与千万级训练轨迹,覆盖了99%的典型生活场景。通过接入视觉语言-动作闭环,模型实现了“预测即训练,演练即学习”的持续进化能力。

在PBench、EZSbench、WorldArena、Agibot World Challenge等主流评测中,ABot-World持续保持领先,并成为唯一在物理合规性、动作可控性、零样本泛化三大关键维度均达到SOTA水平的模型。

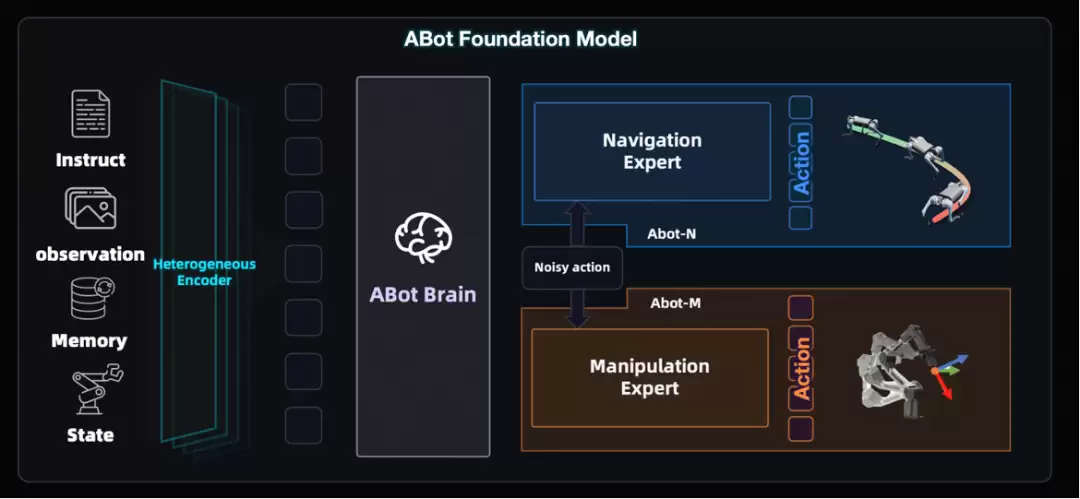

ABot-N & ABot-M:ABot体系的“运动双核”,跨本体导航与操作基座斩获11项SOTA

若将ABot全栈体系视为具身智能的“运行大脑”,那么ABot-N与ABot-M便是其“运动双核”。它们分别掌管机器人的“双腿”与“双手”,直接响应物理世界中“去哪里”与“做什么”的基础指令。依托统一架构设计,高德打造出了既可解耦又能协同的专用基座模型。

作为全球首个实现五大核心导航任务“大一统”的视觉语言-动作基座模型,ABot-N具备了深度的意图理解、自主决策与持续进化能力。它采用层级式的“大脑-动作”架构,通过多模块协同,实现了单一模型对多种导航任务的全覆盖。

ABot-N推出后,迅速在VLN-CE(R2R/RxR)、HM3D-OVON、EVT-Bench等7大权威基准上全面刷新SOTA,并在导航精度、社会合规性、零样本泛化能力上实现了断层式领先。

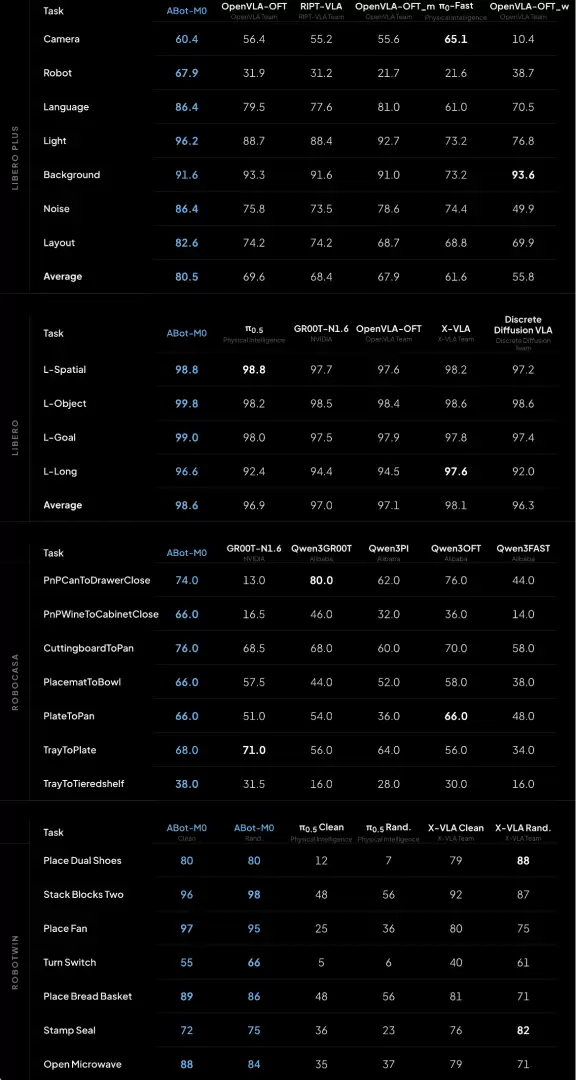

ABot-M则是全球首个采用统一架构的具身操作基座模型。其核心价值在于,能用同一个“通用大脑”适配多种形态的机器人,大幅提升操作模型在异构机器人形态和多样化任务场景下的泛化能力。

技术上,ABot-M提出了全球首个动作流形学习方法,将学习目标由传统的去噪重构转变为流形投影,显著提升了动作生成的稳定性与解码效率。在感知端,它采用语义流和动作流双流并行的架构,有效提升了精细操作的执行精度。

在LIBERO、LIBERO-Plus、RoboCasa GRRoboTwin 2.0等主流评测中,ABot-M全面超越了π0.5、UniVLA、OpenVLA-OFT等基线模型,在泛化能力、鲁棒性与跨形态迁移三个维度实现了系统性领先。

ABot-N与ABot-M的相关多项子成果,已入选ICLR、CVPR等顶级学术会议,成为机器人导航与操作领域在精确性、高效性与安全性方面的范式参考。

ABot-Claw:首创“Map as Memory”的通用集中式Harness架构

记忆是机器人跨越认知与执行鸿沟的基石。传统机器视觉受限于“视野之外即荒原”,记忆碎片化严重制约了泛化能力。

为突破这一瓶颈,ABot-Claw首创了“Map as Memory”(地图即记忆)理念,重构了具身智能的记忆机制。作为ABot体系的“执行中枢”,ABot-Claw采用集中式Harness架构,将高德地图与用户私有地图设为全局认知锚点,把多模态感知数据统一映射至一个共享的语义空间,形成可动态刷新、持久沉淀的“世界记忆”。新的机器人终端接入后,仅需读取这份全局上下文,即可零成本继承所有环境认知。

此外,ABot-Claw采用“云端大脑—边缘响应”的两级设计,兼顾了智能深度与执行实时性。在调度层面,该架构支持多种异构机器人的并行协作与任务接力,当某个机器人发生故障时,任务可自动由其他机器人接续,实现了任务上下文的无缝移交。这标志着机器人系统正从“单体智能”向“体系智能”演进。

ABot-Claw还首创了闭环反馈与纠错机制,在模糊指令理解、跨机导引等复杂场景中,充分验证了其系统的鲁棒性与泛化性。

伴随高德途途的全球首秀,高德同步宣布将开源ABot全体系。此举不仅是对其“AMAP AI Inside”核心理念的深度践行,更可能重塑整个具身智能领域的研发范式,为AGI时代的全面到来按下加速键。

这就是高德首款机器狗亮相亦庄机器人马拉松 ABot-Claw重新定义具身机器人的世界记忆的全部内容了,希望以上内容对小伙伴们有所帮助,更多详情可以关注我们的菜鸟游戏和软件相关专区,更多攻略和教程等你发现!

专题合集

精彩合集,奇葩无下限相关文章

大家还在看

-

- 和平精英矿场地下室位置在哪

-

26-04-28

-

- 金铲铲之战装备大全介绍

-

26-04-28

-

- 弹弹星球宠物有什么作用

-

26-04-28

-

- 乔乔的奇妙冒险黄金赞歌替身系统如何

-

26-04-28

-

- 《无限暖暖》火锅坊食客喜好攻略

-

26-04-28