DEEPSEEK 本地部署常见问题与解决方案

时间:26-04-21

部署前的环境准备与检查

在尝试将DEEPSEEK这类大型语言模型部署到本地环境之前,充分的准备工作是成功的关键。首先,需要仔细核对官方文档中列出的最低硬件要求,这通常包括对CPU架构、内存容量以及最重要的显卡规格的详细说明。对于希望获得较好推理速度的用户,一块性能足够的NVIDIA显卡并安装对应版本的CUDA驱动是基础。同时,操作系统的版本、Python环境以及诸如PyTorch或TensorFlow等深度学习框架的兼容性也必须逐一确认。建议创建一个独立的虚拟环境,例如使用conda或venv,以避免与系统现有Python包发生版本冲突。提前下载好模型权重文件也是节省时间的好办法,因为这类文件体积通常非常庞大,网络不稳定可能导致下载中断。

免费影视、动漫、音乐、游戏、小说资源长期稳定更新! 👉 点此立即查看 👈

安装过程中的典型错误与排查

安装过程很少一帆风顺,遇到问题是常态。一个常见的问题是依赖包安装失败,这可能是由于网络超时、特定版本的库与当前Python环境不兼容,或是缺少某些系统级的开发工具(如Linux下的build-essential,Windows下的Visual C++ Build Tools)所致。通过使用国内镜像源加速Python包的下载,或者根据错误提示手动安装缺失的系统组件,往往能解决此类问题。另一个高频错误出现在加载模型阶段,提示显存不足。这时需要检查是否误下载了参数量超出本地显存容量的模型版本,或者考虑使用量化技术来降低模型对显存的占用。此外,文件路径中包含中文或特殊字符、磁盘空间不足导致模型文件损坏,也都是值得排查的方向。仔细阅读命令行或日志中输出的错误信息,通常是找到解决方案最快的方法。

模型运行与推理优化技巧

成功安装后,如何让模型高效、稳定地运行是下一个课题。对于资源有限的本地环境,推理优化至关重要。可以尝试启用模型的量化版本,如INT8或FP16量化,这能在几乎不损失精度的情况下显著降低内存消耗和提升推理速度。调整推理时的批处理大小也是一个有效的权衡手段,较小的批处理大小对显存更友好,但可能会牺牲一些吞吐效率。如果使用的是消费级显卡,需要注意散热和功耗墙限制,长时间高负荷运行可能导致GPU降频,影响性能稳定性。此外,探索使用诸如vLLM、TGI等专为大型语言模型设计的高效推理服务框架,可以进一步优化资源利用率和响应速度。对于纯CPU环境,则可以考虑使用OpenVINO、ONNX Runtime等针对CPU优化的后端来加速推理。

长期使用与维护建议

将模型部署成功并不仅仅是终点,确保其能够长期稳定地提供服务同样重要。定期检查项目官方仓库的更新通知是必要的,开发者可能会发布重要的安全补丁、性能改进或新的模型版本。在升级任何核心依赖库(如PyTorch)时,务必在测试环境中先行验证,因为大版本升级可能引入不兼容的变更。建立模型的定期健康检查机制,例如运行一组标准的测试提示词,确保其输出质量和响应时间符合预期。同时,做好模型文件、配置文件以及个人微调数据的备份工作。如果部署环境是服务器,还需要考虑设置进程守护,确保在意外退出后能自动重启服务。最后,关注社区讨论和开源项目动态,许多常见的疑难杂症和优秀的实践方案往往在社区交流中首先得到分享和解决。

这就是DEEPSEEK 本地部署常见问题与解决方案的全部内容了,希望以上内容对小伙伴们有所帮助,更多详情可以关注我们的菜鸟游戏和软件相关专区,更多攻略和教程等你发现!

- 盗墓长生印荆轲破解版

- 大小:97.20MB

专题合集

精彩合集,奇葩无下限相关文章

大家还在看

-

- 《脑洞大侦探》第七关解救人质怎么过-第7关解救人质三星通关图文攻略

-

26-04-27

-

- 研途考研app账号注销步骤

-

26-04-27

-

- 王者荣耀世界评价如何王者荣耀世界值不值得体验

-

26-04-27

-

- 辉光之城1907好玩吗辉光之城1907核心玩法与新手入门指南

-

26-04-27

-

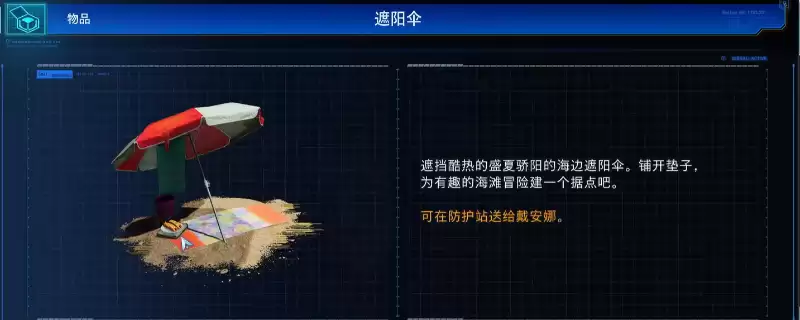

- 《识质存在》地忆芯片遮阳伞获得方法介绍

-

26-04-27