AI 辅助维护者仅用 5 天重写热门 Python 库:性能飙升 48 倍,却卷入开源协议篡改风波

时间:26-04-22

AI 辅助维护者仅用 5 天重写热门 Python 库:性能飙升 48 倍,却卷入开源协议篡改风波

上周,Python 生态里一个看似常规的版本更新,却意外引爆了一场关于开源伦理与技术变革的激烈论战。主角是字符编码检测库 chardet,其 7.0 版本的发布,将 AI 重写代码与开源协议之间的模糊地带彻底推向了台前。

免费影视、动漫、音乐、游戏、小说资源长期稳定更新! 👉 点此立即查看 👈

事件的起因很直接。项目维护者 Dan Blanchard 为了让 chardet 有朝一日能被纳入 Python 标准库,用了一个“高效”得惊人的方法:他借助 AI 编程工具 Claude Code,在短短 5 天之内,几乎从零开始重写了整个项目。结果令人瞩目——新版本的性能最高提升了 48 倍。

但争议的焦点并非性能。关键在于,Blanchard 借着这次彻底重写的契机,将项目原本采用的 LGPL 协议,更改为了更为宽松的 MIT 协议。这意味着,新版代码可以被自由地用于闭源商业项目,而无需像 LGPL 那样要求衍生作品以相同方式开源。

这一举动立刻触动了原作者的神经。2006 年创建该项目的 Mark Pilgrim 在 GitHub 上公开表达不满,直指新版构成了“非法重新授权”。他的逻辑很清晰:维护者长期接触原始代码,现在引入 AI 工具进行重写,并不能自动获得改变协议的权利。这完全不符合“净室逆向工程”的标准——即开发者在完全未接触原码的前提下,仅凭功能描述进行独立创造。Pilgrim 坚称,新版本依然是原代码的衍生作品,并要求恢复 LGPL 协议。

(注:Clean Room Design 是一种规避版权侵权的开发策略,指开发人员在完全没有接触过原版受版权保护代码的情况下,仅根据功能需求说明书重新编写代码,确保新代码不是原代码的“衍生作品”。)

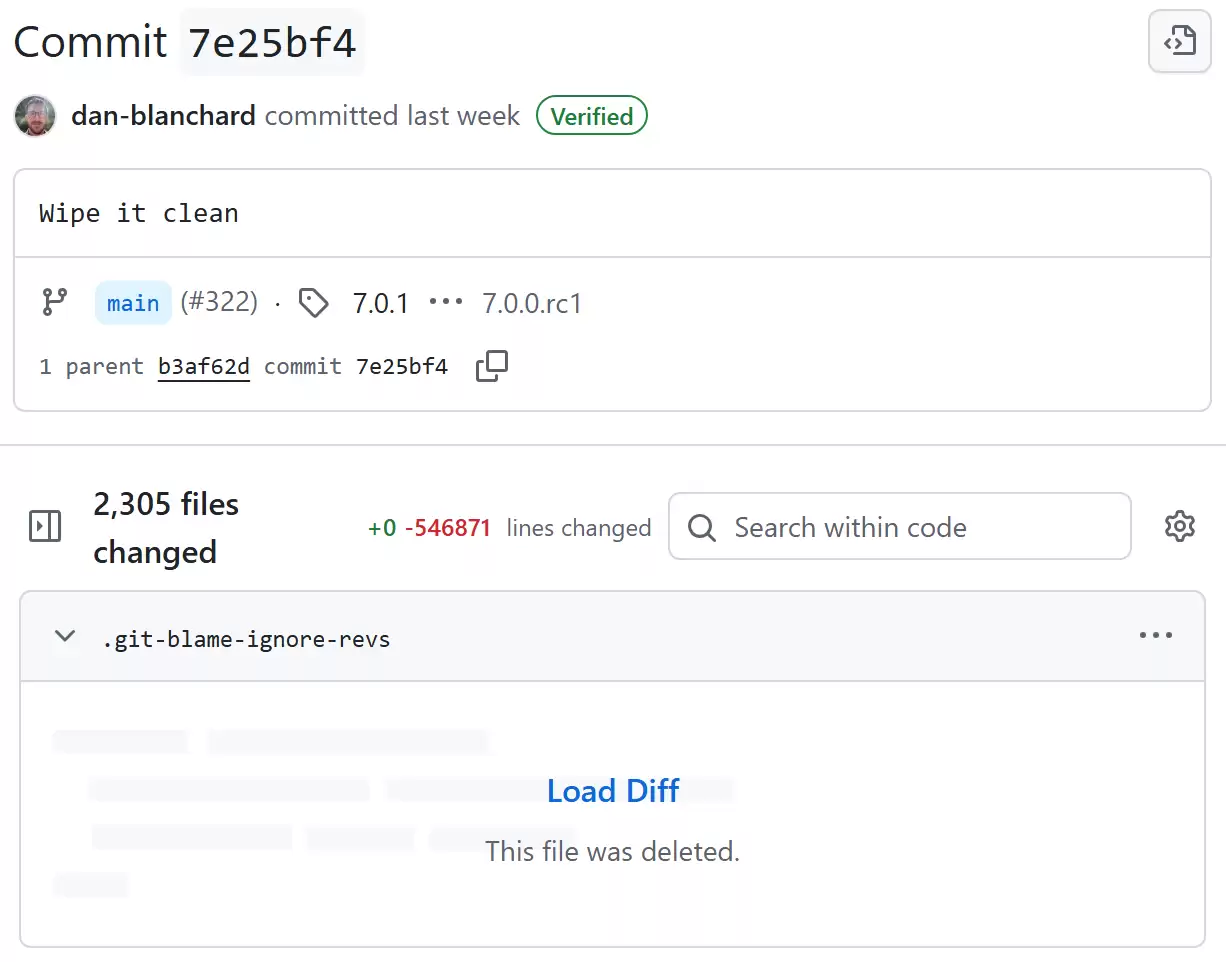

面对指控,Blanchard 选择用数据说话,为这次“AI 净室重写”辩护。他并不否认自己对旧代码很熟悉,但他强调,AI 生成的新代码在结构上已经彻底独立。他引用了一项关键证据:代码相似度分析工具 JPlag 的数据显示,7.0 版本与旧版 6.0 的对应文件,结构相似度最高仅为 1.29%。作为对比,旧版本之间的相似度曾高达 80%。Blanchard 解释道,他的方法是先编写设计文档,然后向 Claude 下达需求,最终在一个清空的全新仓库中生成这些代码。

然而,这种充满未来感的“AI 净室”模式,在现实的法律和伦理框架下正面临严峻拷问。首先,一个无法回避的问题是:Claude 这类大模型的训练数据,极大概率已经包含了 chardet 早期开源的代码。那么,即便新代码结构迥异,AI 的这种“先验知识”是否会让最终产出物在法律上依然被视为衍生品?目前,这完全是一个法律盲区。

其次,在整个重写过程中,Blanchard 本人深度参与了 AI 生成代码的审查、测试与迭代。这种人类开发者的重度干预和引导,同样可能影响到新项目“独立性”的法律判定。说到底,法院迄今为止,尚未对 AI 深度参与编写的软件授权问题作出任何明确裁决。

这场风波的影响早已超出单一项目,正在整个开源社区引发深度反思。自由软件基金会执行董事 Zoë Kooyman 的观点一针见血:一个已经“吸收”了原始代码的 AI 大模型,根本谈不上是“干净”的创作环境。

而开源布道师 Bruce Perens 的警告则更具历史视野。他指出,整个软件开发的底层经济学逻辑正在被 AI 彻底碘伏,其冲击力之巨,堪比印刷术的发明。这不仅仅是一场关于协议条款的争吵,更是一次对开源世界未来根基的集体审视。

这就是AI 辅助维护者仅用 5 天重写热门 Python 库:性能飙升 48 倍,却卷入开源协议篡改风波的全部内容了,希望以上内容对小伙伴们有所帮助,更多详情可以关注我们的菜鸟游戏和软件相关专区,更多攻略和教程等你发现!

专题合集

精彩合集,奇葩无下限相关文章

大家还在看

-

- 《怒火一刀》7天零氪速升攻略

-

26-04-27

-

- 有哪些平台可以买卖游戏账号

-

26-04-27

-

- 牧场物语第一年春季怎么在风之繁华集市赚钱

-

26-04-27

-

- 红色沙漠残响峭壁古代遗迹怎么解谜 红色沙漠残响峭壁古代遗迹解谜方法

-

26-04-27

-

- 屠龙争霸新手如何玩

-

26-04-27