谷歌首个原生多模态嵌入模型 Gemini Embedding 2 发布:能让机器“理解”信息

时间:26-04-22

谷歌发布首个原生多模态嵌入模型 Gemini Embedding 2:让机器真正“理解”多元信息

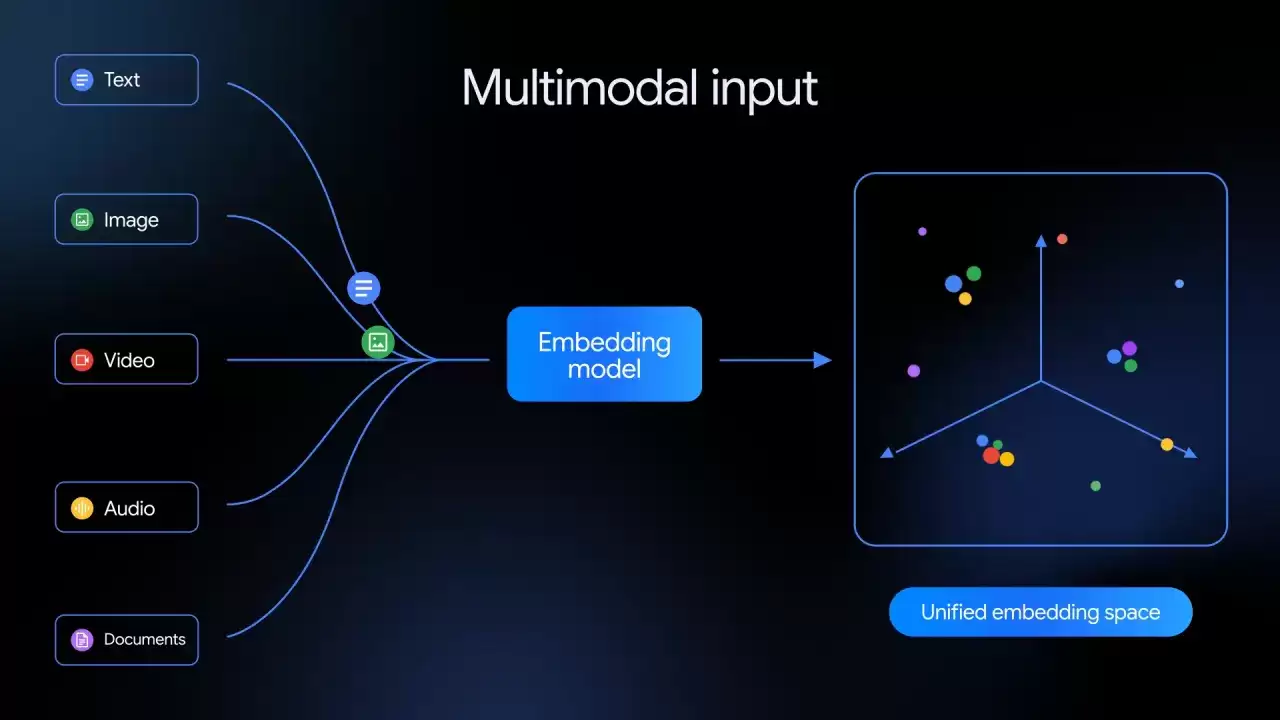

北京时间今天凌晨,谷歌扔出了一枚重磅技术冲击波——全新的 Gemini Embedding 2 模型正式发布。这可不是一次简单的迭代,它是谷歌首个原生的多模态嵌入模型。简单来说,从此以后,文字、图像、视频乃至整个文档,都能被它映射到同一个“理解空间”里,让机器用一种前所未有的统一视角来“看”世界。

免费影视、动漫、音乐、游戏、小说资源长期稳定更新! 👉 点此立即查看 👈

这里需要先分清一个概念:嵌入模型和咱们常聊的生成式模型(比如 Gemini 3)走的不是一条路。生成式模型负责“创造”,而嵌入模型的核心任务是“理解”。它的工作,是把一段文本、一张图片或一段视频,转换成机器更容易读取和分析的数学形式(通常是向量)。

那么,这种转换有什么实际价值呢?关键在于语义。通过语义搜索、分类和聚类这些方式,嵌入模型能够捕捉到信息之间深层次的含义关联。因此,它提供的结果往往比传统的关键词匹配更精准,也更贴合上下文,真正从“匹配词汇”升级到了“理解意图”。

回顾谷歌的嵌入模型发展,早期的版本其实只支持文本处理。而这次的 Gemini Embedding 2,堪称一次全方位的“感官开放”。它一举支持了文本、图像、视频、音频和文档五种模态,并且能在超过100种语言中识别用户的语义意图,野心不小。

当然,能力越大,处理起来也越需要清晰的规则。不同数据类型的处理限制如下:

文本:上下文窗口最高支持8192个tokens。

图像:每次请求最多处理6张,支持 PNG 和 JPEG 格式。

视频:输入视频最长120秒,支持 MP4 和 MOV 格式。

音频:一个亮点是,它可以直接处理原始音频数据,省去了先转录成文字的麻烦步骤。

文档:最多可支持6页的 PDF 文件。

谷歌在官方博客中特别强调,新模型的目标是双重的:一是简化那些原本复杂的多模态数据处理流程;二是全面增强各类应用的多模态理解能力。哪些应用会因此受益?范围很广,从当前火热的检索增强生成(RAG)、更智能的语义搜索,到细致的情感分析和大规模数据聚类,都能看到它的用武之地。

更妙的是,这个模型还支持在一次请求中接收混合输入,比如“图像+文本”。这意味着它能同时分析不同媒体类型之间的关系,而不是孤立地看待它们。这无疑是向真正的跨模态理解迈出了一大步。

举个具体的例子吧。在法律领域的诉讼取证阶段,面对海量的证据材料(包括合同文本、监控视频、沟通录音),法律专业人士如何快速定位关键证据?Gemini 嵌入模型就能大显身手。测试结果显示,在数百万条记录的数据库中进行搜索时,多模态嵌入技术能显著提升检索的精度和召回率,同时让图像与视频的搜索效果也上了一个台阶。

目前,Gemini Embeddings 2(具体型号为 gemini-embedding-2-preview)已经通过 Gemini API 和 Vertex AI 平台开放了公开预览。值得注意的是,原先的纯文本嵌入模型 gemini-embedding-001 并未退役,它将继续服务于那些只需要处理文本的轻量级应用场景。谷歌这次是扩展了能力边界,而非简单地替换,策略相当清晰。

这就是谷歌首个原生多模态嵌入模型 Gemini Embedding 2 发布:能让机器“理解”信息的全部内容了,希望以上内容对小伙伴们有所帮助,更多详情可以关注我们的菜鸟游戏和软件相关专区,更多攻略和教程等你发现!

专题合集

精彩合集,奇葩无下限相关文章

- QClaw海外版开启内测,腾讯龙虾特工队正式出海

- 苹果更换CEO原因首次曝光!特纳斯比库克更果断、更有远见 将重塑硬件产品线

- Claude 辅助学术论文写作的合规性讨论

- 2026 年 4 月全球中学学习机品牌推荐:五款口碑产品评测对比顶尖熬夜刷题防眼疲劳

- 知无涯app如何打印试卷-知无涯app怎样打印试卷

- 三星 GALAXY Tab A 8.0 (P350)用Odin怎么刷机?三星odin刷机教程

- KIMI官网电脑版登录_KIMI官网PC版使用教程

- 一加 7 pro 安装教程:从下载到激活的完整步骤

- 一加 7 pro 配置指南:快速上手与常见问题解答

- 苹果手机ID怎么修改 苹果手机更换Apple ID账号步骤

大家还在看

-

- 《脑洞大侦探》第七关解救人质怎么过-第7关解救人质三星通关图文攻略

-

26-04-27

-

- 研途考研app账号注销步骤

-

26-04-27

-

- 王者荣耀世界评价如何王者荣耀世界值不值得体验

-

26-04-27

-

- 辉光之城1907好玩吗辉光之城1907核心玩法与新手入门指南

-

26-04-27

-

- 《识质存在》地忆芯片遮阳伞获得方法介绍

-

26-04-27