谷歌全新Gemma4开源大模型重磅发布:采用Apache2.0许可证,支持多模态与端侧离线

时间:26-04-22

谷歌 Gemma 4 重磅开源:字节级最强性能,直指企业本地化部署

就在刚刚,谷歌DeepMind甩出了一套“王炸组合”——Gemma 4系列开源大模型正式亮相。这次可不是小打小闹,一口气推出了四个规格:主打效率的20亿参数版(E2B)和40亿参数版(E4B),以及面向高性能需求的260亿参数混合专家模型(MoE)和310亿参数稠密模型(31B)。

免费影视、动漫、音乐、游戏、小说资源长期稳定更新! 👉 点此立即查看 👈

更关键的是,它的目标非常明确:为智能体开发和代码场景深度优化,并且采用了对企业极度友好的Apache 2.0开源协议。谷歌这次是铁了心要啃下企业级本地部署这块硬骨头,甚至直接喊出了“在逐字节比较下,这是性能最强的开放模型”的口号,底气十足。

那么,这套组合拳究竟强在哪里?简单说,它打出的是一张“安全可控”的企业牌。谷歌直接承诺,不会使用用户的私有数据来训练后续模型,这相当于给那些对数据安全如履薄冰的企业吃了一颗定心丸。与此同时,模型的推理能力得到了全面升级,支持超过140种语言、原生函数调用,还能处理多模态输入,最高256K的上下文窗口更是为本地代码助手这类场景量身定做。

协议更开放

变化首先发生在协议层面。从原来的专用许可转向Apache 2.0,这意味着什么?企业可以毫无顾忌地将其用于商业用途、自由修改甚至二次分发,以往令人头疼的合规成本随之大幅降低。

性能大幅提升

当然,光有开放许可还不够,性能才是硬道理。与上一代Gemma 3相比,Gemma 4在数学、代码、多模态理解和长文本处理等一系列核心基准测试上实现了全面上涨。尤其是代码与复杂推理能力,提升幅度相当显著,不再是“花瓶式”的开源模型。

部署门槛降低

想让企业用起来,还得足够“亲民”。Gemma 4系列加强了对消费级显卡和边缘设备的支持,这使得本地部署和后续微调的成本显著下降。对于许多中小企业而言,私有化落地不再是一个遥不可及的昂贵梦想。

生态全面兼容

生态建设上,谷歌也做足了功课。模型一经发布,便已同步登陆Google AI Studio、Hugging Face、Kaggle等主流开发者平台。更重要的是,它与vLLM、SGLang、Llama.cpp、MLX等当前热门的推理框架实现了全面兼容,开发者几乎可以无缝接入现有技术栈。

话说回来,当前全球大模型竞赛,特别是国内赛场,早已是短兵相接。月之暗面、阿里通义千问等模型在多项指标上已展现出全球竞争力。在此背景下,谷歌通过Gemma 4这套轻量化、高安全、低成本的组合方案,意图非常清晰:强化其在开源生态与企业级市场的话语权,一场围绕企业私有化部署的新战役,已经悄然打响。

这就是谷歌全新Gemma4开源大模型重磅发布:采用Apache2.0许可证,支持多模态与端侧离线的全部内容了,希望以上内容对小伙伴们有所帮助,更多详情可以关注我们的菜鸟游戏和软件相关专区,更多攻略和教程等你发现!

专题合集

精彩合集,奇葩无下限相关文章

大家还在看

-

- 《明日方舟》十字路口CG-S-1和CG-S-2突袭攻略

-

26-04-26

-

- 《星球大战》漫画:侠盗一号最冷酷的义军成员迎来个人刊

-

26-04-26

-

- 王者荣耀后羿天穹守望者皮肤多少钱-王者荣耀后羿天穹守望者皮肤价格一览

-

26-04-26

-

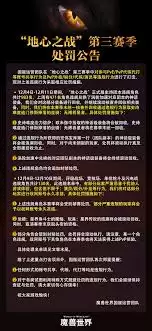

- 地心之战第三赛季史诗难度怎么打

-

26-04-26

-

- 《异种航员2》赚钱技巧-详细金币获取攻略

-

26-04-26