模型选择决定费用_Hermes Agent 高性价比模型推荐

时间:26-04-22

一、低成本高响应:DeepSeek-V3(API 方式)

如果你手头的任务调用频繁,但对超长上下文依赖不高,那么 DeepSeek-V3 的 API 方案值得优先考虑。它的核心优势在于输入输出成本显著低于主流闭源模型,单位推理成本被大幅压缩。这对于批量处理、摘要生成、基础工具调用这类轻量级 Agent 行为来说,性价比非常突出。

免费影视、动漫、音乐、游戏、小说资源长期稳定更新! 👉 点此立即查看 👈

具体怎么操作呢?首先,访问 DeepSeek 官方平台注册账号并获取 API Key。接着,在 Hermes Agent 配置界面找到 “Custom API” 模式并选择它。然后,在 API 端点一栏填入:https://api.deepseek.com/v1/chat/completions。别忘了,模型名称字段要设置为:deepseek-chat。配置完成后,执行 hermes config test 命令验证一下连接是否有效,这一步很关键。

二、强指令遵从与工具调用:Claude Opus 4(OAuth 授权方式)

当任务复杂度升级,比如涉及到多步骤拆解、高精度工具调用或者需要跨会话记忆时,模型的可靠性就成了首要考量。在这方面,Claude Opus 4 的表现堪称标杆,尤其适合飞书审批触发、微信消息结构化解析这类对准确性要求极高的复杂自动化流程。

部署起来也不麻烦。第一步,登录 Claude 官网,开通 Pro 或更高级别的订阅计划。然后,打开 Hermes Agent 的命令行界面,运行:hermes model。在接下来的交互菜单中,依次选择 “Anthropic Claude” 和 “Claude Code auth”。系统会提示你跳转到 Anthropic 的 OAuth 页面完成授权。授权成功后,Hermes 会自动写入凭证并为你开启 Opus 4 的模型通道,整个过程相当顺畅。

三、纯本地零费用运行:Qwen2.5:32b(Ollama 方式)

对于数据隐私有严格要求,或者希望 Agent 能长期、离线驻留的场景,本地部署是唯一的选择。Qwen2.5:32b 模型在中文理解、复杂推理和技能演化上表现均衡,配合 Ollama 可以做到完全离线运行,彻底摆脱网络依赖和 API 计费。

具体部署分几步走:首先,确保你的系统已经安装了 Ollama 服务(macOS 或 Linux 用户可以通过执行 curl -fsSL https://ollama.com/install.sh | sh 来完成)。启动 Ollama 后,执行 ollama run qwen2.5:32b,这会触发模型的自动下载。下载完成后,回到 Hermes Agent 的配置界面,选择 “Ollama” 作为模型网关类型。接着,将模型名称设置为:qwen2.5:32b,端口保持默认的 11434 即可。最后,运行 hermes agent start,你的本地智能体实例就成功启动了。

四、代码专项优化:DeepSeek-Coder-v2:16b(Ollama 方式)

如果你的 Hermes Agent 主要任务是辅助编程,比如函数签名识别、错误定位或者生成单元测试,那么就需要一个更“专业”的模型。DeepSeek-Coder-v2:16b 专为此类任务微调,具备原生优势。而且,它的内存占用比 Qwen2.5:32b 更低,适合在中等配置的设备上部署一个专注的代码助手。

配置流程同样清晰:首先在终端执行 ollama pull deepseek-coder-v2:16b 来下载模型。下载后,可以通过 ollama list | grep deepseek 命令确认模型是否在列表中。然后,进入 Hermes Agent 的配置目录,找到并编辑 config.yaml 文件。将其中的 model: 字段值修改为:deepseek-coder-v2:16b。保存修改,重启 Hermes Agent,最后不妨执行一个 Python 脚本调试任务来验证一下模型的响应质量。

五、平衡型英文任务:Llama3.1:8b(Ollama 方式)

最后,如果你的任务以英文对话、文档解析和通用工具调用为主,同时设备资源又比较有限(比如只有 8GB RAM),那么就需要一个在性能、速度和资源消耗之间取得平衡的选项。Llama3.1:8b 正好满足这些条件,启动快,显存占用低,能稳定支撑 Hermes Agent 的基础功能。

上手很简单:运行命令 ollama run llama3.1:8b 拉取模型。当你在终端看到 >>> 提示符时,就表示模型已经加载就绪。接下来,在 Hermes Agent 的 Web 管理界面中,进入模型设置页面,选择 “Ollama” 类型,然后从下拉菜单中找到该模型。手动填写 Ollama 的主机地址为:http://localhost:11434。点击“应用配置”后,建议立刻发起一个生成英文邮件草稿的请求,实际测试一下效果。

这就是模型选择决定费用_Hermes Agent 高性价比模型推荐的全部内容了,希望以上内容对小伙伴们有所帮助,更多详情可以关注我们的菜鸟游戏和软件相关专区,更多攻略和教程等你发现!

专题合集

精彩合集,奇葩无下限相关文章

大家还在看

-

- 和平精英火箭少女101全出能卖多少钱

-

26-04-26

-

- 杀戮尖塔2各遗物强度高低的排名清单

-

26-04-26

-

- 王者荣耀世界智能构造攻略王者荣耀世界智能通关详细步骤解析

-

26-04-26

-

- 史上最强炼气期境界如何划分等级

-

26-04-26

-

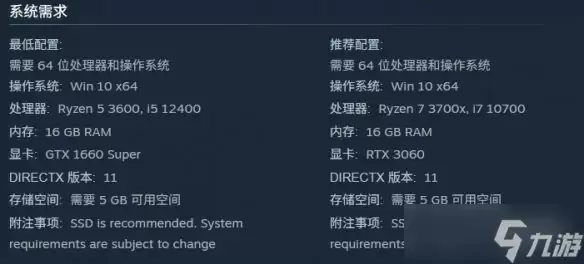

- 《终落之城》配置要求

-

26-04-26