当大模型被派去识别螺丝型号时,它究竟能做到什么?

时间:26-04-22

免费影视、动漫、音乐、游戏、小说资源长期稳定更新! 👉 点此立即查看 👈

一项由加拿大滑铁卢大学、澳大利亚悉尼大学、香港中文大学(深圳)等十余所顶尖学术机构联合完成的研究,为AI在工业质检领域的应用提供了关键基准。该研究以预印本形式发布(arXiv:2604.07413),其核心贡献是构建了名为FORGE的评测基准,旨在系统性地评估当前顶尖多模态大语言模型在真实工厂质检场景下的实际能力。

工业质检:一个被低估的AI挑战

现代工厂流水线每日处理数以亿计的零件组装。一颗螺丝的型号错误、一个零件的表面微裂纹,或是一个缺失的垫圈,在航空发动机或精密医疗设备的生产中,都可能导致严重后果。

传统上,这道质量关卡依赖经验丰富的老师傅。机器视觉系统虽能替代人眼进行定位和基础缺陷识别,但它缺乏认知能力——无法理解“M10螺栓为何不能与M16螺母配套”,也无法自主判断“当前装配是否符合特定工艺规格”。

于是,一个关键问题浮现:那些在图文理解和对话中表现卓越的多模态大模型,能否胜任工厂中“视觉+认知”的复合角色?为了给出实证答案,研究团队构建了FORGE基准,使用真实工业零件数据集,设计了三类核心任务,并对18个前沿多模态模型进行了全面测试,揭示了技术当前的潜力与瓶颈。

一、FORGE基准:为何它重新定义了工业AI评测

在FORGE之前,工业AI评测多聚焦于基础物体识别,例如让模型回答“这是一颗螺丝”。然而,现实生产要求的是“型号级”的精确理解。以螺母为例,M10与M12型号间直径仅差几毫米,但装配关系截然不同。将M16螺母误用于M10螺栓将直接导致零件报废。

因此,FORGE的核心设计原则是**型号级别的细粒度语义理解**——模型不仅要识别物体类别,更要精确判断其具体型号及配套关系。为实现这一高精度目标,研究团队使用精度达0.02毫米的手持3D扫描仪,对14类、90种型号共585个真实工厂零件样本进行了扫描,并采集了约3000张四种真实装配场景的图像。所有数据均带有精细的型号与缺陷标注。最终构建的FORGE基准包含12972个评测样本,涵盖图像与3D点云两种模态,是目前制造业领域最全面的多模态基准之一。

二、三项核心任务:拆解工业质检的关键环节

FORGE设计了以下三类任务,分别对应生产流程中的关键质检环节:

任务一:零件核验。 模拟来料检验场景。给定目标零件型号(如“应全部为M18杯头螺丝”),模型需从混合批次中准确识别出型号不符的“异类”。

任务二:表面缺陷检测。 模拟过程质检。模型需根据零件的三视图点云渲染,判断其是否正常。若存在缺陷,需进一步从裂纹、切痕、变形、凹痕四种类型中做出精确分类。此任务覆盖全部14种零件类型,挑战模型对微观形态的感知能力。

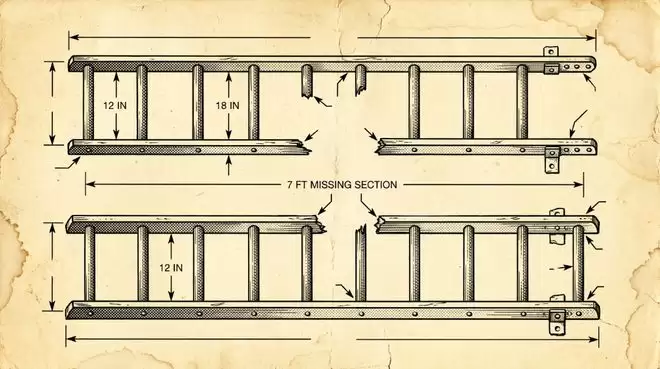

任务三:装配核验。 模拟最终装配检查。给定一套标准装配图(如包含五个部件的金属膨胀螺栓),模型需判断其中是否存在型号错误、多余或缺失的零件。这要求模型不仅识别零件,还需理解装配逻辑与规则。

所有任务均以多选题形式呈现,并设置了零样本、参考条件(提供标准样品图)、上下文示范(提供例题)三种难度模式。

三、模型表现全景:领先者的优势与共性短板

研究评估了18个代表性模型,包括闭源的GPT-5系列、Gemini系列、Claude,以及开源的Gemma、Llama、Qwen、Kimi等。

总体而言,闭源模型在零件核验与装配核验任务上表现领先,其中Gemini-3-Flash与GPT-5系列成绩突出。开源阵营中,Kimi-K2.5与Qwen3-VL-235B表现相对较好。

然而,一个显著短板在表面缺陷检测任务中暴露。这项看似基础的“五选一”选择题,成为了所有模型的得分洼地,最强模型的准确率也难以突破50%,部分结果接近随机猜测。这明确显示:大模型对零件的宏观类别识别已相对成熟,但对微观表面形态(如区分裂纹与切痕)的感知能力仍严重不足。

四、反直觉发现:更多信息未必带来更好表现

评测揭示了一个反直觉现象:在基于三视图点云的任务中,为模型提供“正确答案”参考图后,许多模型的准确率不升反降,部分跌幅超过十个百分点。

问题根源在于空间感知的混淆。三视图是零件在前、侧、俯三个正交方向的平面投影,同一零件在不同视角下形态差异显著。当模型试图将测试图与参考图进行空间匹配时,视角差异与其自身空间理解能力的局限,反而引入了干扰,导致判断混乱。

相比之下,依赖形状语义理解(如型号判断)的任务受此影响较小。这一发现对工业AI应用具有直接启示:信息呈现方式至关重要,盲目增加输入信息可能适得其反。

五、瓶颈诊断:是“看不清”还是“不懂行”?

为定位根本症结,研究者设计了三个诊断实验:

实验一:评估视觉定位能力。 直接测试模型对图中指定坐标对应零件的识别能力。顶尖模型在此类任务上准确率超过97%。结论:主流大模型“看得清”,视觉基础能力并非主要瓶颈。

实验二:评估领域知识。 仅向模型提供装配规格的文本描述,测试其是否知晓正确装配应包含的零件。结果发现,模型在大多数零件上判断正确,但系统性地混淆了“平垫圈”与“弹簧垫圈”。这表明错误源于对零件功能特性的专业知识缺失。

实验三:评估3D形状理解。 将3D点云数据转换为纯文本坐标表格输入模型,测试其从数字序列中解析形状的能力。模型在缺陷检测任务上表现接近随机猜测。结论:对于通用大模型而言,视觉渲染是理解3D制造数据的必要前提,纯数值输入远不足以支撑形状分析。

综合三项实验,结论清晰:当前大模型在制造业场景下表现不佳的核心原因,并非底层视觉能力不足,而是缺乏细粒度的领域专业知识。

六、错误分析中的潜力:模型“失败”中的闪光点

深入分析模型的错误推理过程,研究者发现了两种有价值的“失败模式”。

第一种可称为“材料幻觉”。在某案例中,模型错误地将一个金属平垫圈判定为“塑料材质”,并据此认定其不合格。虽然结论错误,但其推理过程尝试将材质属性纳入合规性判断,这种思维模式正是高级工业AI所需具备的。

第二种可称为“服役状态感知”。在另一个案例中,模型虽然判断错了具体的问题零件型号,但在推理中额外指出了“压板A端部严重磨损”和“垫块D存在磨损痕迹”。这种识别零件磨损状态的能力,与工厂的预测性维护需求高度契合,其价值远超简单的合格/不合格二分判断。

这些案例暗示,大模型在制造业中的潜在能力,可能比标准化测试所衡量的更为广泛。

七、小模型的逆袭:领域微调的价值证明

既然瓶颈在于领域知识,那么注入专业知识能否带来突破?研究者进行了一项关键实验。

他们选取了参数量仅30亿的轻量级模型Qwen2.5-VL-3B,使用FORGE数据集的部分数据对其进行全参数微调。为确保模型学到可迁移的推理能力而非记忆,测试采用了跨场景方式:例如,用杯头螺丝数据训练,测试其在螺母场景的表现;用膨胀螺栓数据训练,测试其在数控夹具上的表现。

结果极具说服力。在零件核验任务上,微调后的小模型准确率从28.2%大幅提升至53.8%,增幅达90.8%,其表现追平了参数量为其78倍的Qwen3-VL-235B。在装配核验任务上,它也超越了多个规模更大的模型。

这一实验传递了明确的实践信号:对于制造业等垂直领域,无需被动等待更强大的通用模型。通过使用高质量领域数据对轻量级模型进行定向微调,完全可以在特定任务上获得媲美甚至超越顶级大模型的效果,这为工业AI的经济高效落地指明了可行路径。

核心启示与落地路径

这项研究将数字世界中的大模型置于真实的工业“考场”,提供了一份客观的能力评估报告。其核心启示如下:

首先,大模型并非工业场景的“即插即用”解决方案。在要求极致精度的制造业中,“识别物体”与“理解规则”之间存在巨大鸿沟,后者尤其是对微观缺陷的判别,仍是当前技术的攻坚难点。

其次,失败的主因已明确:是领域知识的匮乏,而非基础视觉能力的缺失。模型无法区分功能不同的相似零件,不理解装配逻辑,也难以感知微观表面形态。而这恰恰是通过数据可以弥补的。

最后,也是最积极的发现:这一知识缺口可以通过相对经济的方案填补。使用精心构建的制造业数据集对一个小规模模型进行微调,即可带来性能的飞跃。对于制造企业而言,这意味着无需依赖“通才”,可以基于自身产线数据,培养一个专精的“AI工匠”。

当然,FORGE基准也存在其边界,例如数据规模与多样性相比真实工厂的复杂环境仍有差距,模型在油污、遮挡、极端光照等条件下的鲁棒性有待进一步验证。使用三视图渲染替代真实3D输入也是一种研究妥协。

这项研究更重要的意义在于提供了一个清晰的起点。它表明,推动AI在工厂中真正发挥作用,下一步的关键并非盲目追求模型规模,而是深入行业,构建更精细、更结构化的领域知识体系。未来的工厂AI,若能融合质检、磨损预测与工艺优化,其学习路径应如何设计?这正是FORGE这类基准试图引导的方向——先精准定义问题,解决方案的路径便会随之清晰。

Q&A

Q1:FORGE评测基准和之前的制造业AI评测有什么不同?

A:根本区别在于评测精度与任务深度。传统评测多停留在物体识别层面(例如“识别螺丝”),而FORGE要求达到型号级别的细粒度理解(例如“识别M16螺丝”)并考核其装配兼容性。同时,FORGE综合了2D图像与3D点云数据,设计了零件核验、缺陷检测、装配核验三类贴近实际生产流程的任务,在数据质量与评测维度上更为深入和严谨。

Q2:大模型在制造业场景下表现差的主要原因是什么?

A:根据研究的系统性诊断,主要原因并非视觉感知能力弱(模型具备良好的物体定位能力),而是严重缺乏制造业所需的细粒度专业知识。具体包括:无法区分外形相似但功能迥异的零件(如平垫圈与弹簧垫圈)、不理解零件间的装配规则与逻辑、以及对微观表面缺陷类型的感知与分类能力不足。

Q3:微调小模型的效果真的能媲美大模型吗?

A:在特定的、定义清晰的制造业任务上,完全可能实现。研究证实,仅使用FORGE数据集对30亿参数的小模型进行定向微调,其在零件核验任务上的性能即可提升90%以上,达到与某些参数量庞大的模型相当的水平。这证明,通过注入领域知识,轻量级模型可以成为工业AI落地的高效、经济解决方案。

这就是当大模型被派去识别螺丝型号时,它究竟能做到什么?的全部内容了,希望以上内容对小伙伴们有所帮助,更多详情可以关注我们的菜鸟游戏和软件相关专区,更多攻略和教程等你发现!

专题合集

精彩合集,奇葩无下限相关文章

大家还在看

-

- 怪胎马戏团如何设置中文

-

26-04-26

-

- 《全球使命3》越战越有礼!靶场神器震撼登场

-

26-04-26

-

- 《背包英雄》特殊状态分享

-

26-04-26

-

- 种花领超大及限定孢子!《球球大作战》花仙岛4.17开启浪漫奇遇

-

26-04-26

-

- 1.76复古传奇怀旧版,《无忧》原汁原味无魔改版本

-

26-04-26