Seedance 2.0是干嘛的 Seedance 2.0能干什么

时间:26-04-25

一、将文本直接转化为带原生音频的多镜头视频

这大概是Seedance 2.0最令人惊艳的能力了。你只需要输入一段结构化的描述,剩下的,比如分镜怎么切、镜头怎么运动、节奏如何把控,甚至包括匹配画面的语音、环境音和背景音乐,模型都会一手包办。整个过程一气呵成,完全不需要你再去后期配音或合成音轨。从输入到输出,一段4到15秒、分辨率最高可达2K的完整音视频,通常只需要等待40到60秒。

免费影视、动漫、音乐、游戏、小说资源长期稳定更新! 👉 点此立即查看 👈

具体怎么操作呢?其实路径很清晰:

首先,打开像Dreamina、CapCut网页端或万兴剧厂这类已经集成了该模型的平台。

接着,选择Seedance 2.0模型,并切换到“文生视频”模式。

然后,在提示框里输入你的完整构想。举个例子,你可以这样写:“一位穿银色机甲的少年在悬浮城市上空滑翔,身后拖出淡蓝色光痕;镜头由仰拍转为跟拍,风声与引擎低频嗡鸣随速度增强。”

最后,点击生成,稍等片刻,一段自带声音和画面的短片就诞生了。

如果你初次接触“Seedance 2.0”这个名字感到陌生,需要明确一点:它并非一个通用工具或系统组件,而是字节跳动推出的专用AI视频生成模型。其核心能力,主要围绕以下五个方面展开。

二、依据单张或多张图像生成连贯运动视频

想让静态图片“活”过来?Seedance 2.0的图生视频能力正是为此而生。它能够从一张或多张静态图像出发,推演出符合物理规律的自然动态。无论是人物的口型同步说话,还是行走、转身等动作,模型都能流畅生成,并且能确保角色在视频的每一帧里都保持一致,不会出现“脸崩”或特征漂移的问题。这背后,是模型对图像中人物姿态、服装纹理、光照方向和场景纵深的精准识别。

操作上,你可以上传1到9张参考图,比如角色的三视图、场景环境图或风格参考图。

在撰写提示词时,通过使用@Image1、@Image2这样的标记,可以精确调用指定的图像元素。

别忘了补充具体的动作指令,例如:“@Image1的角色向@Image2的咖啡馆门口走去,微笑着挥手,阳光在发梢形成高光。”

为了保证万无一失,建议启用“ID-LoRA锁定”功能,它能牢牢锁住人物特征,确保在多镜头转换中也不会走样。

三、融合多种模态参考素材进行精准可控合成

单一模态的输入有时难免局限,而Seedance 2.0的杀手锏在于其原生支持的多模态融合能力。文本、图像、音频、视频四类素材可以联合驱动生成过程,模型最多能同时解析3段视频、9张图片和3段音频。这意味着,你可以对镜头运动、情绪基调、口型节奏乃至角色行为进行前所未有的多维协同控制。

想象这样一个场景:你想生成一段人物在雨夜窗边独白的片段。

可以先上传一段人物说话的短视频,用来定义精确的唇形和语速节奏。

再上传一张室内布景图作为场景参考,同时配上一段雨声音频来设定氛围。

最后,在提示词中整合所有元素:“@Video1中的人物站在@Image1的窗边,听@Audio1的雨声,轻声说出‘明天会放晴’,窗外天色渐亮。”

接下来,系统会自动完成口型与音频的对齐、雨声音量随画面的强弱变化,以及光影的平滑过渡,最终输出一个极具沉浸感的15秒片段。

四、执行局部编辑与风格迁移式图像增强

对于已有的图像素材,Seedance 2.0提供了非常精细的“外科手术”式编辑能力。在其图生图子能力下,你可以进行非破坏性的局部修改:在完全保留原始构图、光影和主体结构的前提下,单独更换背景、调整服饰颜色、重塑人物姿势,或者复刻某位艺术大师的独特风格。

操作流程直观易懂:

上传原始人像图后,勾选“固定造型修改环境”功能。

输入对新背景的描述,比如:“@Image1的人物置身于敦煌莫高窟第220窟壁画前,暖金色光线从拱门斜射入内。”

系统会自动调整人物皮肤的反光、衣料的阴影,使其与新背景的光线和质感完美融合,最终合成结果几乎看不出拼接痕迹。

如果需要对细节进行更极致的控制,可以切换至内置的ControlNet模式,启用OpenPose骨骼约束或边缘轮廓锁定等功能。

五、支持多图融合与跨素材元素重组

这可以说是创意工作者的“素材搅拌机”。通过多图参考机制,Seedance 2.0能够将不同图像中的独立元素——例如A图的人物、B图的服装、C图的背景、D图的光影风格——按照你的指令进行逻辑化重组,从而创造出全新的构图内容。

举个例子:

你可以上传四张图,并分别标注为@Image1(人物)、@Image2(旗袍)、@Image3(江南园林)、@Image4(水墨渲染滤镜)。

随后输入指令:“让@Image1的人物穿上@Image2的墨绿色旗袍,缓步穿过@Image3的曲桥,整体呈现@Image4的水墨晕染效果,保留原人物五官与手部细节。”

模型会解析每张图的语义层级,完成服装纹理到人物身体的映射、调整人物姿态以匹配园林场景的透视,并将水墨风格渗透到每一个像素。

最终输出的结果中,人物姿态自然,旗袍的褶皱会随着肢体运动而变化,桥体结构也与真实的园林景致相匹配,整体色调和笔触统一在水墨画的逻辑之下,完成度相当高。

这就是Seedance 2.0是干嘛的 Seedance 2.0能干什么的全部内容了,希望以上内容对小伙伴们有所帮助,更多详情可以关注我们的菜鸟游戏和软件相关专区,更多攻略和教程等你发现!

专题合集

精彩合集,奇葩无下限相关文章

- A股PCB概念股集体下跌,南亚新材跌超7%

- 雷军亲临北京车展!小米汽车发布会揭秘新车型,逛展直播送福利

- 苹果新任 CEO 特努斯面临人才流失挑战芯片高管为何成为第二把手

- 《战国王朝》最新更新4月30日上线 新武器系统登场

- 八位堂推出 Retro 18 机械数字键盘 - Xbox 版:绿透配色 209 元

- 宝华韦健 Px8S2 头戴式耳机新增“藏金蓝”“晴漪蓝”配色可选 首发价 5399 元

- 硬件情报站第206期:一代经典卡RTX 3060 12GB或要复活 超频大神揭开RTX 5090烧接口真相

- 《最终幻想14》8.0资料片Evercold公布 支持PS4平台、2027年1月上线

- 《生化危机9》发售不到两个月 销量突破700万

- 《极限竞速:地平线5》PS5版销量已超500万

大家还在看

-

- 王者荣耀世界伽罗铭文怎么搭配

-

26-04-25

-

- 王者荣耀世界春溪漫滩赋神令在哪里在哪

-

26-04-25

-

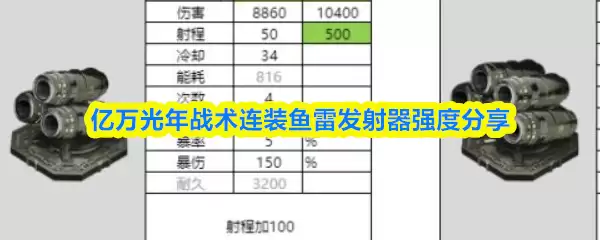

- 亿万光年战术连装鱼雷发射器强度分享

-

26-04-25

-

- 《伊瑟》贝兹比养成攻略

-

26-04-25

-

- 《伊瑟》希尔芙PVE玩法攻略

-

26-04-25