容器内句柄耗尽引发“血案”!从零梳理 Linux FD 限制全链路

时间:26-04-25

从“Too many open files”入手,深度解析Linux文件描述符限制体系

免费影视、动漫、音乐、游戏、小说资源长期稳定更新! 👉 点此立即查看 👈

生产环境服务突发异常,客户反馈连接失败。经过系统排查,最终定位到一个经典的Linux内核错误:Too many open files。

然而,简单地调整ulimit并未奏效。最终发现,问题根源在于容器内部发生了文件描述符(FD)泄漏。本文将以这个真实故障为例,完整拆解Linux文件描述符限制的多层架构,厘清各层限制如何协同作用。

一、 故障现场:服务连接突发拒绝

现象描述

运维平台收到生产服务响应超时告警。登录容器查看应用日志,发现如下关键错误:

http: Accept error: accept tcp 10.xx.xx.xx:xxxxx: accept4: too many open files; retrying in 1s

http: Accept error: accept tcp 10.xx.xx.xx:xxxxx: accept4: too many open files; retrying in 320ms关键点分析:

too many open files:典型的Linux系统限制错误,表明进程已达到其文件描述符上限。accept4失败:内核无法为新的TCP连接分配文件描述符。- 服务行为:进程陷入重试循环,CPU资源被大量消耗,新连接完全无法建立。

第一反应通常是增加FD配额。运维人员执行了ulimit -n 65535,但错误日志并未停止,服务也未恢复。

这表明问题并非简单的配额不足,极有可能是文件描述符泄漏。

二、 问题定位:深入容器内部探查

为了确认猜测,需要查看进程实际打开的文件句柄。

在容器内执行:

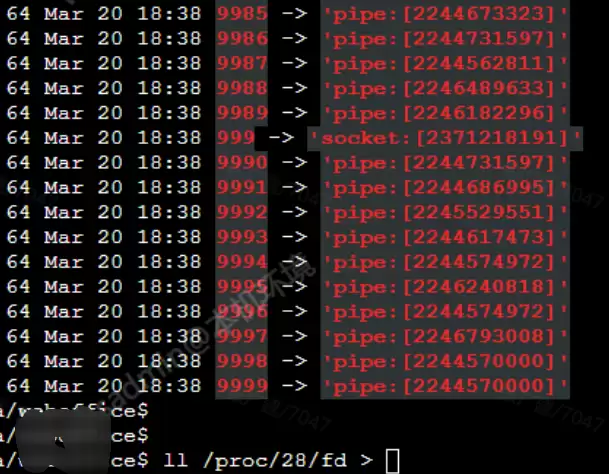

ls -l /proc/进程PID/fd输出的FD列表揭示了真相。部分输出如下:

- 编号异常:文件描述符编号已高达9999以上,远超正常范围。

- 类型集中:绝大多数为

pipe(管道)类型,仅有少量网络socket。

结论明确:这是一个典型的pipe文件描述符泄漏。

什么是pipe泄漏?

此类问题通常源于子进程管理不当。

- 程序调用外部命令(如shell脚本、转码工具)。

- 使用管道进行进程间通信。

若主进程未能正确close管道或wait子进程,管道句柄将持续累积,FD数量无限增长,最终触发Too many open files错误。

三、 体系拆解:Linux FD 限制的多层架构

要根治此类问题,必须从单个容器跳脱出来,从宿主机视角理解Linux文件描述符的管理机制。

宿主机的“句柄数限制”是一个由多层限制构成的复合体系。

实际生效值 = 所有层级限制中的最小值

为清晰理解这一复杂的继承关系,我们从底层内核到上层进程进行完整梳理。

第一层:内核全局限制(fs.file-max)

这是Linux内核层面的全局硬限制,定义了系统所有进程可打开文件总数的上限。

查看:

cat /proc/sys/fs/file-max

# 或

sysctl fs.file-max修改方式:

# 临时修改

sysctl -w fs.file-max=1000000

# 永久修改

echo "fs.file-max = 1000000" >> /etc/sysctl.conf

sysctl -p当前使用情况查看:

cat /proc/sys/fs/file-nr

# 输出格式:已分配FD 未使用FD 最大FD第二层:Systemd 服务限制

如果你的服务(包括Docker守护进程)由Systemd管理,这一层配置至关重要。

常见误区:全局ulimit设为65535,但systemd启动的Docker服务默认限制仅为1024 → 实际限制仍是1024。

查看Docker服务限制:

systemctl show docker | grep LimitNOFILE配置方法:

# 编辑服务配置文件

vim /etc/systemd/system/docker.service

# 在 [Service] 部分增加:

LimitNOFILE=65535

# 重载配置并重启服务

systemctl daemon-reexec

systemctl restart docker第三层:用户/进程限制(ulimit)

这是最广为人知的限制,作用于单个shell会话或特定用户。

查看软/硬限制:

ulimit -Sn # soft(软限制,进程可调高,但不可超过硬限制)

ulimit -Hn # hard(硬限制,系统强制上限)永久修改(用户级):

vim /etc/security/limits.conf

# 添加(*代表所有用户):

* soft nofile 65535

* hard nofile 65535⚠️ 注意:此配置对由systemd直接启动的服务可能不生效。

第四层:进程级限制(最终生效值)

这是最终作用于特定进程的限制值,可通过进程信息查看。

查看:

cat /proc/进程PID/limits | grep "open files"

# 示例输出:Max open files 65535 65535容器环境下的限制关系

在Docker容器中,限制链路更为复杂:

容器内实际限制 = min(宿主机fs.file-max, Systemd(docker.service), ulimit, Docker启动参数 --ulimit)

任意一层设置过低,都会导致容器内进程报错。

⚠️ 最常见的3个配置陷阱:

- 只修改ulimit:但systemd服务配置了更小的LimitNOFILE → 配置无效。

- 只修改容器参数:宿主机全局限制更低 → 配置无效。

- 只修改fs.file-max:此参数仅控制全局总量,不限制单个进程。

四、 生产环境调优与应急处理

基于以上分析,我们制定以下生产环境配置与应急方案。

推荐生产配置模板

✅宿主机内核(fs.file-max)

fs.file-max = 1000000✅Systemd服务(LimitNOFILE)

LimitNOFILE=100000✅Docker 启动参数(--ulimit)

# 在 docker-compose.yml 中配置:

ulimits:

nofile:

soft: 65535

hard: 65535针对FD泄漏故障的应急建议

如案例所示,调高限制并非根本解决方案。

正确的处理流程:

- 先止血(优先恢复业务):

- 方案1:临时调高容器FD限制(延缓问题爆发)。

- 方案2:重启问题容器(立即恢复服务)。

- 再定位泄漏源:通过监控FD类型分布(如pipe占比)定位问题模块。

- 最后修复代码:审查子进程调用、管道通信等逻辑,确保所有资源在使用后正确关闭释放。

核心结论

容器内出现Too many open files错误,未必是系统限制不足。通过本次故障排查,我们明确了两个核心点:

- 透彻理解Linux文件描述符限制的全链路体系,是解决此类复杂问题的基石。

- 根因分析才是治本之策。对于FD泄漏,单纯放宽限制只是推迟了故障发生的时间。

本次故障可以归结为一句话:

容器内进程因 pipe 文件描述符泄漏,最终触发 too many open files 系统限制,导致服务拒绝新连接。

这就是容器内句柄耗尽引发“血案”!从零梳理 Linux FD 限制全链路的全部内容了,希望以上内容对小伙伴们有所帮助,更多详情可以关注我们的菜鸟游戏和软件相关专区,更多攻略和教程等你发现!

专题合集

精彩合集,奇葩无下限相关文章

大家还在看

-

- 怪胎马戏团如何设置中文

-

26-04-26

-

- 《全球使命3》越战越有礼!靶场神器震撼登场

-

26-04-26

-

- 《背包英雄》特殊状态分享

-

26-04-26

-

- 种花领超大及限定孢子!《球球大作战》花仙岛4.17开启浪漫奇遇

-

26-04-26

-

- 1.76复古传奇怀旧版,《无忧》原汁原味无魔改版本

-

26-04-26