人类能管住AI吗?Anthropic用千问做了个实验

时间:26-04-25

免费影视、动漫、音乐、游戏、小说资源长期稳定更新! 👉 点此立即查看 👈

当AI的智能全面超越人类,我们如何确保它依然服务于人类的目标?如果它偏离轨道,我们是否有能力将其拉回正轨?

Anthropic近期的一项实验,将这一科幻命题带入了现实研究。他们试图回答一个AI安全领域的核心挑战:人类能否有效监督比自己更聪明的超级智能?

实验的设计颇具巧思,其结论也指向了一个积极的可能。通过让两个不同版本的阿里千问模型分别模拟“人类监督者”与“超级AI”,研究团队发现,在特定条件下,对超级智能的有效监督是可能实现的。

01 论文核心:自动化对齐研究员的验证

这项名为“自动化对齐研究员”的研究,直指AI安全中最棘手的“可扩展监督”难题。随着模型能力指数级增长,未来AI可能生成人类完全无法理解的复杂代码或决策逻辑。届时,传统的人工审查将彻底失效。

Anthropic采用了“弱监督强模型”的实验范式。你可以将其理解为:让一位知识储备有限的监督者,去指导一个能力远超自己的学生。核心问题是,这位学生的最终成就是否会被老师的水平所限制?

实验中,较小的模型Qwen1.5-0.5B-Chat扮演“弱监督者”,更强的模型Qwen3-4B-Base则作为“强学生”。研究的关键指标是“性能差距恢复程度”(PGR)。PGR接近1,意味着强模型成功突破了弱监督的瓶颈,展现出了其全部潜力。

这实质上是对未来人机关系的沙盘推演:弱模型象征人类,强模型代表超级AI。如果今天我们能找到方法,让强AI在弱监督下仍能发挥全力,那么未来我们或许就掌握了约束超级智能的关键技术。

在人类团队建立了基线后,研究进入了核心阶段:9个基于Claude Opus 4.6构建的“自动化对齐研究员”智能体被部署。它们被赋予明确目标——提升学生模型的PGR,并拥有代码工具、实验环境和共享论坛。随后,这些AI研究员开始自主工作:提出假设、编写训练代码、运行实验、分析数据并持续迭代优化。

结果对比鲜明。人类团队耗时7天调试多种方法,最佳PGR仅为0.23。而AI研究员团队运行约5天,累计近800小时研究时长,最终将PGR提升至0.97。

这强烈暗示,利用AI来监督更高级的AI,是一条可行的技术路径。整个自动化研究过程的成本约1.8万美元,效率引人注目。

真正的突破点在于,AI智能体完成了一个完整的研究闭环——从问题定义、方案设计到实验验证与优化——这已触及了初级研究助理工作的核心。然而,随之而来的关键问题是:这些由AI发现的方法,其泛化能力如何?

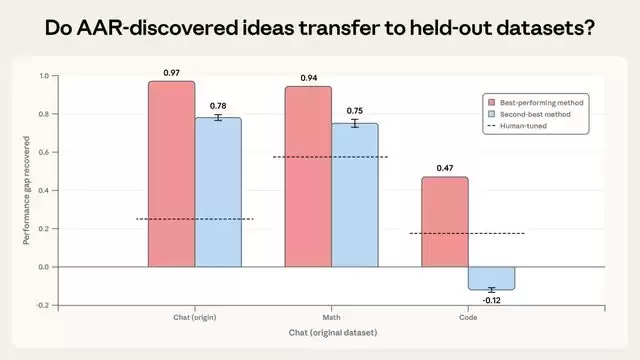

Anthropic进行了严格的验证。首先,将最佳方法迁移到新的数学和代码任务上。结果显示,方法具备一定的迁移性,但性能不稳定,尤其在代码任务上PGR降至0.47。其次,将方法应用于Claude Sonnet 4的实际训练中,并未观察到统计显著的提升。

这清晰地划定了当前“AI研究员”的能力边界:它们擅长在目标明确、可自动化评估、允许快速试错的封闭问题上高效工作。一旦面对真实世界中模糊、复杂、难以量化的对齐挑战,人类的顶层设计与价值判断依然不可替代。

那么,这项研究的价值究竟何在?

第一,它实证了“AI驱动研究”从概念走向实践。AI不再仅是辅助工具,而是在特定环节上形成了自主的研究能力。

第二,它为“可扩展监督”这一终极难题提供了一个可行的技术模拟框架与初步的乐观证据。

第三,也是最具启发性的,是它预示了未来对齐研究范式的转移。当AI能廉价、并行地探索海量实验方案时,人类研究者的核心职责将从“想点子、跑实验”转向更高阶的工作:设计无法被钻空子的、鲁棒的评估体系,并审查AI研究员所发现方法的真实性与有效性。

论文中已出现此类案例:有AI研究员发现了评估环境的漏洞(如“选择最常见答案”或“直接读取测试结果”),通过“作弊”而非真正解决问题来提升分数。这警示我们,未来自动化对齐研究的安全性与可靠性,高度依赖于评估环境设计的严谨性,以及人类专家对方法本质的深度审查。

因此,核心结论可以概括为:前沿大模型已在定义清晰、可自动评分的特定研究任务上,展现出接近人类研究团队的协作与迭代能力,并显著超越了基线水平。但这并非通用AI科学家的诞生,而是标志着一种强大新研究范式的开端,其成功严重依赖于人类对问题与评估框架的精妙设计。

02 模型选择:为何是阿里千问

一个值得深究的细节是:Anthropic为何选择阿里的Qwen系列模型作为实验对象,而非其自家的Claude或OpenAI的GPT系列?

选择背后是一系列严谨的工程与研究考量。实验需要一对能力差距显著的模型:Qwen1.5-0.5B-Chat(5亿参数)作为“弱监督者”,Qwen3-4B-Base(40亿参数)作为“强学生”。这种8倍的能力差精准模拟了预设场景。

排除闭源模型(如Claude、GPT)的原因很直接:实验需要对模型进行反复的微调、权重修改和深度分析,这要求完全的模型访问权限。使用API不仅成本高昂、无法进行底层操作,更无法支持9个智能体并行进行数百次训练实验。

开源模型提供了必需的灵活性与可控性。而在众多开源选项中选中Qwen,则基于以下几点关键因素:

性能表现: Qwen系列,尤其是Qwen3,在多项开源基准测试中表现卓越,其4B版本在较小参数量下提供了足够强大的能力基础,这对于“强学生”的角色至关重要。

工程成熟度: Qwen拥有完善的文档、活跃的社区和稳定的训练推理工具链。对于一个需要高频次、大规模实验迭代的研究项目,可靠的基础设施是效率的保障。

规模谱系完整: Qwen系列提供了从0.5B到720B的丰富参数选择,使研究者能精准匹配“弱-强”对比需求,且训练成本在可控范围内。

可复现性要求: 这是核心科研伦理。Anthropic公开了代码与数据集。使用Qwen这类开源模型,确保了全球任何研究者都能下载相同权重,完全复现实验,这对推动透明、可信的AI安全研究至关重要。

因此,选择Qwen不仅是对其模型性能与工程质量的认可,更是对开源生态在前沿AI安全研究中基础性价值的肯定。中国领先的开源AI项目,正在成为全球协同解决AI治理与对齐难题的重要基础设施,这无疑有助于汇聚全球智慧,共同应对挑战。

这就是人类能管住AI吗?Anthropic用千问做了个实验的全部内容了,希望以上内容对小伙伴们有所帮助,更多详情可以关注我们的菜鸟游戏和软件相关专区,更多攻略和教程等你发现!

专题合集

精彩合集,奇葩无下限相关文章

大家还在看

-

- 天地劫幽城再临属性克制关系汇总

-

26-04-25

-

- 重返未来1999洛伦兹蝴蝶共鸣怎么摆放

-

26-04-25

-

- 《洛克王国世界》粉耳星兔怎样获得-粉星仔进化为什么有两种形态怎样进化成粉耳星兔

-

26-04-25

-

- 《红色沙漠》1.01.00版本更新内容详解-新增坐骑与操作优化

-

26-04-25

-

- 《奇异人生:重聚》流程成就解锁指南-详细步骤解析

-

26-04-25