每个写过 TCP 的人都踩过这个坑:粘包是什么,怎么彻底解决

时间:26-04-25

从“粘包”到“通透”:彻底解析TCP消息边界问题

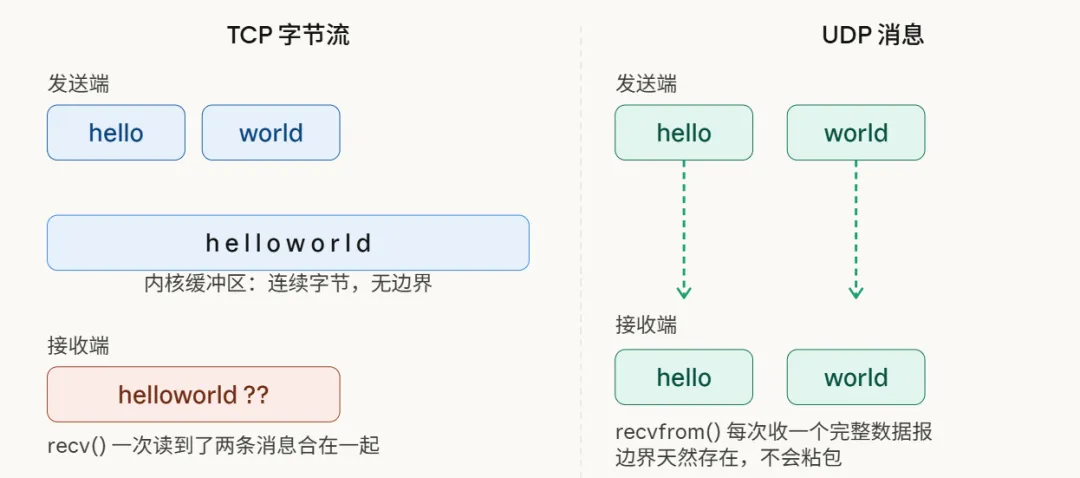

每一位网络编程开发者都会在TCP通信中经历那个标志性时刻:客户端分两次发送“hello”和“world”,服务端却一次读到了“helloworld”;或者更令人费解,只收到了支离破碎的“hel”和“loworld”。

免费影视、动漫、音乐、游戏、小说资源长期稳定更新! 👉 点此立即查看 👈

初次遭遇时,许多人会怀疑TCP是否存在缺陷。事实恰恰相反,这正是TCP设计哲学的直接体现。透彻理解其背后的机制,是构建可靠网络应用的基石。

一、TCP的本质是字节流,而非消息流

这是解开粘包问题的唯一钥匙。

UDP如同邮寄包裹,每个数据报都自带边界。TCP则像铺设了一条连续的水管,发送端注入字节流,接收端获取的是连续的字节序列。至于数据是分次发送还是一次性写入,字节流本身不会留下任何标记。

字节流与消息流的本质区别如下:

因此,粘包与拆包并非故障,而是TCP作为面向字节流协议的核心特征。在TCP的视角里,只有“字节序列”,没有“消息”的概念。界定消息边界,是应用层协议必须独立完成的任务。

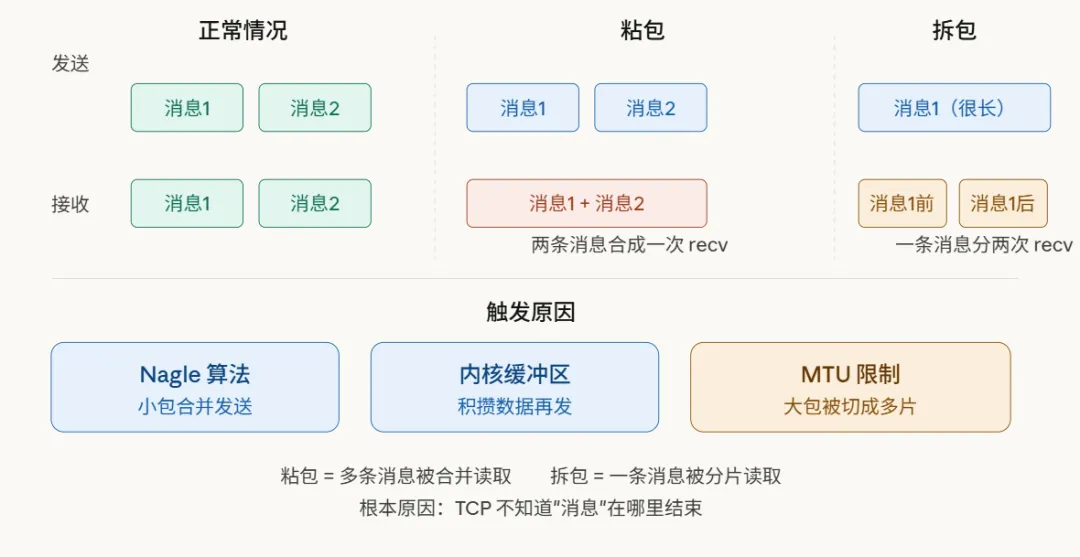

二、粘包与拆包的发生机制

无论是粘包还是拆包,根源都在于发送方与接收方处理数据的节奏未能同步。

两种最常见的触发场景,其背后都有合理的优化逻辑:

首先是Nagle算法。这个TCP默认启用的优化算法,会将多个待发送的小数据包暂存并合并为一个较大的TCP段再发送,旨在减少网络中的小包数量,提升整体传输效率。结果就是,两次send调用发出的数据,可能在网络层被合并,导致对端一次recv调用就全部读取。

其次是MTU限制。网络层以太网帧通常有1500字节的MTU限制。当单条消息长度超过此值时,IP层会自动进行分片传输。接收端就可能先收到第一个分片(消息前半部分),再收到后续分片,从而形成“拆包”现象。

三、四种主流解决方案图解

1. 方案一:固定长度协议

最直接的方案:通信双方预先约定,每条消息都严格使用相同的字节长度。不足则填充,超长则截断或报错。

// 接收端:循环读取直至满N字节

#define MSG_LEN 64

ssize_t recv_fixed(int fd, char *buf) {

size_t received = 0;

while (received < MSG_LEN) {

ssize_t n = recv(fd, buf + received, MSG_LEN - received, 0);

if (n <= 0) return n;

received += n;

}

return MSG_LEN;

}

优点在于实现极其简单。缺点同样突出:当消息长度变化较大时,会造成显著的带宽浪费,灵活性受限。此方案通常适用于消息格式严格固定的场景,例如某些硬件串口协议或标准金融交易报文。

2. 方案二:特殊分隔符

约定一个或一组特殊字符作为消息结束标志。最简单的如换行符`\n`,工程实践中更常见的是`\r\n`(CRLF)。HTTP协议头部字段分隔、Redis的RESP协议,均采用`\r\n`作为分隔符。

// 接收端:按 \r\n 读取一行(工程实现)

ssize_t recv_line(int fd, char *buf, size_t max) {

size_t i = 0;

char c, prev = 0;

while (i < max - 1) {

ssize_t n = recv(fd, &c, 1, 0);

if (n <= 0) return n;

buf[i++] = c;

if (prev == '\r' && c == '\n') break; // 检测到 \r\n,消息结束

prev = c;

}

buf[i] = '\0';

return i;

}

这种方法直观且人类可读性好。但其硬性要求是:消息体内部绝对不能出现分隔符字符,否则会导致解析错误。因此,处理二进制数据时,必须引入转义机制。

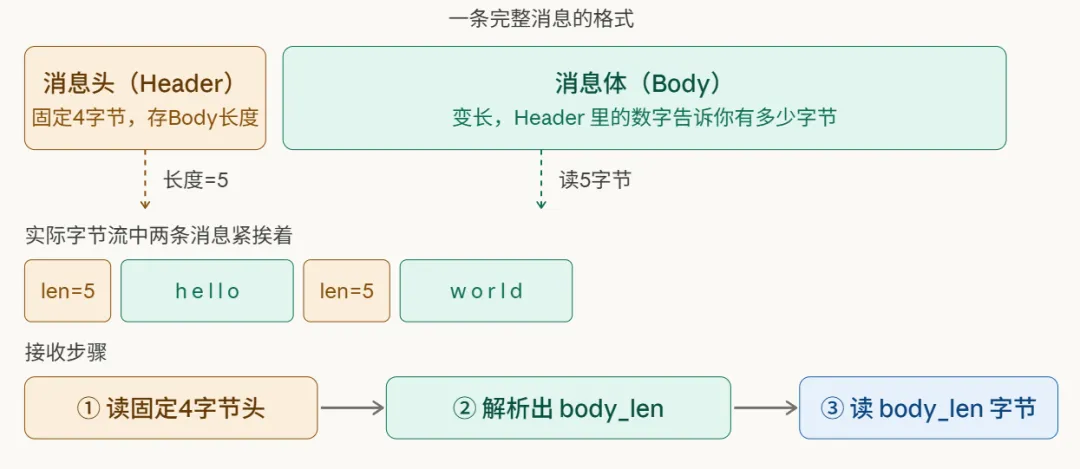

3. 方案三:消息头+消息体(TLV / Length-Value)

这是工程实践中应用最广泛的方案。其核心思路是:在真实的消息体前,附加一个固定长度的消息头,其中最关键的信息是声明后续消息体的长度。接收方先读取固定长度的头部,解析出长度值,再精确读取相应字节数的消息体。

Google的Protobuf、Apache Thrift以及众多自研RPC框架的底层通信,都采用了这一模式。其代码实现逻辑清晰:

// 消息头结构定义

typedef struct {

uint32_t body_len; // 消息体长度(网络字节序)

} MsgHeader;

// 发送端:先发送头部,再发送消息体

int send_msg(int fd, const char *body, uint32_t len) {

MsgHeader hdr = { .body_len = htonl(len) };

send(fd, &hdr, sizeof(hdr), 0);

send(fd, body, len, 0);

return 0;

}

// 接收端:先读取头部,再按长度读取消息体

int recv_msg(int fd, char *buf, uint32_t max_len) {

MsgHeader hdr;

// 首先读取固定4字节的头部

if (recv_exact(fd, &hdr, sizeof(hdr)) <= 0) return -1;

uint32_t body_len = ntohl(hdr.body_len);

if (body_len > max_len) return -1;

// 然后读取指定长度的消息体

return recv_exact(fd, buf, body_len);

}

// 辅助函数:循环读取直至满指定字节数

ssize_t recv_exact(int fd, void *buf, size_t len) {

size_t done = 0;

while (done < len) {

ssize_t n = recv(fd, (char*)buf + done, len - done, 0);

if (n <= 0) return n;

done += n;

}

return done;

}

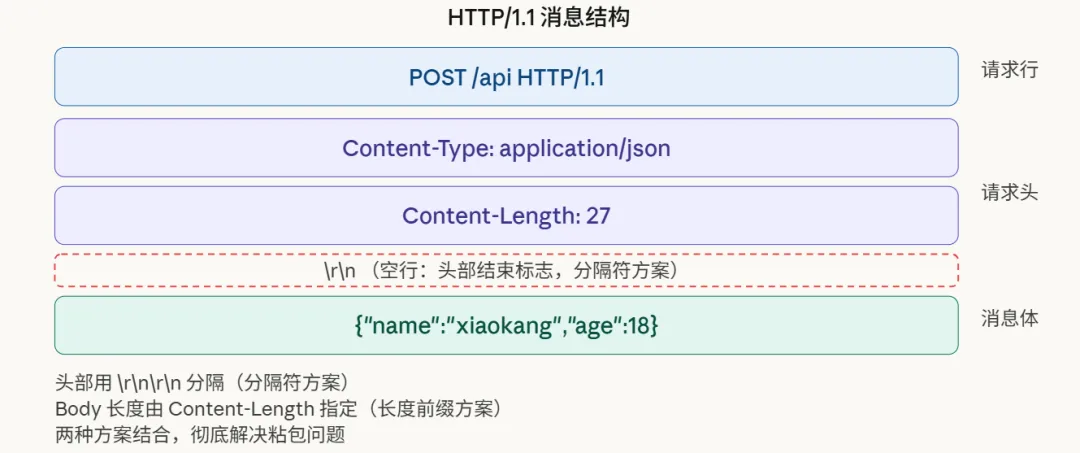

4. 方案四:HTTP协议的实践(组合方案)

HTTP/1.1协议是一个优雅的综合案例,它巧妙结合了分隔符和长度前缀两种方案:

我们来剖析HTTP协议的智慧:

首先,请求头中的每个字段之间,使用`\r\n`分隔(分隔符方案)。

其次,头部与消息体之间,用一个空行`\r\n\r\n`划清界限(同样是分隔符方案)。

最后,消息体的实际长度,由头部`Content-Length`字段明确给出(长度前缀方案)。

这种组合策略,既保证了协议的可读性,又精确地定义了消息边界,是处理混合类型数据的典范。

四、四种方案横向对比与选型

如何选择?一个实用的决策口诀是:处理二进制数据,优先考虑TLV(长度前缀)方案;如果是纯文本协议,分隔符方案简单够用;若遇到像HTTP这样头部为文本、正文可能混合的场景,则借鉴其组合方案。

五、处理粘包问题的常见错误与规避

了解正确方案后,识别常见错误能有效避免踩坑:

// 错误示范:单次recv调用即认为收到完整消息

char buf[1024];

int n = recv(fd, buf, sizeof(buf), 0);

process_message(buf, n); // 风险极高!n可能只是消息的一部分

正确的做法是,依据长度前缀信息,坚持循环读取直至满所需字节:

// 正确做法:配合长度前缀,循环读满指定字节

int recv_exact(int fd, void *buf, size_t need) {

size_t got = 0;

while (got < need) {

ssize_t n = recv(fd, (char*)buf + got, need - got, 0);

if (n <= 0) return -1; // 连接关闭或出错

got += n;

}

return 0;

}

另一个高频错误是忽略网络字节序转换。消息头中的长度字段,必须在发送前使用`htonl`转换为网络字节序(大端),在接收后使用`ntohl`转换回主机字节序。忽略此步骤,在不同字节序架构的机器间通信将导致灾难性错误:

// 发送时:主机字节序 → 网络字节序(大端)

uint32_t net_len = htonl(body_len);

// 接收时:网络字节序 → 主机字节序

uint32_t body_len = ntohl(net_len);

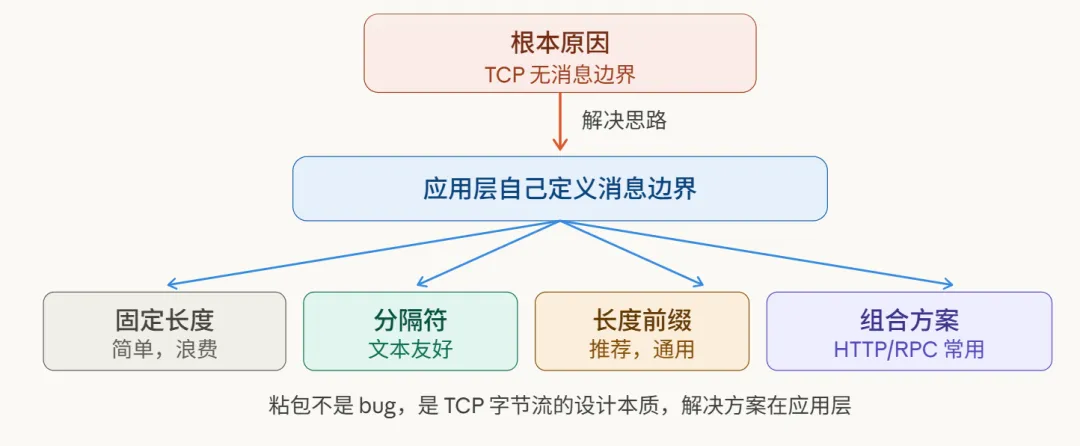

六、核心总结:粘包问题的本质与解决路径

七、关键结论

归根结底,TCP粘包问题可以归结为两个核心认知:

第一,理解“根源”:因为TCP是面向字节流的传输层协议,它只保证字节的可靠、有序交付,而将消息语义边界的界定职责,完全交由应用层处理。

第二,掌握“方法”:应用层需自行定义消息边界。主流方案无非四种——固定长度、特殊分隔符、长度前缀、或如HTTP般的组合方案。根据实际业务场景与数据特性择一即可。

对于绝大多数工程应用,长度前缀(TLV)方案因其通用性强、效率高且不受消息内容限制,成为首选推荐。记住,在设计任何TCP通信协议时,首要明确的决策就是:“我使用哪种方案来界定消息边界?”想清楚这个根本问题,你便真正跨越了粘包这个技术鸿沟。

这就是每个写过 TCP 的人都踩过这个坑:粘包是什么,怎么彻底解决的全部内容了,希望以上内容对小伙伴们有所帮助,更多详情可以关注我们的菜鸟游戏和软件相关专区,更多攻略和教程等你发现!

专题合集

精彩合集,奇葩无下限相关文章

- 冲上热搜!5月仅上班19天

- 黄仁勋亲演“塑料兄弟情”:1000亿缩水到200亿!同床异梦也得紧紧相拥

- iPhone17e+MacBook Neo领衔,苹果春季全品类新品连发!

- 大疆起诉美国FCC:指控禁令缺乏证据、违反正当程序

- 联想 2026 款来酷斗战者“战 7000”笔记本首销 i7-13645HX + 16G + 512G + RTX5060 售 7699 元

- 苹果紧急提醒iPhone用户更新系统:旧版iOS会被攻击

- 大疆上汽携手发力!2023款KiWi EV量产,智能驾驶新体验即将开启

- 宁波神秘老板买下三家“富力系”酒店

- 谷歌推进芯片供应商多元化,与Marvell展开TPU定制与推理芯片开发谈判

- 《全球人工智能治理科技社团倡议》发布

大家还在看

-

- 未来之役国际服上线时间未来之役国际服正式开服日期与全球发布详情

-

26-04-25

-

- 真实人生:模拟生活好玩吗 真实人生:模拟生活玩法简介

-

26-04-25

-

- 《吸血鬼爬行者》黄牌流轮椅套路推荐

-

26-04-25

-

- 忘却前夜德克斯特是谁忘却前夜德克斯特角色背景与剧情定位解析

-

26-04-25

-

- 望月月灵获取方法全攻略望月月灵招募途径与培养技巧

-

26-04-25