K8S 集群故障排查实录:一场追根溯源的技术侦探之旅

时间:26-04-25

深夜Pod频繁重启:一次由底层存储I/O抖动引发的Kubernetes故障排查

近期,我们监控到生产集群中多个Pod在凌晨时段出现规律性重启。这种非预期的Pod生命周期波动不仅干扰了平台自身的稳定性,更对业务SLA和终端用户体验构成了直接威胁。尤其值得注意的是,故障高发期集中在业务流量低谷的深夜,这为问题排查增加了复杂性。我们立即组织了一次从控制平面到底层基础设施的深度根因分析。

免费影视、动漫、音乐、游戏、小说资源长期稳定更新! 👉 点此立即查看 👈

本次排查遵循了标准的故障诊断路径:从集群基础配置与时间同步状态入手,逐步深入到调度器、控制器管理器等核心组件的日志分析,最终聚焦于集群状态存储核心——etcd的健康度。我们成功定位了影响Pod稳定性的关键瓶颈,并制定了一套涵盖架构优化与运维流程的解决方案。以下是完整的故障复盘与技术细节。

一、问题背景

故障现象表现为:多个部署于不同节点上的Pod,在每日23:00至次日08:00期间,出现非业务触发的频繁重启。监控系统捕捉到Pod状态在Running、Terminating、ContainerCreating之间循环。初步判断,这并非由应用层内存溢出或就绪探针失败导致,而是与控制平面的状态管理异常相关。我们需要找到触发Pod被异常驱逐或调度的根本原因。

二、检查基础配置

任何稳定性排查的第一步都是验证基础设施的基线健康度。我们首先排除了因基础配置错误或环境不一致导致的系统性偏差。重点检查了可能引发集群协调问题的两大基础因素:时间同步与配置一致性。

2.1. 时间同步检查

在分布式系统中,时间漂移是导致锁失效、日志乱序、调度冲突的经典诱因。我们对集群所有节点(Master及Worker)的NTP服务状态进行了全面核查:

• 同步配置:所有节点均配置为指向同一内部时间源 ntp.iflytek.com,配置策略统一。

• 同步状态:ntpq -p 命令显示状态为 Reach 377,表明时钟源可达性极佳,同步链路健康。

• 时间偏移:各节点与时间源之间的偏移量(offset)绝对值在 -18~+89微秒 之间,抖动(jitter)标准差为 12~69微秒。该指标远优于Kubernetes对时间同步的要求(通常要求误差在100毫秒以内)。

• 闰秒状态:所有节点均未处于闰秒调整状态。

结论:集群时间同步机制工作正常,可排除因时钟差异导致的etcd租约失效或领导者选举异常。

2.2. 配置一致性检查

接着,我们核对了控制平面与工作节点关键服务的配置文件,确保没有因配置差异引发的非预期行为:

• 节点间配置文件:对比了所有Master节点上 kube-apiserver, kube-controller-manager, kube-scheduler 以及所有节点上 kubelet, kube-proxy 的关键配置参数(如证书路径、API Server端点、网络插件CIDR等),确认完全一致。

• 网络与防火墙:检查了节点间通信所需端口(如6443, 2379-2380, 10250等)的连通性,并确认系统防火墙(iptables/firewalld)或安全组规则未在故障时段发生变更或阻断。

基础层排查未发现异常。这指引我们将调查方向转向动态运行的控制平面组件。

三、分析调度器和控制器

3.1. 调度器分析

kube-scheduler 负责为Pod选择最佳运行节点。其稳定性直接影响Pod的调度与重新调度。检查其日志时,发现了密集的错误信息:

error retrieving resource lock kube-system/kube-scheduler: Get "https://10.0.xxx.xxx:6443/apis/coordination.k8s.io/v1/namespaces/kube-system/leases/kube-scheduler?timeout=5s": net/http: request canceled (Client.Timeout exceeded while awaiting headers)

error retrieving resource lock kube-system/kube-scheduler: etcdserver: leader changed这些错误揭示了两个关键问题:1)调度器在尝试更新或获取其领导者锁时,向API Server发起的HTTP请求超时(5秒阈值被触发);2)请求失败的根本原因与后端etcd集群的“领导者切换”事件直接相关。这表明调度器因无法及时确认其领导者身份,可能导致调度决策暂时中断或失效。

3.2 控制器管理器分析

同样,kube-controller-manager 的日志中也出现了几乎相同的错误模式:

E1211 21:23:26.673254 1 leaderelection.go:347] error retrieving resource lock kube-system/kube-controller-manager: Get “https://10.0.xxx.xxx:6443/apis/coordination.k8s.io/v1/namespaces/kube-system/leases/kube-controller-manager?timeout=5s”: net/http: request canceled (Client.Timeout exceeded while awaiting headers)控制器管理器负责维护副本集、端点、服务账户等资源的状态。其领导者锁获取失败,意味着节点控制器、副本集控制器等可能无法正常工作,无法及时纠正Pod的实际状态与期望状态之间的偏差。这解释了为何部分Pod异常终止后,副本集控制器未能立即创建新的替代Pod。

调度器与控制器的日志共同将问题指向了同一方向:它们与API Server之间的通信超时,且根因与etcd的不稳定直接相关。调查焦点转向etcd集群。

四、排查etcd健康状况

etcd作为Kubernetes集群唯一的持久化状态存储,其性能与稳定性是整个控制平面的基石。我们深入分析了etcd节点的日志与监控指标,发现了明确的性能瓶颈证据:

心跳超时与领导者频繁切换:etcd日志中反复出现如下警告:

leader failed to send out heartbeat on time; took too long, leader is overloaded likely from slow disk这条信息是诊断的关键:etcd集群领导者因无法在规定时间内(默认100ms)完成心跳广播,触发了新一轮的领导者选举。日志明确将原因归咎于“慢磁盘”。频繁的领导者切换会导致集群短时间内不可写,进而引发前述调度器和控制器获取租约超时。

请求响应严重超时:此外,大量普通读写操作的延迟也远超预期:

apply request took too long, took 102.98ms, expected 100ms

range response took 120ms, expected lessetcd对读写延迟有严格的内部预期(通常P99延迟要求在10ms以内)。持续出现超过100ms的请求响应时间,证实存储I/O性能已成为严重瓶颈。在数据迁移或负载不均期间,这种延迟会被放大,直接导致API Server请求堆积、超时,最终反映为Pod状态更新失败和重启。

五、根因分析

综合以上日志证据,问题链条已基本清晰。我们通过横向关联基础设施运维事件,最终锁定了根本原因。

5.1. 初步排查:防火墙和网络配置无变化

首先排除网络层突发问题:

• 防火墙与网络:核查确认故障时段内,无网络设备变更、无安全策略调整、无DDOS攻击迹象。节点间网络延迟与丢包率在正常基线范围内。

• 定时任务与硬件:排查了集群内所有节点的crontab任务及基础设施层的定时维护窗口(如备份、扫描),确认无重合的高CPU/高IO任务。硬件监控也未报告磁盘故障或内存纠错事件。

此步骤排除了外部干扰,让我们更专注于集群内部组件与底层基础设施的关联性。

5.2. 深夜低峰期的请求超时问题

通过对监控数据的趋势分析,我们发现一个矛盾现象:在业务请求量最低的深夜(23:00-08:00),Kubernetes API Server的请求延迟和etcd的磁盘写入延迟却出现周期性峰值。

• 请求超时加剧:API Server的apiserver_request_duration_seconds指标显示,针对leases资源的PUT/PATCH请求P99延迟从平时的几十毫秒飙升至数秒,导致大量5秒超时。

• 存储I/O延迟飙升:etcd所在虚拟机的磁盘await(IO等待时间)和util(利用率)指标与API请求延迟曲线高度吻合。这表明底层存储的性能抖动是上游请求超时的直接原因。

业务“低峰期”成为控制平面“故障期”,这强烈暗示有后台基础设施操作正在此窗口进行。

5.3. 底层存储扩容和数据均衡导致的不稳定

与存储运维团队联调后,根因得以确认:底层分布式存储集群的夜间维护操作。

• 时间与范围的高度吻合:存储团队为 xx.xx.xx.x1 网段的存储池执行了在线扩容与数据重新均衡操作,操作时间窗口与Pod重启高峰期完全重叠。我们的Kubernetes集群Master节点正部署于此网段。

• 存储性能瓶颈的传导:数据跨节点迁移再平衡产生了巨大的、持续的存储I/O压力。这直接导致运行在该存储池上的etcd虚拟机磁盘延迟(特别是写入延迟)从毫秒级跃升至数百毫秒甚至秒级。高延迟触发了etcd心跳超时,进而引发频繁的领导者切换(etcdserver: leader changed)。

• 资源竞争激化:数据均衡过程在存储节点间产生了不均衡的负载,加剧了资源争用。etcd的读写请求排队时间变长,使得控制平面组件通过API Server操作资源锁(Lease)的请求大量超时,最终导致Pod被误判为需要重启。

5.4. 存储扩容与Kubernetes控制平面的关系

此次事件清晰地展示了底层I/O抖动对云原生控制平面的级联影响:

• 网络延迟与请求超时:虚拟化层将存储I/O延迟转化为虚拟机内磁盘的高延迟。etcd作为强依赖持久化存储的共识组件,对此极为敏感。其性能下降直接表现为API Server请求超时,进而导致所有依赖领导者选举的控制器失活。

• 低峰期≠低负载期:基础设施运维通常选择业务低峰期进行操作,但这意味着存储系统自身处于高负载状态。这种“后台高压”模式与虚拟机对共享存储资源的竞争叠加,使得控制平面组件对延迟的敏感性被急剧放大。

六、解决方案

基于根因分析,我们制定了短期缓解与长期加固相结合的解决方案,旨在提升集群对底层波动的韧性。

6.1. 将etcd节点迁移至物理机

• 背景:虚拟化层和共享存储池的I/O隔离性不足,是导致etcd受干扰的根本架构风险。

• 方案:将etcd集群从虚拟机迁移至专属的物理服务器,并配置本地NVMe SSD。此举消除了虚拟化开销和共享存储池中其他租户“噪声邻居”的影响,为etcd提供稳定、可预测的低延迟存储性能。

6.2. 优化存储扩容和数据均衡的过程

• 分阶段扩容:与存储团队建立协同流程。将大规模存储扩容拆解为多个小批次执行,每批次完成后,观察Kubernetes控制平面监控指标(如etcd写入延迟、API Server请求成功率),确认稳定后再进行下一批次。

• 控制均衡速度:调整存储集群的数据均衡策略,限制后台迁移任务的最大带宽和IOPS,避免在短时间内耗尽存储资源。同时,将均衡任务更平滑地分散到多个维护窗口,避免集中操作。

6.3. 使用高性能存储

• 方案:对于必须部署在虚拟化环境的情况,为etcd数据目录配置高性能存储卷(如基于SSD的高性能云盘或本地临时SSD盘)。确保存储卷的IOPS和吞吐量预留满足etcd在高负载下的性能要求,并启用I/O优先级隔离。

通过实施以上方案,我们不仅解决了此次特定的Pod重启问题,更系统性地加固了Kubernetes控制平面面对底层基础设施维护时的稳定性。这一案例再次强调,保障生产级Kubernetes的SLA,需要具备从应用、编排层到IaaS层的全栈可观测性与协同运维能力。

这就是K8S 集群故障排查实录:一场追根溯源的技术侦探之旅的全部内容了,希望以上内容对小伙伴们有所帮助,更多详情可以关注我们的菜鸟游戏和软件相关专区,更多攻略和教程等你发现!

专题合集

精彩合集,奇葩无下限相关文章

- 今年火流星激增,“天空到处是乱飞的物体”!科学家激辩:应该不是外星人干的

- Meta盘前涨超1%!10亿美元数据中心项目启动,千岗就位

- “口袋哈苏”OPPO Find X9 Ultra亮相,第五代骁龙8至尊版赋能专业移动影像创作

- 程序员将被AI取代?梅宏院士:理性看待当前的热潮和炒作

- 蚂蚁百灵Ling-2.6-flash模型发布 定价每百万token0.1美元

- 当机器人伸出手……汉诺威工博会人机互动精彩瞬间

- 北京移动用户可享算力套餐

- 马斯克打算花600亿美元收购“00后”创办的Cursor,加码AI编程

- 42项高价值配置全系标配 别克至境E7正式上市并开启交付

- 坚守开源,深耕中国,奥芯明接待临港代表团

大家还在看

-

- 洛克王国世界人鱼的礼物称号获取攻略

-

26-04-26

-

- 洛克王国世界轻松打过所有人称号获取攻略

-

26-04-26

-

- 虚实万象Demo通关结算画面有什么彩蛋-虚实万象Demo通关结算画面彩蛋是什么

-

26-04-26

-

- 《小小魔兽》12.0.5 版本中 L'ura 在所有难度下均出现 Bug

-

26-04-26

-

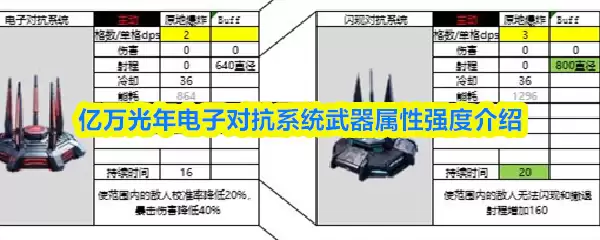

- 亿万光年电子对抗系统武器属性强度介绍

-

26-04-26