Counterpoint 预测:AI ASIC 对 HBM 内存需求四年猛增 35 倍

时间:26-04-26

AI ASIC驱动HBM需求激增:技术路线与市场格局深度解析

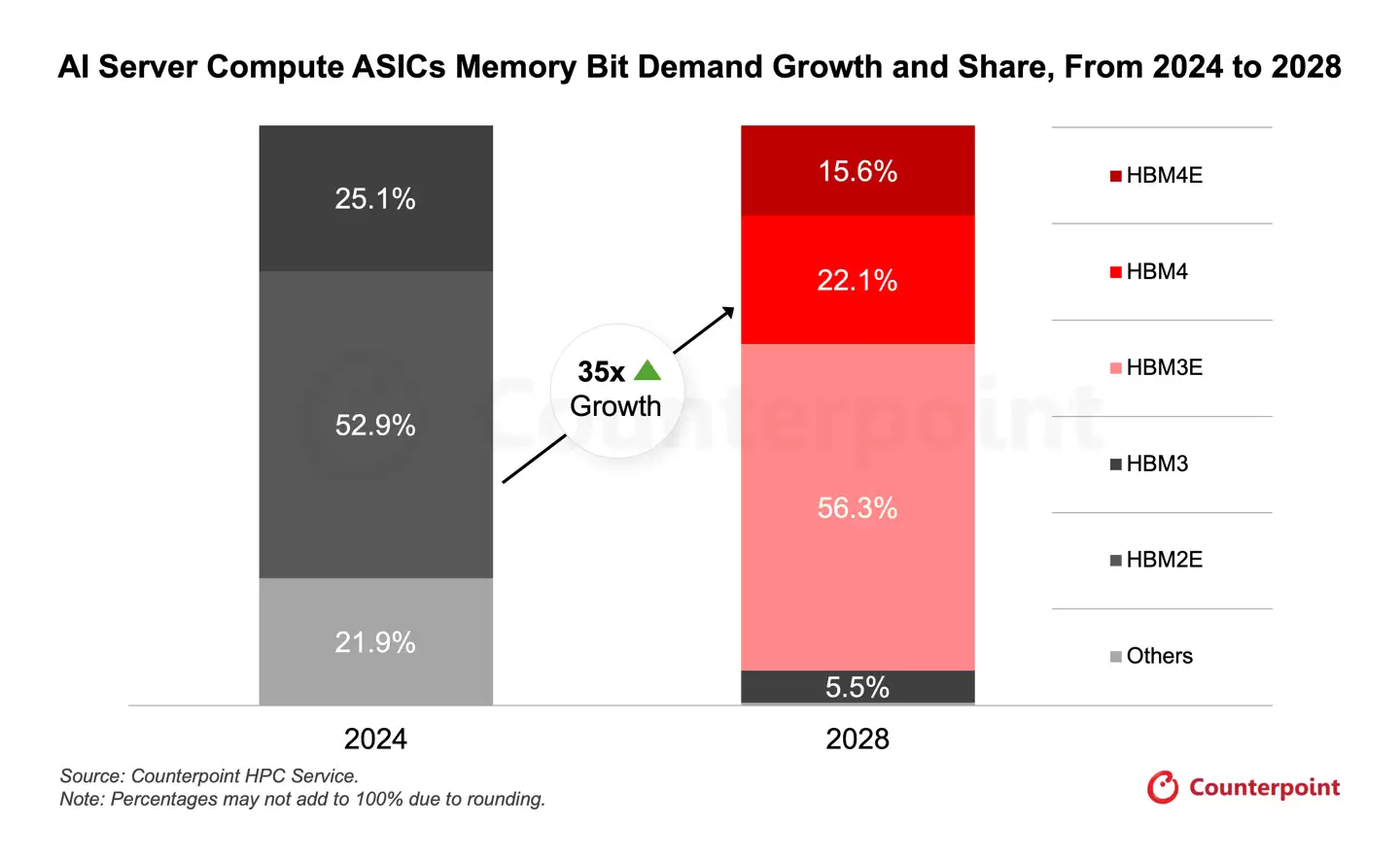

Counterpoint Research于3月13日发布的最新预测指出,AI服务器专用计算芯片(ASIC)对高带宽内存(HBM)的需求正呈现指数级增长。报告预计,到2028年,该细分市场的HBM需求量将达到2024年水平的35倍。与此同时,单颗AI ASIC芯片的平均HBM堆叠容量也将提升近5倍,这直接反映了模型复杂度与算力需求的飙升。

免费影视、动漫、音乐、游戏、小说资源长期稳定更新! 👉 点此立即查看 👈

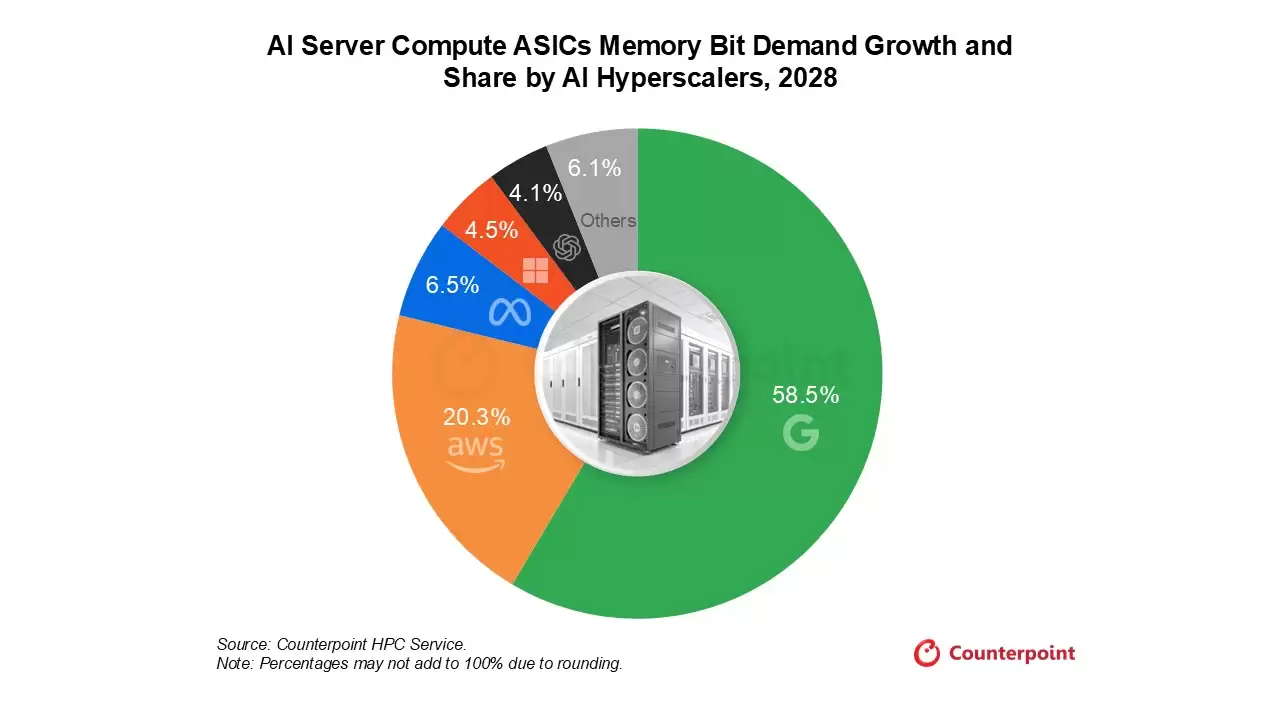

从需求端驱动因素分析,谷歌及其TPU系列芯片构成了当前市场的核心支柱。其激进的芯片迭代策略与大规模数据中心部署,是HBM需求预测上调的关键。数据显示,谷歌一家就占据了AI ASIC领域58.5%的HBM采购份额,亚马逊以20.3%的份额紧随其后,两家科技巨头共同定义了市场需求的基本盘。

在技术迭代路径上,HBM3E因其成熟的生态与性价比,在中期内仍将是主流选择,预计在AI ASIC中占比56.3%。而面向下一代的HBM4及HBM4E标准,虽逐步向定制化、更高带宽方向演进,预计到2028年将共同占据37.7%的市场份额,标志着内存架构正从通用型向专用型过渡。

供应链竞争态势正在重塑。三星电子凭借其在封装技术与产能上的加速投资,有望从当前主导者SK海力士手中夺回部分市场份额。在更上游的先进封装环节,台积电的CoWoS技术仍主导AI ASIC的集成方案,但英特尔代工服务的EMIB-T封装技术也正获得更多设计公司的评估,为供应链多元化提供了潜在选项。

这就是Counterpoint 预测:AI ASIC 对 HBM 内存需求四年猛增 35 倍的全部内容了,希望以上内容对小伙伴们有所帮助,更多详情可以关注我们的菜鸟游戏和软件相关专区,更多攻略和教程等你发现!

专题合集

精彩合集,奇葩无下限相关文章

- Modos发布13.3英寸3.2K墨水屏显示器支持手写笔与60Hz刷新率

- 海盗船推出 10 可编程键鼠标 IRONCLAW WIRELESS SE:26k DPI 130g

- 海信推出 Vidda 小钢炮 S Mini 电视:180Hz Mini LED + AG 抗光层 可选 55-75 英寸 1999 元起

- LG UltraGear EVO GX9/GM9 电竞显示器海外发布 搭载 39 英寸 5K2K 曲面 OLED/27 英寸 5K Mini LED

- 摩托罗拉海外发布 2026 款 moto g stylus 手机、moto pad 平板 主打创作与生产力

- 苹果海外官网上架 Herschel Cloudform iPhone 斜挎包:可放置 AirTag 59.95 美元

- Modos Flow 便携屏预热:配 13.3 英寸黑白 / 彩色 60Hz 墨水屏面板 搭开源固件

- 传闻苹果折叠手机将命名为 iPhone Ultra国内厂商计划跟进同类产品

- HMD Global 2026 年夏季新机规格曝光:Crest 2 / Pro 中低端机、Key 2 入门手机

- 苹果折叠 iPhone Fold 新渲染图泄露后摄凸起减少外观更精致

大家还在看

-

- 王者荣耀世界废物利用技巧王者荣耀高效资源循环玩法

-

26-04-26

-

- 《胜利女神:妮姬》3.5周年庆典活动介绍

-

26-04-26

-

- 我的世界魔法艺术3巧工魔艺合成表大全

-

26-04-26

-

- 龙魂旅人波塞冬如何搭配阵容-龙魂旅人波塞冬阵容搭配方法

-

26-04-26

-

- 怒火一刀法师如何进行强散搭配

-

26-04-26