英伟达完成DeepSeek-V4全系模型适配,支持百万级

时间:26-04-26

英伟达完成DeepSeek-V4全系模型适配,支持百万级上下文

四月二十五日,英伟达正式宣布完成对DeepSeek-V4人工智能模型的适配支持。开发者可通过NVIDIA NIM微服务直接下载并部署该模型,也可基于SGLang或vLLM等主流推理框架开展灵活定制化应用。

免费影视、动漫、音乐、游戏、小说资源长期稳定更新! 👉 点此立即查看 👈

那么,这次适配的模型具体有何不同?简单来说,DeepSeek-V4提供了两个针对性极强的版本。Pro版本具备1.6万亿总参数与490亿激活参数,专为高复杂度推理任务设计;而Flash版本则配置2840亿总参数与130亿激活参数,聚焦于低延迟、高吞吐的实时应用场景。关键在于,两款模型均支持百万级Token上下文长度及最高达38.4万Token的单次输出能力。这意味着,无论是长文本理解,还是大规模文档解析这类关键任务,现在都有了更强大的开源工具支撑——没错,它们都以MIT许可证形式开源了。

当然,性能参数是一回事,实际部署体验又是另一回事。好消息是,目前的测试表明,借助vLLM提供的即用型优化方案,开发者已经可以在Blackwell架构的B300硬件平台上实现快速启动与高效运行。这无疑大大降低了应用门槛。话说回来,这还不是终点。后续随着Dynamo编译器、NVFP4稀疏精度支持以及CUDA底层内核的持续迭代升级,模型的整体推理性能还有望得到进一步增强。对于关注效率的团队来说,这波升级的潜力值得持续关注。

这就是英伟达完成DeepSeek-V4全系模型适配,支持百万级的全部内容了,希望以上内容对小伙伴们有所帮助,更多详情可以关注我们的菜鸟游戏和软件相关专区,更多攻略和教程等你发现!

专题合集

精彩合集,奇葩无下限相关文章

大家还在看

-

- 符文英雄竞技场第一名教你如何打造最强战力

-

26-04-26

-

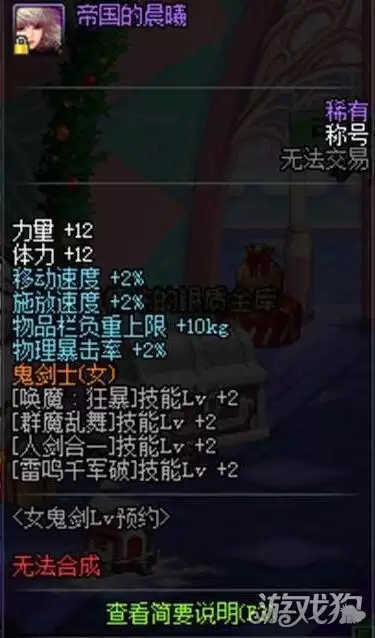

- DNF据说这个称号很贵 坐等称号封装系统

-

26-04-26

-

- RNG战胜EDG成功复活 网友表示圣枪哥是最大罪人

-

26-04-26

-

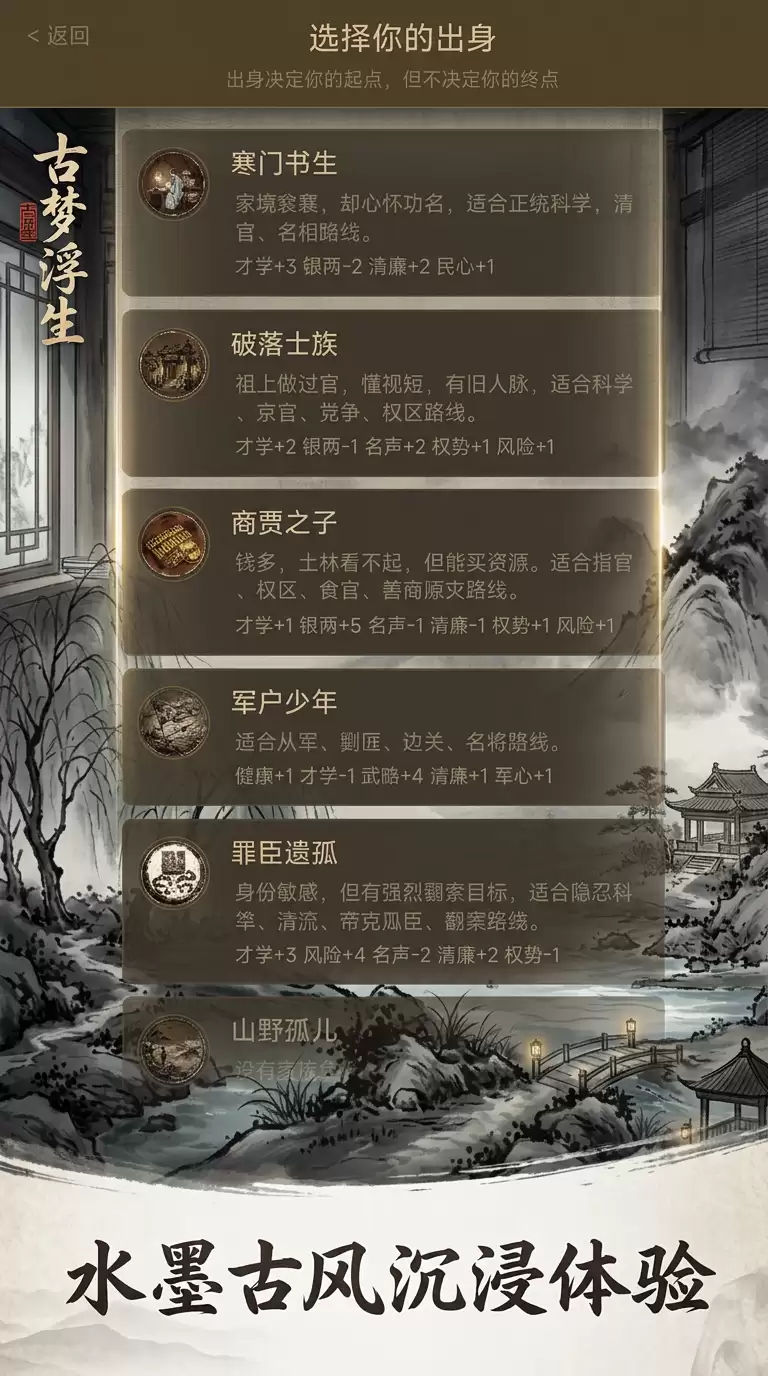

- 古梦浮生好玩吗 古梦浮生玩法简介

-

26-04-26

-

- 《聪明开局吧》第53关捌怎么过-第53关捌找出9个常用字图文攻略

-

26-04-26