太狠了!OpenClaw之父一夜屠光5000 Issue,GitHub服务器先跪了

时间:26-04-26

AI产生的垃圾,就该AI自己来扫

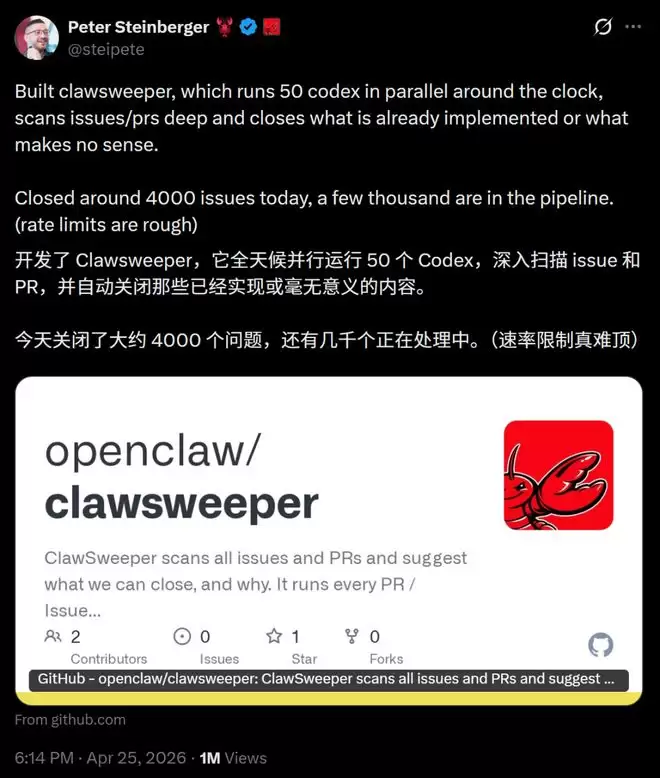

开源社区的维护者们,最近可能都听说了这件有点“疯狂”的事。OpenClaw的创始人、OpenAI工程师Peter Steinberger,用了短短两天时间,搭建了一个名为ClawSweeper的工具。然后,他启动了50个Codex实例,让它们7×24小时不间断地并行扫描。

免费影视、动漫、音乐、游戏、小说资源长期稳定更新! 👉 点此立即查看 👈

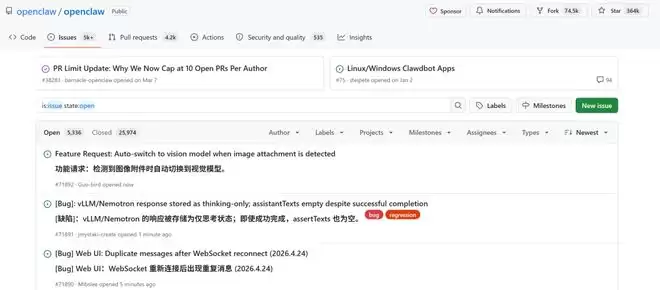

结果呢?一天之内,他那个拥有36万Star的开源巨兽仓库——openclaw/openclaw——里,超过5000个无效Issue被直接关闭,还有数千个在管道里排队等待“处决”。

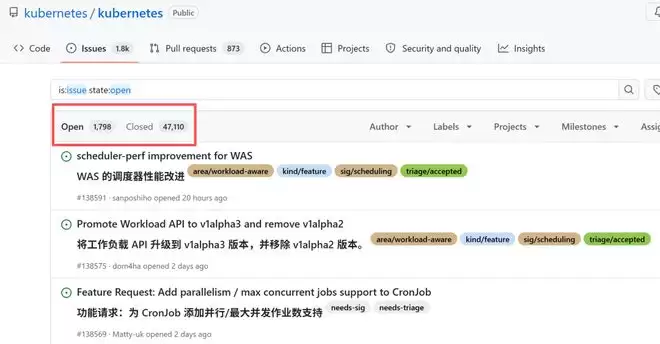

这个数字意味着什么?要知道,这个级别的开源项目,积压的Issue和PRs(Pull Requests)往往数以万计。

里面充斥着重复报告、早已过时的问题、在main分支已经修复却无人关闭的旧账,以及大量AI灌水产生的无意义内容。它们堆在一起,就像一个庞大的“数字坟场”,任何人类维护者看一眼,恐怕都会感到头皮发麻。

如果依靠人工来处理这些积压,清完恐怕需要整整一年。而Steinberger用AI,一天就清理了一半。

更让人惊讶的是成本。有人问他这一轮大规模扫描花了多少钱,他的回答轻描淡写:不到1000美元。算下来,对5000多个Issue进行深度审查并关闭,平均一个的成本还不到两毛钱。

而让整套系统速度慢下来的唯一原因,并非模型不够聪明,而是GitHub的API速率限制——服务器的响应速度,竟然追不上AI的处理速度。

“冷面判官”的处决逻辑

可别误会,ClawSweeper绝非一个“无脑杀手”。恰恰相反,其设计哲学可以用四个字概括:极致保守。

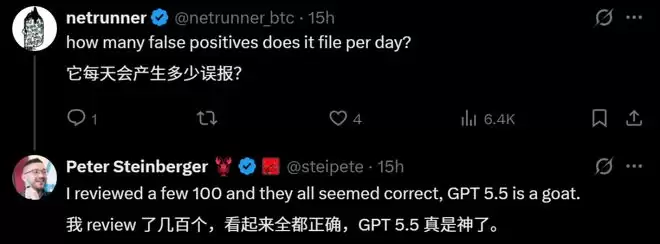

这套系统的核心运行在gpt-5.5上,采用了高推理强度(high reasoning effort)和快速服务层(fast service tier)的配置;每个待审条目的Codex审查超时设定为10分钟。

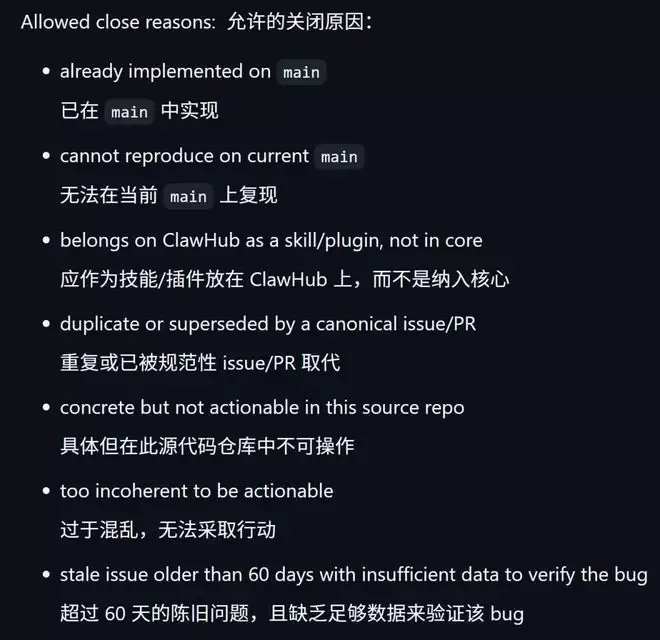

它只在以下七种明确的情况下,才会决定关闭一个Issue:已经在main分支实现、当前main分支无法复现、应归属于ClawHub的skill/plugin而非核心库、重复或已被更权威条目取代、在该仓库内描述具体但不可执行、内容过于混乱无法执行、以及超过60天且缺少足够数据验证的bug。

除此之外,一律保持开放状态。

这还没完,系统还设置了另一层保险:ClawSweeper不会去触碰维护者自己发布的条目。它会先查看GitHub的身份标记,只要是项目所有者、成员或协作者发布的issue,就直接跳过,绝不自动关闭。

设计上更为谨慎的一点是,Codex在审查时根本没有写入权限。它只能在只读环境中查看代码、分析上下文、做出判断,然后将结果整理成一份结构化的Markdown报告,存入items/<编号>.md文件。

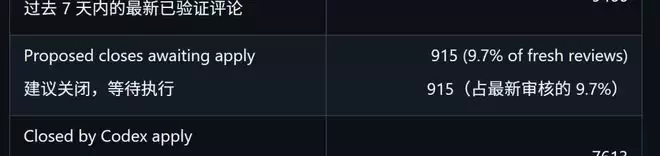

真正的评论和关闭动作,并不会在审查阶段直接发生。系统要等到进入apply_existing=true模式后,重新抓取最新的上下文,并再次计算快照哈希,确认该issue在提案生成后没有发生任何变化,才会真正动手执行。

Steinberger本人人工抽查了数百条关闭记录,结果是:准确率几乎达到百分之百。

README就是仪表盘

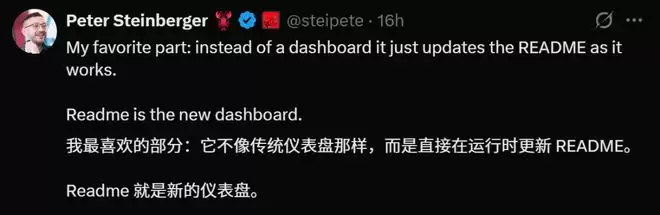

ClawSweeper最让人拍案叫绝的设计,或许不是它的关闭逻辑,而是它的“监控系统”。

按照传统做法会怎么做?搭建Grafana,配置Prometheus,弄一套精美的后台仪表盘。但Steinberger说:没必要。README就是我的仪表盘。

ClawSweeper在运行过程中,会实时更新仓库的README.md文件。当前有多少开放的issue、本轮审查了多少条、提议关闭多少条、已执行关闭多少条、GitHub限流到了哪一步——所有这些信息,都以清晰的表格形式明明白白地写在README里。

任何人打开GitHub仓库主页,就能一眼看到这位“AI判官”此刻正在干什么。这让整个清理过程变得完全透明、完全公开、完全可审计。任何对“AI擅自关闭我的Issue”心存疑虑的贡献者,都可以直接点进对应的items/71514.md文件,查看Codex给出的完整审查理由。

当AI开始“自愈”

你可能会想,这不就是个高级点的自动化脚本吗?但把格局放大一点看,意义就不同了。

GitHub上有超过4亿个仓库,其中活跃的大型开源项目,几乎都面临着同一个噩梦——Issue坟场。Kubernetes有4万多个已关闭的Issue,Linux内核邮件列表的积压更是天文数字。

维护者的时间是世界上最稀缺的资源之一,而大量时间被浪费在“判断这个Issue到底还需不需要存在”这种机械劳动上。ClawSweeper的意义在于,它第一次在一个真实的、百万Star级别的仓库里证明了:利用AI智能体进行大规模的、保守的、可审计的Issue分诊,是完全可行的。

5000多个Issue的深度审查加关闭,总花费不到1000美元,单个成本约0.2美元。而且它7×24小时不休息、不抱怨、不带情绪。唯一能让它慢下来的,只有GitHub API的速率限制。

从某种意义上说,这标志着开源项目从“人工维护”迈向“自愈”的起点。未来,每一个大型开源仓库里,可能都会运行着一个类似ClawSweeper的机器人,持续监控Issue质量,自动过滤噪音,从而让人类维护者只需要关注那些真正需要人类智慧判断的、高价值的问题。

Rate Limit是最后的防线

有个细节特别有意思。在ClawSweeper的仪表盘(README)上,赫然写着:“State: Apply throttled”——它被GitHub的API限流给卡住了。

50个Codex并行扫描的速度太快了,快到GitHub的服务器开始说“你慢点,我跟不上了”。在传统软件开发中,速率限制是为了防止恶意攻击。但现在,它成了制约AI工作效率的唯一瓶颈。

不是模型不够聪明,也不是判断不够准确,纯粹是基础设施的管道,追不上AI处理的速度。这大概就是当下最真实的写照:管道,成了AI狂奔路上最后的减速带。

参考资料:

https://x.com/steipete/status/2047982647264059734

https://github.com/openclaw/clawsweeper

这就是太狠了!OpenClaw之父一夜屠光5000 Issue,GitHub服务器先跪了的全部内容了,希望以上内容对小伙伴们有所帮助,更多详情可以关注我们的菜鸟游戏和软件相关专区,更多攻略和教程等你发现!

专题合集

精彩合集,奇葩无下限相关文章

大家还在看

-

- 《功夫熊猫:神龙大侠》阵兽系统核心玩法介绍

-

26-04-26

-

- 红色沙漠传说之狼任务攻略

-

26-04-26

-

- 《绝地求生》aespa回归 期待与你再次相遇!

-

26-04-26

-

- 逆战未来何时上线

-

26-04-26

-

- 使命召唤:黑色行动7梅南德斯BOSS怎么打

-

26-04-26