内存通胀“终结者”?谷歌公开最新极限压缩算法

时间:26-04-26

解决大模型算力瓶颈,核心在于精准定位存储与计算开销的源头——是训练过程,还是推理环节?稀疏化、量化、模型压缩与知识蒸馏等技术路径,正是针对不同痛点展开的优化。行业内的实践也因技术栈和场景需求而异,形成了多元化的解决方案。

免费影视、动漫、音乐、游戏、小说资源长期稳定更新! 👉 点此立即查看 👈

以长上下文处理为例,算法团队近年的主流方案是围绕键值缓存进行架构创新,采用分离式设计,将预填充与解码部署于不同服务器。然而,这种方案在应对高并发、大批次推理任务时,系统内存带宽压力陡增。这揭示了一个关键事实:推理阶段的瓶颈往往不在计算速度,而在于数据从内存到计算单元的传输效率。

谷歌最新发布的TurboQuant算法,正是直击这一核心痛点:大模型运行时巨大的内存消耗。其设计目标清晰——在保持模型输出质量近乎无损的前提下,大幅降低推理工作内存占用,并提升响应速度。

这项技术的应用前景广泛。对于模型推理,处理百万级Token长上下文的成本将显著降低;向量数据库有望实现更高效的实时索引与亚毫秒级查询;在边缘AI领域,手机与嵌入式设备运行复杂长上下文推理将成为可能。其技术原理同样可扩展至多模态场景,用于向量数据的有效压缩。

市场的反应最为直接。技术发布当日,美光科技、闪迪等存储厂商股价应声下跌。近年来,受全球数据中心建设驱动,内存与固态硬盘需求旺盛,价格高企。市场的波动反映出一种预期:TurboQuant这类技术的普及,可能重塑AI推理服务器对内存容量的需求,进而改变硬件成本结构。

理解TurboQuant,需从大模型生成机制入手。模型并非一次性输出完整文本,而是以自回归方式逐词生成。此过程依赖一个“临时记事本”——键值缓存,用以存储历史信息,避免重复计算。对话或文本越长,KV Cache体积越庞大,对高性能内存的占用也越惊人,最终成为拖慢推理速度、推高成本的主要瓶颈。

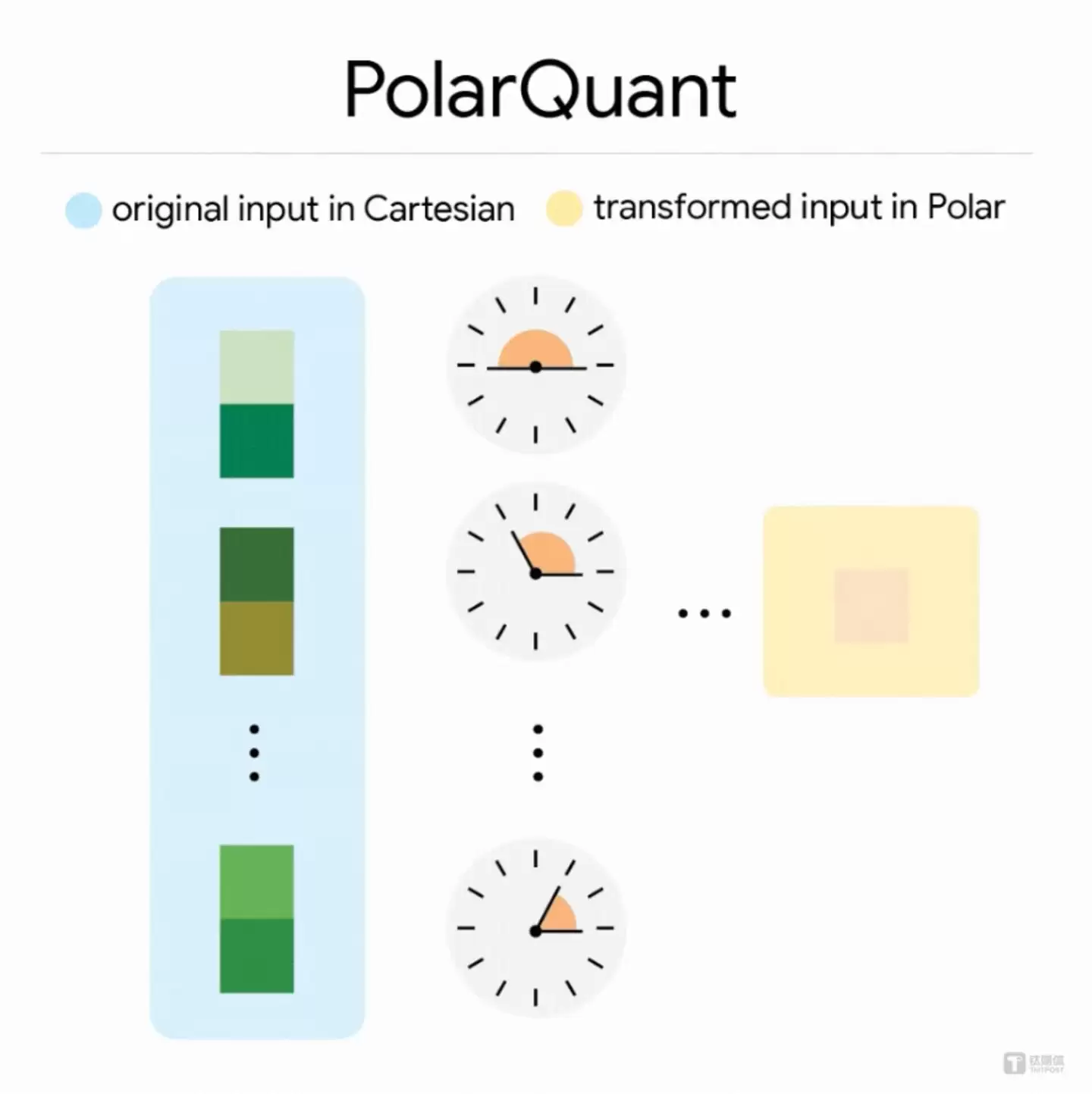

TurboQuant的解决方案基于两项协同算法:负责主体压缩的PolarQuant,与负责误差校正的QJL。二者结合,旨在高效压缩KV Cache中的高维向量。

第一步:PolarQuant——高质量压缩

传统量化方法类似使用直角坐标系定位。PolarQuant则创新性地采用极坐标思维,通过“角度与距离”描述向量。研究发现,经过特定数学变换后,高维向量的数值分布呈现高度规律性,如同一个预设刻度的圆形标尺。这使得系统能够预先构建最优压缩码本,无需在线校准,实现了真正的实时无损压缩。此步骤利用多数比特位,完成了数据主体的高效“瘦身”。

第二步:QJL——消除隐藏误差

主压缩后残留的微小误差若不加处理,会在注意力计算中累积,导致模型“关注点”偏移。QJL方法的精妙之处在于,它仅用1个比特标记残差方向,再与高精度原始查询向量结合,最终实现无偏差的内积估计。这意味着,数据虽经大幅压缩,但模型在评估信息相关性时的判断依然精准。

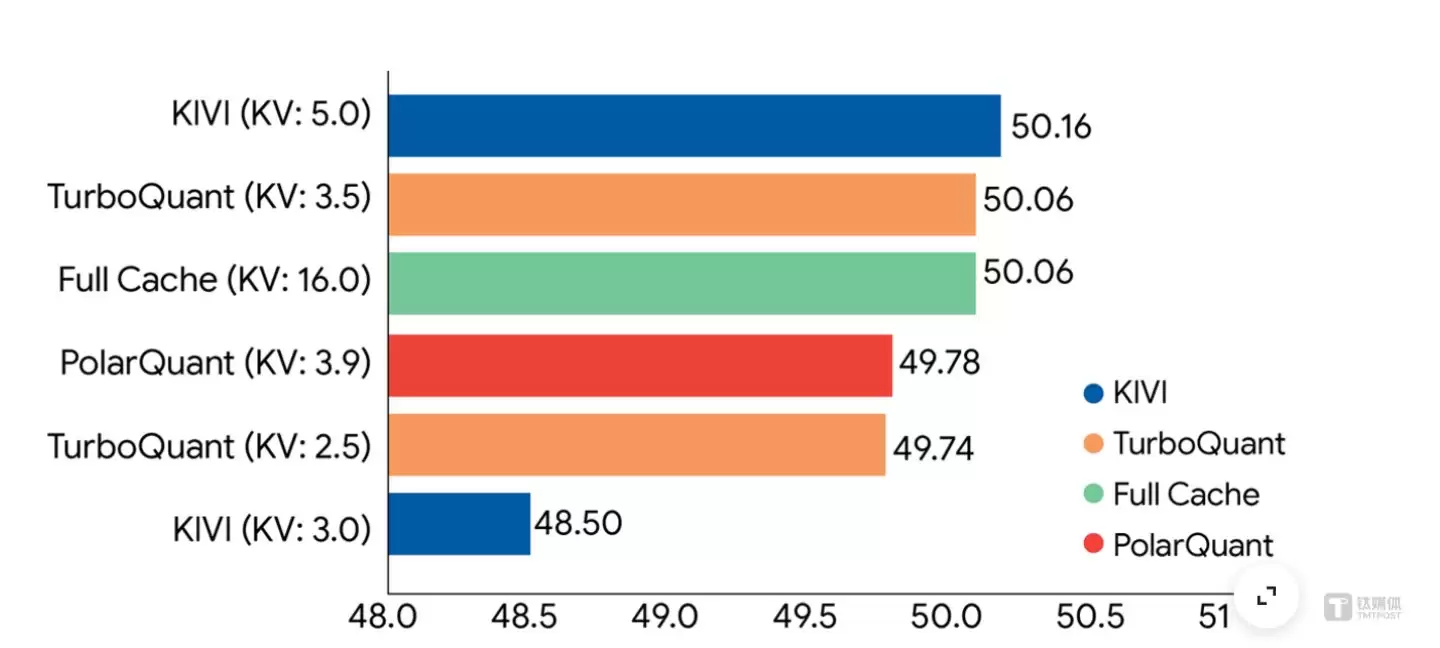

根据谷歌官方数据,TurboQuant实现了接近理论极限的性能突破:

极致压缩:可将KV Cache压缩至每通道仅3比特,相比传统的16或32比特存储,内存占用减少6倍以上。在长上下文测试中,即便经过如此极致的压缩,模型检索隐藏信息的准确率仍保持满分。

精度无损:在多项标准长上下文基准测试中,采用3.5比特配置的TurboQuant,其模型性能与使用全精度缓存时完全一致;即便使用2.5比特配置,性能下降也微乎其微。

速度飞跃:由于需从内存读取的数据量锐减,计算速度获得极大提升。在H100 GPU上,4比特TurboQuant处理注意力核心步骤的速度,比未压缩的32比特版本快8倍。

TurboQuant能够以极低的内存开销和近乎零的预处理延迟,构建并查询高精度的大型向量索引,这使谷歌规模的语义搜索变得更快、更经济。该技术的意义远超实验室范畴。虽然目前主要应用于缓解Gemini等模型的KV Cache瓶颈,但其底层架构同样适用于任何需要在高维向量数据库中进行海量相似性搜索的场景,例如现代语义搜索引擎。

该技术的相关论文已被接收,将于ICLR 2026和AISTATS 2026学术会议上正式发表。

相关链接:https://research.google/blog/turboquant-redefining-ai-efficiency-with-extreme-compression/

相关论文链接:https://arxiv.org/pdf/2502.02617

(本文作者 | 杨丽,编辑 | 杨林)

这就是内存通胀“终结者”?谷歌公开最新极限压缩算法的全部内容了,希望以上内容对小伙伴们有所帮助,更多详情可以关注我们的菜鸟游戏和软件相关专区,更多攻略和教程等你发现!

专题合集

精彩合集,奇葩无下限相关文章

大家还在看

-

- 王者荣耀世界交易指南王者荣耀世界支持物品交易吗

-

26-04-27

-

- 无限大手游攻略是什么

-

26-04-27

-

- 《炉石传说》大地的裂变预构筑卡组合集 大地的裂变首日卡组推荐_铺场德

-

26-04-27

-

- 风之痕迹魔武加护如何做

-

26-04-27

-

- 《魔兽世界》12.0地下堡介绍

-

26-04-27