Claude Opus 4.7 发布:更费token了,用户评价两极

Claude Opus 4.7正式发布:编程性能显著跃升,但成本与能力取舍需权衡

Anthropic于4月17日宣布其旗舰模型Claude Opus 4.7全面开放。相较于Opus 4.6,此次迭代在高级软件工程与复杂推理任务上实现了实质性突破,其多模态视觉处理能力也获得大幅增强,能够生成更精准的界面设计与演示文稿。

在定价层面,Opus 4.7维持了原有费率:每百万输入token收费5美元,每百万输出token收费25美元。然而,实际成本结构已发生关键变化。

官方公告明确指出,新版分词器将导致相同文本内容的token数量膨胀至原有的1.0至1.35倍。在API单价不变的情况下,这意味着实际使用成本隐性地上升了10%至35%,开发者需在预算规划中充分考虑这一变量。

消息发布后,社区迅速展开实测。从社交媒体反馈来看,用户对Opus 4.7的评价呈现显著分歧。

多数开发者认可其在代码生成与调试方面的进步,但在文案创作、日常对话等泛文本任务上,批评意见较为集中。

Claude Opus 4.7核心能力解析

根据官方技术文档,Opus 4.7在代码生成与复杂逻辑推理方面表现出更强的严谨性与一致性。模型新增了自我验证机制,使其在处理长期、多步骤的复杂工作流时更为可靠。用户反馈表明,以往需要全程监控的编码任务,现在可更放心地交由模型执行。它能严格遵循指令,并在输出前主动进行交叉检查。

视觉能力是本次升级的另一重点。Opus 4.7支持更高分辨率的图像输入,长边最大可达2,576像素(约375万像素),这是前代模型的3倍以上。这一提升使其能够胜任依赖精细视觉细节的任务,例如解析密集的UI截图、从复杂图表中提取结构化数据,或进行像素级的设计比对。

需要重点注意的是,Opus 4.7开始严格按字面语义解析并执行指令。这意味着为旧版本优化的提示词可能产生预期外的结果——旧模型通常会进行意图推断或自动跳过部分内容。用户必须据此重新评估并调整现有的提示词工程与工具链配置。

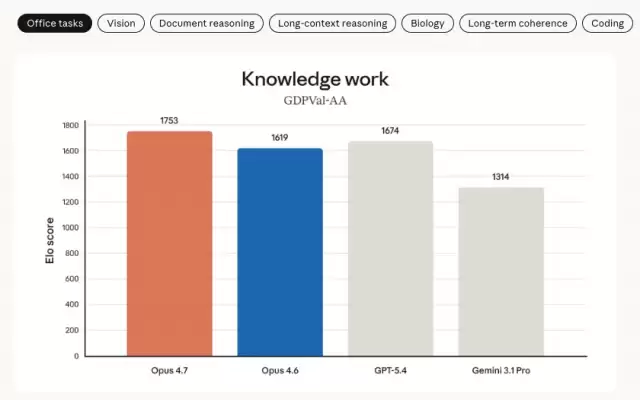

内部基准测试显示,Opus 4.7在专业垂直领域表现更为突出。它能够像资深金融分析师一样,构建严谨的财务分析模型,生成更具专业性的演示文稿,并实现更紧密的多任务协同。在第三方评估基准GDPval-AA(涵盖金融、法律等领域的知识工作经济价值评估)上,Opus 4.7达到了当前业界领先水平。

此外,模型在利用基于文件系统的记忆功能上更为智能。它能在多轮、长时间会话中有效记录关键笔记,并在后续的新任务中直接调用这些历史信息,从而减少了需要重复输入的上下文体量。

在安全层面,Opus 4.7内置了自动检测与拦截功能,旨在阻止涉及禁用或高风险网络安全用途的请求。Anthropic同时指出,安全研究人员若需将模型用于合法的漏洞研究、渗透测试等目的,可申请加入新设立的“网络验证计划”。

总体而言,Opus 4.7在安全性上与4.6版本保持相近水平:在欺骗、谄媚、协助滥用等风险行为上发生率较低。在输出诚实性与抵御恶意“提示注入”攻击方面,新模型优于旧版;但在某些特定场景,例如对受管制物质提供过于详细的减害建议,其表现略有退步。

新增xhigh推理级别,Token消耗管理成关键

根据Anthropic官方博客,Opus 4.7同步推出了一系列功能更新:

首先,在原有的“high”(高)和“max”(最大)推理努力级别之间,新增了“xhigh”(极高)级别。这为用户在处理复杂问题时,提供了更精细的调控选项,以便在推理质量与响应延迟之间取得平衡。

在Claude Code中,所有计划的默认努力级别已提升至“xhigh”。针对编码与智能体应用场景,官方建议从“high”或“xhigh”级别开始进行性能测试。

除了支持更高分辨率图像外,Anthropic已公开测试“任务预算”功能。开发者可通过设定预算参数,引导Claude在长周期任务中合理分配Token资源。

Claude Code新增了/ultrareview命令,该命令会启动一个专项代码审查会话,深入分析代码变更并标记出那些需要细致审查才能发现的潜在缺陷与设计问题。Pro和Max用户目前可免费试用3次。

此外,“自动模式”已向Max用户开放。在此模式下,Claude可代理部分权限决策,从而以更少的中断运行更长的任务链,同时控制相关操作风险。

需要明确的是,Opus 4.7虽然是4.6的直接迭代,但有两项变化会显著影响Token消耗,必须提前规划:

第一,新版分词器优化了文本处理方式,但相同输入内容可能被映射为更多Token,膨胀比例约在1.0至1.35倍之间,具体取决于内容类型。

第二,在更高的努力级别下,模型的内部思考量会增加,尤其在智能体场景的多轮交互中,Opus 4.7会产生更多的输出Token。

用户可通过调整努力级别参数、设定任务预算,或在提示词中明确要求简洁输出来控制Token消耗。Anthropic的内部测试数据显示,在其编码评估体系中,所有努力级别的Token使用效率均有所提升。

社区反馈呈现两极分化

对于Opus 4.7的编程能力,多数进行过深度测试的用户给予了肯定,承认其代码生成与调试能力确实更为强大。

然而,令许多用户措手不及的是Token消耗的急剧增加。有开发者指出,官方通稿着重强调视觉能力提升,却未充分说明其消耗Token的速度显著加快。使用同一张设计稿进行测试,Opus 4.7的输入Token数量可达Opus 4.6的3倍以上。

更值得关注的是,Opus 4.7在部分能力上出现了回调。

在长上下文信息检索方面,Opus 4.6的评分可达78.3%,而Opus 4.7降至32.2%。Anthropic对此的解释是,新模型在遇到信息缺失时会直接报错,而非像旧版那样进行推断性补充。但用户实测发现,即使信息明确存在于上下文中,模型也可能遗漏。这对于依赖长文档处理的法律、金融等领域用户而言,需要格外谨慎评估。

Opus 4.7的联网搜索与智能体能力也出现轻微下滑。其智能搜索评测BrowseComp的分数从Opus 4.6的83.7%降至79.3%,与GPT-5.4(89.3%)的差距进一步拉大。

被诟病最多的,是Claude Opus 4.7文风的显著变化。

许多内容创作者反映,Opus 4.7的输出中频繁出现“稳稳接住”、“压实闭环”等互联网行业术语,破折号使用混乱,续写内容也显得生硬枯燥。用户无奈表示:“以往是用它来优化文案,现在光是修改它生成的文本就要耗费双倍时间。”

最后,模型的思考过程被默认隐藏。Opus 4.7不再主动输出推理摘要,用户若想洞察其内部逻辑,必须手动添加相应指令。对于复杂任务,一旦输出错误,开发者难以定位其思考链条在何处出现偏差,导致问题排查成本倍增。业内分析认为这可能是防止技术被“蒸馏”的措施,但此举确实牺牲了开发者的调试体验。

综上,Opus 4.7并非一次无缝的平滑升级。如果你的核心应用场景并非硬核编程与复杂推理,建议先行充分评估再决定是否迁移。