大模型架构的下半场

时间:26-04-20

深度扩展的隐忧:当层数激增遭遇停滞的通信机制

过去十年,深度学习的发展遵循着一个清晰的范式:规模化。参数规模、数据规模、上下文长度持续扩大。这一策略成效显著:损失曲线稳步下降,模型能力不断增强,扩展定律为资源投入提供了精确的导航。

免费影视、动漫、音乐、游戏、小说资源长期稳定更新! 👉 点此立即查看 👈

然而,不同维度的扩展,其技术内涵与实现难度截然不同。序列长度的扩展催生了根本性的创新,涉及注意力机制革新与系统工程优化。数据扩展则相对直接:更多数据通常意味着更低的损失。相比之下,增加模型的宽度与深度,表面上似乎与数据扩展一样简单。

但宽度与深度真的在同等效力地扩展吗?

事实并非如此。深度在数量上实现了增长,但在质量上却遭遇了瓶颈。核心问题在于,层与层之间的通信架构,在过去近十年里几乎停滞不前。这不仅是深度网络本身的问题,更揭示了神经网络设计中的一个关键盲区。

研究社区投入了巨大精力扩展层内的计算能力,却长期忽视了同步提升层间的通信带宽。这一现状,必须被打破。

上半场:被成功扩展的维度

要理解已取得的进展,最有效的方法是审视哪些维度被成功扩展,以及其背后的技术路径。

首先是序列长度。早期Transformer仅能处理数百个token。要实现128K乃至更长的上下文,需要一系列协同创新:包括稀疏注意力、线性注意力等新机制,FlashAttention等系统工程优化,以及RoPE扩展等位置编码改进。这些工作共同构建了一个致力于优化序列维度信息流动的完整技术栈。其回报是显著的,不仅实现了超长文档处理,更为OpenAI-O1、DeepSeek-R1等模型的长链推理能力铺平了道路。这证明了,当资源被投入到优化“信息在序列中的流动”时,所能获得的突破性成果。

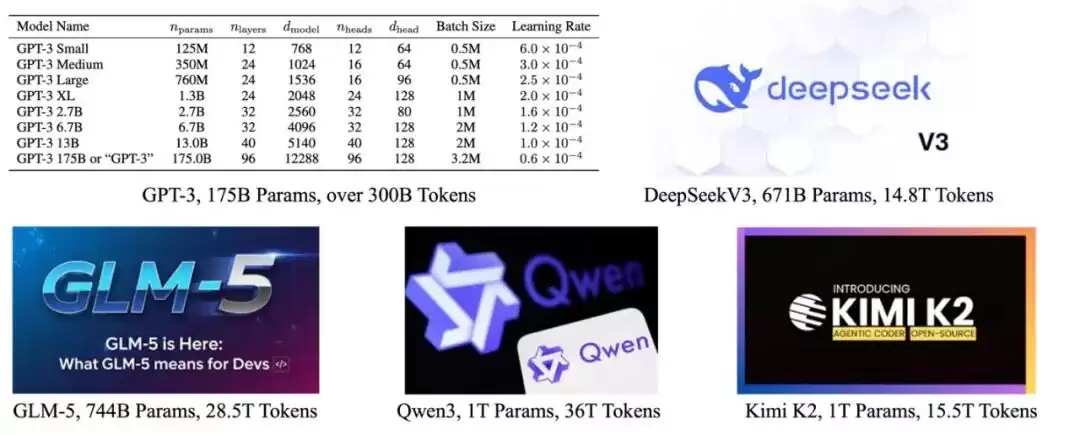

△现代大语言模型中参数与数据规模的增长曲线

参数与数据的扩展,则最符合直觉。从深度学习早期开始,标准范式便是:更多数据、更宽的网络、更深的层数,带来更强的表征能力。从GPT-2的15亿参数到如今的数万亿规模,这一范式持续有效。这似乎表明,沿着这些已验证的方向持续投入,无需引入新机制即可获得回报。

然而,对神经网络而言,“更宽”与“更深”存在本质差异。宽度扩展相对顺畅:现代GPU架构天然擅长宽矩阵运算,注意力机制的优化也使其能高效处理更宽的表示。因此,增加宽度可以较为平滑地集成到现有架构中。

深度扩展则面临不同挑战。模型层数确实从几十层增至上百层,但层间通信的核心机制,本质上仍是ResNet于2015年提出的深度残差连接,即经典的“x + F(x)”操作。此后虽有诸多改进(如归一化位置、残差缩放、跨层连接),但没有任何方案真正撼动那个加法操作“+”在残差流中的核心地位。

残差连接是深度学习的基石之一。没有它,便不可能训练上百层的Transformer,也不会有现代大语言模型与扩展定律。但基础方案有时会因其成功而变得“隐形”,以至于我们不再追问:它是最优解,还是仅仅是首个可行的解决方案?

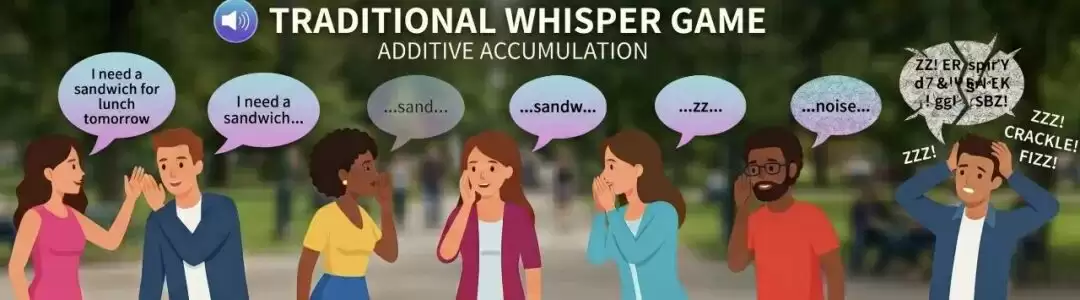

可以做一个类比:想象一个特殊版本的传话游戏。标准版本中,第1人向第2人耳语,第2人再向第3人传递,信息在传递中逐渐失真。这类似于没有残差连接的深层网络:每一层只能看到前一层的输出。

残差连接修复了此问题:每个人在传递自己解读的同时,也将之前所有的原始信息一并向下传递。第3个人既能听到第2个人的新解读,也能访问之前的所有内容。原始信号被完整保留,成为不断叠加的“合唱”中的一个声部。

但新问题随之浮现:当传到第152个人时,他需要同时听取152个声音——原始信息加上151层叠加的内容,全部混合在一个信号中。理论上,前面所有层的信息依然存在,但它们已被严重稀释。如果第152层需要精确获取第3层的信息,它必须从这片庞大的“合唱”中费力地将其分离出来。

△在信息累加的传话游戏中,靠后的参与者难以精准提取所需内容

通常,第152层无法做到这一点。

这就是信息稀释问题。每一层都面临两难:若积极贡献新信息,可能淹没先前内容;若保持保守,则能保留已有信息但学习效率低下。结果,许多层学会了“保持沉默”,几乎不在残差流中写入实质性新内容。这样的网络在名义上很深,在功能上却很浅。我们堆叠了152层,但其中大量层并未有效参与计算。

瓶颈不在于152层网络所需的计算力,而在于信息穿越这些层时的通信带宽。这类似于几十年前CPU发展遭遇的困境:处理器速度不断提升,直至内存带宽成为瓶颈,迫使整个行业转向缓存与通信优化。组织管理亦然:一群聪明人的集体创造力,受限于他们之间的沟通效率。深度学习正经历自己的版本:十年间持续增强单层能力,而层间通信通道,始终是2015年铺设的那条“单车道”。

那么,是否存在更优的机制?

现有解决方案及其局限

在本文探讨的研究之前,已有许多工作关注到深度瓶颈。修补方案日趋精巧:例如获得CVPR最佳论文的DenseNet,它保留了每一层的输出,但带来了平方级的内存与计算开销。采用可学习加权的方法,如DenseFormer、LIMe,降低了成本,但其权重在训练后便固定不变,无法针对不同token或上下文动态调整,缺乏灵活性。

字节跳动的Hyper-Connections与DeepSeek的mHC采取了不同路径,它们将通信通道拓宽至N个,层间通过混合矩阵连接,相当于在信息高速公路上增设了多条车道。但根本限制仍在:信息仍需逐层流动,第152层无法直接、高效地访问第3层的原始信息。

彩云公司的MUDDFormer实现了动态混合,能根据每个token的表示生成层间聚合权重。这在方向上是对的:从每一层汲取多少信息,理应取决于当前处理的内容。但其局限在于,第152层在决定从第3层汲取信息时,仅基于第152层自身的状态进行预测,并未真正“查看”第3层实际包含的内容。它是在猜测哪些层可能有用,而非进行精确的信息检索。

这就是大模型架构的下半场的全部内容了,希望以上内容对小伙伴们有所帮助,更多详情可以关注我们的菜鸟游戏和软件相关专区,更多攻略和教程等你发现!

专题合集

精彩合集,奇葩无下限相关文章

- 科隆Major欧洲赛区晋级预测:强队稳定,FaZe降至71.5%,Liquid仅16.3%

- pebble智能手表 是什么?基础说明与使用场景

- 对话奔驰集团高层:“中国研发团队拥有自己的职责和权利”

- 三星Galaxy S26 Ultra荣登美国《消费者报告》智能手机综合排名榜首

- FaZe成为2025年液体百科上搜索量最高的CS战队

- amd e350 常见问题与处理办法汇总

- 《蜜语纪》许父为了20000元放过聂予诚,鲁贞贞当众羞辱许蜜语

- AI驱动从头设计多样化小分子结合蛋白,韩国团队发现能选择性识别压力激素的蛋白质

- amd e350 教程:常见用法与操作步骤

- 真神作!《生化危机9》Steam通关率高达70%!

大家还在看

-

- 暗黑4S11飞天火圣骑BD怎么搭配

-

26-04-28

-

- 逆战未来星海王者插件如何选择

-

26-04-28

-

- 《明日方舟:终末地》采石场拉电线攻略

-

26-04-28

-

- 原神稻妻秘境副本有哪些

-

26-04-28

-

- 无畏之刃如何获取技能点

-

26-04-28