Gemma与Gemini是什么关系?Google系大模型

Google Gemma 与 Gemini:同源异构的双轨战略

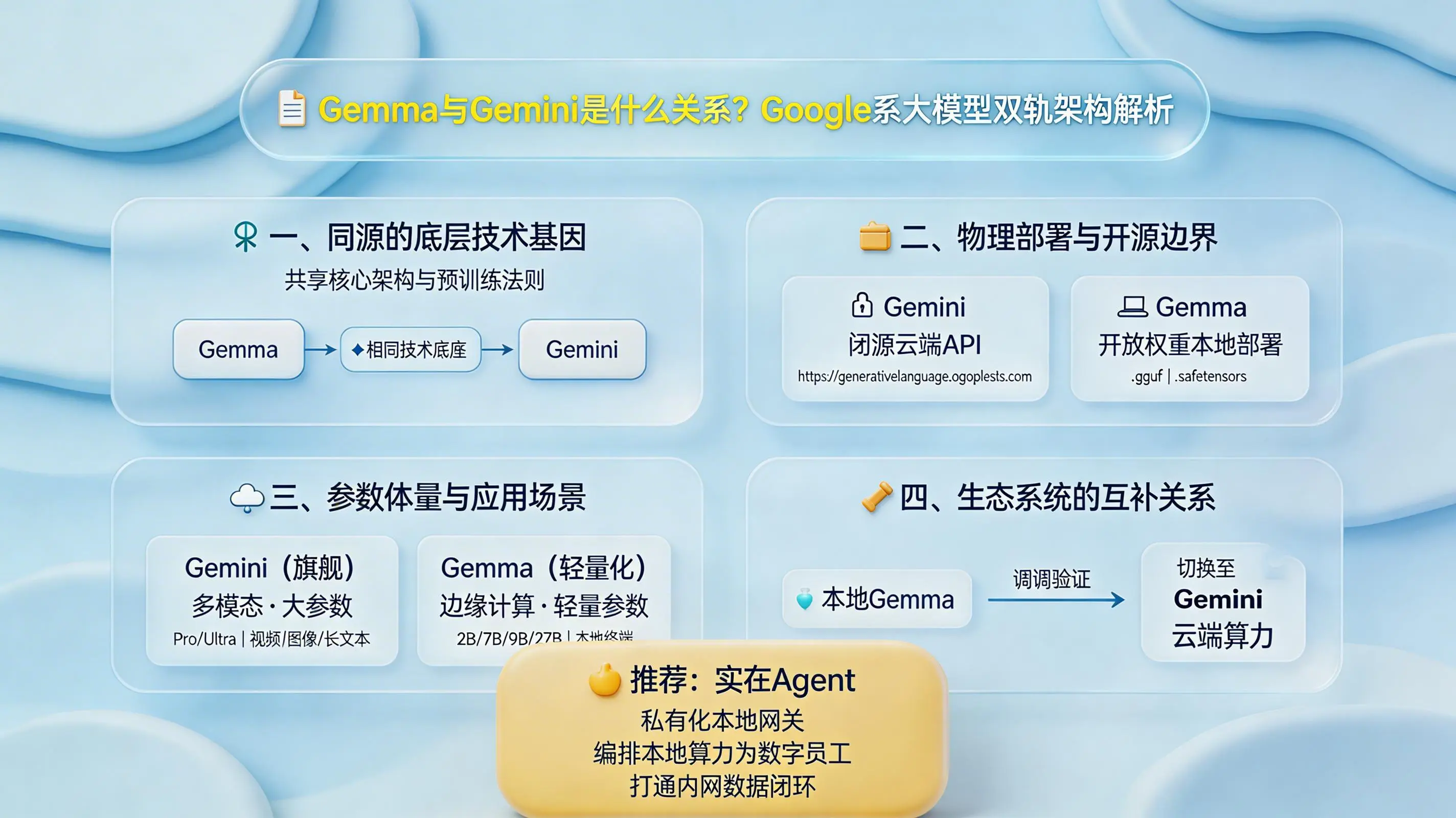

Google推出Gemma和Gemini,并非两个独立的技术分支,而是基于同一核心技术架构衍生的双轨产品。Gemini是面向云端服务的闭源旗舰模型,而Gemma则是为本地化部署设计的开源轻量版本。理解两者的定位差异,是有效运用Google AI生态的关键。

本文大纲

一、共享的核心架构与训练范式

二、部署模式对比:云端API与开放权重

三、参数规模与适用场景解析

四、云端与本地生态的协同策略

一、共享的核心架构与训练范式

Gemma与Gemini拥有共同的技术根源。其底层神经网络架构、核心算法及预训练数据规范一脉相承。两者本质上是同一套先进机器学习框架下的不同产品化形态。

这类似于采用相同的核心引擎与底盘技术,既可打造追求极致性能的赛道跑车(Gemini),也能生产注重效率与适应性的城市SUV(Gemma)。它们共享基础的技术逻辑与知识体系,却在产品形态上服务于不同目标。

二、部署模式对比:云端API与开放权重

两者最根本的区别在于部署模式与可访问性。

Gemini 采用闭源云端服务模式。用户通过Google Cloud的特定API端点(例如 https://generativelanguage.googleapis.com)或Web界面进行调用。开发者无法直接访问其模型权重或源代码,只能将其作为黑盒服务集成。

Gemma 则属于开放权重模型。开发者可以直接从Hugging Face或Google官方渠道下载完整的模型文件(如 .gguf 或 .safetensors 格式),并将其部署在本地工作站、服务器甚至边缘设备上,实现完全的私有化控制与定制。

三、参数规模与适用场景解析

不同的部署模式直接决定了其适用的技术场景。

云端重型任务(Gemini):作为旗舰模型,其参数量级庞大(如Pro或Ultra版本),并原生支持处理多模态信息(视频、图像、长文本)。它适用于需要海量通用知识库和强大推理能力的复杂任务,例如深度内容分析、跨模态生成与复杂逻辑处理。

边缘敏捷计算(Gemma):其模型参数规模集中在2B、7B、9B等级别,专为轻量化设计。这使得它能够在显存有限的消费级GPU或终端设备上高效运行,擅长执行目标明确的本地化任务,如实时文本生成、特定领域的信息提取、代码补全及私有数据集的快速推理。

四、云端与本地生态的协同策略

在Google的AI战略中,Gemma与Gemini构成了互补的协同生态。一个典型的高效工作流是:开发者首先在本地使用Gemma进行快速的模型微调、原型验证及业务逻辑测试;当业务需要扩展到云端、处理高并发请求或调用更强大的多模态能力时,则可无缝切换至Gemini API。这种组合兼顾了开发迭代的敏捷性与生产环境对性能及规模的需求。

总结

Gemma与Gemini体现了Google“一体双轨”的产品战略。它们技术同源,却路径分明:Gemini作为闭源旗舰,提供顶级的云端通用智能;Gemma作为开源先锋,则成为开发者手中可私有化部署的轻量级工具。成功在本地部署Gemma后,企业面临的下一挑战是如何安全、高效地将其集成至现有业务系统。此时,采用专业的AI智能体平台(例如实在Agent)至关重要。此类平台原生兼容主流大语言模型,能通过私有化物理网关,将本地模型算力敏捷编排为数字员工,无需复杂编码即可打通内网各系统间的数据流转闭环,从而充分释放本地化AI部署的业务价值。