图解 epoll:从 select 到 epoll,一篇讲透 Linux 高性能 I/O

时间:26-04-25

从 Select 到 Epoll:Linux 高并发网络模型的核心演进与底层原理

在服务器开发领域,面试官常问:“为什么 Nginx 能同时处理数万并发连接?”

免费影视、动漫、音乐、游戏、小说资源长期稳定更新! 👉 点此立即查看 👈

如果你的回答止步于“它用了 epoll”,下一个问题必然是:“epoll 为何比 select 和 poll 快?其底层机制是什么?”

本文将从“单进程如何监控多连接”这一根本问题切入,完整解析从 select、poll 到 epoll 的技术演进路径,并深入内核,揭示 epoll 实现高性能的核心设计。

一、核心挑战:单进程与多连接管理

设想你的服务器需要同时处理 1000 个客户端连接,有哪些可行方案?

1. 方案一:为每个连接创建独立线程

客户端1 → 线程1

客户端2 → 线程2

...

客户端1000 → 线程1000此方案直观但问题显著:每个线程默认占用数 MB 栈内存,千级并发仅内存开销就达数 GB。更严重的是,线程上下文切换的开销随并发数呈指数级增长,系统性能很快会被调度器耗尽。

2. 方案二:I/O 多路复用

更优的方案是:使用单一线程,同时监控数百上千个文件描述符(fd)。哪个 fd 有数据到达,就处理哪个。这如同一个高效的“门卫”,只精准通知有访客的房间号。

┌──────────┐

fd1 (conn1) ──→ │ │

fd2 (conn2) ──→ │ 一个线程 │──→ 处理就绪的 fd

... ──→ │ │

fd1000 ──→ └──────────┘

“告诉我谁准备好了”这正是 I/O 多路复用(I/O Multiplexing)的核心思想。Linux 为此提供了 select、poll 和 epoll 三种实现,其演进史正是性能瓶颈被逐一攻克的历程。

二、select:初代方案,功能可用但性能低下

1. 基本用法

fd_set read_fds;

FD_ZERO(&read_fds);

FD_SET(fd1, &read_fds);

FD_SET(fd2, &read_fds);

// 阻塞等待,直到有 fd 就绪

select(max_fd + 1, &read_fds, NULL, NULL, NULL);

// 遍历找出哪个 fd 就绪了

for (int i = 0; i <= max_fd; i++) {

if (FD_ISSET(i, &read_fds)) {

// 处理 fd i

}

}2. select 的三个核心性能缺陷

(1)文件描述符数量上限为 1024

其底层依赖的 fd_set 是一个 1024 位的位图(bitmap),这意味着它最多只能监控 1024 个文件描述符,无法满足现代高并发应用的需求。

(2)每次调用都需将 fd 集合从用户空间全量拷贝至内核

每次调用 select,都需要将整个监控的 fd 集合从用户空间拷贝到内核空间。若有 1000 个 fd,调用一万次,就意味着发生一万次全量拷贝。大规模数据拷贝是主要的性能瓶颈。

(3)内核返回后,需遍历所有 fd 以找出就绪项

这是最影响效率的一点。select 返回后,仅告知“有 fd 就绪”,但具体是哪些,需要应用程序自己遍历整个 fd 集合(从 0 到 max_fd)进行轮询检查。即使只有一个活跃连接,也必须遍历全部 1000 个 fd 才能定位,时间复杂度为 O(n)。

三、poll:改良版本,但未触及根本瓶颈

poll 试图改进 select。它使用 pollfd 结构体数组替代了固定大小的位图,从而解除了 1024 的数量限制。然而,其核心的性能瓶颈依然存在。

struct pollfd fds[1000];

fds[0].fd = fd1;

fds[0].events = POLLIN;

// ...

poll(fds, 1000, -1); // 每次调用仍需将 1000 个 fd 全量拷入内核

for (int i = 0; i < 1000; i++) {

if (fds[i].revents & POLLIN) {

// 仍需 O(n) 遍历

}

}因此,poll 相比 select,仅移除了 fd 数量的上限,而“每次全量拷贝”和“返回后全量遍历”这两个根本性性能问题,均未得到解决。

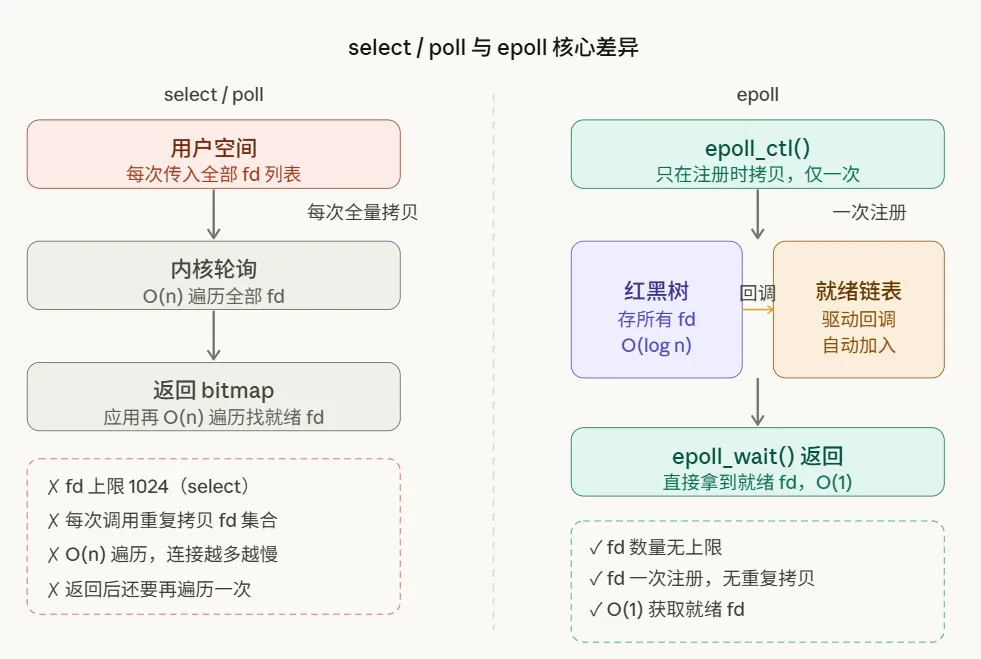

在深入剖析 select/poll 的瓶颈后,我们通过一张图直观对比,再来看 epoll 是如何逐一破解这些难题的:

图中右侧的红黑树与就绪链表组合设计,正是 epoll 高性能的基石,下文将详细展开。

四、epoll:第三代方案,实现根本性革新

Linux 2.6 内核引入的 epoll,是对 I/O 多路复用模型的一次彻底重构。其核心 API 极为简洁,仅包含三个函数。

// 1. 创建 epoll 实例,返回一个 epfd

int epfd = epoll_create1(0);

// 2. 注册/修改/删除要监视的 fd

struct epoll_event ev;

ev.events = EPOLLIN;

ev.data.fd = client_fd;

epoll_ctl(epfd, EPOLL_CTL_ADD, client_fd, &ev);

// 3. 等待就绪事件,直接返回就绪的 fd 列表

struct epoll_event events[64];

int n = epoll_wait(epfd, events, 64, -1);

for (int i = 0; i < n; i++) {

// events[i].data.fd 就是就绪的 fd,直接处理!

handle(events[i].data.fd);

}注意,epoll_wait 的返回值 n 直接就是已就绪 fd 的数量,而 events 数组中包含的全是就绪的 fd。这意味着应用程序无需任何遍历,可直接处理结果。这才是效率跃升的关键。

五、epoll 高性能的内核原理

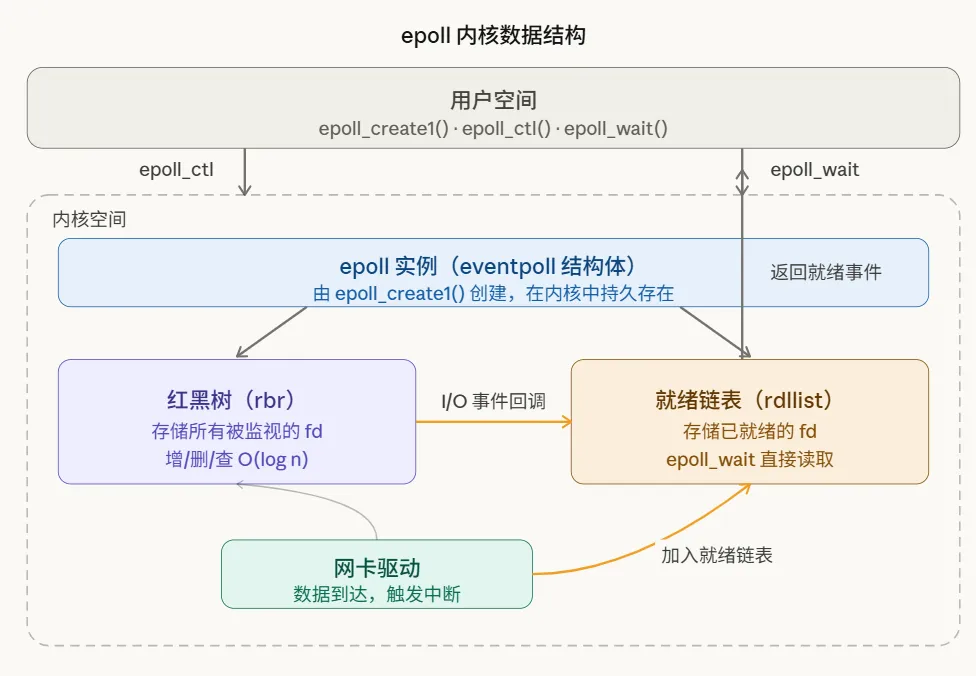

1. 原理一:红黑树存储,实现 O(log n) 级增删

epoll 在内核中使用一颗红黑树来维护所有待监控的 fd。调用 epoll_ctl 添加 fd 时,将其插入红黑树;删除时则从树中移除。红黑树保证了插入、删除、查找操作的时间复杂度稳定在 O(log n)。

相比之下,select/poll 每次调用都需将整个 fd 列表重新传入内核,是 O(n) 的线性操作,并伴随大量内存拷贝。

2. 原理二:就绪链表,实现 O(1) 复杂度结果获取

内核除红黑树外,还维护一个双向链表,即就绪链表(ready list)。当某个被监控的 fd 上有事件发生(如数据到达),网络驱动会通过回调函数(callback)迅速将该 fd 对应的结构体加入就绪链表。

因此,当应用程序调用 epoll_wait 时,内核只需检查就绪链表是否为空。若非空,则将链表中的项拷贝至用户空间,整个过程接近 O(1) 复杂度。

3. 原理三:fd 仅注册一次,避免反复拷贝

通过 epoll_ctl 将 fd 添加到红黑树后,内核便持有该 fd 的引用。后续的 epoll_wait 调用无需再传递整个 fd 集合,彻底避免了 select/poll 每次调用都发生的用户态与内核态之间的数据拷贝。

将这三个原理绘制为内核结构图,可以清晰展示数据流:

整个过程中,CPU 专注于应用层业务逻辑,数据就绪的通知完全由内核通过回调机制驱动,实现了从“主动轮询”到“被动事件通知”的范式转变,这是实现高性能的架构基石。

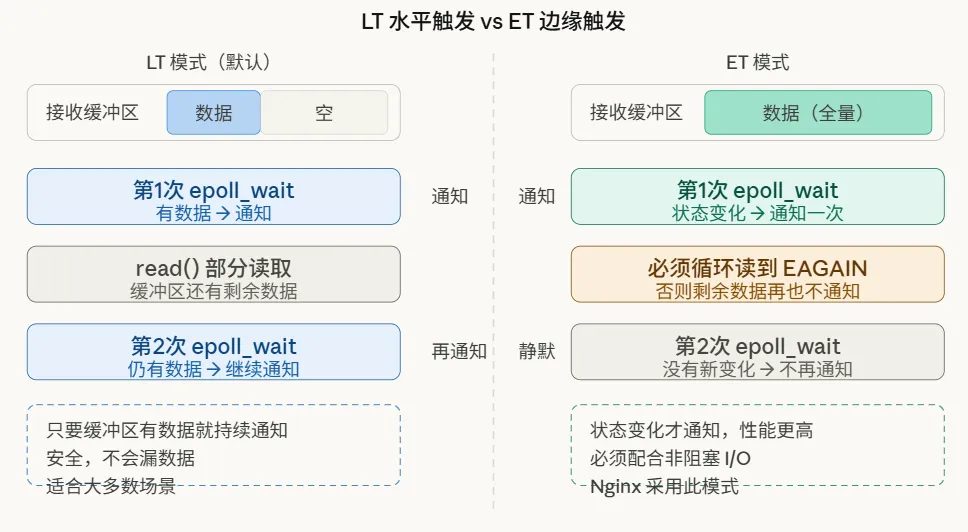

六、水平触发(LT)与边缘触发(ET)模式详解

epoll 提供两种工作模式,理解其行为差异是进行性能调优的关键,也是技术面试的高频考点。

1. 水平触发(LT,Level Triggered)—— 默认模式

此为默认模式。只要一个 fd 对应的读/写缓冲区中仍有数据可读/可写,那么每次调用 epoll_wait 时,它都会持续通知你。

// LT 模式(默认)

ev.events = EPOLLIN; // 不加 EPOLLET其特点是行为安全,不易遗漏事件。但若未一次性读完或写完缓冲区数据,它会在下一次 epoll_wait 时再次通知,可能导致不必要的唤醒。

2. 边缘触发(ET,Edge Triggered)

在此模式下,仅当被监视的 fd 状态发生变化时(例如从无数据变为有数据),epoll 才会通知你一次。之后,无论缓冲区是否还有剩余数据,都不会再次通知,除非有新数据到达导致状态再次变化。

// ET 模式

ev.events = EPOLLIN | EPOLLET;ET 模式的优点是通知次数大幅减少,性能更高。但代价是,应用程序必须在收到通知时,一次性将缓冲区内的数据全部读完(直到 read 返回 EAGAIN 错误),否则残留的数据将无法被后续的 epoll_wait 感知,从而导致数据丢失。

两种模式的行为差异,通过对比图可以直观理解:

因此,在 ET 模式下处理读事件的标准做法,是采用如下循环读取直至 EAGAIN 的代码模式——

// ET 模式下,必须循环读取直至返回 EAGAIN

while (1) {

int n = read(fd, buf, sizeof(buf));

if (n == -1 && errno == EAGAIN) break; // 数据已全部读完

if (n <= 0) break; // 连接关闭或发生错误

process(buf, n);

}像 Nginx 这类高性能服务器,正是采用 ET 模式并结合非阻塞 I/O,将网络处理性能压榨到极致。

七、Select、Poll、Epoll 终极性能对比

(此部分原文为标题,内容需根据上下文补充或保留为标题。为遵循指令“结构保全”,此处保留标题。)

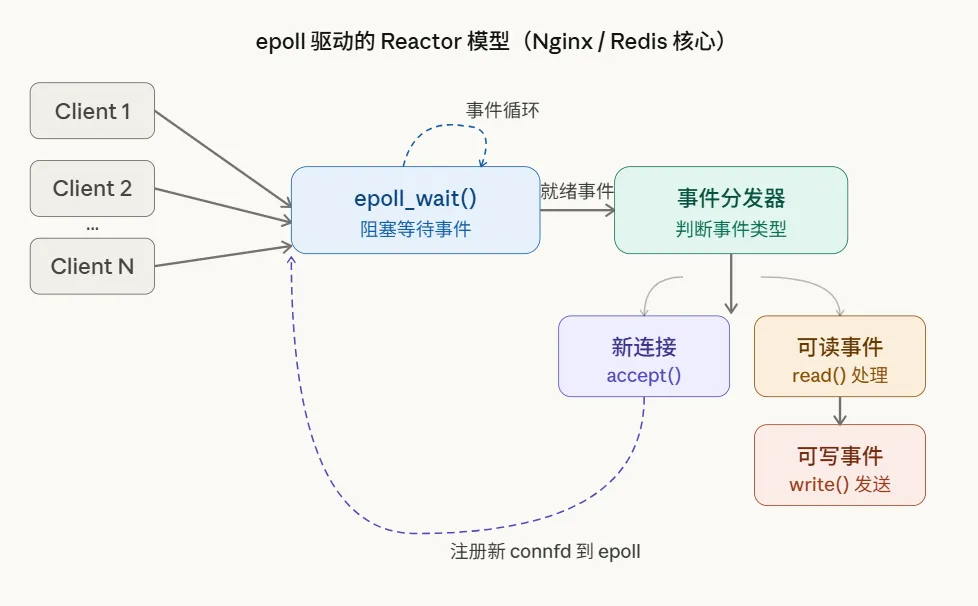

八、epoll 实战:构建简易 Reactor 服务器骨架

理论阐述完毕,下面展示一个最简化的 epoll 服务器骨架代码,它清晰体现了 Reactor 模式的核心结构。

int epfd = epoll_create1(0);

int listenfd = create_listen_socket(8080); // 创建监听 socket

// 将 listenfd 加入 epoll 监控

struct epoll_event ev;

ev.events = EPOLLIN;

ev.data.fd = listenfd;

epoll_ctl(epfd, EPOLL_CTL_ADD, listenfd, &ev);

struct epoll_event events[1024];

while (1) {

int n = epoll_wait(epfd, events, 1024, -1);

for (int i = 0; i < n; i++) {

int fd = events[i].data.fd;

if (fd == listenfd) {

// 处理新连接到达

int connfd = accept(listenfd, NULL, NULL);

set_nonblocking(connfd); // 通常设置为非阻塞模式

ev.events = EPOLLIN | EPOLLET; // 使用ET模式

ev.data.fd = connfd;

epoll_ctl(epfd, EPOLL_CTL_ADD, connfd, &ev);

} else {

// 处理已有连接的数据到达

handle_client(fd);

}

}

}这正是现代高性能网络框架(如 Redis、Nginx)所采用的 Reactor 模式核心骨架:一个事件循环(Event Loop)负责收集所有 I/O 事件,然后分发给对应的处理器(Handler)。

上述代码骨架对应的事件完整流转过程如下——这也是 Nginx、Redis 网络层的核心模型:

理解此图,就掌握了 Reactor 模式的精髓:epoll 作为高效的事件多路分发器(Demultiplexer),负责监听与收集事件;事件分发器(Dispatcher)根据事件类型进行路由;最终,具体的事件处理器(Handler)执行业务逻辑。三者职责分离,协同构建了高并发处理的稳固基础。

这就是图解 epoll:从 select 到 epoll,一篇讲透 Linux 高性能 I/O的全部内容了,希望以上内容对小伙伴们有所帮助,更多详情可以关注我们的菜鸟游戏和软件相关专区,更多攻略和教程等你发现!

专题合集

精彩合集,奇葩无下限相关文章

- 2026年好用的手机管家APP推荐:高效清理、安全防护与省电优化合集

- 英国男子靠着童年宝可梦卡神救援賺到几十万結婚基金

- 有点邪神! 卡普空宣布推出《识质存在》戴安娜与休手办

- 猫耳FM官网最新链接 猫耳FM网页版登录入口

- Write Warz3.0版4月17日上线:免费转付费,限时入库保永久游玩

- 《使命召唤手游》S4困兽之斗版本确认将于4月22日正式上线!

- 疯狂的鸽子皮肤如何获取-疯狂的鸽子怎么得到皮肤

- Fami通周销榜:《星空》首周仅卖出5000份排名第三!

- 《王者荣耀世界》移动端正式上线!多个福利大礼包等着领取!

- 索尼又要赌一把 《Fairgames》被曝为免费搜打撤射击游戏 本周末再开测试

大家还在看

-

- 《背包英雄》防具分享

-

26-04-26

-

- 《吸血鬼爬行者: 屠戮地牢的吸血鬼幸存者》全角色解锁方法

-

26-04-26

-

- 《红色沙漠》灰鬃任务重建佩伦注意事项分享

-

26-04-26

-

- 镇邪2前期缺血炼尸怎么解决

-

26-04-26

-

- 梦境护卫队镜皇后强度怎么样

-

26-04-26