实战案例:近期,客户单位无线网无规律卡顿,最后查出来竟然有人在跑......

时间:26-04-25

背景介绍

一家外贸中小企业遭遇了棘手的网络故障。其稳定运行超过两年的无线网络近期突发大面积中断,员工普遍反馈视频卡顿、网页加载缓慢甚至无法访问,日常办公受到严重影响。

免费影视、动漫、音乐、游戏、小说资源长期稳定更新! 👉 点此立即查看 👈

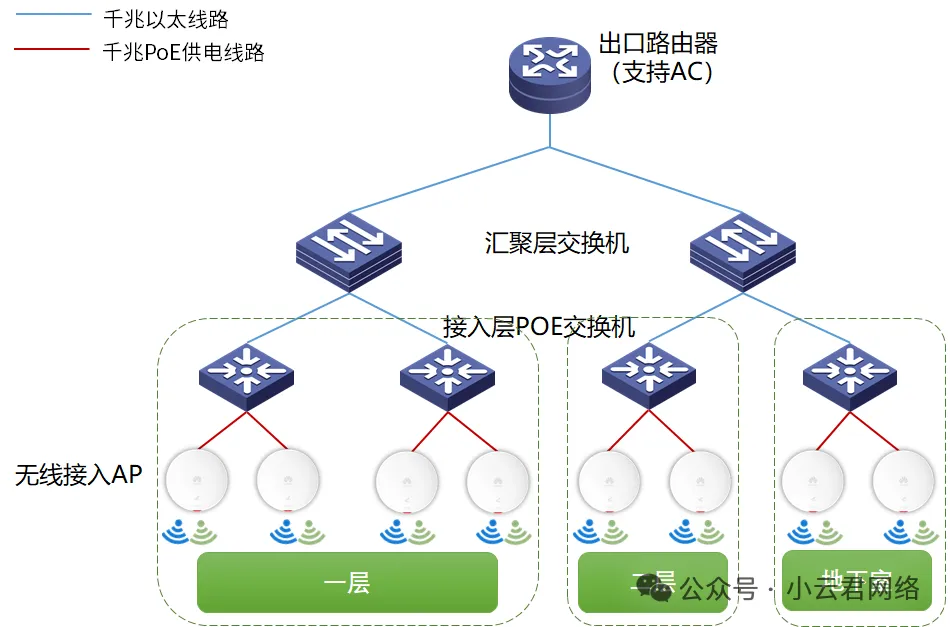

整网拓扑

该公司网络采用某P品牌AC+面板AP的典型架构,通过一条千兆宽带完成全公司无线覆盖。

分析思路

网管系统日志显示,故障现象极具特征:每次异常仅持续两三分钟,但发生时间毫无规律,昼夜皆可能突发。这种偶发性故障排查难度最高。我们制定了三级递进排查策略:

首先,在故障触发瞬间,立即检查异常终端的网络参数配置,并通过Ping测试验证内网及外网连通性,同时执行带宽测速,确认实际吞吐量是否达标。

若第一步未发现明显异常,则进入参数调优阶段。尝试关闭IPv6功能、更换公共DNS服务器等操作,观察网络质量是否改善。

如前两步均告无效,则需启动深度流量分析。部署Wireshark等专业工具进行长期抓包,对网络数据流进行协议级监控与诊断。

排查分析

(1) 第一步:异常时间点,检查异常终端网络参数、连通性和吞吐量

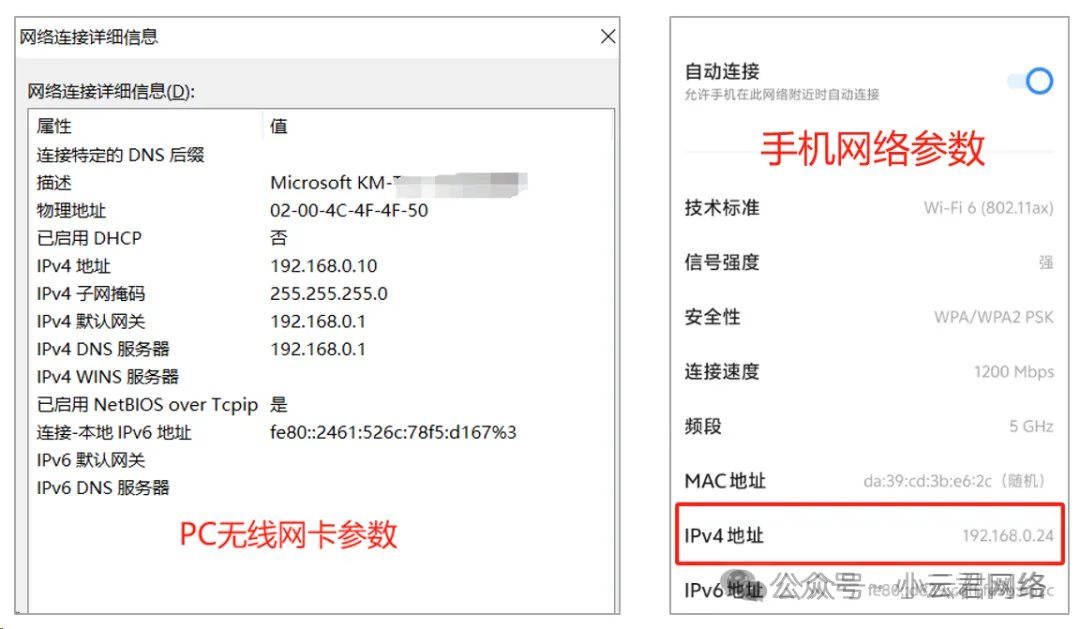

经过持续监控并与网管协同记录,在故障复现时提取了异常终端的网络配置。

从参数分析,IP地址、网关、DNS获取均正常,基本排除了私接DHCP服务器导致地址冲突的可能性。配置无误后,我们执行了分层连通性诊断,依次Ping测以下关键节点:

• 路由器LAN口IP:评估无线终端至内网网关的链路质量。

• 路由器WAN口IP:检验路由器NAT地址转换功能状态。

• 上游网关(光猫):诊断光猫设备工作稳定性。

• 公网地址(如百度):验证运营商外网链路通畅性。

所有节点测试均未出现丢包或延迟抖动。

然而,连通性正常不代表网络体验无虞。这好比道路虽通但车道狭窄,高峰时段必然拥堵。因此,必须通过测速验证实际可用带宽。

手机无线测速显示带宽超过900Mbps,完全达标。至此,排查陷入僵局:网络参数、连通性、带宽均无异常,卡顿根源究竟何在?

此时需将排查方向转向影响网络体验的其他潜在因素。通常有两个关键点值得深究:

• IPv6协议栈:当前IPv6网络建设尚在完善,链路震荡或DNS解析故障可能引发访问异常。

• DNS解析服务:本地运营商DNS可能存在劫持或响应缓慢问题,导致域名解析失败。

后续排查将围绕这两点展开。

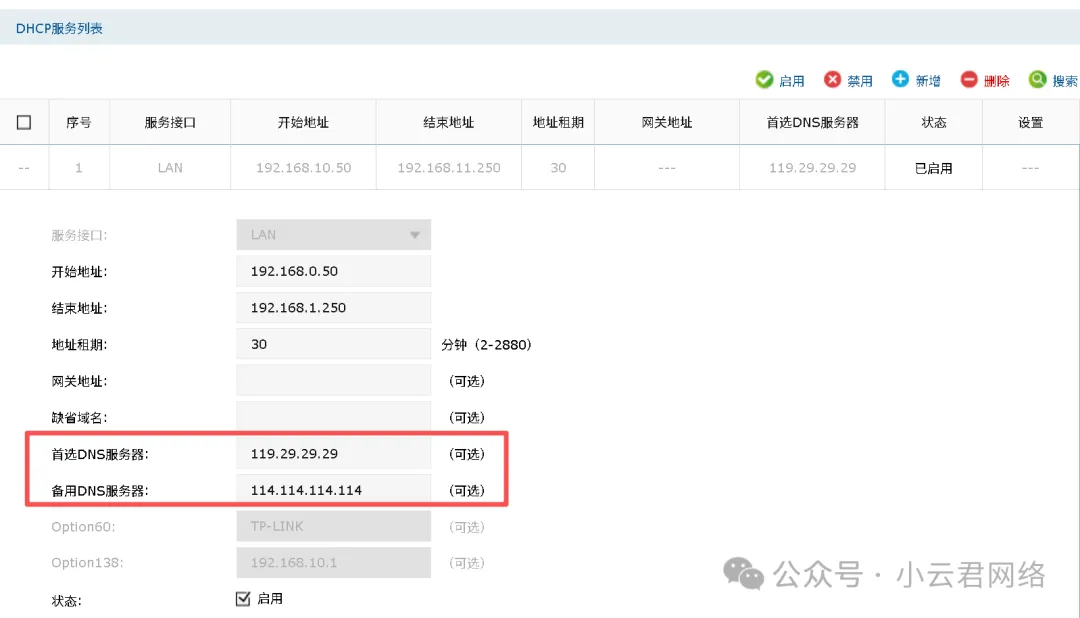

(2) 第二步:修改可能影响上网的参数进行观察

首先,在主路由器全局关闭IPv6功能,强制所有流量经由IPv4通道,以排除IPv6协议干扰。

随后,修改DHCP下发的DNS服务器地址,将运营商默认DNS更换为公共DNS 114.114.114.114。

参数调整后数日,间歇性卡顿现象依然存在。常规排查手段已用尽,必须启动底层流量监控。

(3) 第三步:抓包确认NTP报文交互

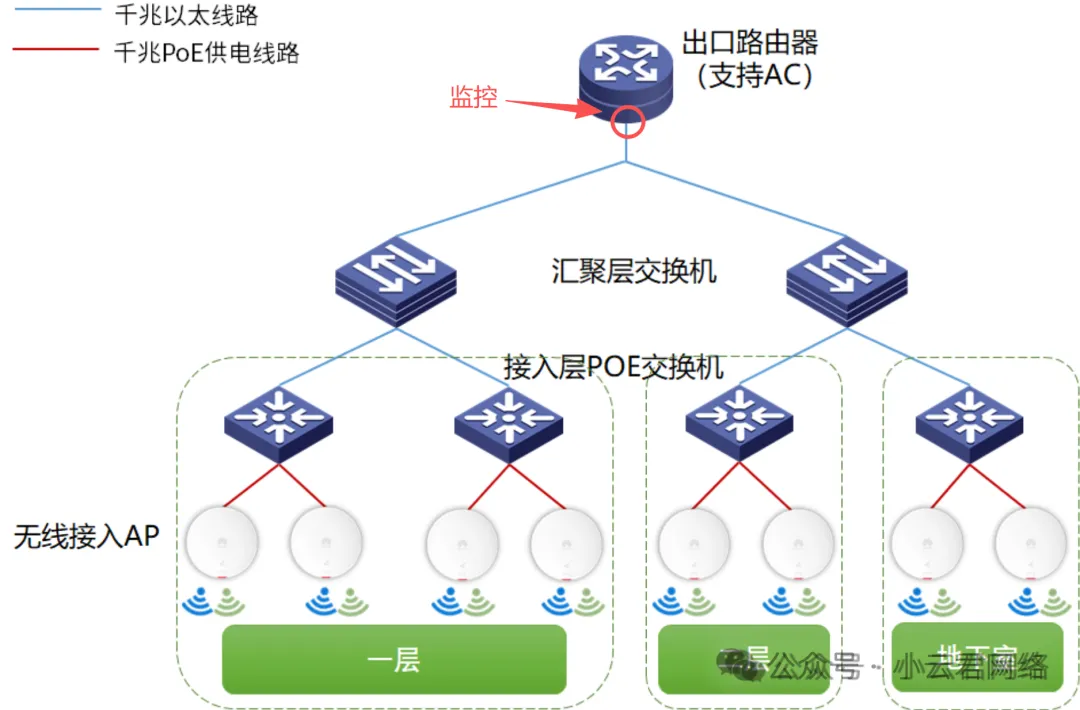

我们在路由器LAN口部署了流量镜像进行抓包分析。

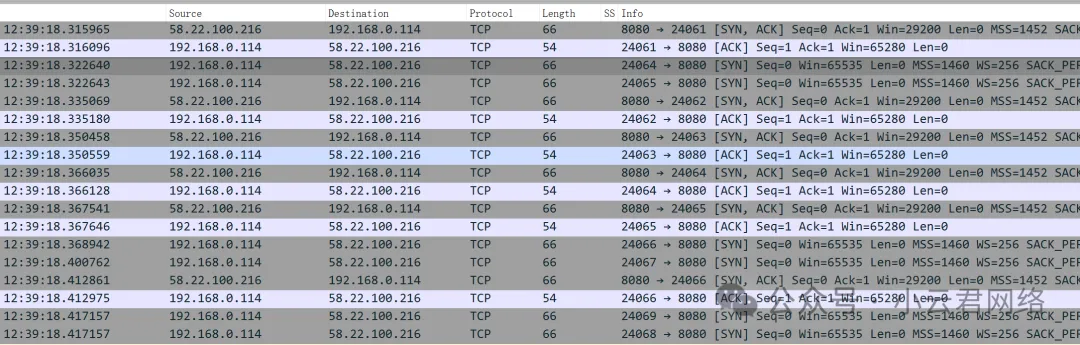

故障复现后,抓包数据迅速锁定异常时间点。发现内网IP为192.168.0.114的设备,正持续向外部地址58.22.100.216发起海量TCP新建连接请求。

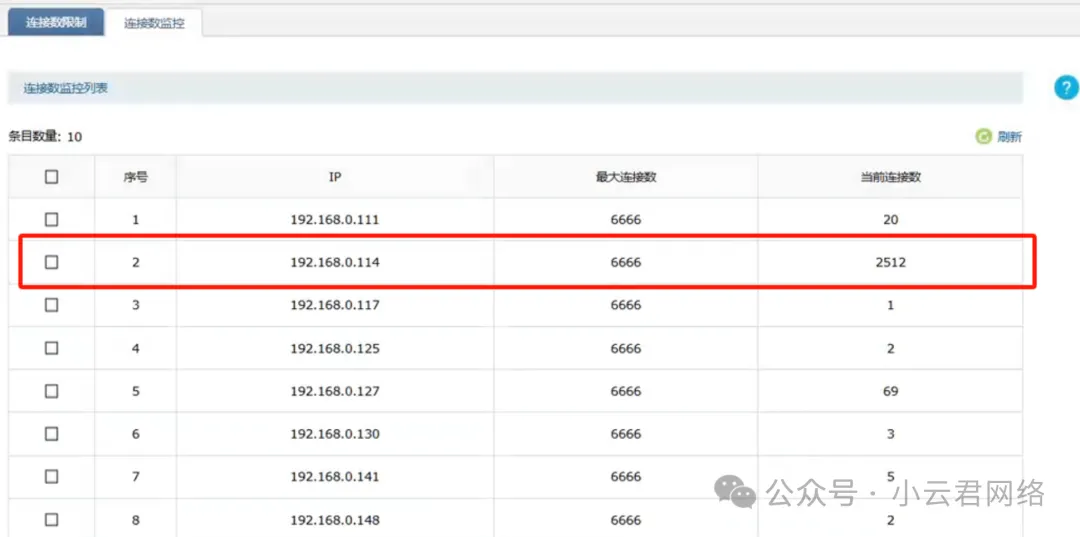

流量图清晰显示,该设备使用持续递增的源端口向目标地址发送SYN请求。路由器后台统计显示,其瞬时并发连接数突破2500。

根本原因浮出水面。该公司使用的家庭级宽带,其并发连接数上限通常在4000以内。单台设备瞬间占用2500多个连接,几乎耗尽整条宽带的连接数资源,导致其他终端无法建立新连接,全网卡顿由此产生。

根据IP与MAC地址溯源,最终定位故障源为一台办公室台式电脑。

与网管核实后发现,该电脑自动运行着一款“网络测试”软件,会不定期自动执行吞吐量及连接数压力测试。正是这些突发测试流量,在特定时刻冲垮了网络连接池,引发全网间歇性故障。关闭该软件后,网络立即恢复正常。

原理及解决方案

问题原因:内网一台台式电脑上自动运行的“网络测试”软件,不定期发起流量与连接数压力测试,耗尽了宽带并发连接数资源,导致整网性能瓶颈。

解决方案:

1. 紧急处置:立即终止问题电脑上的测试软件进程,并强化终端软件安装与行为监控策略,杜绝此类内部应用引发的网络风暴。

2. 策略预防:在路由器或网络管理平台上,为所有终端配置独立的流量整形与连接数限制策略。通过策略隔离,即使单终端异常,其影响也将被限制在局部,避免全网业务中断。

这就是实战案例:近期,客户单位无线网无规律卡顿,最后查出来竟然有人在跑......的全部内容了,希望以上内容对小伙伴们有所帮助,更多详情可以关注我们的菜鸟游戏和软件相关专区,更多攻略和教程等你发现!

专题合集

精彩合集,奇葩无下限相关文章

大家还在看

-

- 《异环》达芙蒂尔角色介绍-暗系近战主C详解

-

26-04-26

-

- 蓝色星原旅谣雷冠牦boss打法指南

-

26-04-26

-

- 一款被低估的小厂MMO,以最完美的方式关服了

-

26-04-26

-

- 《功夫熊猫:神龙大侠》隐秘洞穴玩法介绍

-

26-04-26

-

- 新版曙光英雄奇奇怎么玩-曙光英雄新版奇奇玩法攻略

-

26-04-26