HappyHorse-1.0 – 阿里ATH推出的AI视频生成模型

时间:26-04-28

HappyHorse-1.0快速摘要:

在AI视频生成领域,一个新名字正迅速成为焦点:HappyHorse-1.0。这款由阿里巴巴ATH创新事业部旗下未来生活实验室团队打造的模型,甫一登场便展现出强劲实力。它集文生视频、图生视频、视频编辑与音视频同步生成于一体,瞄准影视创作、广告与数字人生产等核心场景。其基于单流Transformer的架构设计,更是在权威的盲测排行榜中取得了领先地位。

免费影视、动漫、音乐、游戏、小说资源长期稳定更新! 👉 点此立即查看 👈

- 模型名称:HappyHorse-1.0(欢乐马)

- 开发公司:阿里巴巴集团ATH创新事业部,未来生活实验室团队负责研发

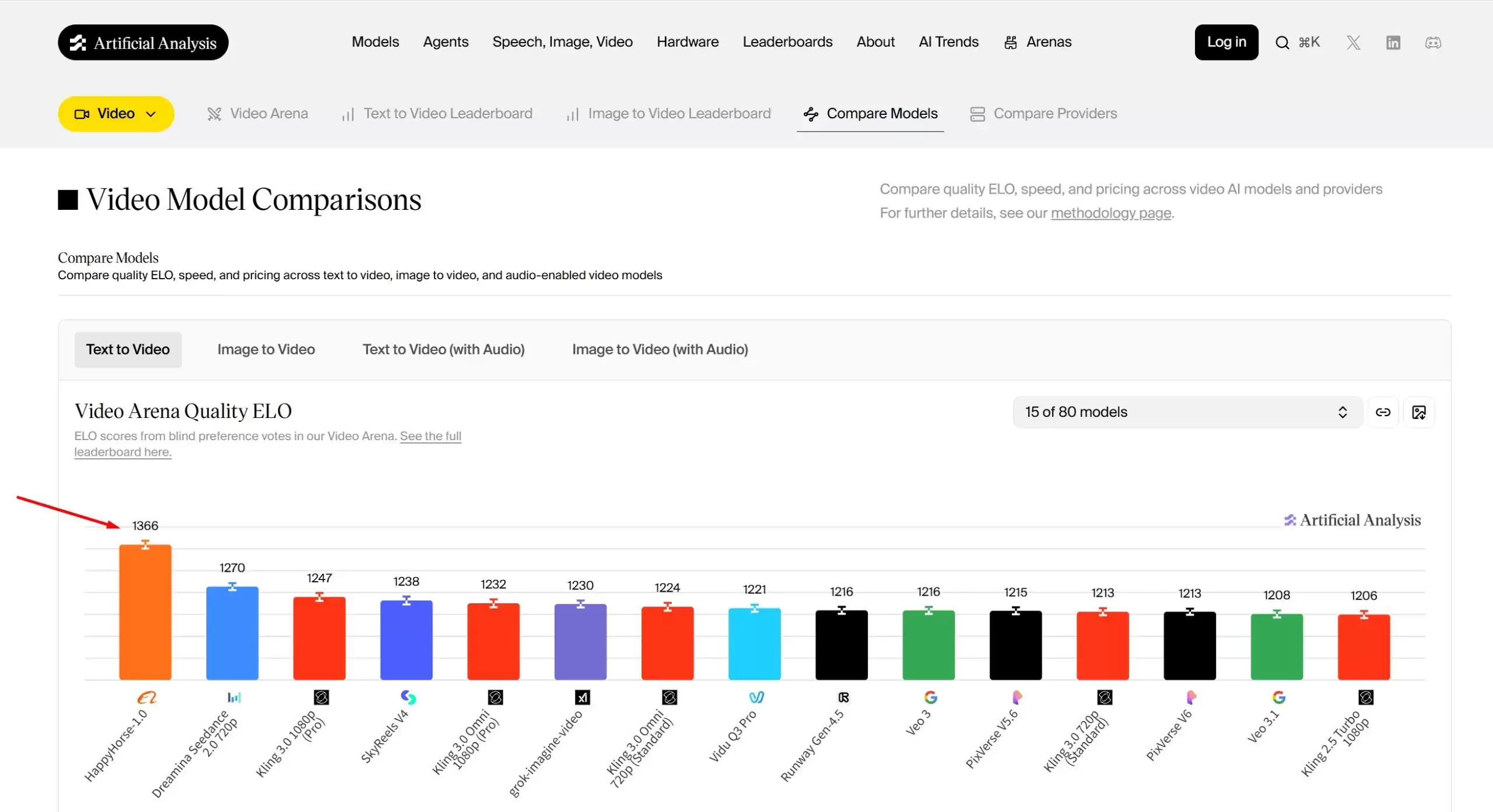

- 发布时间:2026年4月7日进入Artificial Analysis Video Arena榜单,次日即4月8日成功登顶

- 主要功能:支持文本生成视频、图像生成视频、视频编辑与音视频同步生成

- 参数规模:150亿参数单流Transformer模型,40层结构设计

- 技术特点:采用DMD-2蒸馏与8步去噪推理,无CFG机制

- 适用场景:AI短片制作、虚拟人生成、广告视频、影视分镜与多语言内容生成

- 开源与API:计划完全开源,并已在阿里百炼平台内测,API预计分阶段开放

- 价格信息:部分测试平台显示约$0.05/秒级生成成本(非官方最终定价)

HappyHorse-1.0的核心优势

那么,这款模型凭什么能迅速脱颖而出?关键在于以下几个技术突破,它们共同构成了其护城河。

- 盲测榜单断层领先优势:数据最有说服力。根据Artificial Analysis Video Arena的评测,HappyHorse-1.0在文生视频任务中获得约1333–1374的Elo分,在图生视频任务中更是达到1391–1410分,领先当时排名第二的Seedance 2.0约60分以上。这种优势并非偶然,其根源在于统一的生成架构显著提升了画面的一致性与用户偏好评分。

- 单流Transformer统一建模能力:传统多模态模型常面临“信息损耗”的难题。HappyHorse-1.0的解法是采用40层单流Self-Attention结构,将文本、图像、视频与音频token放在同一个序列里处理。这就好比将所有信息放在一个会议室里直接沟通,避免了跨部门传递造成的误解和延迟,从而在多模态融合误差和复杂场景的语义一致性、运动连贯性上表现更优。

- 极低步数高效推理机制:速度与成本是企业应用的生命线。模型基于DMD-2蒸馏技术,将扩散过程压缩至仅需8步去噪,且无需复杂的CFG引导。实际效果如何?在H100 GPU上生成一段5秒的1080P视频,耗时仅约38秒。这种效率提升,对于需要批量生成内容的企业级用户而言,意义重大。

- 原生音视频同步生成:音画不同步是许多AI生成内容的通病。HappyHorse-1.0从底层解决了这个问题,它在同一序列空间中生成音频与视频token,实现了口型、环境音与动作的同步输出。这对于数字人、短剧制作等多语言对话场景来说,能大幅降低后期对齐的成本和难度。

- 多语言与人物一致性优化:模型支持中、英、日、韩、德、法等7种语言的唇形同步。更重要的是,通过跨模态对齐机制,它在人物驱动类视频生成中,有效减少了令人头疼的面部漂移问题,使得人物表情在不同帧之间保持稳定。

HappyHorse-1.0的核心功能

技术优势最终要落地为具体功能。HappyHorse-1.0提供了一套相当全面的视频生成工具箱。

- 文本生成视频功能:用户只需输入如“雨夜城市航拍镜头”这样的描述,模型便能生成5-8秒具有电影质感的视频。其内部的时序Transformer能够建模动态场景,实现镜头运动与光影变化的自然过渡,非常适合用于广告创意预览或短视频脚本的快速验证。

- 图像驱动视频生成:给一张人物或产品图片,就能让它“动起来”。模型通过视觉token的时序扩展来保持主体的高度一致性,这项功能在电商产品展示或IP形象动画化场景中,能省去大量的重复建模工作。

- 视频编辑与风格迁移:对已有的视频素材不满意?模型支持对其进行风格转换,例如将写实风格转为动画风格,或增强电影感。它通过在潜空间进行内容重建来实现这一点,为后期创意剪辑和内容再创作提供了新思路。

- 音视频同步生成:这是其标志性功能之一。模型能在单次生成过程中,同时输出匹配的背景音效和人物对白,从根本上避免了传统后期配音可能产生的误差,确保环境声、语音节奏与画面动作浑然一体,尤其适合叙事类内容的创作。

- 多镜头叙事生成能力:不止于生成单一镜头。模型支持通过提示词驱动分镜结构,能在单次推理中完成推镜、切镜与场景转换,这无疑大大提高了影视前期分镜设计的效率和可视化程度。

HappyHorse-1.0的技术原理

光看功能还不够,理解其背后的技术原理,才能看清它的设计哲学与未来潜力。

- 单流Transformer架构设计:这是其技术基石。采用40层Self-Attention的统一结构,头尾各4层负责不同模态的投影,中间32层参数完全共享。这种设计让文本、视频、音频token在一个“熔炉”里共同训练,最大程度减少了跨模态间的误差传播。

- DMD-2蒸馏推理机制:为了实现高效推理,团队采用了分布匹配蒸馏技术,将原本需要数十甚至上百步的扩散过程压缩至区区8步。这就像找到了一条生成高质量视频的“捷径”,在几乎不损失质量的前提下,显著提升了推理速度与资源利用率。

- 多模态统一序列建模:所有输入,无论文本、图像、视频还是音频,都被转化为统一的token序列。随后,自注意力机制在这个统一的序列上进行联合建模,实现深度的跨模态信息共享与语义对齐,这是其理解力和一致性的来源。

- MagiCompiler推理优化系统:光有算法还不够,还需要强大的工程优化。该系统采用全图编译技术来优化GPU计算路径,在H100环境下能有效减少显存碎片,提高吞吐效率,最终将1080P视频的生成时间压缩到约38秒。

- 语言驱动唇形同步系统:为了实现精准的唇形同步,模型在训练阶段就将语音token与视觉表情token进行对齐。这套系统支持七种语言,使得生成数字人的口型能与语音节奏高度匹配,提升了表达的逼真度和自然感。

HappyHorse-1.0与主流模型对比

| 维度 | HappyHorse-1.0 | Seedance 2.0 | Kling 3.0 | PixVerse V6 |

|---|---|---|---|---|

| 文本到视频Elo | 1333–1374(榜首) | 1273(第二) | 1241 | 1239 |

| 图像到视频Elo | 1391–1410(榜首) | 1356 | 1297 | 1338 |

| 音视频能力 | 原生同步生成 | 支持音频生成 | 基础音频支持 | 有限音频支持 |

| 推理架构 | 40层单流Transformer | 多流DiT架构 | Omni多模态架构 | 扩散+Transformer混合 |

| 推理效率 | 8步去噪约38秒 | 未公开 | 较慢 | 中等 |

根据Artificial Analysis与财讯快报等多方信息对比,可以清晰地看到HappyHorse-1.0在盲测评分中建立的领先优势。这种优势的核心,正源于其统一的单流架构与极低步数的推理策略。当然,市场是多元的:Seedance 2.0在音频生成的稳定性上仍有其长处;Kling 3.0则在长视频生成与商业生态的成熟度方面底蕴更厚。整体来看,HappyHorse-1.0更像是一款追求极致性能的“研究型”模型,而竞品则更偏向于提供稳定成熟的商业化工具链。这种性能差异,既反映了架构复杂度和训练数据规模的不同,也体现了各大公司在攻克多模态生成难题时,所选择的不同技术路径。

如何使用HappyHorse-1.0

对于想要尝鲜或评估这款模型的用户,目前有几个主要的体验途径。

- 访问Artificial Analysis盲测平台:最直接的体验方式是打开Artificial Analysis官网,进入其Video Arena视频模型盲测区。该平台采用ELO竞技机制,匿名展示不同模型的生成结果,HappyHorse-1.0也参与其中。

- 参与视频盲测投票:在平台上,系统会随机展示两段由不同模型生成的匿名视频。你需要根据画质、动作连贯性、镜头稳定性等维度,判断哪段更优。你的每一次投票,都会影响模型的Elo评分。

- 查看模型归属结果:投票提交后,平台会揭晓两段视频对应的真实模型名称。如果其中一段恰好来自HappyHorse-1.0,你就能直观地看到它在文生视频或图生视频任务中的实际表现和评分。

- 理解平台使用限制:需要注意的是,Artificial Analysis平台主要用于模型对比和质量评估,不支持用户输入自定义提示词来生成视频。所有样本均为平台预置。

- 扩展体验渠道使用:除了盲测,还可以关注堆友平台、LibTV官网等渠道,它们可能提供首发接入入口。此外,灵犀AI也已集成该模型,可用于更实际的内容生成测试。

HappyHorse-1.0的局限性

当然,作为一款新锐模型,HappyHorse-1.0也存在一些当前的限制,这是评估其适用性时必须考虑的因素。

- API开放仍在分阶段:尽管已进入阿里百炼平台内测,但企业级API并未全面开放。这意味着普通开发者暂时还无法直接调用其完整能力,限制了即时生产力的释放。

- 高算力依赖明显:要流畅生成1080P视频,目前仍依赖H100级别的GPU资源。这对于算力预算有限的中小团队或个人开发者而言,部署成本较高,在消费级硬件上难以完全复现其宣称的性能。

- 长视频生成能力有限:从已公开的信息和演示来看,其能力焦点集中在5–15秒的短视频生成。在需要长时间叙事一致性的长视频生成方面,仍缺乏充分的验证和稳定的解决方案。

HappyHorse-1.0的典型应用场景

尽管存在限制,但其强大的能力已经在多个场景中展现出明确的应用价值。

- 虚拟数字人生成:输入人物形象与语音文本,即可输出口型同步的讲解视频。这对于虚拟主播、电商智能客服、品牌数字代言人等场景,能大幅降低制作门槛和成本。

- AI短剧制作:结合其分镜生成能力,制作方可以输入剧本大纲和角色设定,快速生成连续的视频片段,实现低成本、高效率的影视内容前期可视化和短片制作。

- 广告视频生成:营销人员只需输入产品描述和核心卖点文案,模型便能生成具有电影级质感的广告短片,极大提升内容营销的效率和创意迭代速度。

- 教育与科普内容:对于抽象的科学原理或历史过程,通过文字描述生成动态演示视频,能使教学和科普内容更加直观、生动。

- 多语言内容制作:凭借其七语言唇形同步能力,可以快速生成针对不同地区市场的本土化视频内容,为企业的跨境营销和全球化传播提供有力工具。

HappyHorse-1.0常见问题

HappyHorse-1.0是什么模型?

简单来说,HappyHorse-1.0是阿里巴巴推出的一款高性能AI视频生成模型。它不仅能根据文字或图片生成高质量短视频,还具备原生音视频同步生成的特色能力。凭借其创新的单流Transformer架构,它在多项盲测中取得了排名第一的成绩。

HappyHorse-1.0如何计费?

目前官方尚未公布统一的计费标准。根据部分测试平台的数据推测,生成成本大约在每秒0.05美元左右。最终的定价策略,需要等待阿里百炼平台正式开放API后才能确定,预计会采用按调用次数或生成时长等模式计费。

HappyHorse-1.0和Seedance 2.0哪个好?

这取决于你的具体需求。从盲测数据看,HappyHorse-1.0在生成视频的视觉质量上确实略胜一筹。但Seedance 2.0在音频生成的稳定性和整体商业方案的成熟度上可能更有优势。简单来说,前者偏向追求极致效果,后者偏向稳定可靠的生产工具。

HappyHorse-1.0支持实时生成吗?

目前还不支持。它的工作模式主要是“离线生成”,通过8步去噪过程来保证视频质量。因此,它更适用于短视频制作、广告创意等对实时性要求不高的场景,而非直播等需要实时流式生成的场合。

HappyHorse-1.0有免费使用方式吗?

目前,像Artificial Analysis这样的盲测平台可以提供免费的体验和对比。一些集成了该模型的设计工具也可能提供有限的免费额度。但要获得完整、稳定的API服务,未来很可能主要面向企业级用户。是否会推出个人免费层,还需关注阿里百炼平台的正式政策。

这就是HappyHorse-1.0 – 阿里ATH推出的AI视频生成模型的全部内容了,希望以上内容对小伙伴们有所帮助,更多详情可以关注我们的菜鸟游戏和软件相关专区,更多攻略和教程等你发现!

专题合集

精彩合集,奇葩无下限相关文章

大家还在看

-

- y8游戏网页版入口官网

-

26-04-28

-

- 《大江湖之苍龙与白鸟》新人实用小技巧

-

26-04-28

-

- 无尽探险队火焰流派怎么玩

-

26-04-28

-

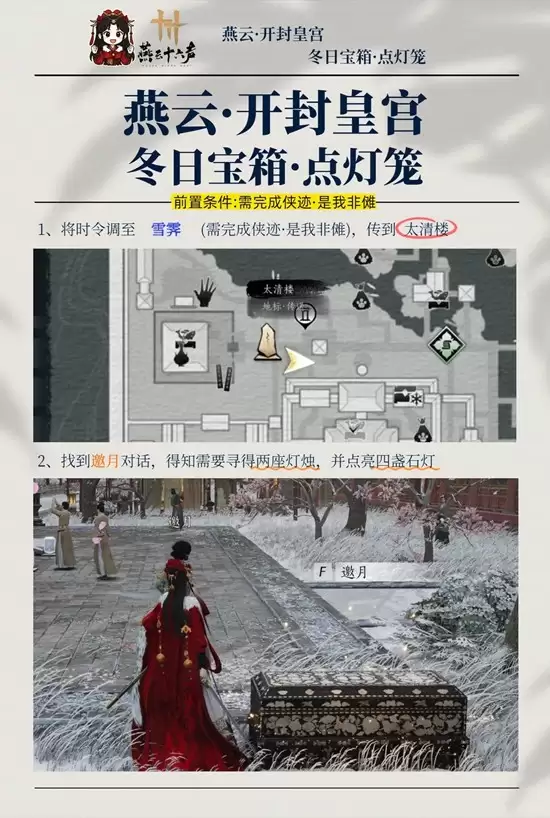

- 《燕云十六声》新春冬日宝点灯笼拿取攻略

-

26-04-28

-

- 《灵兽大冒险》貔貅技能介绍

-

26-04-28