搜对≠答对:EAPO用“证据奖励”让大模型不再靠猜

搜对≠答对:EAPO用“证据奖励”让大模型不再靠猜

如今,AI搜索技术已经能把全网资料一股脑儿塞进几百万Token的上下文里,大模型的任务似乎很简单:从这堆信息里找出正确答案就行。

但现实常常让人哭笑不得:正确的资料明明就摆在眼前,模型要么答错,要么答案碰巧蒙对了,可仔细一看,它引用的证据却全是错的。

问题到底出在哪儿?

根源在于奖励机制——现有的强化学习只盯着最终答案。只要答案猜对了,模型就能拿到奖励,至于过程对不对,它并不关心。

阿里通义实验室的研究团队最近提出一个全新的强化学习框架:EAPO(Evidence-Augmented Policy Optimization)。这个框架引入了一个关键概念——“证据奖励”,把监督的焦点从“答案”下沉到了“寻找证据”的过程中。

这项工作已被自然语言处理顶级会议ACL 2026录用,并在多个权威的长文本基准测试中取得了优异成绩,甚至让一个300亿参数的模型在长文本推理上,反超了1200亿参数的GPT-OSS和Claude-Sonnet-4。

论文地址:https://arxiv.org/abs/2601.10306

面对海量搜索结果,大模型是怎么“翻车”的?

先来看一个具体的例子:

提问:周杰伦在2005-2010年间,演唱的歌曲中,有几首获得过金曲奖提名?

理想的检索推理流程应该是这样的:

根据检索回来的详实资料,正确答案应该是12首。

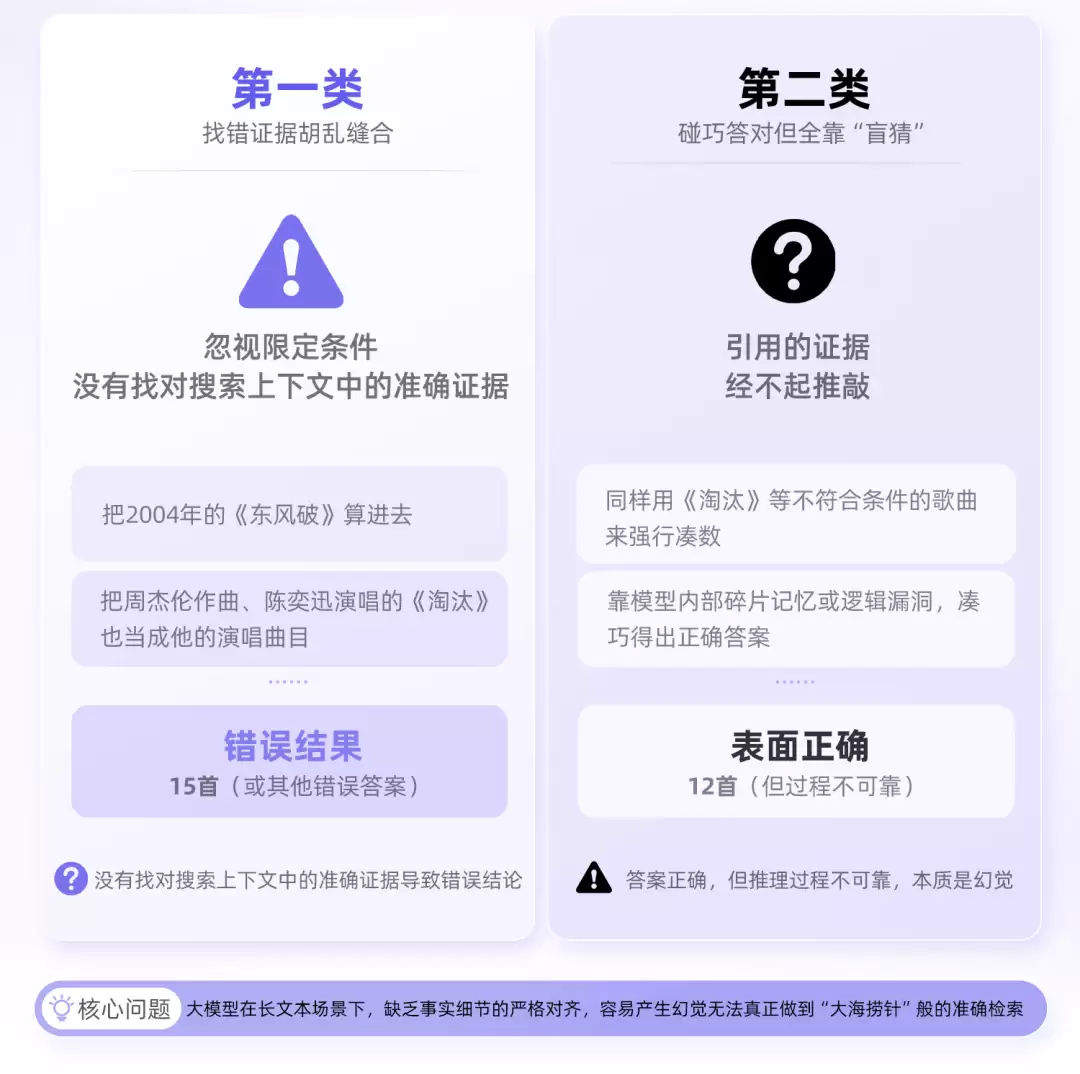

但在处理这种信息噪音极高的任务时,大模型通常有两种“翻车”姿势:

第一种是直接答错:比如回答15首。因为它可能把2004年的《东风破》,或者周杰伦只作曲并未演唱的《淘汰》都算了进去。

第二种是“蒙对”:答案确实是12首,数字对了。可仔细检查它的推理过程,引用的关键证据却是《淘汰》这首歌。

发现问题了吗?无论是哪种情况,模型都没有真正执行那项“大海捞针”般的精准证据提取工作。

这种脱离证据的推理,正是大模型在面对长文本时最容易犯的典型幻觉。

证据质量,到底有多关键?

为了验证“证据质量”究竟有多重要,研究团队做了一个预实验。

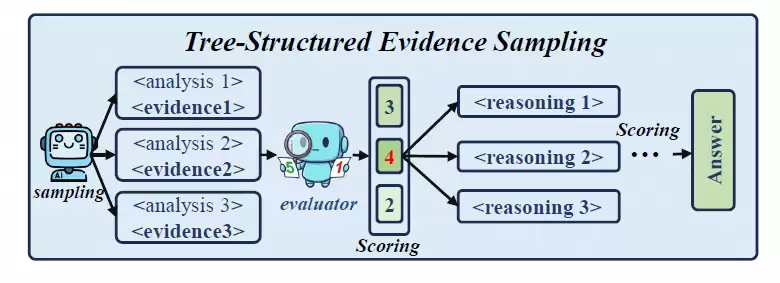

他们设计了一种“树状证据采样”方法(如下图),让模型针对同一个问题生成多条不同的证据提取路径,再分别评估每条路径的质量和最终表现,看看究竟是哪一步决定了成败。

实验数据揭示了一个清晰的结论:找到对的证据,几乎就等于找到了对的答案。

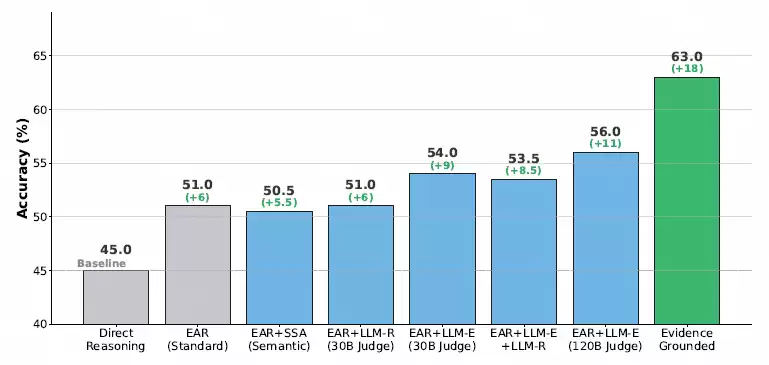

数据显示,如果直接把高质量证据“喂”给模型做推理,结果准确率会从45%飙升到63%。反之,如果证据找得一塌糊涂,那么无论怎么优化后续的推理步骤,性能也几乎毫无起色。

EAPO:一套自我进化的强化学习框架

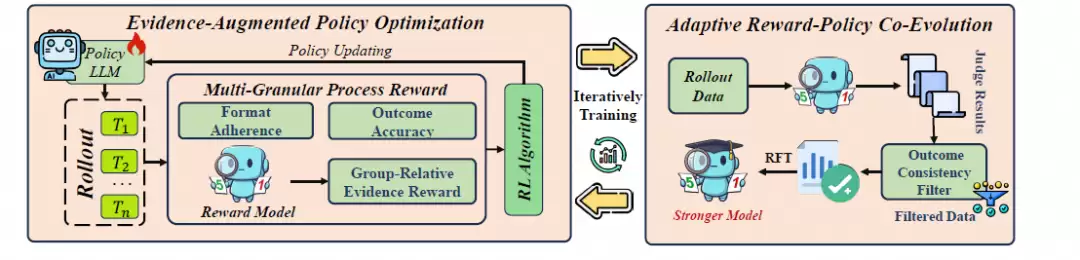

基于上述发现,研究团队设计了一套自我进化的闭环强化学习框架——EAPO。

(1)建立证据增强推理范式

研究团队强制模型执行一个严格的4步工作流:分析问题 -> 提取原文证据 -> 执行推理 -> 给出答案。这种结构化的格式让每一步都“透明可查”,尤其是中间的证据环节,从此可以被直接监督和评估。

(2)细粒度打分,引入群组相对证据奖励

传统强化学习只在最终答案上给一个稀疏的奖励信号,而EAPO构建了一个过程奖励模型。

在训练时,模型会对同一个问题生成多个不同的证据组合。奖励模型会对比这些证据,给那些引用最精准、最具决定性作用的证据打高分。这种密集的“过程监督”,让模型彻底明白了“找对证据”远比“蒙对答案”更重要。

(3)奖励模型与策略模型的协同进化

如果奖励模型停滞不前,随着大模型越来越聪明,固定的评判标准迟早会分辨不出证据之间那些微妙的好坏差异。

EAPO巧妙地设计了一个“自适应协同进化”机制:大模型在训练中生成的那些高置信度、且最终答案完全正确的优质证据链,会被反哺给奖励模型进行微调。

这样一来,就形成了一个良性循环:大模型越强,生成的训练数据就越好;奖励模型的评判眼光越毒辣,反过来又能指导大模型提炼出更精准的证据。

从“立规矩”到“打分数”,再到“同进化”,EAPO让强化学习的激励信号落在了证据本身,使得模型的每一次推理都有迹可循。

效果如何?数据说话

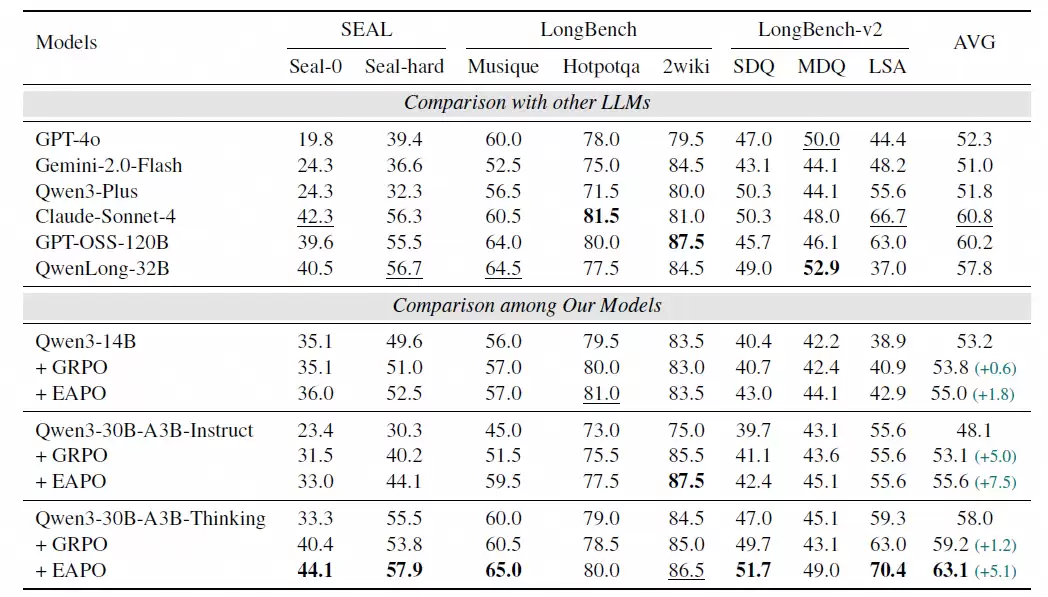

团队在SEAL、LongBench-V1/V2等包含8个长文本推理基准上进行了全面评测:

基于Qwen3-30B-Thinking训练的EAPO模型,平均得分达到63.1%,性能相较基线提升了5.1%。更值得注意的是,它击败了体量大得多的开源模型GPT-OSS-120B,甚至超越了GPT-4o、Claude-Sonnet-4等闭源大模型。

为了深入验证这套设计的有效性,团队对模型训练时的轨迹进行了“切片”分析:

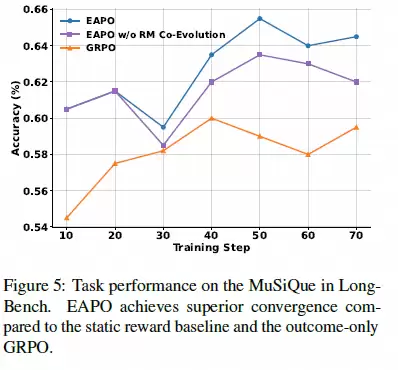

▶ 收敛更快,天花板更高

从准确率趋势图可以明显看出,只关注最终结果的GRPO方法不仅学得慢,而且提升很快遇到瓶颈。在引入证据过程打分后,模型学习速度显著加快;而加上“协同进化”机制后,模型的准确率更是突破了原有瓶颈,持续攀升。

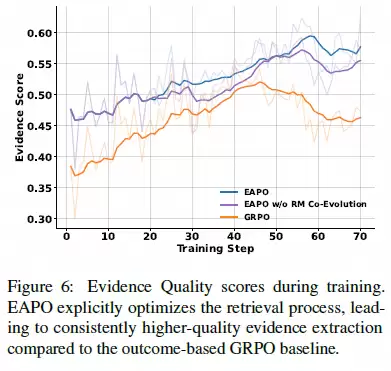

▶ “找证据”能力断崖式领先

从训练过程中的“证据质量得分”来看,GRPO隐式地优化证据,提升非常缓慢;而EAPO直接针对证据质量打分,其寻找证据的能力始终保持着断崖式的领先优势。

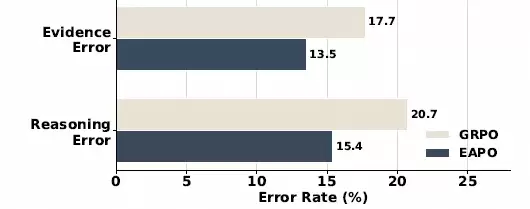

为了进一步探究EAPO究竟改善了模型的哪些方面,团队把失败案例拆成两类进行错误分析:一类是没找到或找错证据的“证据错误”,另一类是证据对了但逻辑推理出错的“推理错误”。

对比EAPO和传统GRPO的表现:

- 证据错误率:从17.7%降到了13.5%

- 推理错误率:从20.7%降到了15.4%

EAPO实现了两类错误的双降。有意思的是,它并没有显式地监督推理步骤,但推理错误率几乎下降了同样的幅度。这恰恰说明,推理本身或许没那么难,它只是经常被错误的证据带偏了方向。一旦前提是对的,结论自然就容易对了。

结语

AI搜索和Search Agent解决了“把海量资料搬回来”的问题,然而,信息越多,模型“走捷径”的空间就越大;上下文越长,“假装读过”的成本就越低。只奖励结果的强化学习,恰恰在无形中放任了这种投机行为。

在长文本时代,大模型不能只做一个对着海量检索结果囫囵吞枣的“速读者”,更需要成为一个严谨、言必有据的“考据派”。

EAPO框架打破了长文本强化学习只能依赖“结果奖励”的稀疏性瓶颈。它找到了一个可以明确评价的过程节点——证据提取,并围绕它建立了一整套可持续进化的监督机制。这让每一次推理都有迹可循,让每一个结论都经得起追问:你的依据是什么?

? 今日互动

你有没有被大模型“睁眼说瞎话”过?

评论区聊聊:你遇到过大模型资料明明给对了,却依然答错的瞬间吗?是哪类问题最容易翻车?抽取3位送定制周边~

近期活动推荐