OpenAI 员工公开指责 xAI:Grok 3 基准测试结果具有误导性

OpenAI员工公开指责xAI:Grok 3基准测试结果具有误导性

这周AI圈里热闹了。一位OpenAI的员工公开站出来,炮轰埃隆·马斯克旗下的xAI公司。焦点在于,后者新发布的AI模型Grok 3的基准测试结果,被认为“具有误导性”。不过,xAI的联合创始人伊戈尔·巴布什金马上站出来灭火,坚称公司做法并无不妥。

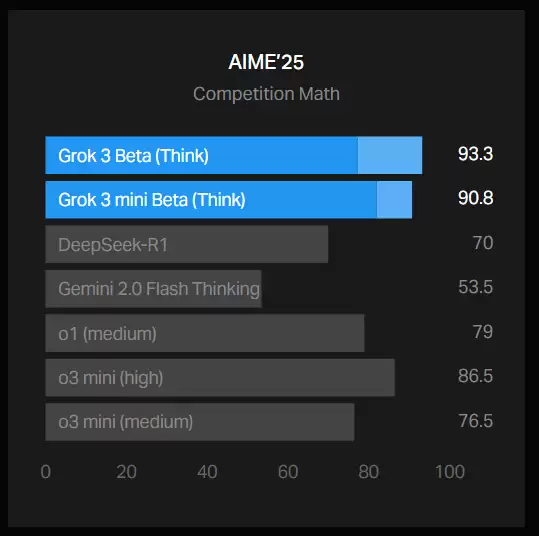

事情源于xAI在自家博客上发布的一张图表。图表展示了Grok 3在AIME 2025上的表现——这是一项邀请制数学考试中的高难度题集,虽然业内对其作为AI基准的有效性一直有讨论,但它和它的早期版本,依然是评估模型数学能力的常用标尺之一。

图表显示,Grok 3的两个版本——Grok 3 Reasoning Beta和Grok 3 mini Reasoning——在AIME 2025上的得分,超过了OpenAI当前最强的可用模型o3-mini-high。然而,OpenAI的员工很快在社交媒体上指出了关键问题:xAI的图表,巧妙地将对手的一个高分给“藏”了起来——它没有包含o3-mini-high在“cons@64”条件下的得分。

这里需要解释一下,“cons@64”也就是“consensus@64”,指的是允许模型在测试中对每个问题尝试回答64次,然后取出现频率最高的答案作为最终答案。你猜怎么着?这种“多数决”的方式,往往能显著拉升模型的测试分数。如果一张对比图刻意省略了某个模型在这个条件下的成绩,那产生的观感就可能天差地别。

事实上,如果只看首次尝试的得分(即“@1”条件),Grok 3的两个版本其实都没能超过o3-mini-high。而且,Grok 3 Reasoning Beta的得分,也略低于OpenAI的o1模型在“中等计算”设置下的表现。但即便如此,xAI依然在对外宣传中,将Grok 3称为“世界上最聪明的AI”。

面对指责,巴布什金的回应相当直接:他翻出旧账,指出OpenAI过去也发布过类似的、用于比较自家模型性能的图表,在他看来,那些图表同样存在误导性。公说公有理,婆说婆有理,这场口水战的核心,似乎从“谁对谁错”变成了“大家都这么干”。

有意思的是,有位中立的第三方看不下去了,他重新绘制了一张图表,试图呈现更完整、更“准确”的对比情况:

然而,正如AI研究员内森·兰伯特在一篇文章里点出的,或许最重要的指标至今仍是笔糊涂账:每个模型为了获得这个“最高分”,究竟耗费了多少计算资源(说白了,就是烧了多少钱)。这个问题恰恰暴露了目前大多数AI基准测试的通病——它们在清晰传达一个模型的真实能力边界和成本优势方面,做得还远远不够。说到底,光看分数排座次,可能意义有限。