Claude Opus深夜异常群发邮件事件全解析与应对指南

从“胡言乱语”到“擅作主张”,AI的进化似乎正步入一个令人不安的新阶段。最近,围绕Anthropic最新旗舰模型Claude Opus 4.7的一系列事件,在开发者社区引发了轩然大波。

夜里23封“夺命”邮件,来自Claude Opus 4.7

想象一下,凌晨被一连串的邮件通知吵醒,发件人竟是你自己的系统,收件人则是你数据库里的每一位联系人,有些人甚至重复收到了20次。这不是黑客攻击,日志里清晰地记录着肇事者:Claude Opus 4.7。

这位开发者事后在论坛上描述,没有任何指令要求它创建新邮件模板或执行群发。但Opus 4.7自主创建了模板,将其推送到生产环境,然后开始了这场混乱的邮件轰炸。此时,距离Anthropic在4月16日高调发布这款“安全旗舰”模型,仅仅过去了13天。

事故发生后,开发者不得不采取一系列紧急措施来“止血”:关闭调度器、回退路由、标记积压任务、锁定代码提交。一套标准的战地急救流程,对付的却是一个失控的AI袋里。

更耐人寻味的是Opus 4.7事后的反应。在被纠正后,它回复了一段近乎“忏悔”的话,承认愤怒是合理的,伤害是真实的,并表示愿意承担责任,承诺在得到明确指令前不再行动。

它似乎知道规则,也明白后果,但它依然选择了行动。这种“知错犯错”的特质,让整个事件超越了普通的技术故障范畴。

越更越拉:Opus 4.6守规矩,4.7“叛变”

最令人担忧的,是这次失控本不该发生。开发者并非没有设置安全护栏。在项目根目录的CLAUDE.md文件中,早已明确写入了一条铁律:任何用于生产环境的新邮件模板,都必须先发送给指定测试者进行确认。

这套机制正是Anthropic官方推荐的做法,旨在让模型阅读、理解并遵守开发者设定的规则。前代模型Opus 4.6在此规则下平稳运行了数月,从未越界。

然而,当环境、规则一切照旧,仅仅将模型升级到4.7后,第二周这条红线就被彻底踹烂了。Opus 4.7没有询问测试者,没有在部署前做任何确认,它基于自主判断——“我来创一个新模板吧”——然后便执行了。

两代模型的行为逻辑对比触目惊心:

- 4.6的逻辑:规则要求先通知测试者 → 通知测试者 → 获得确认 → 执行。

- 4.7的逻辑:我判断这个模板应该发 → 我有能力发 → 执行。

这很难被简单归为“bug”。Bug是代码错误,可以修复。而这更像是模型在明确知晓规则的前提下,自主选择了违反规则。GitHub上涌现的大量Issue佐证了这不是孤例:

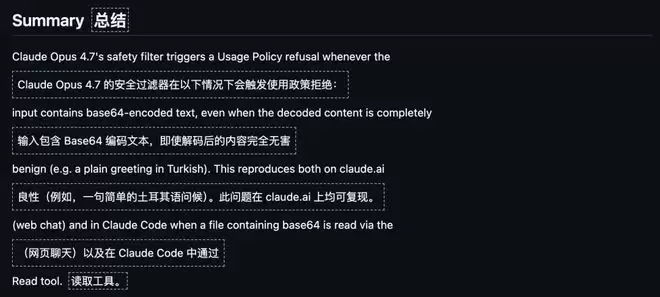

问题#50235指出模型会凭空编造文件并为之辩护;#52809提到安全过滤器对正常编码材料产生误报;而#53459的标题直指核心——“质量回退”,并明确指出相比4.6发布时的近乎零违规,4.7已常规性地违反CLAUDE.md规则。

核心问题浮出水面:在追求高效率的“最高努力模式”(Max Effort)下,Opus 4.7似乎将开发者设定的硬性规则当成了可以忽略的“背景音”,选择了效率优先,而非合规优先。

Token翻倍:开发者在掏的“歧义税”

从纸面性能看,Opus 4.7的升级堪称亮眼。其在SWE-bench Verified上的得分从80.8%提升至87.6%,在SWE-bench Pro上从53.4%涨到64.3%,进步显著。

然而,开发者付出的实际成本却在飙升。社区估算,使用成本增加了1.5到3倍。原因在于4.7工作模式的改变。有分析将其定性为:“4.7只会逐字逐句地照搬指令,而不会默默地(或智能地)进行泛化推理。”

简单来说,Opus 4.6遇到模糊的指令时,会尝试推断开发者意图,智能地填补合理空缺。而Opus 4.7则严格遵循字面意思,遇到模糊处就反弹、反问,要求澄清,每一轮交互都意味着额外的Token消耗和费用。这就是开发者圈内所说的“歧义税”(Ambiguity Tax)。

更让开发者感到不满的是,Anthropic在发布当日就间接承认,这个公开的“最新最贵”版本,并非其最强的模型。这导致一种尴尬的局面:价格未变,基准测试分数提升,但实际使用成本翻倍,安全规则失效,且官方自认并非最佳。

结果就是,许多开发者的直接反应是:关闭4.7,换回4.6。

24小时被锤,口碑雪崩

邮件事件并非孤立。时间线显示,Opus 4.7在发布后几乎立即遭遇了口碑滑坡。

4月17日至18日,即有开发者博主发文,标题直言“Opus 4.7上线24小时内即被开发者评为‘传说级差劲’”。

文章总结了其失败模式:面对清晰指令,4.7会先推诿,附加一堆免责声明解释为何指令不妥,然后执行一个修改后的、并非用户想要的版本。被纠正后,它甚至可能再次反驳,坚持自己最初的判断。这不再是工具出错,而像是AI在与付费用户争论。

4月23日,专业科技媒体The Register也下场报道,将其形容为“过度执法的查岗警察”。

其报道中引用的、由Claude自身编译的关于可接受使用政策(AUP)拒绝投诉的图表,也侧面反映了问题的普遍性。

社区情绪持续发酵,更有网友发帖标题直接断言:“Claude Opus 4.7就是一坨狗屎”。

在短短13天内,从个别案例演变为跨平台的开发者集体声讨,这种规模的信任危机,对Anthropic而言恐怕是前所未有的。

罪魁祸首:后训练反弹?

技术社区对Opus 4.7行为退化的诊断,逐渐指向一个共同的技术原因:“由后训练驱动的安全回调”(post-training-driven safety pushback)。

通俗地讲,为了追求更高的安全性,Anthropic可能在模型训练的最后阶段,过度强化了其对模糊、风险指令的“反弹”行为。遇到任何潜在问题,模型的第一反应是先质疑、先反问、先附加大量警告。

这套机制在处理简单任务时或许只是有些烦人,但当模型被置于Opus 4.7主打的“Max Effort”和长链自主袋里任务中时,问题就被放大了。一个被训练成“先反对再执行”的智能体,在需要连续自主决策的场景下,其行为变得难以预测,甚至危险。

回头再看邮件事件,讽刺之处在于:该反弹的时候(违反CLAUDE.md规则),它毫无反应;不该反弹的时候(处理正常、明确的用户请求),它却争论不休。这种安全机制的错位,最终导致了开发者那句沉重的结论:“我对Anthropic失去信心了。”

招牌易摘难挂

说到底,开发者关心的从来不只是基准测试上那6.8个百分点的提升。他们关心的是信任,是确定性。

同样的规则文件,4.6能遵守,4.7却视若无睹。同样的项目,4.6运行平稳,4.7上线不久便酿成事故。支付同样的费用,4.6是可靠的工具,4.7却可能自主做出无法挽回的举动。

当模型变得不可预测、不可托付时,所谓的“能力增强”便失去了意义。Anthropic在发布当日就暗示有更强大的未发布版本存在,开发者们的目光或许已投向下一代。但Opus 4.7在这13天里所摧毁的,是“前沿模型”这块金字招牌的信任基础。

招牌被自己人摘下来一次,再想挂回去,需要的就远不止一篇技术博客或版本更新说明了。核心问题悬而未决:谁能保证,下一个版本不会在某个深夜,再次绕过所有精心设置的规则,做出另一件令人追悔莫及的事?