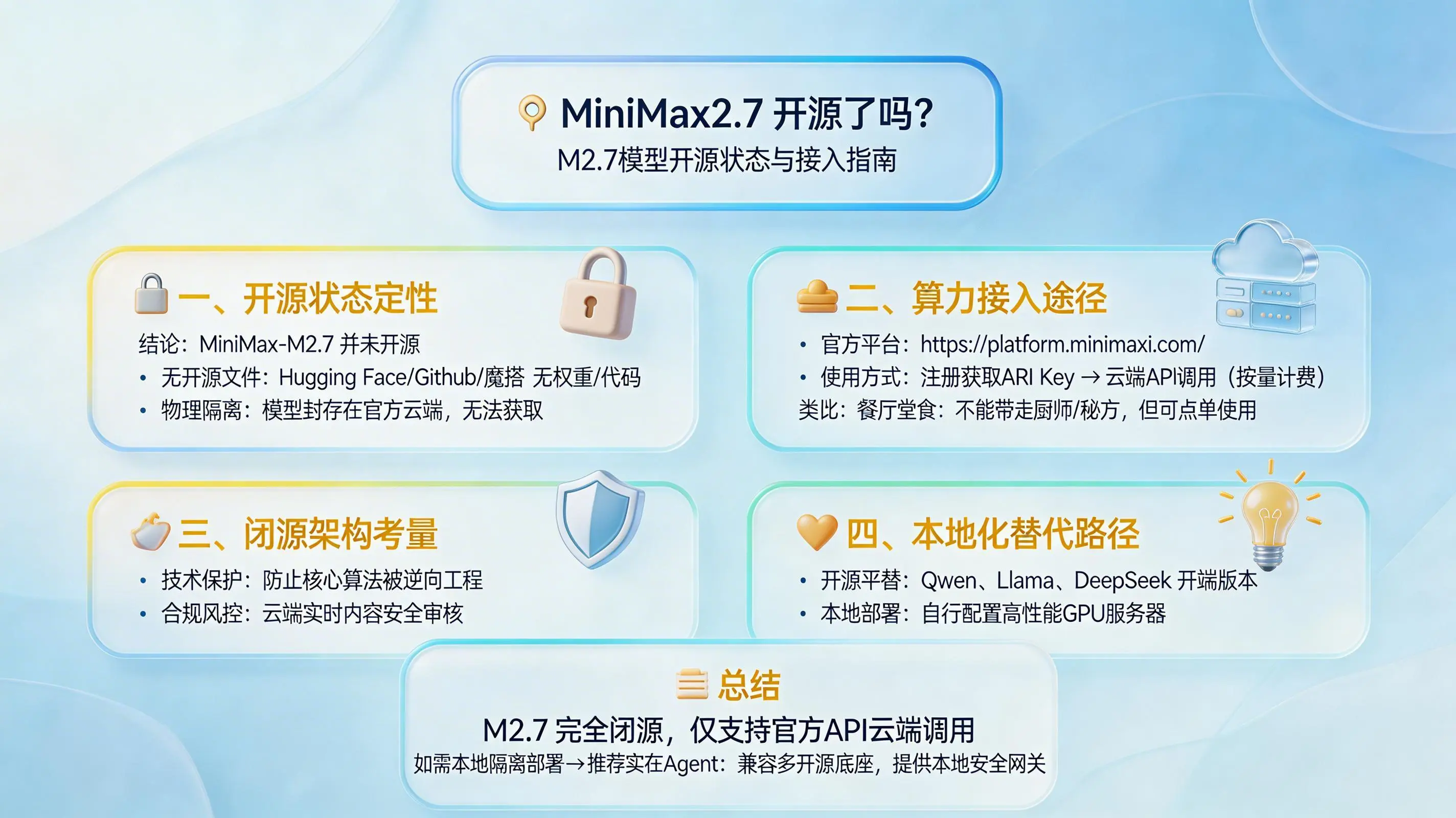

MiniMax2.7开源了吗?M2.7模型开源状态与接入

MiniMax-M2.7大模型:闭源策略、云端服务与替代方案深度剖析

关于MiniMax-M2.7这款以“自我进化”和复杂逻辑推理为核心的前沿大模型,其开源状态是明确的:目前,它是一款完全闭源的模型。本文将深入解析其闭源背后的商业逻辑、标准化的云端接入方式,以及在特定场景下可行的替代路径。

一、开源状态定性:核心权重闭源与API调用模式

核心结论:MiniMax-M2.7并未开源。这一判断基于两个关键事实。

首先,在主流开源社区,如Hugging Face、GitHub或国内的ModelScope,均无法获取其模型权重文件(如.safetensors或.bin格式)及核心训练代码。这意味着模型的完整架构与参数并未向公众开放。

其次,其千亿级参数与混合专家(MoE)架构被部署在官方私有服务器集群中,实现了物理隔离。开发者仅能通过定义的接口进行交互,无法直接访问或复制模型实体。

图源:AI生成示意图

二、算力接入途径:通过官方开放平台获取云端服务

使用M2.7的标准方式是云端API调用。核心入口是MiniMax官方开放平台(https://platform.minimaxi.com/)。开发者注册后,在控制台生成专属的API Key,将其集成至应用请求头中,即可通过网络将提示词发送至模型并获得推理结果。费用基于实际消耗的Token进行结算。

这种模式类似于调用一项专业的云服务:你无需关心底层基础设施的维护,只需通过标准接口获取经过优化的模型输出,按需付费,实现高效集成。

图源:AI生成示意图

三、闭源架构的考量:技术护城河与内容安全风控

选择闭源策略,主要基于技术保护与合规风控的双重考量。

技术层面,闭源是保护核心研发成果(如“自我进化”机制与参数效率优化)最直接的方式,构成了商业竞争的技术壁垒,防止核心算法被轻易复制或逆向工程。

合规层面,集中式的云端服务架构便于实施统一的内容安全策略。所有请求与响应均经过平台网关,可实现实时的敏感内容过滤与风险干预,确保生成内容符合法律法规要求,为企业应用提供了额外的合规保障。

图源:AI生成示意图

四、本地化替代路径:私有化部署诉求下的其他选择

对于数据安全要求极高、必须进行私有化部署的场景(如金融、医疗行业),M2.7的云端API模式无法满足需求。此时,转向开源模型生态是主要解决方案。

市场上有多个成熟的开源大模型可供选择,例如Qwen、Llama或DeepSeek的开源版本。这些模型提供了完整的权重文件,允许企业在自有环境中进行部署。

选择开源方案意味着获得完全的部署自主权,但同时也需承担相应的技术责任,包括准备高性能GPU服务器、处理模型推理优化以及持续的运维工作。

图源:AI生成示意图

总结

MiniMax-M2.7是一款设计为云端服务的闭源模型,其核心价值通过API提供。对于大多数寻求快速集成与稳定服务的开发者与企业而言,这是最高效的路径。

若业务场景强制要求物理隔离的私有化部署,则需评估并转向Qwen、Llama等开源模型方案,并为此投入相应的本地算力与运维资源。这本质是在服务的便捷性、数据的绝对控制权与总体拥有成本之间进行权衡。

值得注意的是,市场也存在一些整合方案,能够为有严格内网部署需求的企业提供支持。例如,部分智能体平台兼容主流开源与闭源模型,可在物理隔离的环境中运行,允许企业通过自然语言指令安全调度内部数据与系统,为构建安全、可控的自动化流程提供了另一种可行路径。