Qwen3.6-Plus需要多大显存?本地化部署的硬件选

Qwen3.6-Plus本地部署:显存需求的精算逻辑

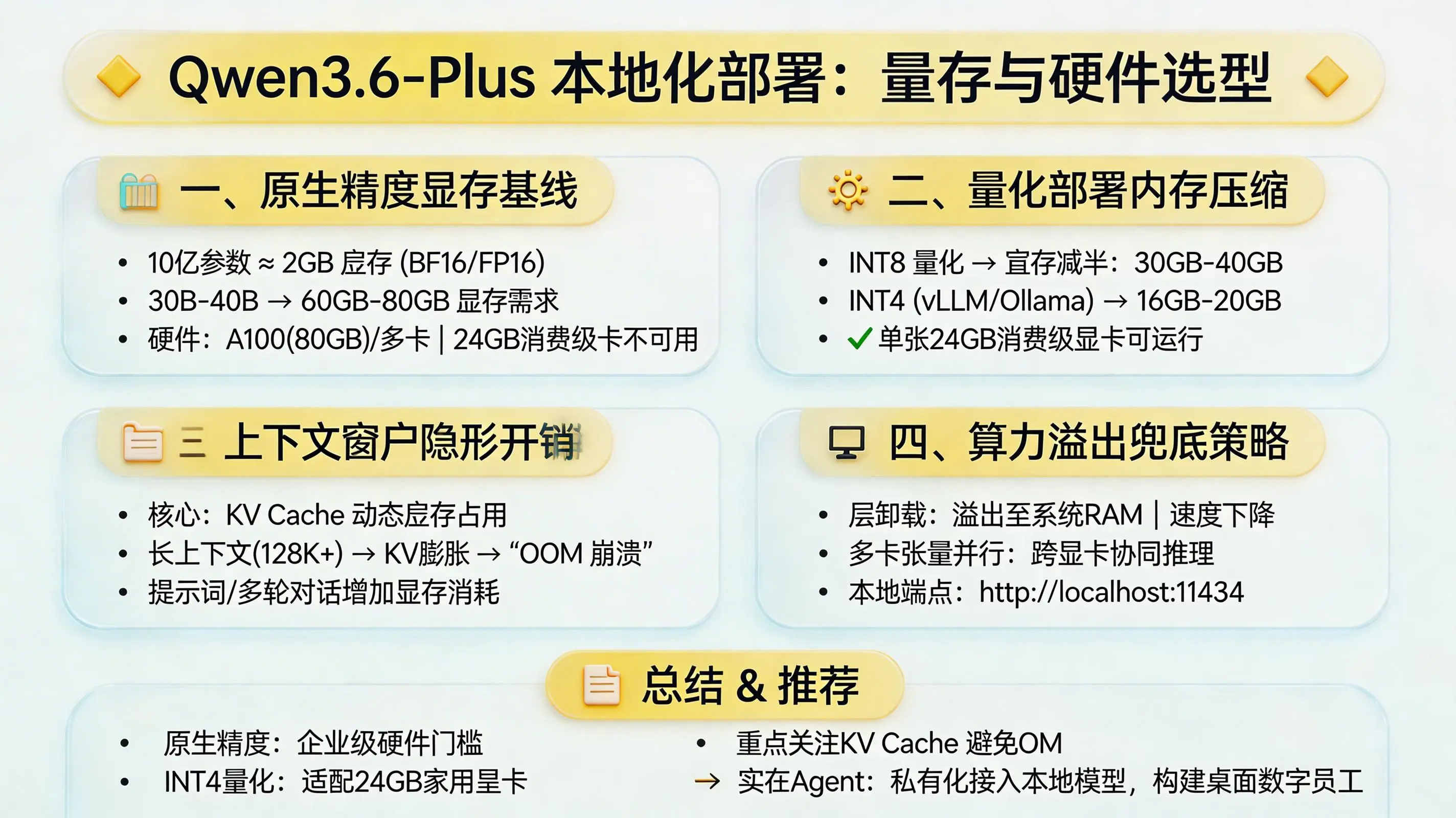

在通义千问模型系列中,Qwen3.6-Plus定位独特。它以中等参数规模,实现了接近上一代超大模型的复杂逻辑推理与代码生成性能。这种“小体量、高能力”的特性,使其成为开发团队与企业在私有化部署时的重点评估对象。然而,将其成功部署至本地环境,首要解决的核心技术门槛便是显存资源的精确评估。本文将深入拆解其显存占用的计算逻辑。

本文大纲

一、原生精度显存基线:无损运行的物理底线

二、量化部署的内存压缩:INT8 与 INT4 的断崖式降本

三、上下文窗口的隐形开销:动态缓存对显存的侵占

四、算力溢出与兜底策略:多卡并联与内存卸载

一、原生精度显存基线:无损的代价

精确评估显存需求,起点是模型加载的精度选择。若要求完全无损的原始性能,在BF16或FP16半精度格式下,模型参数与显存占用遵循确定的物理规律。

参数映射:核心计算规则是,每10亿(1B)参数约需2GB物理显存。据此推算,若Qwen3.6-Plus参数量在300亿至400亿区间,仅完整加载模型权重一项,静态显存门槛就高达60GB-80GB。

硬件落点:这一数字的现实意义在于,它超出了单张消费级旗舰显卡(如24GB的RTX 4090)的承载能力。部署方案直接指向配备大显存的企业级计算卡(如80GB的A100)或多卡集群。这是为保全模型原始性能所必须支付的硬件成本。

二、量化部署的内存压缩:降本的艺术

对于多数实际部署场景,完全无损并非刚性需求。通过量化技术,以极小的精度损失换取显存占用的大幅降低,是实现成本可控的关键路径。

INT8量化:将模型权重转换为8位整数格式,显存需求可近似减半。前述模型的加载显存可降至30GB-40GB范围。

INT4量化:采用vLLM、Ollama等推理框架支持的4位量化技术,显存占用将出现断崖式下降,压缩至约16GB-20GB。

结论明确:在INT4量化模式下,一张显存为24GB的高端消费级显卡已足以承载并流畅运行该模型。量化是降低大模型私有化部署门槛的核心技术。

三、上下文窗口的隐形开销:沉默的成本杀手

显存评估中,静态权重仅是冰山一角。决定系统在长序列推理中是否稳定的关键,是水下的部分——KV Cache(键值缓存)。

动态侵占机制:随着输入提示词(Prompt)长度增加或进行多轮对话,系统需动态分配显存来存储当前会话的上下文信息。这部分开销是实时变化的。

边界风险:这是最易被忽视的风险点。若将上下文长度(Context Length)设置为128K或更高,KV Cache占用的显存可能急剧膨胀,甚至超过模型权重本身。许多推理过程中触发的OOM(内存溢出)错误,根源即在于此。配置时必须对此“沉默的成本杀手”预留足够余量。

四、算力溢出与兜底策略:最后的防线

当显存资源临近极限时,仍有底层调度策略可作为最终保障。

层卸载(Offload):在本地端点(例如配置http://localhost:11434)部署时,可启用层卸载功能。该机制允许系统将部分模型层临时交换至系统内存(RAM),从而突破显卡显存容量限制。代价是推理延迟会增加,生成速度可能变慢。

多卡张量并行:这是更标准的企业级解决方案。通过PCIe或NVLink互联,将模型计算图与参数均匀分割至多张显卡并行处理。此方案不仅能聚合显存容量,也是保障长文本处理时高吞吐性能的关键技术。

总结

部署Qwen3.6-Plus的显存账目清晰:原生精度下属于企业级硬件范畴;而通过INT4量化,可将其压缩至单张高端消费卡的可运行范围。实际部署中,必须将KV Cache的动态消耗作为核心风险进行管控,合理设置上下文长度以避免显存溢出。

最后一个关键问题是:当模型在本地服务器成功运行后,如何将这股底层算力稳定、高效地集成至实际业务流?这通常是落地环节的最大挑战。部分解决方案,例如能原生接入本地开源模型API的智能体平台,提供了纯私有化的安全路径。它们允许开发者通过自然语言配置,快速构建可调度内网各类封闭应用的数字员工,从而真正释放本地模型的业务潜能。