Mythos架构被22岁小伙“逆推”开源了,MoE和注意力借鉴DeepSeek

听说Mythos太危险被封印?有人反手就给他“重建”并开源了

最近AI圈有个挺有意思的事儿:传说中的Claude Mythos模型架构,虽然被Anthropic“封印”了,但社区可没闲着。这不,一个基于公开研究和主流推测的“重建版”——OpenMythos,已经开源了。

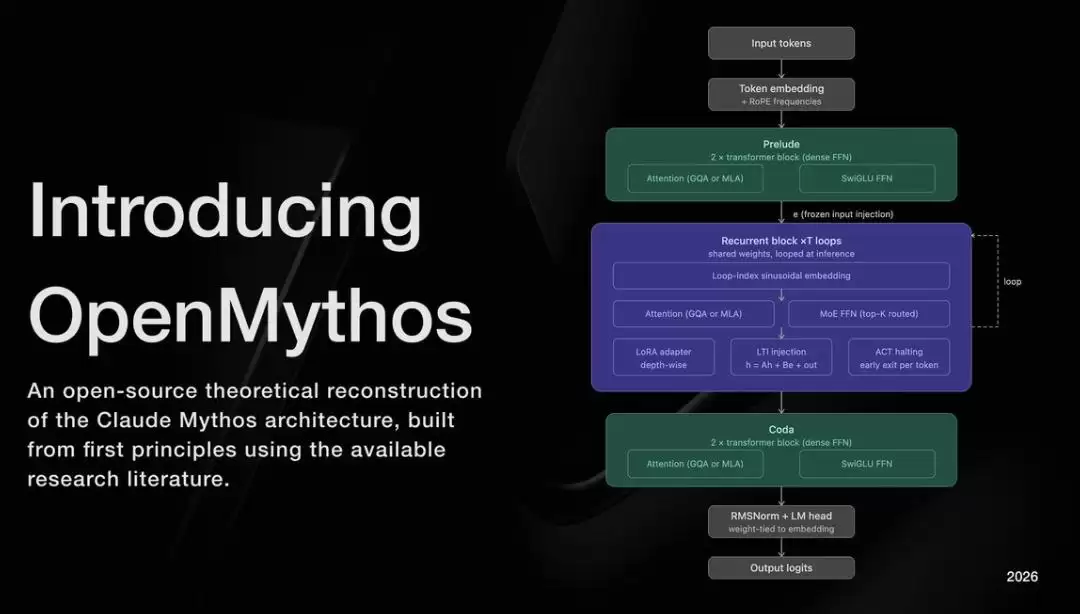

这个项目实现了一个核心架构:带有MoE路由机制的循环深度Transformer。它的精髓在于,通过跨专家的权重共享和条件计算,来实现一种迭代式的深度思考。简单说,就是让模型学会“反复琢磨”同一个问题。

已有研究证实,这种架构仅用一半的参数,就能获得与传统模型同等的效果。这听起来是不是有点碘伏?

不堆参数,堆循环

把这些技术碎片拼凑起来的人,是22岁的Kye Gomez,他也是Swarms智能体框架的创始人。

他设计的这套循环深度Transformer架构,核心思路可以归结为三点:

- 让同一组模型权重最多反复运行16次。

- 每次运行时,走不同的专家路径。

- 整个推理过程在潜在空间内完成,不对外输出中间结果。

这三者结合,指向一个结论:让一个问题“多想想”,可能比单纯堆砌参数更高效。

回顾过去两年,AI行业的标准做法是堆叠上百层不同的Transformer层,每一层学习不同的特征,代价就是参数量爆炸式增长。

而循环深度Transformer换了个思路:它不用上百层,只用几层,但允许这几层反复循环运行,最多16遍。每一遍的计算,都基于前一轮产出的结果继续深化。

问题来了:同一个模块跑16遍,难道不是重复计算、浪费算力吗?

关键在于,每次循环激活的其实是不同的“专家”。循环块内部集成了混合专家层,MoE路由器在每一轮循环中,都会动态选择激活不同的专家子集。在MoE的具体设计上,借鉴了DeepSeek-MoE的思路:使用大量细粒度的路由专家,配合少量始终在线的共享专家。

对此,Gomez有一个精妙的总结:MoE提供了领域知识的广度,而循环则赋予了推理的深度。

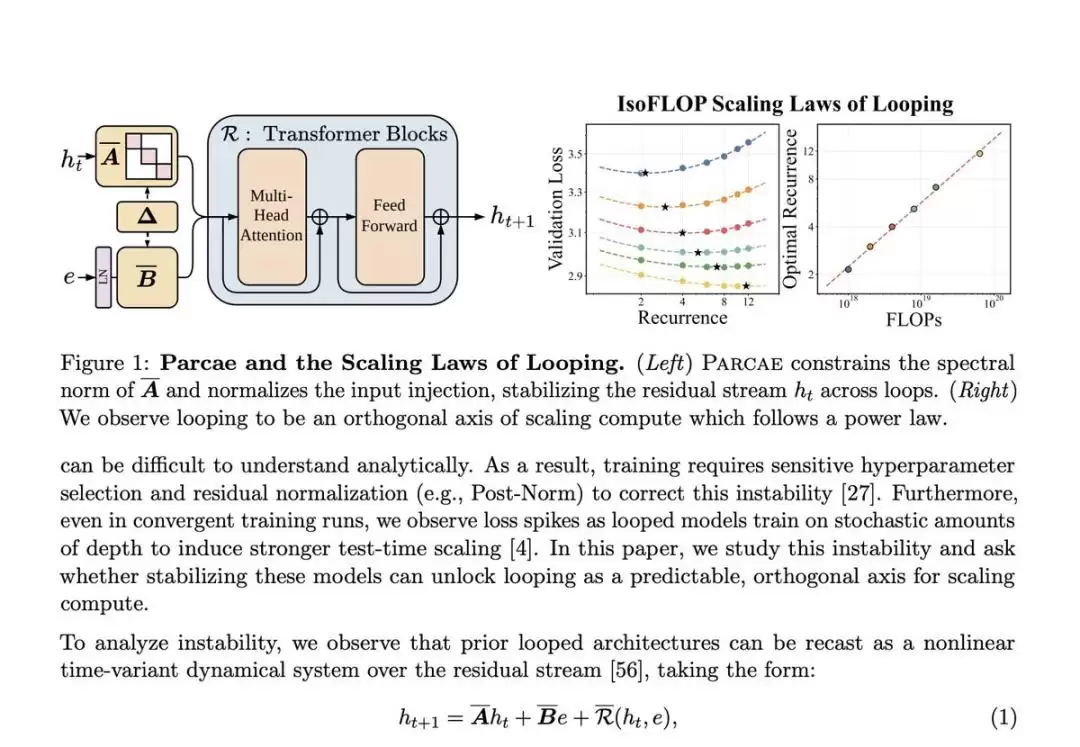

广度和深度都有了,还需要解决稳定性问题:如何确保循环不会“跑飞”或者发散?

来自UCSD和Together AI的一篇新论文《Parcae: Scaling Laws For Stable Looped Language Models》提出了解决方案:LTI稳定循环注入技术,确保每一轮循环都能稳定收敛。

实验数据很有说服力:一个仅7.7亿参数的循环深度Transformer模型,在性能上追平了13亿参数的标准Transformer模型。参数量少了近一半,效果却一样。这其中的效率提升,不言而喻。

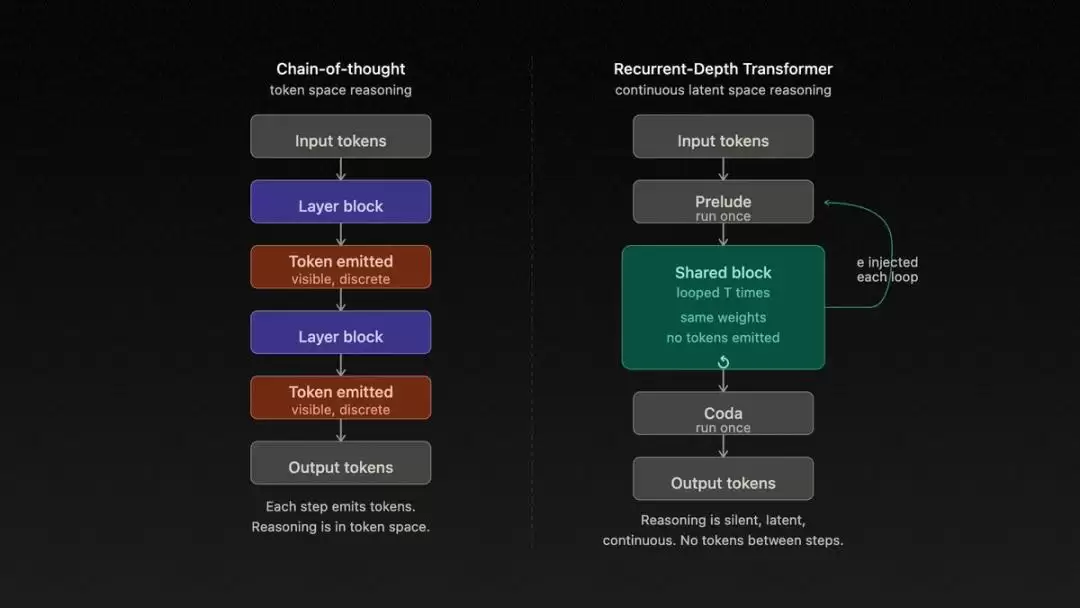

最后一块技术拼图是连续潜在空间推理。这16轮推理全部在模型的隐藏状态向量中完成,不生成任何中间的文字标记。直到最后一轮循环结束,模型才一次性输出最终答案。

这与我们熟悉的思维链推理完全不同。思维链是“想一步,写一步,再想一步”,中间过程全部暴露。而循环深度Transformer是“内部反复琢磨16遍,最后才说一句话”,整个推理过程完全内化。

为了验证这种架构的潜力,Kye还引用了俄亥俄州立大学的一篇论文,其中对循环Transformer架构做了两个关键实验。

第一个实验关于系统性泛化。

在训练中从未见过的知识组合,在推理时,循环Transformer依然能正确回答,而标准Transformer直接失败。这证明循环并非简单的重复计算,而是能够进行真正的“更深层思考”,从而组合出新的解决方案。

第二个实验关于深度外推。

模型在训练时只接触过20步的推理链,但在测试时直接给出需要30步推理的问题。循环Transformer的应对策略很直接:在推理时自动增加几轮循环即可。而标准Transformer面对这种超长推理链,表现直接崩溃。

这些实验结果揭示了一个关键趋势:当前的大语言模型在预训练中已经记住了海量事实知识,真正的瓶颈在于知识的灵活组合能力。模型往往无法将已知的事实串联起来,去回答新颖、复杂的问题。而循环机制,似乎免费解锁了这种组合推理能力。

如果这些结论得到广泛验证,那么AI模型发展的主流路径,可能将从“训练更大的模型”转向“让现有模型在推理时多想几遍”。这无疑是一个更具成本效益和实用性的方向。

至此,Anthropic的Mythos是否真的采用了这套架构,似乎已经不那么重要了。重要的是,关于循环Transformer的猜想和开源实现,已经吸引了学术界和工业界的广泛目光。更多的理论验证与实验探索,显然已经在路上了。

参考链接:

[1]https://x.com/KyeGomezB/status/2045660378844024994

[2]https://arxiv.org/abs/2604.07822[3]https://arxiv.org/abs/2604.12946