谷歌DeepMind将推Gemma 4大模型 120B参数剑指开源市场话语权

2026年:谷歌Gemma 4,能否重塑开源大模型格局?

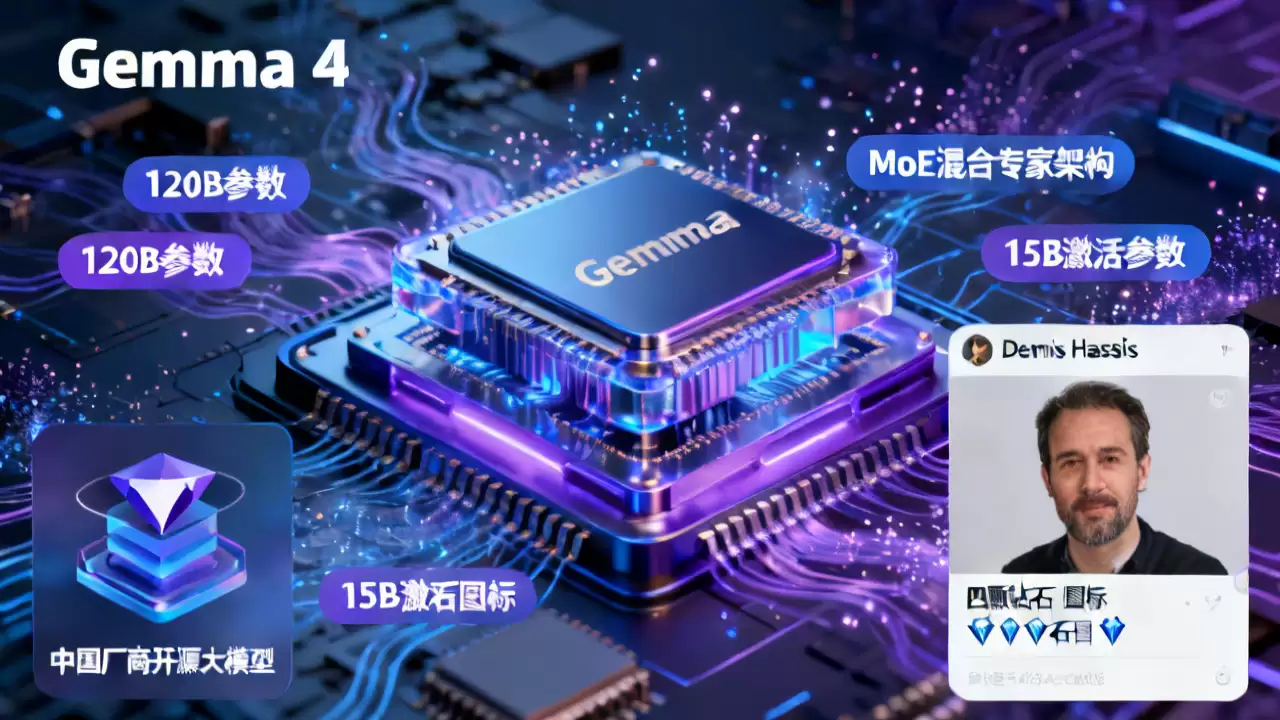

2026年4月,AI社区的目光聚焦于谷歌DeepMind。其负责人Demis Hassabis在社交平台发布的四颗钻石图标,迅速被解读为新一代开源模型Gemma 4的明确信号。核心信息已然清晰:模型总参数规模将达到120B,采用MoE(混合专家)架构,并将实际激活参数控制在15B。这一设计的直接目标,是让模型能够基于RTX 4090乃至未来的5090这类消费级显卡实现本地高效运行。谷歌此举,意在重新夺回开源大模型领域的技术定义权与生态影响力。

代号“四钻”:一次精准的迭代信号

选择在Gemma 3发布周年之际进行预热,严格遵循了谷歌既定的年度开源模型迭代节奏。四颗钻石的图标一经发布,便迅速被行业观察者与Gemma 4关联。这既是一次符合预期的版本更新宣告,也是一次成功的市场注意力调度。在高速演进的大模型赛道,头部厂商的关键节点动作,直接牵动着开发者生态与下游应用的风向。

规模与效率的平衡术:120B参数如何实现本地部署

Gemma 4标志着谷歌开源模型在参数规模上的一次重大跨越。从30B到120B的跃升,旨在追求更强大的模型性能。但随之而来的核心挑战是:如何控制部署成本?

答案在于其核心架构:MoE混合专家系统。该架构的工作原理类似于一个高度专业化的顾问团队,针对不同任务动态调用最相关的“专家”子网络。因此,尽管模型总参数量高达120B,但每次推理仅需激活约15B参数。结合成熟的4-bit或8-bit量化技术,模型完全有望适配RTX 4090/5090级别的消费级显卡内存,为本地离线部署提供了坚实的技术基础。这对于注重数据隐私、需要低延迟响应的应用场景而言,是一个极具吸引力的解决方案。

此外,Gemma 4预计将显著扩展上下文窗口长度。这一升级将直接提升其在长文本理解、复杂代码生成与连贯多轮对话等方面的能力,使其在关键性能指标上进一步逼近领先的闭源模型。

战略破局:谷歌瞄准高性能与易用性的交汇点

审视当前开源大模型市场,Meta及多家中国厂商通过强调轻量化与低部署成本,已占据了显著的生态位。谷歌此前发布的Gemma系列,在差异化竞争与市场声量上并未完全达到预期。

Gemma 4的竞争策略,精准定位了“高性能”与“低部署门槛”之间的空白市场。它试图证明,开源模型无需在能力与可用性之间妥协。能够提供接近顶级闭源模型的性能,同时保持对本地硬件环境的友好性,这一价值主张对金融、医疗、法律等合规敏感行业,以及广大的独立开发者和研究机构,具有强大的吸引力。

若Gemma 4的最终性能与发布规格相符,它很可能成为推动开源大模型技术栈向更高性能门槛演进的关键变量。这不仅关乎谷歌在开源领域的市场地位,更可能加速整个行业对大规模、高效能开源模型的工程化探索与应用落地。