MuleRun(骡子快跑)首发灰测HappyHorse模型,支持用户7x24小时调用

全球首个自进化个人AI MuleRun首发灰测阿里巴巴视频生成模型HappyHorse 1.0

4月27日下午,AI领域迎来一个值得关注的新动态:全球首个自进化个人AI“骡子快跑”(MuleRun)正式启动了对阿里巴巴视频生成模型HappyHorse 1.0的灰度测试。这意味着,用户现在可以直接在MuleRun平台输入提示词,调用这个新模型,利用其文生视频、图生视频乃至多图参考生视频的强大能力,为广告、电商、短剧、社交媒体创意等多种场景高效生产内容。

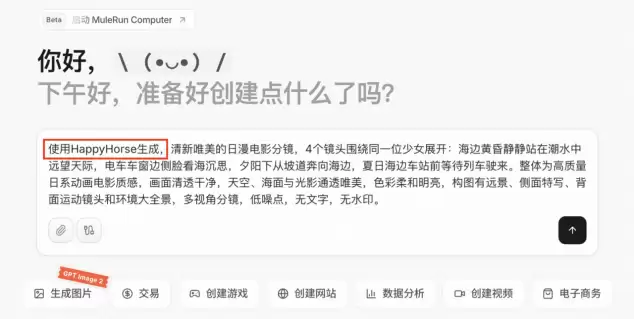

图示 在MuleRun正式调用HappyHorse

那么,MuleRun究竟有何不同?关键在于它赋予每位用户一台持续运行的独立云端虚拟机。这相当于为你配备了一位永不疲倦的数字员工,能够7x24小时待命。通过这个平台,你可以全天候地驱动HappyHorse 1.0进行视频生成与编辑。更值得关注的是,这位“数字员工”具备学习能力——它会主动观察并记住你的审美偏好、工作习惯和个人数据,随后进行自我优化,以便在视频生成任务上越来越贴合你的个性化需求。其目标很明确:帮助用户实现近乎零门槛、却又能产出高质量内容的生产流程。

此外,MuleRun还构建了一个开放的智能体(Agent)网络生态。用户可以将生成的内容直接存入平台的知识库(Knowledge),轻松实现与团队成员或好友之间的内容共享与协同创作,这无疑为创意工作流增添了新的协作维度。

话说回来,此次接入的HappyHorse 1.0模型本身也实力不俗。作为阿里巴巴最新推出的多模态视频生成模型,它支持生成长达15秒、包含多镜头叙事的视频,能适配多种画幅,并输出1080P的高清分辨率。在实际表现上,该模型在光影质感、运镜转场、人物真实感以及音画同步等方面均有优秀表现。当然,它的创意风格适配能力也相当突出,能够轻松还原诸如水墨工笔、折纸、粘土定格动画等多种独特的艺术风格。

据悉,MuleRun的模型库并不止于此。平台还接入了OpenAI最新的图像生成模型GPT-Image-2。用户可以根据需求在不同模型间自由切换,再结合MuleRun自身集成的图片与视频处理工具——从提升清晰度、剪辑裁切到添加音频——从而一站式完成从创意到成品的复杂内容生产全流程。这或许意味着,一个更加集成化、智能化的个人创作时代正在拉开序幕。

*附MuleRun正式链接:

https://mulerun.com/chat

(公众号:)