十万个why:想 Kafka 暂停消费,为什么别直接用 Thread.sleep?

Kafka消费限流:别用Thread.sleep,这才是正确的“暂停”姿势

在Kafka的消费端配置里,有一个参数至关重要:max.poll.interval.ms。它的默认值通常是5分钟,但不少团队为了能更快地感知到消费者故障,会把它设得更短。这个参数定义了消费者连续两次调用poll()方法的最大间隔时间,是服务端判断消费者是否“假死”的核心依据。

业务开发中常会遇到这样的场景:消费者从Kafka拉取数据后,需要写入数据库或调用第三方接口。结果上游生产速度过快,下游的数据库或接口因为限流等原因,处理能力跟不上了。眼看消息就要堆积,最直接的想法就是让消费者“慢下来”,比如在业务代码里加一句Thread.sleep(5000)。

在测试环境跑少量数据,看起来效果不错,消费速度确实降下来了。可一旦部署到生产环境,面对真实的流量冲击,线上告警立刻就会响起来。

为什么简单的Sleep会引发灾难?

这里需要理解现代Kafka版本的一个关键机制:心跳(Heartbeat)和消息拉取(Polling)是解耦的。维持心跳的任务由一个独立的后台线程负责。也就是说,即使你在主业务线程里执行了sleep,心跳依然会正常发送,Broker知道你的消费者进程还“活着”。

但问题在于,Broker不仅需要知道进程存在,更需要确认主消费线程仍在正常工作,没有卡死在某个地方。而max.poll.interval.ms这个参数,监控的正是主线程调用poll()的间隔。

当你使用Thread.sleep时,实质上是强行挂起了消费主线程。如果业务逻辑的处理时间,再加上你主动sleep的时间,总和超过了max.poll.interval.ms的限制,Kafka的协调者(Coordinator)就会判定:这个消费者虽然有心跳,但已经丧失了处理能力,处于一种“假死”状态。

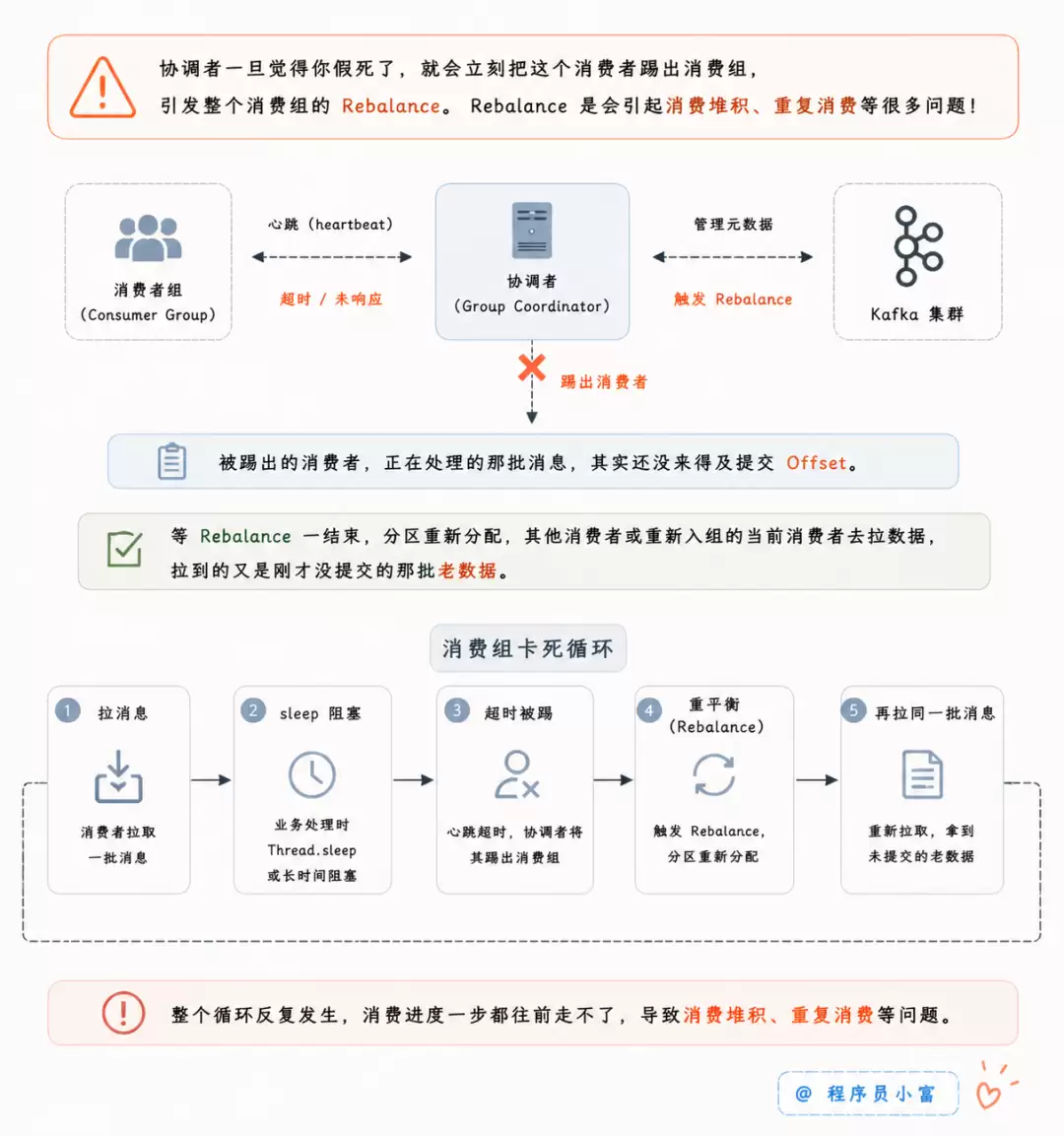

随之而来的是一连串的恶性循环

协调者一旦认定消费者假死,会立即将其踢出消费组,从而触发整个消费组的重平衡(Rebalance)。重平衡本身就会导致消费暂停、消息重复等一系列问题。

更棘手的是,被踢出的消费者,其正在处理的那批消息的偏移量(Offset)很可能还没来得及提交。重平衡结束后,分区被重新分配,其他消费者(或重新入组的原消费者)再次拉取数据,拿到手的还是刚才那批“旧消息”。

于是,熟悉的剧情再次上演:处理业务 -> 触发sleep -> 超时被踢 -> 重平衡 -> 拉取同一批消息。整个消费组就这样陷入了一个无法自拔的死循环:拉消息 -> 阻塞 -> 超时被踢 -> 重平衡 -> 再拉同一批消息。

如何正确实现Kafka消费暂停?

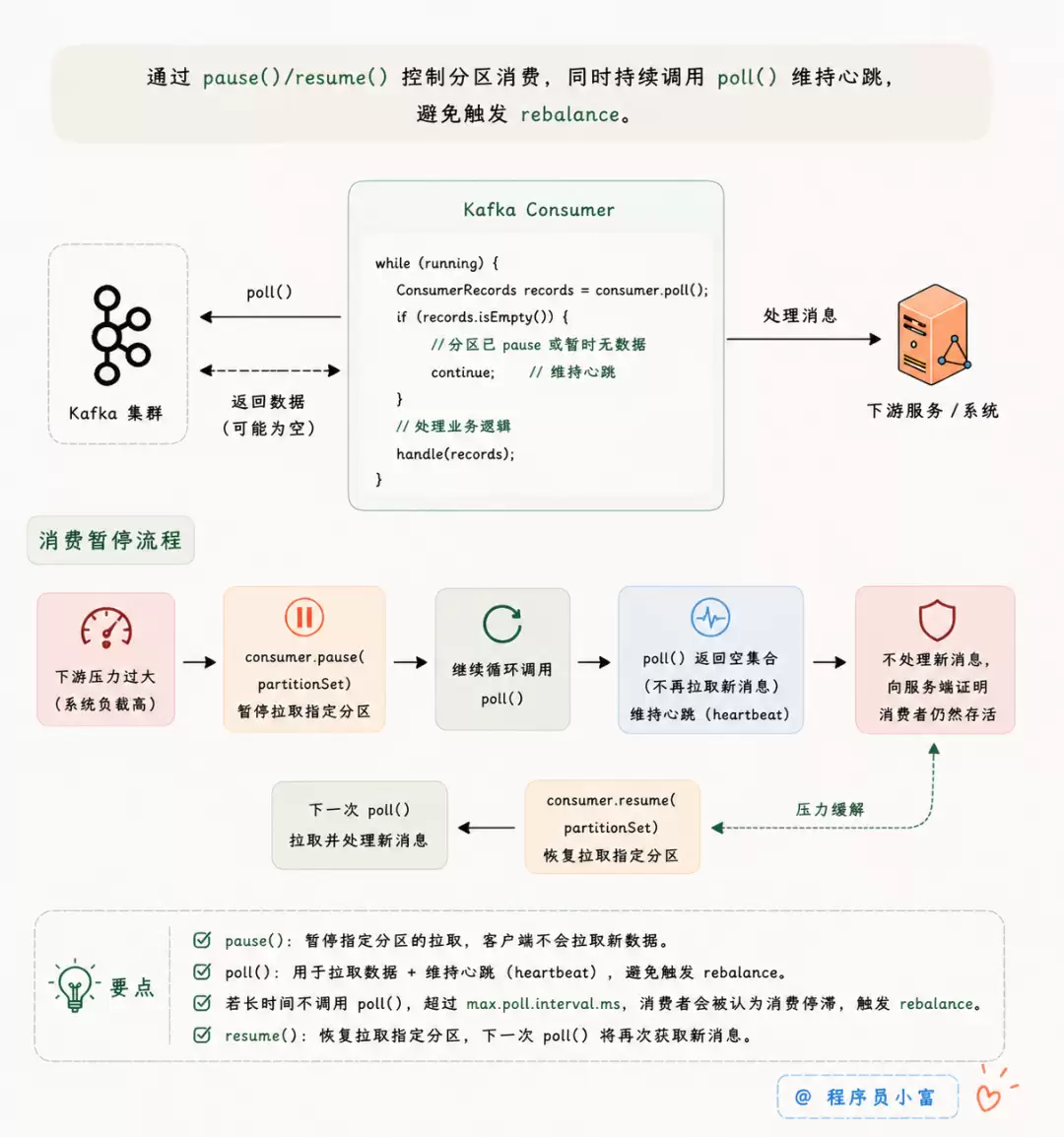

既要达到暂停拉取新消息的目的,又要让Kafka确信主线程活力依旧,核心思路其实很清晰:保持poll()的调用循环不中断,但同时明确告知服务端“暂时别再给我发新数据了”。

这正好可以利用Kafka消费者客户端原生的pause()和resume()方法来实现。

当系统探测到下游处理能力不足时,立即调用consumer.pause()暂停当前分配到的所有分区。最关键的一步随之而来:主线程的外层循环必须继续正常调用poll()。

由于分区已被暂停,此时的poll()会立即返回一个空集合,不会拿到新数据,业务逻辑自然也不会执行。正是这一次次看似“空转”的poll()调用,持续向服务端证明着主线程的活跃。等到下游压力缓解,再调用consumer.resume()恢复分区,下一次poll()就能重新获取到消息了。

其代码框架大致如下:

public void consume() {

consumer.subscribe(Collections.singletonList("biz_topic"));

while (true) {

// 正常拉取消息

ConsumerRecords records = consumer.poll(Duration.ofMillis(100));

if (!records.isEmpty()) {

// 处理业务逻辑,假设返回 true 代表下游处理不过来了

boolean isOverloaded = processRecords(records);

if (isOverloaded) {

// 拿到当前分配的所有分区

Set assignment = consumer.assignment();

// 暂停这些分区的拉取

consumer.pause(assignment);

long pauseStartTime = System.currentTimeMillis();

// 核心逻辑:暂停期间,继续用 poll 证明自己活着

while (System.currentTimeMillis() - pauseStartTime < 5000) {

// 此时 poll 返回空集合,没有新数据

consumer.poll(Duration.ofMillis(100));

}

// 5秒结束,恢复拉取

consumer.resume(assignment);

}

// 提交 Offset

consumer.commitSync();

}

}

} 在SpringBoot项目中如何优雅实现?

在Spring生态中,每一个@KafkaListener注解标注的方法,底层都会被封装到一个MessageListenerContainer(消息监听容器)中。这个容器就是那个在后台默默执行poll循环的“勤劳工人”。

我们的任务就变得简单了:为监听器指定一个ID,然后通过操作这个容器来实现暂停与恢复。Spring框架在接收到暂停指令后,会自动在底层调用原生消费者的pause()方法,并由其后台线程维持poll()的调用,完美规避max.poll.interval.ms超时的问题。

第一步:为监听器赋予唯一ID

平时开发中,@KafkaListener的id属性可能经常被忽略,但在这里它是必须的。这是后续在容器注册表中精准定位到它的关键。

@Component

public class OrderConsumer {

// 核心点:必须指定 id,它是这个消费者的唯一标识

@KafkaListener(id = "biz-order-listener", topics = "biz_topic")

public void onMessage(ConsumerRecord record) {

// 正常的业务逻辑处理

System.out.println("收到消息:" + record.value());

// 假设这里调用下游接口发现限流了,或者快被打挂了

// 注意:不要在这里直接写 Thread.sleep!

// 具体的暂停动作我们交由专门的控制逻辑来做

}

} 第二步:通过注册表控制暂停与恢复

我们需要注入KafkaListenerEndpointRegistry,它就像是所有监听容器的“管家”。下面是一个清晰的控制服务示例:

@Service

public class KafkaFlowControlService {

@Autowired

private KafkaListenerEndpointRegistry registry;

// 消费者 ID,跟上面的注解保持一致

private static final String LISTENER_ID = "biz-order-listener";

/**

* 暂停消费

*/

public void pauseConsumption() {

// 从管家手里拿到具体的监听容器

MessageListenerContainer container = registry.getListenerContainer(LISTENER_ID);

if (container != null && !container.isContainerPaused()) {

container.pause();

System.out.println("下游压力过大,已暂停 Kafka 消费拉取...");

}

}

/**

* 恢复消费

*/

public void resumeConsumption() {

MessageListenerContainer container = registry.getListenerContainer(LISTENER_ID);

if (container != null && container.isContainerPaused()) {

container.resume();

System.out.println("下游压力缓解,恢复 Kafka 消费拉取...");

}

}

}第三步:在业务流中串联控制逻辑

机制打通了,但线上真正的坑往往出现在流程衔接上。一旦调用了pause(),消费者便进入静默状态,必须有一个外部机制来将其“唤醒”。

一个比较稳妥的模式是:由业务逻辑触发暂停,由定时任务探测恢复。

例如,在@KafkaListener方法中,如果检测到连续3次调用下游接口都返回HTTP 429(请求过多),则立即调用KafkaFlowControlService.pauseConsumption()暂停消费。

同时,启动一个定时任务,每隔一分钟去探测下游服务的健康状态:

@Component

public class ResumeTask {

@Autowired

private KafkaFlowControlService flowControlService;

// 每隔 1 分钟执行一次

@Scheduled(fixedDelay = 60000)

public void checkAndResume() {

// 检查一下容器是不是在暂停状态

// 去 ping 一下下游系统的探针接口,或者看一眼 Redis 里的限流标识

boolean isDownstreamOk = checkDownstreamHealth();

if (isDownstreamOk) {

// 下游恢复了,把消费端重新拉起来

flowControlService.resumeConsumption();

}

}

}说起来,这还是一个经典的面试题。记得刚入行时被问到如何控制消费速度,我脱口而出就是用sleep,当时还觉得思路挺清晰,结果自然是被挂了。现在回想,技术细节里的魔鬼,往往就藏在这些看似简单的选择里。