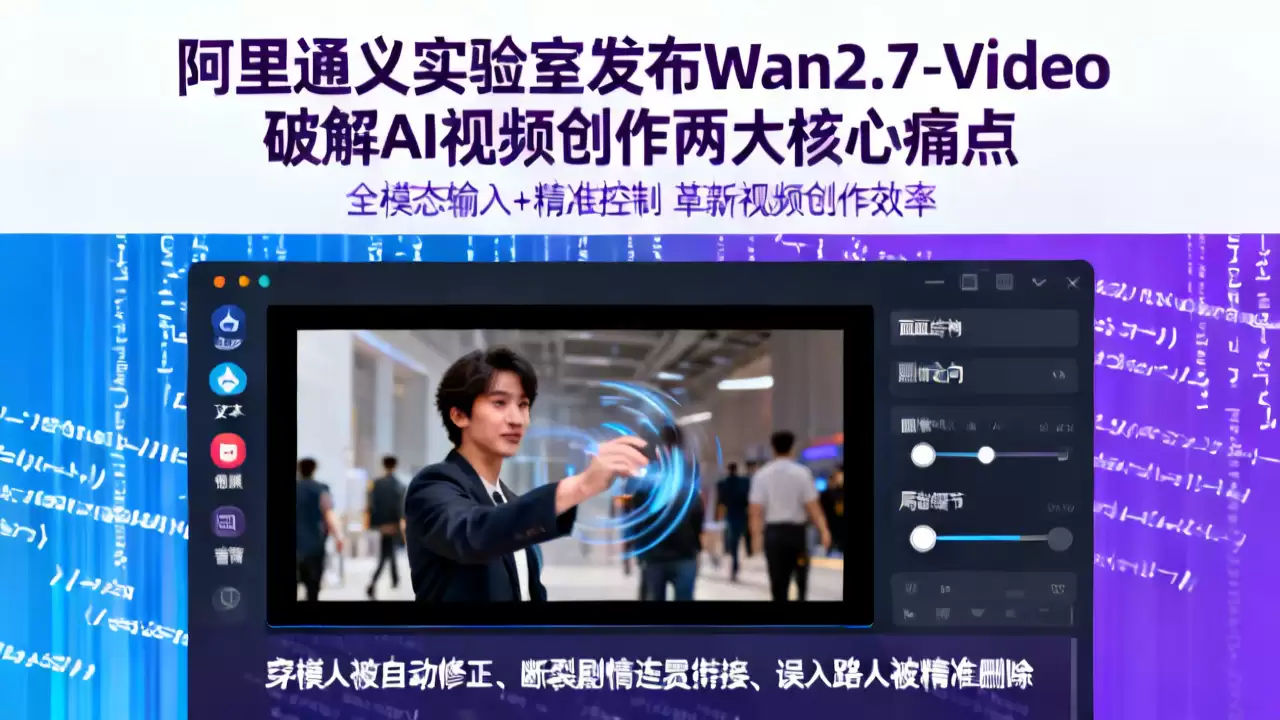

阿里通义实验室发布Wan2.7-Video 破解AI视频创作两大核心痛点

2026年4月3日,阿里通义实验室正式发布AI视频生成工具Wan2.7-Video

2026年4月伊始,阿里通义实验室就给视频创作领域带来了一枚重磅“冲击波”——专业级AI视频生成工具Wan2.7-Video正式发布。这款工具瞄准的,正是当下让无数创作者头疼的两大行业核心痛点:生成内容不够专业,以及后期修改堪比“愚公移山”。怎么说呢?它支持文本、图像、视频、音频全模态输入,能精准拿捏画面构图、剧情走向乃至局部细节,目标很明确:把专业内容创作的门槛打下来,同时把创作者的编辑自由度和灵活性提上去。

行业通病:从“眼前一亮”到“眼前一黑”,往往只需几秒

用过AI生成视频的朋友,大概率都经历过这种“坐过山车”式的心情:一开始为天马行空的创意提示词兴奋不已,等到成片出来,常常是人物莫名其妙“穿模”、剧情发展逻辑断裂。更让人崩溃的是修改过程——想删掉画面里一个误入的路人?对不起,多数工具只能让你回到起点,重新输入指令“抽卡”,祈祷下一次运气好点。为了那几秒钟能用的素材,耗上一两个小时是家常便饭。这种普遍存在的效率卡点,正是Wan2.7-Video决心要粉碎的对象。

技术迭代背后的真实瓶颈

过去两年,AI视频生成技术可谓日新月异,但热闹归热闹,距离真正在商业场景中大规模、高质量地落地,始终隔着一道明显的鸿沟。短板主要集中在两方面。

其一,是内容的专业性不足。大多数模型对画面构图、光影逻辑、剧情连贯性这些“基本功”把控欠佳,生成结果更像创意草图,距离“成品”还差着十万八千里,最终仍需投入大量人工进行剪辑和调校。

其二,就是编辑的灵活性太差。现有模式基本是“一锤子买卖”,单次生成后,任何细微的调整都可能需要推倒重来。这种模式时间成本极高,也完全无法满足那些需要多次迭代、深度定制的创作需求。

有数据为证:来自国内MCN行业的一份调研显示,目前AI生成视频的后期调整成本,竟然占到整体制作成本的60%以上,这个比例远高于传统的实拍制作模式。换句话说,工具本想帮你省事,结果却可能在后期给你制造了更多麻烦。

两大定向突破:从“全模态”输入到“图层式”编辑

那么,Wan2.7-Video具体是怎么破局的呢?它的优化路径非常清晰,就是直指上述两大痛点。

首先是 **全模态输入能力**。创作者不再被束缚于单一的文本描述。你可以同时“投喂”给它文本脚本、参考图像、粗剪视频小样,甚至是一段背景音频。模型的任务,就是充当一位理解力超强的“导演助理”,自动整合这些多维度的信息,合成出符合你所有要求的视频内容。这无疑大大降低了精准表达创意意图的门槛。

但更核心的升级,在于编辑能力的革命性突破。Wan2.7-Video实现了真正的指令化局部修改。你只需要用文字描述你的调整需求,就能精准“动刀”视频中的任意元素:框选画面里多余的路人,可以一键消失;选中一个静物,能直接替换成你指定的物品;甚至实现季节切换、画面风格转译这类复杂操作。关键是,这一切调整都不会影响视频其他未修改区域的连贯性。

这相当于把Photoshop里“图层编辑”的逻辑,完美移植到了动态视频领域。从此,修改视频可能像修改一份Word文档一样直观、可逆。毫无疑问,这才是真正释放创作自由的关键所在。

重构生产流程:从专业影视到个人创作

在行业观察者看来,Wan2.7-Video的落地,很可能将重塑整个视频内容的生产链条。

对于中小型创作者或个人博主而言,原本需要一个小型团队协作的后期剪辑工作,现在或许一个人通过指令调整就能高效完成。有预测认为,这将使内容生产周期缩短70%以上,让“一个人就是一支队伍”的口号更接近现实。

而对于影视制作、广告创意等专业领域,它的价值同样不可小觑。快速生成多个风格、不同版本的概念样片供客户选择,将大幅降低前期沟通的成本和摩擦,让创意确认流程变得更加敏捷。

未来生态:开放接口与场景融合

更具想象空间的是后续的生态拓展。据悉,通义实验室后续将开放Wan2.7-Video的API接口,支持第三方平台和工具直接接入。这意味着,它的能力未来可能会与直播、在线教育、电商展示等具体场景深度结合,催生出我们现在还难以完全预料的定制化应用与创新玩法。视频创作的“操作系统”级工具,或许已经拉开序幕。