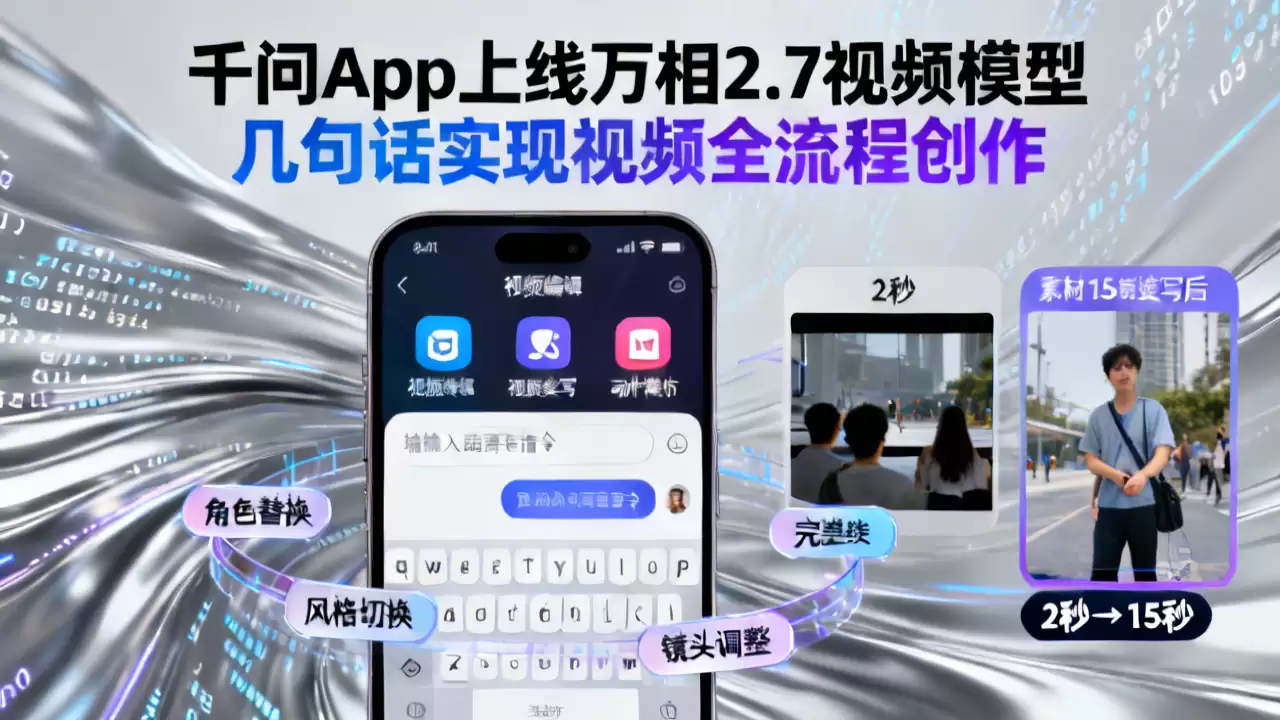

千问App上线万相2.7视频模型 几句话实现视频全流程创作

2026年4月3日:千问App发布万相2.7视频生成模型

2026年4月3日,千问App正式推出“万相2.7”(Wan2.7)视频生成大模型。此次版本升级聚焦三大核心功能:视频编辑、视频续写与动作模仿。用户通过自然语言指令,即可完成角色替换、风格迁移、镜头语言调整等专业级操作。其视频续写功能尤为突出,能将2秒的初始素材扩展为长达15秒的连贯片段,显著降低了专业视频制作的技术壁垒。

告别复杂软件:自然语言成为新“剪刀”

对于缺乏剪辑经验的用户而言,以往修改视频风格或调整角色动作,往往需要系统学习复杂的专业软件。万相2.7模型彻底重构了这一流程,将全部操作简化为自然语言交互。这意味着,无需专业背景,用户也能直接进行高质量的视频创作。

具体操作极为直观:输入需求即可。例如,替换视频中的特定元素(如将猫替换为狗)、为场景添加或移除对象、调整人物服饰与环境背景。模型能智能匹配光影与纹理,确保合成效果自然。视频风格支持一键切换,涵盖动画、3D渲染、黏土风格等十余种创意模式。用户还可直接调整角色的动作、表情与台词,系统会自动同步口型与语音。改变拍摄视角、调整镜头焦距以实现不同的叙事效果,同样只需几句描述。

突破行业痛点:从“一次生成”到“精细控制”

当前多数AI视频工具仍局限于“文本生成视频”的单次创作模式,对已有素材的精细化编辑能力不足,内容可控性一直是行业的核心挑战。

万相2.7模型的核心突破,正在于其对现有视频的精细控制能力。除了基础的编辑功能,模型新增的“视频续写”能力允许用户上传最短2秒的素材,并生成最长15秒的连贯后续内容。通过指定首尾关键帧,用户可以引导剧情走向,确保画面过渡流畅、逻辑自洽。动作模仿功能则支持指定角色复现任何参考动作,进一步拓展了创意表达的边界。

从专业工具到普惠工具:AI视频创作民主化

此前,具备高可控性的AI视频技术主要服务于专业创作领域。千问App将万相2.7的全量能力向所有消费者开放,标志着AI视频创作正从昂贵的专业工具,加速转变为普惠的日常应用。

随着大模型推理成本持续优化,未来AI视频工具的生成时长上限与输出分辨率将进一步提升。普通用户无需投入高昂设备或经历漫长学习曲线,即可实现以往需专业团队完成的视频内容。这将在短视频创作、教育可视化、内容营销等多个领域,实质性地提升创作效率与可能性。